2026年にYouTube動画を英語に翻訳する方法:3つの方法

スペイン語、日本語、または中国語のYouTube動画を見つけたけれど、英語で見たいと思ったことはありませんか?必要なチュートリアル、講義、友人が共有したバイラルクリップ、またはより広いオーディエンスのために公開したい自分の動画かもしれません。2026年には、視聴、学習、または公開するかによって選ぶべき3つの実際のオプションがあります。このガイドでは、自動字幕、音声クローンによるフルダブ、バイリンガル字幕の3つをすべて説明し、実際に重要なトレードオフについて解説します。

YouTube動画を翻訳する3つの方法

「YouTube翻訳者」という単一の存在はありません。なぜなら、1つのフレーズの下に隠れている3つの異なる問題があるからです。(1) 自分の言語で動画を見たい — これは字幕で解決され、最も早い方法です。(2) 別の言語で公開可能なバージョンが欲しい — これは音声クローンによるフルダブで解決され、遅いですがより共有可能です。(3) 視聴しながら原言語を学びたい — これはバイリンガル字幕で解決され、言語学習の理想的な方法です。

このガイドでは、3つすべてをカバーします。各方法にはカジュアルな使用のための無料またはほぼ無料のオプションと、制作に必要な仕上げを扱う有料オプションがあります。どの方法が「最良」かではなく、使用ケースによって選んでください — それぞれ異なる問題を解決します。

なぜ単一の方法ではすべてに対応できないのか

YouTubeの組み込み自動翻訳は便利ですが、粗いです — 一般的な対話にはまあまあ対応しますが、イディオム、スラング、アクセント、専門用語、文脈が重要な場所では崩れます。5分のクリップには問題ありませんが、90分の講義では、累積的なずれが視聴不可能にします。

ダブは逆のトレードオフです:制作には時間がかかりますが、視聴は容易です。字幕を読まないオーディエンス(子供、高齢者、何かをしながら視聴している人)に公開する場合、ダブは必須です。

バイリンガル字幕は言語学習者の秘密兵器です — 両方の言語を重ねて表示し、原文を聞きながら翻訳を読むことができます。これは、視聴しながら実際に*原言語を教える*唯一の方法です。

以下の3つの方法はランク付けされていません。それぞれが特定の問題を他の2つよりも優れた方法で解決します。

3つの方法を並べて比較

方法1:自動字幕 + ブラウザ翻訳(無料、最速)

最適な用途:他の言語で単一の動画を迅速に視聴すること。時間投資:30秒。

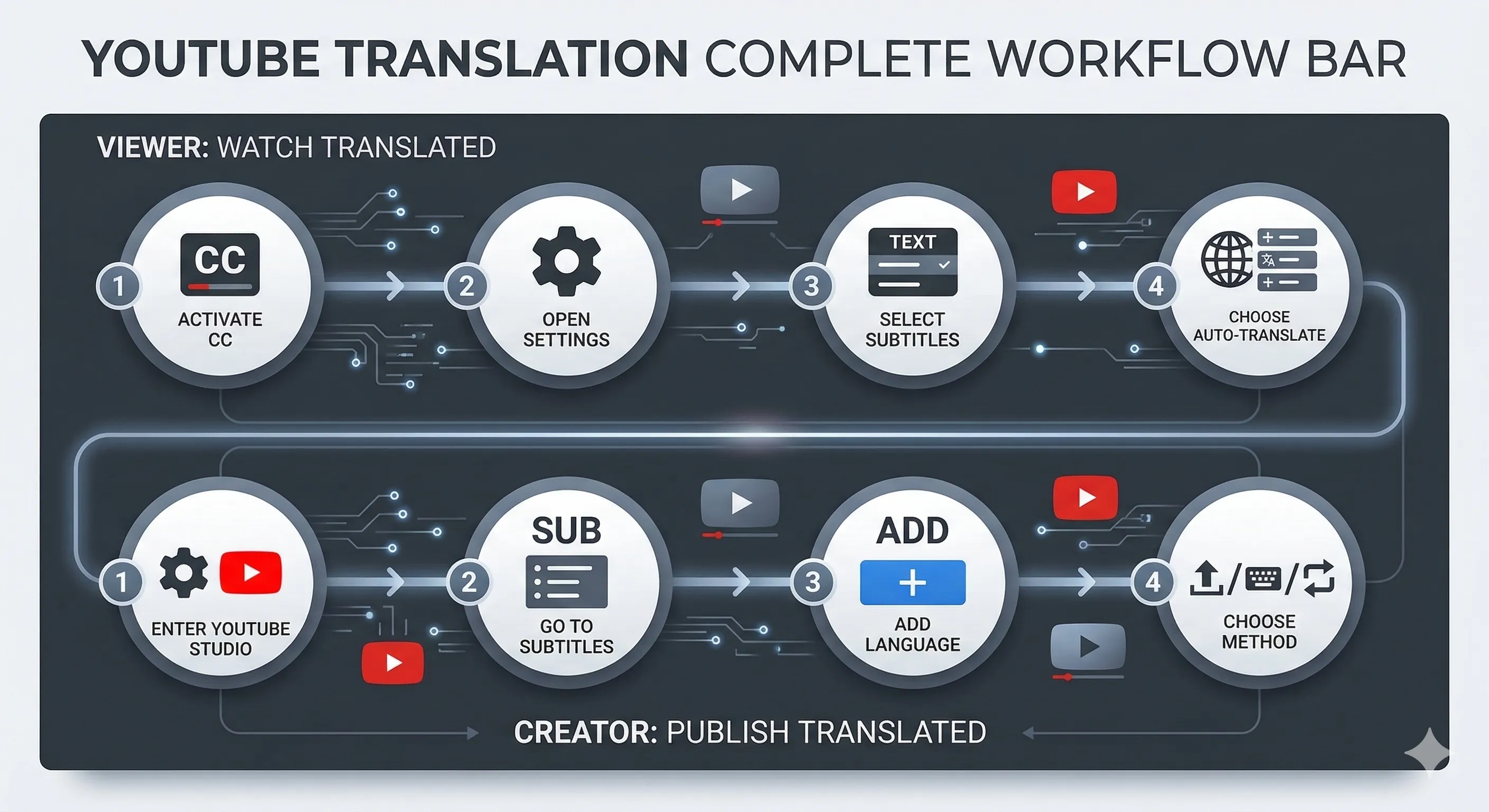

字幕が有効になっているすべてのYouTube動画は、YouTube自体によって自動翻訳できます。CCボタンをオンにし、設定ギアを開いて → 字幕 → 自動翻訳 → 英語を選択します。YouTubeはGoogleの翻訳バックエンドを使用して、リアルタイムで英語の翻訳を生成します。

うまくいくこと:主要な言語ペア(スペイン語、フランス語、ドイツ語、日本語、韓国語、中国語)の会話対話。パイプラインは無料で、即時で、クリエイターが字幕を無効にしていないすべての動画で機能します。

うまくいかないこと:専門用語(プログラミング用語、医療用語、ニッチな趣味)、強いアクセント、イディオム、速いスピーチ。翻訳は単語レベルなので、文の構造が壊れた英語として読まれることがあります。また、クリエイターが字幕を完全に無効にしている動画では、この方法はまったく適用されません。

アップグレードパス:YouTubeの自動翻訳があまりにも多くを見逃した場合は、動画のURLを/tools/video-transcriptionに貼り付けて、より洗練されたトランスクリプトを取得します — 遅いですが、特に技術的なコンテンツでははるかに高品質です。

方法2:音声クローンによるフルダブ(有料、共有可能)

最適な用途:字幕を読まないオーディエンスのために、別の言語で動画を再公開すること。時間投資:動画の1分あたり5-15分の処理時間。

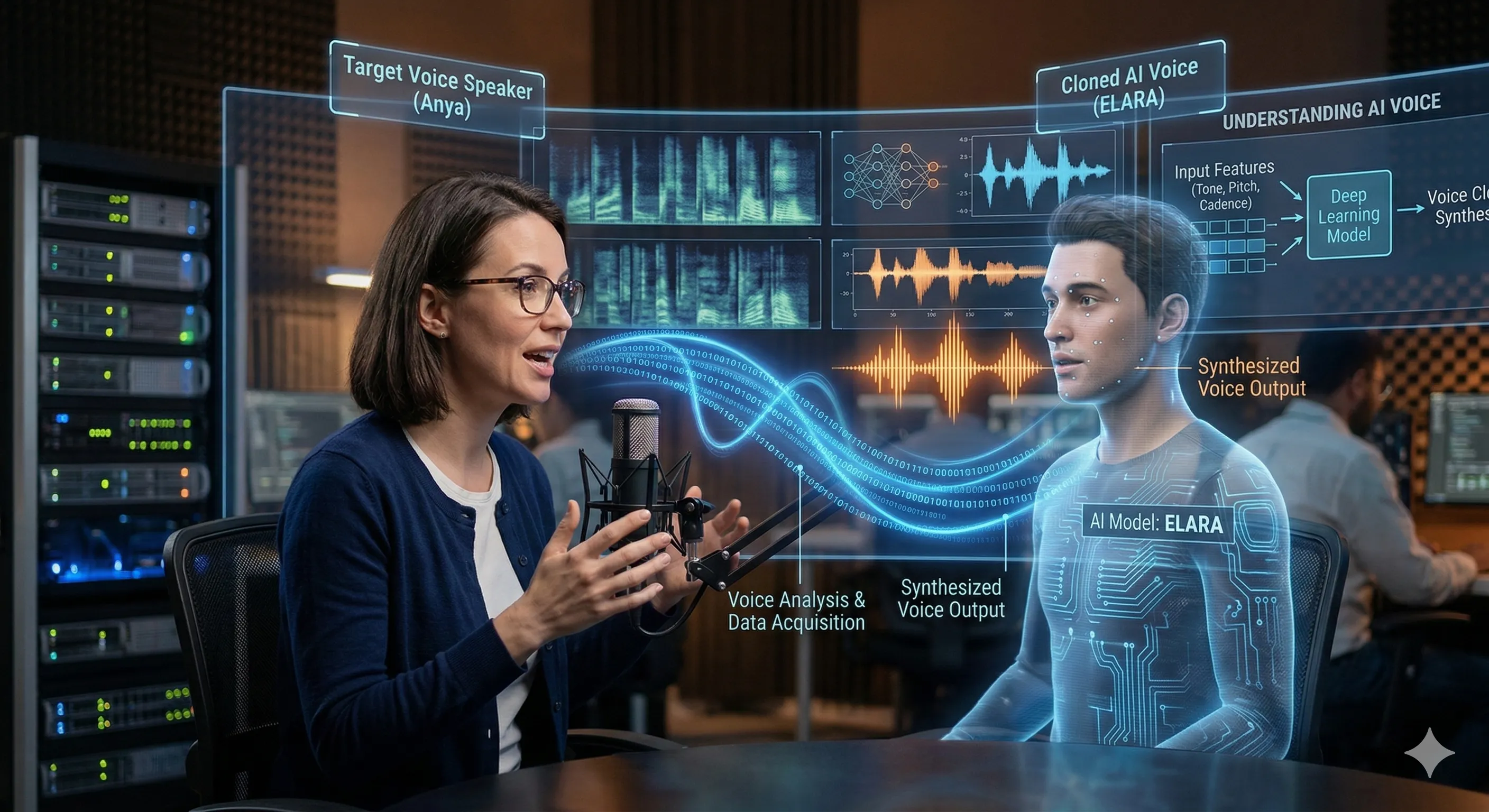

フルダブは、元の音声を英語のトラック(クローンされた声)に置き換え、口の動きをリップシンクで調整して、オーバーダブに見えないようにします。その結果、視聴可能な動画が得られ、話者が実際に英語版を言ったように聞こえます。

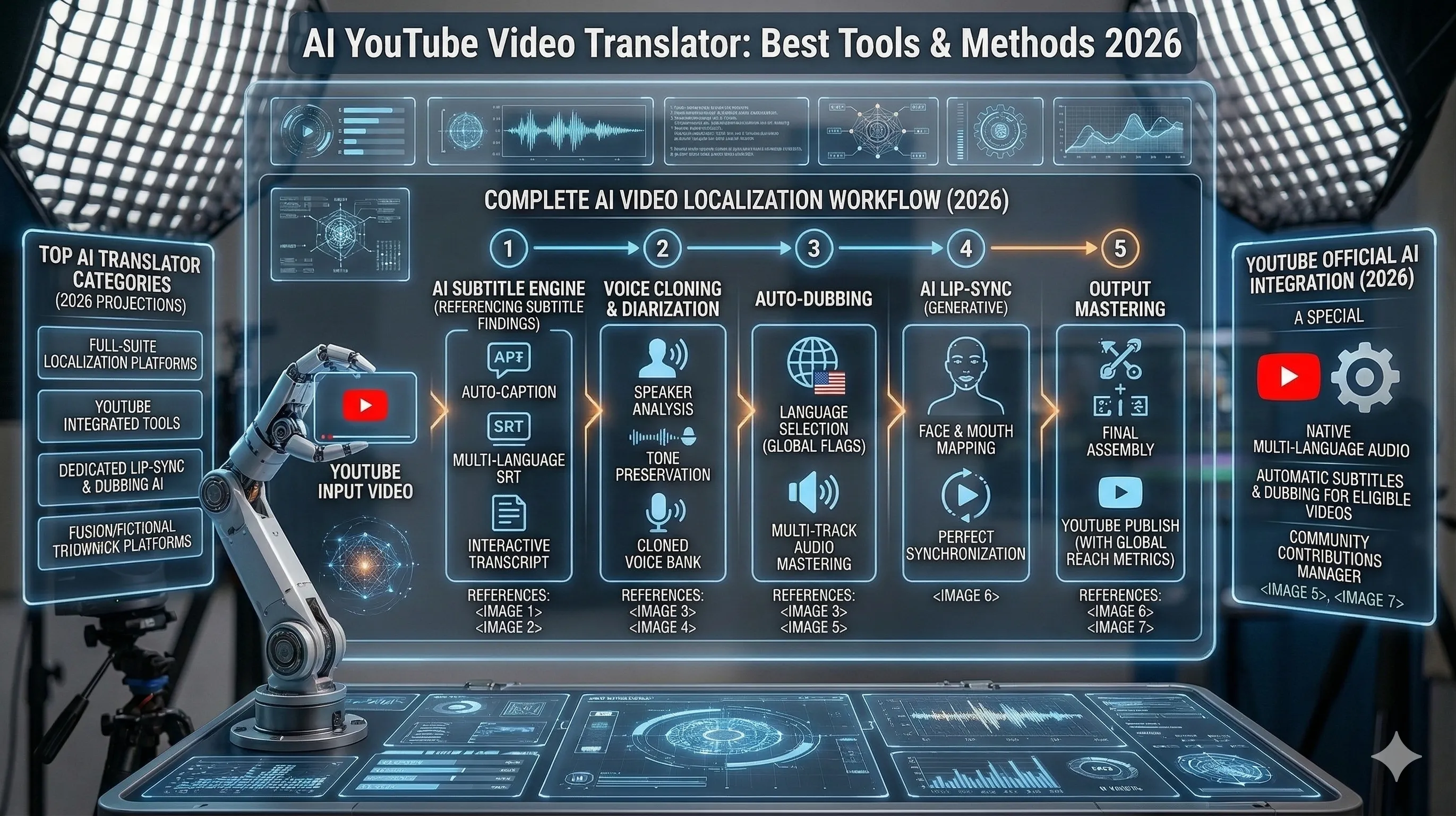

Curifyでのワークフローは、/tools/video-dubbingで:YouTubeのURLを貼り付けるか、動画をアップロードし、ターゲット言語を選択すると、パイプラインが5つのステージを実行します — 音声をバックグラウンド音楽から分離し、音声を文字起こしし、トランスクリプトを翻訳し、話者の声をクローンし、口の動きを再調整します。1回のアップロードで3つのアーティファクトが生成されます:ダブされた音声、口の動きが調整された新しい動画、そして一致する字幕ファイルです。

うまくいくこと:正面から撮影されたトーキングヘッドコンテンツ — インタビュー、講義録、製品デモ、ポッドキャスト動画。出力はトーキングヘッド映像用に公開準備が整っています。

うまくいかないこと:プロファイルアングル(リップシンクモデルは正面を向いた話者で訓練されています)、重いひげや手で顔を隠すこと(モデルが口の境界を失う)、長い口の動きの停止。話者がカメラの外にいるドキュメンタリー風のBロールの場合は、そのカットで字幕のみのローカリゼーションに戻ることを計画してください。

コスト:分単位の支払い。10分のトーキングヘッド動画は、手動ダブにかかる人間の時間とほぼ同じ処理時間がかかり、コストはごくわずかです。

方法3:バイリンガル字幕(無料または有料、学習に最適)

最適な用途:言語学習者、ESL教師、子供の第二言語露出のために動画を使用する親。時間投資:2-5分。

バイリンガル字幕は、両方の言語を重ねて表示します — 原文が1行、英語の翻訳がその直下に表示されます。原言語を聞きながら両方を読むことができ、これが実際の言語習得の仕組みです。

Curifyでのワークフローは、/tools/bilingual-subtitlesで:YouTubeのURLを貼り付け、原言語とターゲット言語を選択すると、ツールが両方の言語を同じタイムスタンプに合わせた.srtファイルを生成します。動画に焼き込むか、切り替え可能な字幕トラックとして添付します。

この方法が重要な理由:字幕のみの翻訳は、原音声の手がかりを完全に失います。バイリンガル字幕はそれを保持します。視聴しながら言語を学ぶことが目的であれば、これが唯一その目的を達成する方法です。子供に母国語を教える親にとっては特に便利です — 子供は原音声を聞きながら、両方の書かれた形を並べて見ることができます。

無料の代替手段:YouTubeで原言語のCCをオンにし、Language ReactorやSubadubのようなブラウザ拡張機能を使用して第二言語の翻訳をオーバーレイします。生成された.srtよりも正確ではありませんが、無料でブラウザ内で動作し、ダウンロードは不要です。

3つの方法の選び方

方法1(自動字幕)を選択:今すぐ、次の30秒以内に単一の動画を視聴したい場合、いくつかの行がわずかにずれていても気にしない場合。

方法2(フルダブ)を選択:動画をオーディエンスのために再公開する場合 — 自分のYouTubeチャンネル、グローバルチームのための内部トレーニング動画、販売しているコースなど。視聴者が字幕を読まない場所。

方法3(バイリンガル字幕)を選択:原言語を学んでいる、教えている、または言語学習者のためのコンテンツを作成している場合。

また、これらを組み合わせることもできます:メインのトーキングヘッドセグメントをダブ(方法2)し、教育セクションにはバイリンガル字幕(方法3)を使用し、話者がカメラの外にいるBロールには自動翻訳(方法1)を戻すことができます。Curifyのパイプラインは、1回のアップロードからすべての3つのアーティファクトを生成するため、同じソース動画が再アップロードなしで3つのオーディエンスに対応できます。

ステップ5:公開前の品質チェック

どの方法を選んでも、公開または共有する前に次の3つのチェックを行ってください:

1. 少なくとも3つのランダムなタイムスタンプで翻訳をスポットチェックします。 開始近くのもの、中間のもの、終了近くのものを選びます。原文を聞きながら翻訳を読みます。3つのうちのいずれかで明らかにずれている場合、全体のトランスクリプトも同じ問題がある可能性が高いです — 再翻訳するか、品質を受け入れます。

2. ダブされた音声(方法2のみ)をペースで聞きます。 英語の文が原文よりも短かったり長かったりすると、リップシンクがどちらかの方向にずれます。ほとんどのパイプラインは自動的にパディングや圧縮を行いますが、結果が急いでいるように聞こえたり、引き伸ばされているように聞こえたりすることがあります。目立つ場合は、異なるペース戦略で再レンダリングします。

3. プロファイルショットでのリップシンクを確認します(方法2のみ)。 これはモデルが最も失敗する場所です。重要な感情的瞬間が横から撮影されている場合、そのラインのためにリップシンクがわずかにずれて見えることを受け入れるか、異なるアングルにカットします。

カジュアルな使用の場合、方法1は品質チェックを必要としません(十分良いか、そうでないか、10秒でわかります)。方法2と3は、公開前に2分間のスキャンを行うことで報われます。

ツール比較:各方法に必要なもの

| 方法 | ツール | コスト | 時間 | 最適な用途 |

|---|---|---|---|---|

| 自動字幕 | YouTubeの組み込みCC + 自動翻訳 | 無料 | 30秒 | カジュアル視聴、単一動画 |

| 自動字幕(改善版) | Curify Video Transcription | 分単位の支払い | 2-5分 | YouTube CCがあまりにも多くを見逃した場合 |

| フルダブ | Curify Video Dubbing | 分単位の支払い | 5-15分/分 | 読まない視聴者のために再公開 |

| フルダブ(代替) | ElevenLabs Voice Studio | サブスクリプション | 手動設定 | 精密な音声制御が必要な場合 |

| バイリンガル字幕 | Curify Bilingual Subtitles | 分単位の支払い | 2-5分 | 言語学習、ESL教育 |

| バイリンガル字幕(無料) | Language Reactor + YouTube CC | 無料 | ブラウザプラグイン | 視聴しながら学ぶ、制作なし |

3つのCurifyツールは1つのパイプラインバックボーンを共有しています — YouTubeのURLを1回貼り付け、必要な出力形式を選択すると、同じアップロードで字幕ファイル、ダブ音声、またはバイリンガル

.srtが生成されます。各形式の再エンコードや再アップロードを省けます。Curifyが3つの方法を統合する方法

Curifyの/tools/video-dubbingと/tools/bilingual-subtitlesは共有パイプラインで動作するため、単一のYouTube URLアップロードからすべての3つの方法の出力を生成できます:

1. トランスクリプト(方法1のアップグレードパス) — クリーンで時間に合わせた、翻訳またはChatGPTに手渡すための準備が整ったもの。

2. ダブされた動画(方法2) — クローンされた声の翻訳音声、リップアライン、同時に生成された一致する字幕ファイル。

3. バイリンガル字幕ファイル(方法3) — 原言語とターゲット言語が同じタイムスタンプに合わせられ、動画に焼き込むか、切り替え可能なトラックとして添付する準備が整っています。

ツールは入力を共有しますが、異なる出力を生成するため、ソースを再アップロードせずにオーディエンスに合わせたアーティファクトをマッチさせることができます。料金はソース動画の分単位で、サブスクリプションや月額最低料金はありません。

各パイプラインステージがどのように機能するかのエンジニアの視点が必要な場合 — 音声ソースの分離、ニューラル翻訳、音声クローン、リップシンクの調整 — /blog/video-transcription-technical-deep-diveで生産グレードのアーキテクチャの詳細を確認してください。このガイドは同じパイプラインのユーザーの視点です。

方法を選び、パイプラインをスキップ

"YouTube動画を英語に翻訳するにはどうすればよいか"は、1つの質問ではなく3つの異なる質問です。方法1(自動字幕)はカジュアルな視聴に対応します。方法2(フルダブ)は公開に対応します。方法3(バイリンガル字幕)は学習に対応します。2024年以降、3つすべてのツールは劇的に改善されました — 以前は5つの別々のスクリプトとGPUが必要だったものが、2026年には単一のURLの貼り付けで済むようになりました。

真剣に受け止めるべき警告があります:すべてのAI翻訳パイプラインにはエッジケースがあります。強いアクセント、専門用語、速いスピーチ、プロファイルアングルのリップシンク — これらは理論的な失敗モードではなく、実際のものです。公開する前に出力をスポットチェックしてください。2分間のレビューが、素晴らしい翻訳動画と最初の30秒で視聴者を失う動画の違いです。

Take the next step

Putting what you read into practice.