Wie man Videos 2026 natürlich synchronisiert: Behebung von AI-Stimmenklonartefakten

Ein umfassender Leitfaden zur Lösung häufiger Synchronisationsprobleme mit AI-Tools. Fokussieren Sie sich auf Schmerzpunkte wie robotisches Pacing, Mangel an Emotionen und Lippen-Synchronisationsprobleme.

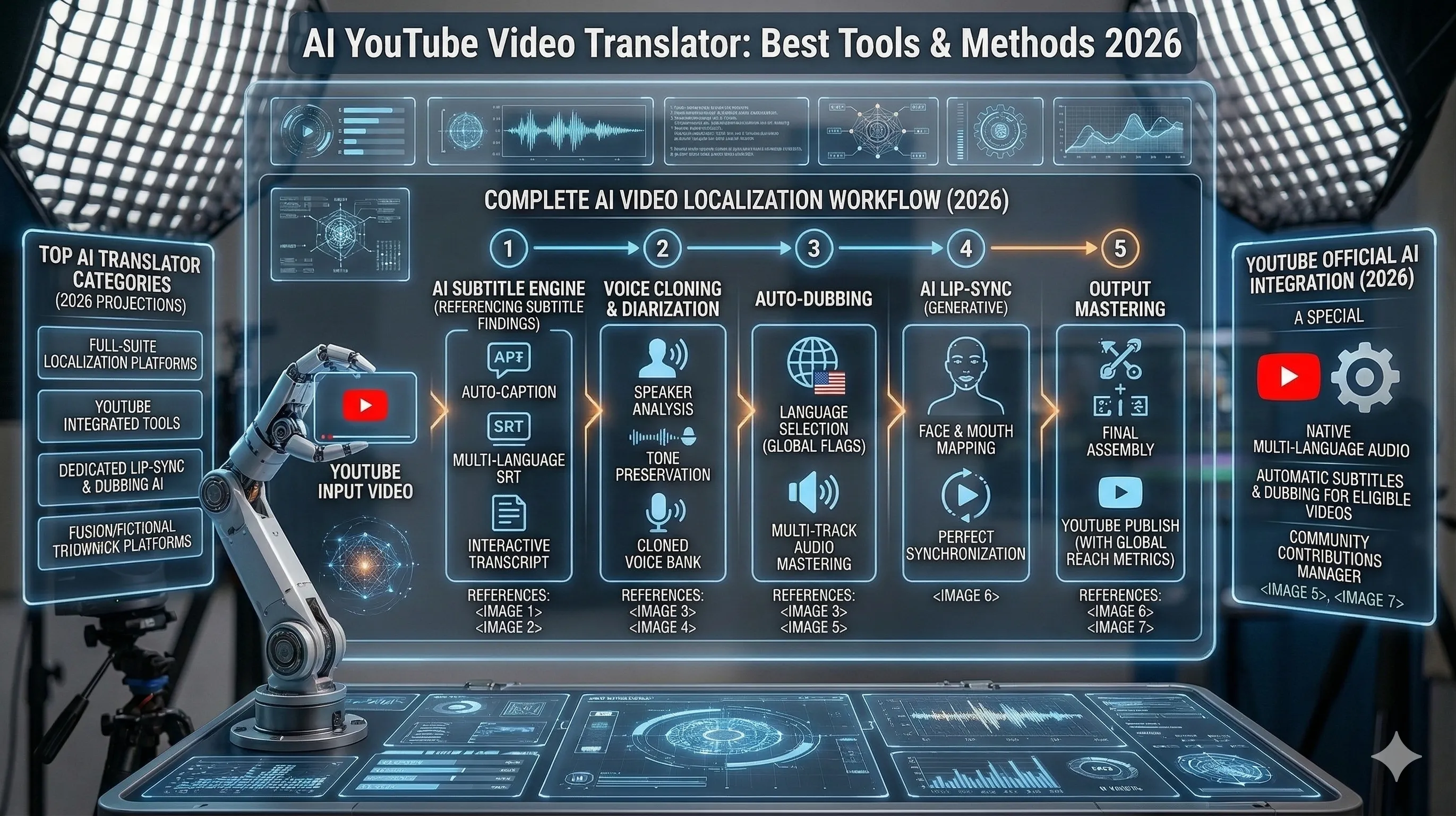

AI-Video-Synchronisation hat die Inhaltserstellung revolutioniert, aber robotische Artefakte und unnatürliches Pacing plagen immer noch viele Produktionen. Im Jahr 2026 haben wir bessere Werkzeuge und Techniken, um diese Herausforderungen zu überwinden. Das Kernproblem liegt darin, wie die meisten Synchronisationspipelines Sprache als rein technische Schicht behandeln, anstatt als Aufführung. Viele Systeme erzeugen immer noch Audio mit flacher Prosodie, inkonsistenter Betonung und schlecht getimten Pausen, was die Immersion bricht, selbst wenn die Stimme selbst realistisch klingt. Zuschauer sind sehr empfindlich gegenüber Timing-Diskrepanzen – wenn emotionale Beats, Mikro-Pausen oder Satzbetonungen nicht mit der visuellen Aufführung übereinstimmen, fühlt sich das Ergebnis subtil „falsch“ an, auch wenn sie nicht artikulieren können, warum. Moderne Ansätze adressieren dies, indem sie sich auf Prosodiekontrolle und zeitliche Ausrichtung konzentrieren. Anstatt Sprache linear zu erzeugen, integrieren neuere Modelle rhythmusbewusste Synthese, die es den Erstellern ermöglicht, das Pacing auf der Phrase- und Silbenebene zu steuern. Dies macht es möglich, Lippenbewegungen abzugleichen, dramatische Pausen zu bewahren und die ursprüngliche Absicht des Sprechers über Sprachen hinweg aufrechtzuerhalten. Techniken wie erzwungene Ausrichtung, Phonem-timing und Referenz-Audio-Bedingung werden jetzt in hochwertigen Pipelines zum Standard. Eine weitere wesentliche Verbesserung kommt von kontextbewusstem Stimmmodellieren. Anstatt jede Zeile isoliert zu erzeugen, behalten fortgeschrittene Systeme das Gedächtnis des Gesprächs – sie verfolgen Ton, emotionalen Zustand und Sprecher-Dynamik über Szenen hinweg. Dies reduziert den tonal drift und stellt sicher, dass ein Charakter konsistent klingt, egal ob er flüstert, streitet oder Exposition liefert. Für narrativ-lastige Inhalte verbessert dieser Wechsel allein die wahrgenommene Realität dramatisch. Schließlich hat der Aufstieg von Human-in-the-Loop-Workflows die Kluft zwischen Automatisierung und Qualität geschlossen. Ersteller kombinieren jetzt AI-Generierung mit leichten Bearbeitungsschichten – Feinabstimmung von Pausen, Anpassung der Betonung oder Regenerierung spezifischer Segmente anstelle ganzer Clips. Dieser hybride Ansatz balanciert Effizienz mit kreativer Kontrolle und ermöglicht es Produktionsteams, die Synchronisation zu skalieren und gleichzeitig Ergebnisse auf Studio-Niveau zu erzielen. Gemeinsam bewegen diese Fortschritte die AI-Synchronisation von einem praktischen Werkzeug zu einer produktionsgerechten Lösung, die in der Lage ist, natürliche, emotional resonante Aufführungen über Sprachen hinweg zu liefern, ohne Geschwindigkeit oder Skalierbarkeit zu opfern.

Dieser Leitfaden zeigt Ihnen, wie Sie häufige Synchronisationsprobleme beheben können, indem Sie modernste AI-Tools wie MuseTalk, Emotion TTS und fortgeschrittene Nachbearbeitungstechniken verwenden. Wir gehen über die grundlegende Sprachgenerierung hinaus, um die hartnäckigsten Fehlerpunkte in AI-Synchronisations-Workflows anzugehen – Lippen-Synchronisationsdrift, monotone Lieferung, Timing-Diskrepanzen und emotionale Flachheit. Sie lernen, wie Sie MuseTalk für präzise visuelle-audio Ausrichtung verwenden, um sicherzustellen, dass generierte Sprachspuren eng mit Lippenbewegungen und Gesichtsausdrücken übereinstimmen, selbst in schnellen oder dialoglastigen Szenen. Auf der Audio-Seite erläutern wir, wie man Emotion TTS-Systeme nutzt, um kontrollierte Ausdruckskraft in generierte Stimmen einzufügen. Anstatt sich auf generische Voreinstellungen zu verlassen, führt der Leitfaden durch, wie man Tonhöhenkonturen, Pacing und Betonung anpasst, um die Absicht widerzuspiegeln – sei es Spannung, Sarkasmus oder subtile emotionale Verschiebungen innerhalb einer einzigen Zeile. Dies ermöglicht es Ihnen, von „technisch korrektem“ Audio zu Aufführungen zu wechseln, die menschlich und kontextuell verankert wirken. Wir behandeln auch fortgeschrittene Nachbearbeitungs-Workflows, die einen entscheidenden Unterschied in der endgültigen Ausgabequalität machen. Dazu gehören Phonem-timing-Anpassungen, Stille-Trimming und -Erweiterung, Einfügen von Atem- und Pauseneinfügungen sowie Audio-Mastering-Techniken wie EQ-Abgleich und Lautstärke-Normalisierung, um synchronisierte Stimmen nahtlos in den Original-Soundtrack zu integrieren. Durch die Kombination dieser Werkzeuge und Techniken in einer kohärenten Pipeline können Sie systematisch Synchronisationsprobleme diagnostizieren und beheben, anstatt auf Trial-and-Error zu setzen – und inkonsistente AI-Ausgaben in polierte, produktionsbereite Dialoge zu verwandeln.

Pro Tip

Häufige AI-Synchronisationsprobleme

🤖 Robotisches Pacing

AI-generierte Sprache fehlt oft der natürliche Rhythmus und das Timing, was sie mechanisch und distanziert klingen lässt.

Zuschauer-Entfremdung

Unnatürliches Pacing bricht die Immersion und reduziert die Zuschauerbindung um bis zu 40%.

😐 Mangel an emotionaler Nuance

AI-Stimmen haben Schwierigkeiten, subtile Emotionen zu vermitteln, wodurch dramatische Szenen flach wirken.

Emotionale Trennung

Fehlende emotionale Hinweise verhindern, dass Zuschauer eine Verbindung zu Charakteren und Geschichte aufbauen.

👄 Lippen-Synchronisationsfehler

Schlechte Ausrichtung zwischen Audio und visuellen Lippenbewegungen erzeugt einen unheimlichen Effekt.

Unrealistische Erscheinung

Sichtbare Lippen-Synchronisationsfehler brechen sofort die Illusion natürlicher Sprache.

Transformieren Sie Ihr Video-Dubbing mit KI

Durch die Kombination dieser fortschrittlichen Techniken und Tools können Sie natürliche, emotional ansprechende synchronisierte Inhalte erstellen, die das Publikum fesseln. Die Zukunft des KI-Dubbings ist da, und sie ist menschlicher denn je.