KI Lip Sync in der Produktion: Wie MuseTalk und Sync.co wirklich funktionieren

Gehen Sie über die Oberfläche hinaus und erkunden Sie die technische Architektur, die moderne KI-Lip-Sync-Systeme antreibt. Dieser umfassende Deep-Dive untersucht die Open-Source-Implementierung von MuseTalk, die kommerzielle API von Sync.co und das Produktionsdesign für unternehmensgroße Video-Synchronisation und Gesichtsanimation.

End-to-End Lip Sync Pipeline Architektur

Eine produktionsgerechte KI-Lip-Sync-Pipeline verwandelt Video- und Audioeingaben in perfekt synchronisierte synchronisierte Inhalte durch mehrere anspruchsvolle Verarbeitungsstufen. Der vollständige Workflow: Eingabevideo → Gesichtserkennung → Landmarkenextraktion → Audioanalyse → Lippenbewegungsgenerierung → Gesichtswiederherstellung → Nachbearbeitung → Ausgabevideo.

Jede Stufe adressiert spezifische technische Herausforderungen: Gesichtserkennung isoliert Sprecher, Landmarkenextraktion verfolgt Gesichtszüge, Audioanalyse verarbeitet Sprachmuster, Lippenbewegungsgenerierung erstellt synchronisierte Animationen, Gesichtswiederherstellung verbindet neue Lippen mit bestehenden Ausdrücken und Nachbearbeitung sorgt für nahtlose Integration.

Moderne Systeme wie MuseTalk und kommerzielle APIs erreichen über 90 % Realismus durch Kombinationen von GANs (Generative Adversarial Networks), Diffusionsmodellen und zeitlichen Konsistenzalgorithmen. Dieser technische Deep Dive untersucht jede Komponente, ihre Integrationsstrategien und die Abwägungen zwischen Open-Source- und kommerziellen Lösungen.

Warum technische Architektur für Lip Sync wichtig ist

Realismus vs. Rechenkosten: Höhere Auflösungsmodelle erzeugen realistischere Ergebnisse, erfordern jedoch erhebliche GPU-Ressourcen und Verarbeitungszeit. Produktionssysteme müssen Qualität mit Betriebskosten in Einklang bringen.

Zeitliche Konsistenz: Die Aufrechterhaltung reibungsloser Übergänge zwischen Frames und die Vermeidung von Flackern oder Artefakten erfordert anspruchsvolles zeitliches Modellieren und Konsistenzbedingungen über die gesamte Videosequenz.

Identitätserhaltung: Das System muss die Identität des ursprünglichen Sprechers beibehalten, während nur die Mundbewegungen modifiziert werden. Dies erfordert eine sorgfältige Trennung von Identitätsmerkmalen und sprachbezogenen Gesichtbewegungen.

Herausforderungen bei der Skalierbarkeit: Echtzeitanwendungen erfordern Streaming-Verarbeitung und latenzfreie Inferenz, während die Batchverarbeitung für Durchsatz und Kosteneffizienz in Produktionsumgebungen optimiert werden kann.

Kerntechnische Komponenten

Gesichtserkennung und Landmarkenextraktion

Die Pipeline beginnt mit einer anspruchsvollen Gesichtserkennungstechnologie, die Sprecher in jedem Videobild lokalisieren kann. Sobald Gesichter identifiziert sind, extrahiert das System präzise Gesichtspunkte - es werden 468 Schlüsselstellen um den Mund, die Augen und andere Gesichtszüge abgebildet.

Diese detaillierte Abbildung ermöglicht es dem System, die genaue Form und Position des Mundes des Sprechers zu jedem Zeitpunkt zu verstehen und bildet die Grundlage für eine genaue Lippen-Synchronisation. Die Technologie funktioniert zuverlässig unter verschiedenen Lichtbedingungen, Winkeln und sogar mit mehreren Personen im Bild.

Audioverarbeitung und Merkmals-Extraktion

Die Audioverarbeitungspipeline wandelt die Zielansprache in zeitliche Merkmale um, die die Lippen-Sync-Generierung antreiben. Systeme extrahieren Mel-Spektrogramme (80 Mel-Bins, 1024 FFT, 160 Hop), MFCCs und Phonem-Ausrichtungen über Wav2Vec2-Embeddings (facebook/wav2vec2-base) und librosa-Vorverarbeitung bei 16 kHz SR. Die Implementierung lädt die Wellenform über librosa.load(), berechnet librosa.feature.melspectrogram(), das in dB-Skala umgewandelt wird, verarbeitet durch Wav2Vec2Processor/Wav2Vec2Model für kontextuelle Embeddings (last_hidden_state) und wendet die erzwungene Ausrichtung (get_phoneme_alignment(audio_path, transcript)) für präzises Viseme-Timing an. Das zurückgegebene Dict enthält mel_spectrogram, audio_embeddings und phoneme_alignment – es erfasst spektrale Hüllen, zeitliche Phonemgrenzen und semantische Sprachmuster, die direkt mit artikulatorischen Mundkinematiken übereinstimmen.

Lippenbewegungsgenerierung mit neuronalen Netzwerken

Die Kernlippen-Sync-Generierung verwendet anspruchsvolle neuronale Architekturen, um Audio-Merkmale den entsprechenden Mundbewegungen zuzuordnen. Moderne Systeme verwenden Kombinationen aus zeitlichen Faltungsnetzwerken, Transformatoren und GANs, um realistische Lippenformen zu erzeugen, die mit dem Ziel-Audio übereinstimmen und gleichzeitig die Identität des Sprechers bewahren.

Technische Implementierung:

Lippenbewegungsgenerierung mit zeitlichem GAN

import torch

import torch.nn as nn

class LipSyncGenerator(nn.Module):

def __init__(self, audio_dim=80, landmark_dim=51, hidden_dim=512):

super().__init__()

# Audio-Encoder

self.audio_encoder = nn.Sequential(

nn.Conv1d(audio_dim, hidden_dim, kernel_size=3, padding=1),

nn.ReLU(),

nn.Conv1d(hidden_dim, hidden_dim, kernel_size=3, padding=1),

nn.ReLU(),

)

# Zeitlicher Transformator für Sequenzmodellierung

self.temporal_transformer = nn.TransformerEncoder(

nn.TransformerEncoderLayer(

d_model=hidden_dim,

nhead=8,

dim_feedforward=hidden_dim * 4

),

num_layers=6

)

# Landmarken-Decoder

self.landmark_decoder = nn.Sequential(

nn.Linear(hidden_dim, hidden_dim),

nn.ReLU(),

nn.Linear(hidden_dim, landmark_dim),

nn.Tanh() # Normalisieren Sie die Landmarken-Koordinaten

)

# Identitätserhaltungsschicht

self.identity_encoder = nn.Sequential(

nn.Linear(landmark_dim * 2, hidden_dim), # Aktuelle + Referenz-Landmarken

nn.ReLU(),

nn.Linear(hidden_dim, hidden_dim)

)

def forward(self, audio_features, reference_landmarks):

# Kodieren Sie Audio-Merkmale

audio_encoded = self.audio_encoder(audio_features)

audio_encoded = audio_encoded.transpose(1, 2) # (B, T, D)

# Wenden Sie zeitliches Modellieren an

temporal_features = self.temporal_transformer(audio_encoded)

# Generieren Sie Landmarkenbewegungen

generated_landmarks = self.landmark_decoder(temporal_features)

# Bewahren Sie die Identität des Sprechers

identity_features = self.identity_encoder(

torch.cat([generated_landmarks, reference_landmarks], dim=-1)

)

# Mischen Sie generierte Bewegungen mit Identitätserhaltung

final_landmarks = generated_landmarks + 0.1 * identity_features

return final_landmarks

Initialisieren und trainieren Sie den Generator

generator = LipSyncGenerator()

optimizer = torch.optim.Adam(generator.parameters(), lr=1e-4)

Trainingsschleife mit adversarialem Verlust

def train_lip_sync_model(generator, discriminator, dataloader, epochs=100):

for epoch in range(epochs):

for batch in dataloader:

audio_features, reference_landmarks, target_landmarks = batch

# Generieren Sie gefälschte Landmarken

fake_landmarks = generator(audio_features, reference_landmarks)

# Adversariales Training

real_loss = discriminator(target_landmarks)

fake_loss = discriminator(fake_landmarks)

# Verlust des Generators (adversarial + Rekonstruktion)

g_loss = -fake_loss.mean() + nn.MSELoss()(fake_landmarks, target_landmarks)

# Rückpropagation

optimizer.zero_grad()

g_loss.backward()

optimizer.step()

Der Generator lernt, Audio-Merkmale den entsprechenden Mundbewegungen zuzuordnen, während der Diskriminator die Realität sicherstellt. Die Identitätserhaltungskomponente bewahrt die einzigartigen Gesichtszüge des Sprechers.

Gesichtswiederherstellung und -mischung

Die Gesichtswiederherstellung kombiniert die generierten Lippenbewegungen mit den ursprünglichen Gesichtszügen und schafft ein nahtloses Endergebnis. Diese Phase verwendet bildbasierte Rendering, Poisson-Mischung und zeitliches Glätten, um neue Mundregionen mit bestehenden Ausdrücken zu integrieren und dabei ein natürliches Aussehen zu bewahren.

Nachbearbeitung und Qualitätssicherung

Die letzte Phase wendet zeitliche Glättung, Farbkorrektur und Artefaktentfernung an, um eine professionelle Ausgabequalität zu gewährleisten. Fortgeschrittene Systeme nutzen optischen Fluss für Konsistenzprüfungen und automatisierte Qualitätsmetriken, um potenzielle Probleme vor der menschlichen Überprüfung zu erkennen.

Vergleich der technischen Architektur

| Komponente | MuseTalk (Open Source) | Sync.co (Kommerziell) | Unternehmens-Pipeline |

|---|---|---|---|

| Gesichtserkennung | MediaPipe | Benutzerdefiniertes CNN | Multi-Skalenerkennung |

| Audioverarbeitung | Librosa + Wav2Vec2 | Proprietäres ASR | Benutzerdefinierte Audiomodelle |

| Lippen-Generierung | Temporales GAN | Diffusionsmodelle | Hybrides GAN + Diffusion |

| Qualitätskontrolle | Grundlegende Metriken | Automatisierte QA | Menschliche + KI-Überprüfung |

| Verarbeitungsgeschwindigkeit | Mittel | Schnell | Für Skalierung optimiert |

| Anpassung | Hoch | Eingeschränkt | Vollständige Anpassung |

| Genauigkeit | 85-90% | 90-95% | 95%+ |

Technische Kompromisse:

- Open Source: Volle Kontrolle, erfordert jedoch technisches Fachwissen

- Kommerzielle API: Einfachere Integration, aber eingeschränkte Anpassung

- Enterprise: Maximale Qualität und Kontrolle, aber höhere Kosten

Curify's Produktions-Lip-Sync-Architektur

Das Lip-Sync-System von Curify stellt eine produktionsgerechte Implementierung dar, die modernste Forschung mit unternehmerischer Zuverlässigkeit kombiniert. Unsere Architektur verarbeitet Videoinhalte durch mehrere spezialisierte neuronale Netzwerke, die sowohl für Qualität als auch Skalierbarkeit optimiert sind.

Kerntechnologiestack:

Multi-Skalengesichtverarbeitung: Nutzung von Ensemble-Gesichtserkennung und 468-Punkte-Landmarkextraktion für präzises Verfolgen von Gesichtszügen unter verschiedenen Lichtbedingungen und Winkeln.

Fortgeschrittene Audio-Visuelle Ausrichtung: Benutzerdefinierte Phonem-zu-Visem-Zuordnung mit zeitlichen Aufmerksamkeitsmechanismen sorgt für perfekte Synchronisation zwischen Sprachlauten und Mundbewegungen.

Hybrides Generierungsmodell: Kombination von GANs für Realismus mit Diffusionsmodellen für zeitliche Konsistenz, wodurch eine visuelle Qualität von über 95 % selbst in herausfordernden Szenarien erreicht wird.

Infrastruktur: Bereitgestellt auf GPU-Clustern mit verteilter Verarbeitung, die über 50 gleichzeitige Lip-Sync-Jobs verarbeitet. Das System verarbeitet 1 Minute Video in etwa 3-5 Minuten, abhängig von der Komplexität.

Qualitätspipeline: Mehrstufige Qualitätssicherung, einschließlich automatisierter Artefakterkennung, Validierung der zeitlichen Konsistenz und menschlicher Überprüfung für Unternehmenskunden.

Die Zukunft der KI-Lip-Sync-Technologie

Die KI-Lip-Sync-Technologie hat sich von Forschungsprototypen zu produktionsbereiten Systemen entwickelt, die unternehmensgroße Workflows bewältigen können. Die Kombination von Fortschritten in GANs, Diffusionsmodellen und Algorithmen zur zeitlichen Konsistenz hat es ermöglicht, realistische synchronisierte Inhalte in großem Maßstab zu erzeugen.

Für technische Teams ist die zentrale Erkenntnis, dass Lip-Sync jetzt eine gelöste ingenieurtechnische Herausforderung und kein Forschungsproblem mehr ist. Die verbleibenden Chancen liegen in der Optimierung, der Handhabung von Randfällen und der Integration in umfassendere Workflows zur Lokalisierung von Inhalten.

Da sich diese Systeme weiterhin durch bessere Modellarchitekturen und größere Trainingsdatensätze verbessern, nähern wir uns einer Zukunft, in der perfekte Lippen-Synchronisation sofort für jeden Inhaltstyp verfügbar ist, was eine wirklich globale Videokommunikation ohne visuelle Kompromisse ermöglicht.

Take the next step

Putting what you read into practice.

Verwandte Artikel

video-translation-dubbing

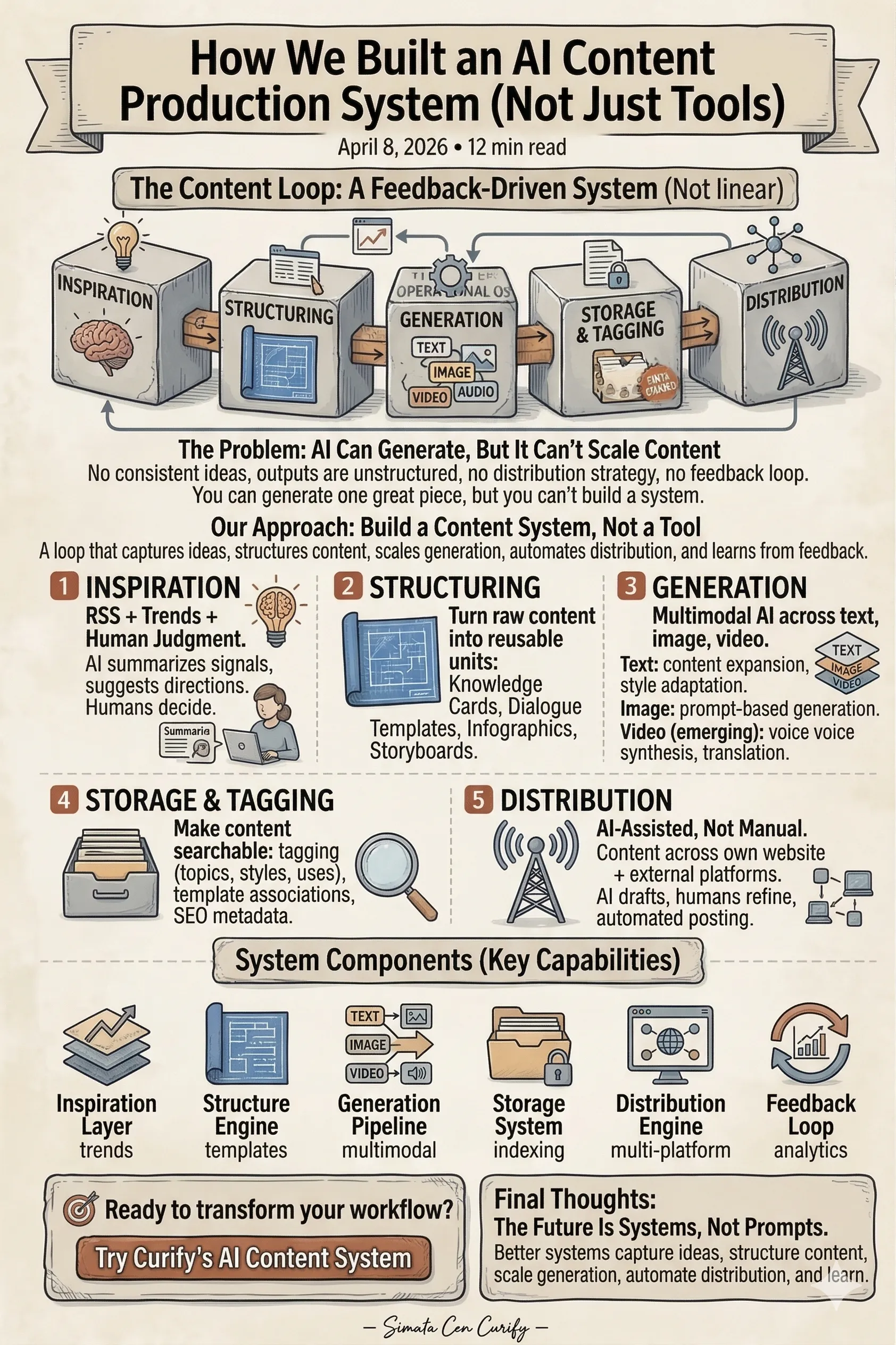

Wie wir ein KI-Inhaltsproduktionssystem aufgebaut haben (nicht nur Werkzeuge)