如何在2026年自然配音视频:修复AI语音克隆伪影

一份全面的指南,解决使用AI工具时常见的配音挑战。关注机械节奏、缺乏情感和口型同步等痛点。

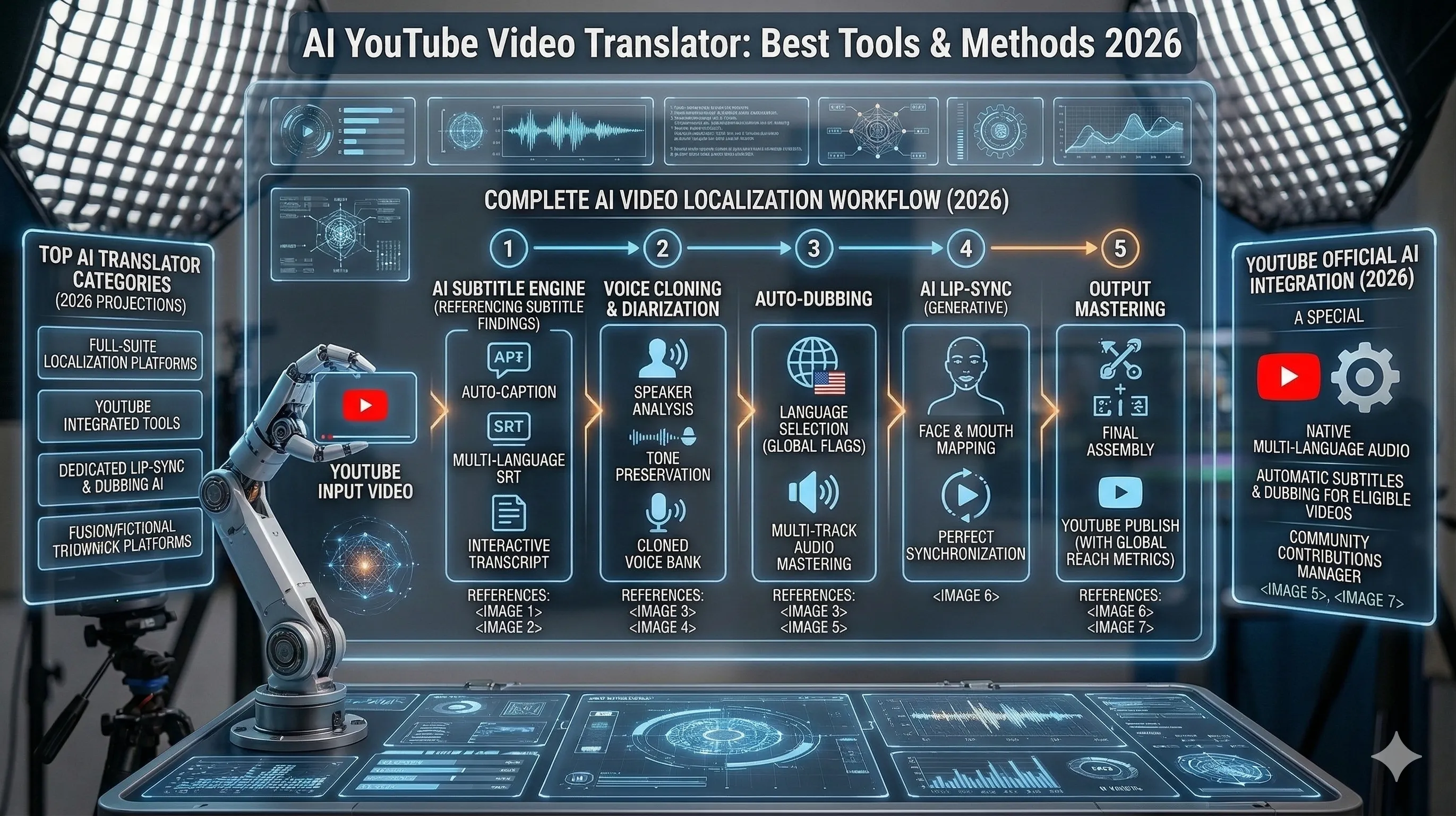

AI视频配音彻底改变了内容创作,但机械伪影和不自然的节奏仍然困扰着许多制作。在2026年,我们拥有更好的工具和技术来克服这些挑战。核心问题在于大多数配音流程将语音视为纯粹的技术层,而非表演。许多系统仍然生成音频,具有平坦的韵律、不一致的重音和时机不当的停顿,即使声音本身听起来真实,也会破坏沉浸感。观众对时机不匹配非常敏感——当情感节拍、微停顿或句子重音与视觉表演不一致时,结果会显得微妙“偏离”,即使他们无法清楚表达原因。现代方法通过关注韵律控制和时间对齐来解决这个问题。新模型不再线性生成语音,而是采用节奏感知合成,使创作者能够在短语和音节层面控制节奏。这使得匹配口型动作、保留戏剧性停顿以及在不同语言中保持原演员意图成为可能。像强制对齐、音素级时机和参考音频调节等技术现在已成为高质量流程的标准。另一个重大改进来自于上下文感知语音建模。先进系统不再孤立生成每一行,而是保持对话记忆——跟踪语调、情感状态和说话者动态。这减少了音调漂移,并确保角色在低声细语、争论或讲解时听起来一致。对于叙事内容,这一转变显著提高了感知的真实感。最后,人机协作工作流程的兴起缩小了自动化与质量之间的差距。创作者现在将AI生成与轻量级编辑层结合——微调停顿、调整重音或重新生成特定片段,而不是整个剪辑。这种混合方法在效率与创作控制之间取得了平衡,使制作团队能够在实现工作室级结果的同时扩大配音规模。所有这些进展使AI配音从便利工具转变为生产级解决方案,能够在不牺牲速度或可扩展性的情况下,提供自然、情感共鸣的表演。

本指南将向您展示如何使用尖端AI工具,如MuseTalk、Emotion TTS和先进的后处理技术,修复常见的配音问题。我们超越基本的语音生成,解决AI配音工作流程中最持久的故障点——口型同步漂移、单调的表达、时机不匹配和情感平淡。您将学习如何使用MuseTalk进行精确的视觉音频对齐,确保生成的语音与口型动作和面部表情紧密匹配,即使在快节奏或对话密集的场景中。在音频方面,我们将分解如何利用Emotion TTS系统为生成的声音注入受控的表现力。而不是依赖于通用预设,指南将逐步讲解如何调整音调轮廓、节奏和重音以反映意图——无论是紧张、讽刺还是单行中的微妙情感变化。这使您能够从“技术上正确”的音频转变为感觉人性化且具有上下文基础的表演。我们还涵盖了先进的后处理工作流程,这些工作流程对最终输出质量产生了关键影响。这包括音素级时机调整、静音修剪和延长、呼吸和停顿插入,以及音频母带处理技术,如EQ匹配和响度标准化,以将配音声音无缝融入原始音轨。通过将这些工具和技术结合成一个连贯的流程,您将能够系统地诊断和修复配音问题,而不是依赖于反复试验——将不一致的AI输出转变为精致、准备好的对话。

Pro Tip

常见AI配音问题

🤖 机械节奏

AI生成的语音通常缺乏自然的节奏和时机,听起来机械且脱离。

观众脱离

不自然的节奏破坏沉浸感,导致观众保留率下降多达40%。

😐 缺乏情感细腻

AI声音难以传达细微情感,使戏剧场景显得平淡。

情感脱节

缺失的情感线索使观众无法与角色和故事建立联系。

👄 口型同步不匹配

音频与视觉口型动作之间的对齐不良,造成了不自然的效果。

不真实的外观

可见的口型同步错误立即破坏自然语音的幻觉。

用AI转变您的视频配音

通过结合这些先进的技术和工具,您可以创建自然、情感丰富的配音内容,吸引观众。AI配音的未来已经到来,它比以往任何时候都更具人性化。