情感 TTS 电影:让您的叙事更具情感

将平淡叙事转变为情感杰作

如果您的视频叙述不仅能传达信息,还能传达真实的情感呢?我们的情感增强 TTS 工具将现有视频内容进行升级,赋予其高能量、情感丰富的语音合成。利用 Azure 认知服务的高级 SSML 标记和 ElevenLabs 转录,该工具将平淡、单调的叙述转变为引人入胜、情感共鸣的表演,吸引观众。

这个情感增强工具的功能

这个 Python 工具代表了音频后期制作的突破 - 它从现有视频中提取音频,精确转录,然后用情感智能重新合成每个片段。结果是一个新的音轨,保持完美的口型同步,同时增加戏剧性的表达、能量和传统 TTS 系统无法实现的情感细腻。

🎭 核心功能

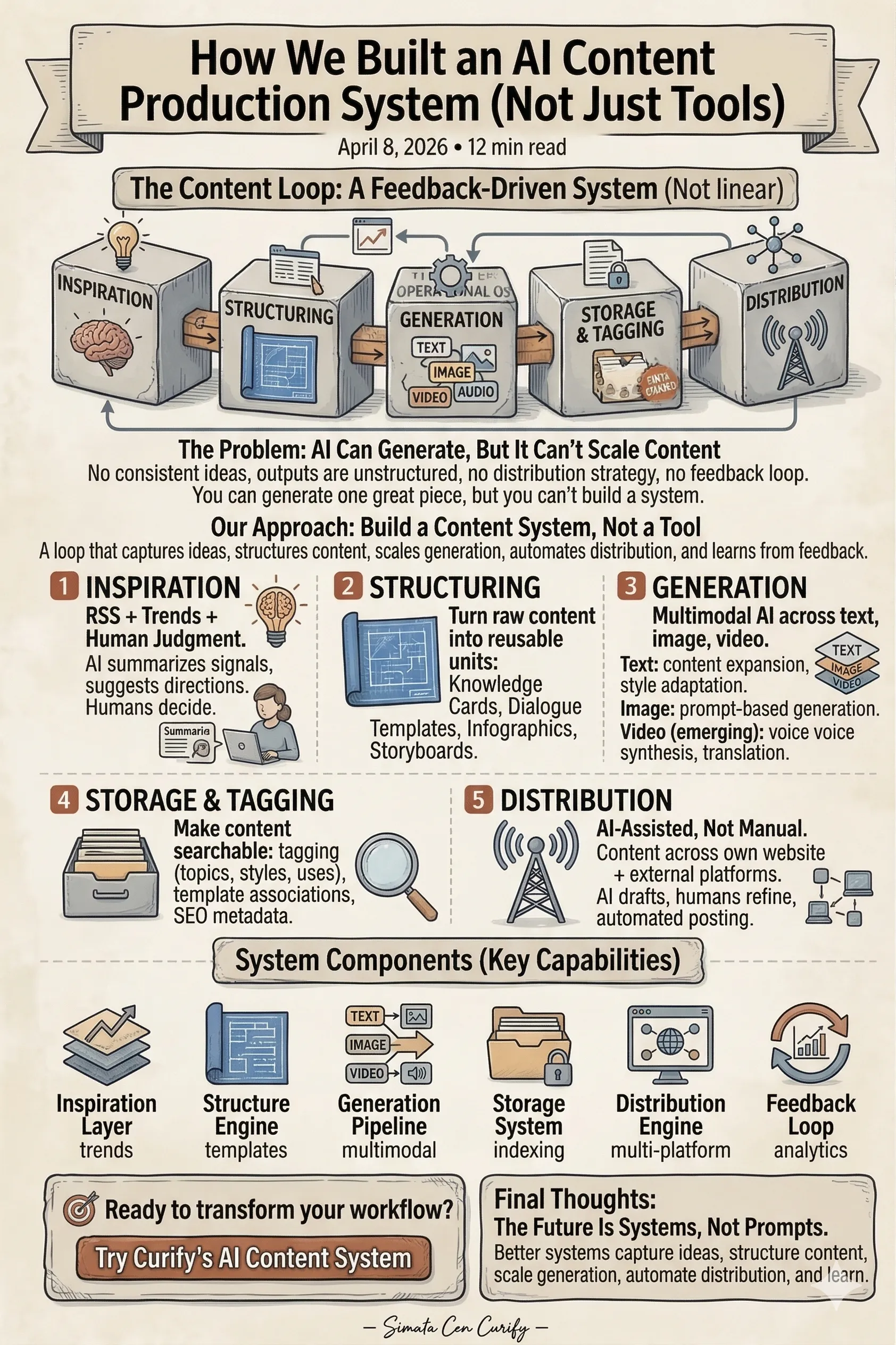

情感管道的工作原理

该工具遵循一个复杂的六步流程,将平淡的叙述转变为情感丰富的表演,同时保持完美的技术同步。

📥音频提取

使用 MoviePy 从现有的 MP4 视频中提取高质量音频,保留原始时间和质量。

音频提取过程

使用 MoviePy 提取 PCM 音频,设置适当的编解码器以实现最大兼容性。

clip = VideoFileClip(video_path) clip.audio.write_audiofile(audio_path, codec='pcm_s16le', logger=None)

📝智能转录

ElevenLabs Scribe 提供逐字时间戳和标点检测,以实现精确分段。

转录 API

直接 API 集成,提供逐字时间和自动标点检测。

resp = requests.post(ELEVENLABS_URL, headers={'xi-api-key': ELEVENLABS_KEY}, files={'file': ('audio.wav', f, 'audio/wav')}, data={'model_id': 'scribe_v1'})🎭情感 SSML 构建

将文本片段转换为带有表现性标记的 SSML,以实现高能量的表达风格。

SSML 生成

构建带有广告风格的 SSML,控制速率/音调/音量以实现情感表达。

def build_emotional_ssml(text: str) -> str:

return f'''<speak version='1.0' xmlns='http://www.w3.org/2001/10/synthesis' xmlns:mstts='https://www.w3.org/2001/mstts' xml:lang='en-US'>

<voice name='{voice}'>

<mstts:express-as style='advertisement_upbeat' styledegree='2'>

<prosody rate='+15%' pitch='+8%' volume='+15%'>

{escaped}

</prosody>

</mstts:express-as>

</voice>

</speak>'''🔊Azure TTS 合成

Azure 认知服务生成高质量的情感音频,具有自然的韵律和表达。

Azure TTS API

使用 Azure 的神经 TTS,支持 SSML 进行表现性语音合成。

headers = {'Ocp-Apim-Subscription-Key': AZURE_API_KEY, 'Content-Type': 'application/ssml+xml', 'X-Microsoft-OutputFormat': 'riff-24khz-16bit-mono-pcm'}

resp = requests.post(AZURE_TTS_URL, headers=headers, data=ssml.encode('utf-8'), timeout=30)🔗音频拼接

将单个情感片段合并为一个连续的音轨。

WAV 拼接

在拼接多个 WAV 文件为最终音轨时保留音频参数。

def concat_wavs(wav_paths: list[str], out_path: str) -> None:

params = None

frames = []

for p in wav_paths:

if not os.path.exists(p):

continue

with wave.open(p, 'rb') as wf:

if params is None:

params = wf.getparams()

frames.append(wf.readframes(wf.getnframes()))

if not frames:

logger.warning('没有可拼接的 WAV 帧。')

return

with wave.open(out_path, 'wb') as out_wf:

out_wf.setparams(params)

for f in frames:

out_wf.writeframes(f)🎬视频复用

在保持视频质量的同时,用情感音轨替换原始音频。

FFmpeg 集成

使用 FFmpeg 进行专业的视频/音频复用,并自动匹配时长。

cmd = ['ffmpeg', '-y', '-i', video_path, '-i', audio_path, '-map', '0:v:0', '-map', '1:a:0', '-c:v', 'copy', '-c:a', 'aac', '-b:a', '192k', '-shortest', out_path]

情感语音的科学

传统的 TTS 系统产生平坦、单调的语音,无法吸引观众。我们的情感增强使用尖端的 SSML 标记和 Azure 的神经 TTS 创建具有自然情感变化、动态范围和与专业配音相匹配的表现。

🎯 表达的 SSML 标记

广告活泼风格

<speak version='1.0' xmlns='http://www.w3.org/2001/10/synthesis' xmlns:mstts='https://www.w3.org/2001/mstts' xml:lang='en-US'>

<voice name='en-US-AndrewNeural'>

<mstts:express-as style='advertisement_upbeat' styledegree='2'>

<prosody rate='+15%' pitch='+8%' volume='+15%'>

您的情感文本在这里

</prosody>

</mstts:express-as>

</voice>

</speak>- •styledegree: 控制强度级别 (0-2,越高 = 越具表现力)

- •rate: 语速调整 (-100% 到 +100%)

- •pitch: 情感强调的音调修改 (-50% 到 +50%)

- •volume: 影响力的音量控制 (0% 到 +100%)

🔊 Andrew Neural - 高能量声音

- •自然表现力的音调,完美适合广告和兴奋场合

- •支持广告活泼风格以获得最大能量

- •内置的韵律控制,精细调整情感表达

- •优化用于吸引人的高影响力内容

技术架构

🧠 AI 组件

- •支持 SSML 的 Azure 认知服务 TTS

- •ElevenLabs Scribe 进行逐字转录

- •智能文本分段,带有边界检测

- •带有风格控制的情感标记生成

- •专业音频处理和连接

⚙️ 处理管道

- •MoviePy 音频提取,带有编解码器优化

- •实时转录,带有逐字时间戳

- •带有表现力韵律控制的 SSML 构建

- •Azure TTS 合成,使用神经语音模型

- •保留音频参数的 WAV 连接

- •FFmpeg 视频/音频复用,自动匹配时长

现实世界应用

🎬 电影与视频制作

将纪录片旁白从平淡的表达转变为情感丰富的表演。

- • 纪录片配音增强,带来戏剧性影响

- • 具有吸引力的情感表达的教育内容

- • 具有高能量说服力的营销视频旁白

📚 教育内容

创建具有表现力和情感共鸣的叙述的引人入胜的学习材料。

- • 具有动态情感强调的在线课程视频

- • 具有表现力讲故事的儿童教育内容

- • 具有引人入胜的情感变化的企业培训视频

🎮 游戏与互动媒体

为游戏旁白和角色声音增添情感深度。

- • 具有情感范围和表现的角色配音

- • 具有动态情感表达的互动故事旁白

- • 具有引人入胜的情感强调的游戏教程视频

🎭 数字讲故事

创建具有专业情感表演的有声书和故事。

- • 具有角色情感表达的有声书制作

- • 具有引人入胜的情感表达的播客增强

- • 具有动态情感变化的数字讲故事

核心实现示例

这是驱动情感增强的基本代码结构:

def main():

if not AZURE_API_KEY:

logger.error('AZURE_AI_API_KEY not set. Check curify_background/.env')

sys.exit(1)

# Step 1: Extract audio

if not os.path.exists(AUDIO_PATH):

if not extract_audio(VIDEO_PATH, AUDIO_PATH):

sys.exit(1)

# Step 2: Transcribe

segments = transcribe(AUDIO_PATH)

# Step 3: TTS per segment

wav_paths: list[str] = []

for i, seg in enumerate(segments):

text = seg['text'].strip()

if not text:

continue

out_path = os.path.join(OUTPUT_DIR, f'segment_{i:03d}.wav')

if os.path.exists(out_path):

logger.info('[%02d] Segment WAV already exists, skipping TTS.', i)

wav_paths.append(out_path)

continue

ssml = build_emotional_ssml(text)

logger.info('[%02d] Generating TTS: %s…', i, text[:60])

if azure_tts(ssml, out_path):

wav_paths.append(out_path)

# Step 4: Concatenate

if not wav_paths:

logger.error('No segments synthesised.')

sys.exit(1)

concat_wavs(wav_paths, FULL_WAV)

# Step 5: Mux onto original video

if not mux_audio_video(VIDEO_PATH, FULL_WAV, OUTPUT_MP4):

sys.exit(1)

logger.info('All done!')为什么情感增强有效

主要优势

- ✓与原始视频时序完美同步

- ✓自然的情感表达和变化

- ✓高质量的神经TTS合成

- ✓智能文本分段和边界检测

- ✓专业的音频处理管道

- ✓批量处理,保持一致的情感传递

开始使用

快速入门指南

⚠️ 系统要求

- •具有认知服务访问权限的Azure AI API密钥

- •用于转录服务的ElevenLabs API密钥

- •Python 3.7+,带有MoviePy和requests库

- •已安装FFmpeg并可在PATH中使用

- •用于音频提取的现有MP4视频

- •足够的存储空间用于中间音频文件

预期结果

该工具生成情感增强的视频,保持完美的技术质量,同时增加戏剧性的表现力。

🎭 情感音频输出

高能量的表现音频,具有自然的韵律和情感变化

Azure神经TTS,SSML标记,24kHz/16bit PCM WAV格式

🎬 技术规格

专业的视频输出,带有增强的音轨和完美的同步

H.264视频编码,AAC音频编码,自动持续时间匹配

情感增强的未来

我们正在通过先进的语音配置文件、实时情感检测和与视频编辑工作流程的集成来扩展情感能力,以实现无缝内容创建。