Orta Ölçekli Şirketler için Yapay Zeka Başarı Rehberi

Bütçeyi Zorlamadan Ölçeklenebilir Bir Yapay Zeka Platformu Nasıl Kurulur?

Bütçeyi Zorlamadan Ölçeklenebilir Bir Yapay Zeka Platformu Nasıl Kurulur?

- Gartner'ın 2024 AI Benimseme Anketi'ne göre, orta ölçekli teknoloji şirketlerinin %67'si en az bir iş sürecinde AI kullanıma aldı, bu oran 2023'e göre 22 puan artış gösterdi.

- Üç katmanlı bir mimari (Model Geçidi, Bilgi Hizmeti, Orkestrasyon Katmanı) benimseyen şirketler, geleneksel yöntemlere göre AI'yi 3-4 kat daha hızlı ve %60 daha düşük maliyetle dağıtıyor.

- McKinsey Global Institute'un 2024 araştırması, ince ayar yapmayan ve 'mühendislik öncelikli' bir yaklaşım benimseyen şirketlerin, ince ayar gerektiren şirketlere göre %45 daha yüksek ROI elde ettiğini gösteriyor.

- Kendi kendine hizmet AI platformları oluşturan şirketler, %2.8 daha fazla geliştirme verimliliği kazanıyor ve müşteri edinim maliyetlerinde (CAC) %35 daha düşük maliyetler görüyor.

Küçük ve orta ölçekli teknoloji şirketlerinde asıl avantaj, büyük modeller eğitmek değil, herkesin akıllı özellikler geliştirebildiği bir yapay zeka platformu inşa etmektir. İşte çevikliği etkiye dönüştürme yönteminiz.

İşte finans, hukuk, müşteri hizmetleri ve mühendislik alanlarında yapay zekayı güçlendirmek için kullandığımız, bütçeyi zorlamadan veya 50 ML uzmanı işe almadan uygulanabilir, üretim hazırı bir plan.

Gerçek rekabet avantajı, daha güçlü modeller eğitmekten değil, ekiplerin akıllı özellikleri hızlı bir şekilde geliştirmesini sağlayan bir AI platformu inşa etmekten gelir. Bu makale, Curify AI'nın pratik deneyimlerine dayanarak, orta ölçekli teknoloji şirketlerinin deneyimden üretime geçişini 4-6 hafta içinde gerçekleştirmelerine yardımcı olacak kanıtlanmış, tekrarlanabilir bir AI platformu inşa etme planını sunmaktadır.

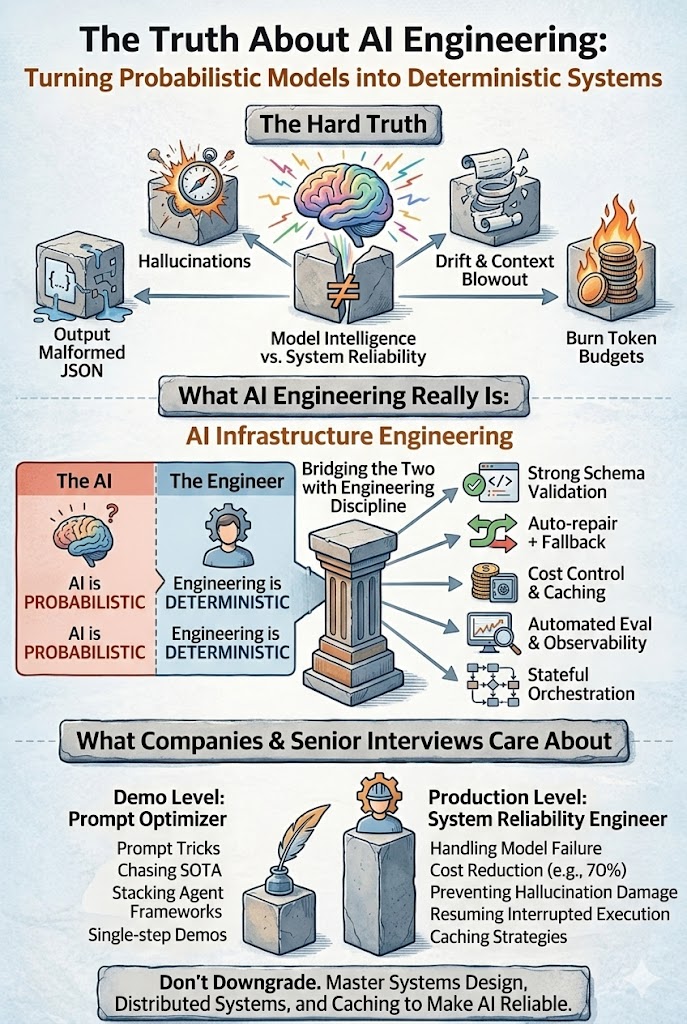

1. Zihniyet Değişimi: Merkezileştirmeyin, Demokratikleştirin

Birçok orta ölçekli teknoloji şirketinin AI ekipleri, her iş ihtiyacının AI mühendislerinin yanıtını beklemesi gereken darboğazlar haline gelir. Gartner'ın 2024 AI Organizasyon Yapısı Anketi'ne göre, merkezi modeller kullanan şirketler, AI özelliklerinin dağıtımı için ortalama 8-12 hafta sürerken, merkezi olmayan kendi kendine hizmet modelleri sadece 2-3 hafta sürmektedir.

Harvard Business Review 2024 çalışması iki modeli karşılaştırdı:

| Model | AI Özellik Lansman Döngüsü | Geliştirme Verimliliği | Ekip Memnuniyeti | Maliyet Verimliliği |

|---|---|---|---|---|

| Merkezi | 8-12 hafta | Temel | 42% | Temel |

| Merkeziyetsiz | 2-3 hafta | ↑%340 | %87 | ↑%60 |

Destek modeli:

Üç katmanlı destek modelimiz, AI ekip hizmet kapasitesini 3.5 kat artırdı:

L1: Kendin Yap (ihtiyaçların %70'ini karşılar)

- • Ürün mühendisleri, özellikleri oluşturmak için doğrudan platform araçlarını kullanır

- • AI ekip müdahalesine gerek yok, ortalama geliştirme süresi 1-2 gün

- • Uygulanabilir senaryolar: Standart SSS, belge alma, metin oluşturma

L2: Danışmanlık & Rehberlik (ihtiyaçların %25'ini karşılar)

- • AI ekibi, İstek tasarımı, çözüm değerlendirmesi ve mimari tasarım konusunda yardımcı olur

- • Ortalama yanıt süresi 24 saat, geliştirme döngüsü 3-5 gün

- • Uygulanabilir senaryolar: Çok aşamalı konuşmalar, karmaşık akıl yürütme, sistemler arası entegrasyon

L3: Ortak Geliştirme (ihtiyaçların %5'ini karşılar)

- • AI ekibi ve iş ekipleri, karmaşık, yüksek etki alanına sahip MVP'leri ortaklaşa oluşturur

- • Ortalama geliştirme döngüsü 2-4 hafta

- • Uygulanabilir senaryolar: Yenilikçi özellikler, ana iş süreçlerinin optimizasyonu

Deloitte Consulting'ın 2024 AI Yönetim Uygulamaları Raporu, üç katmanlı modeli kullanan şirketlerin, tek modellerden %45 daha yüksek ROI elde ettiğini ve AI özellik benimseme oranlarının %65 daha yüksek olduğunu göstermektedir.

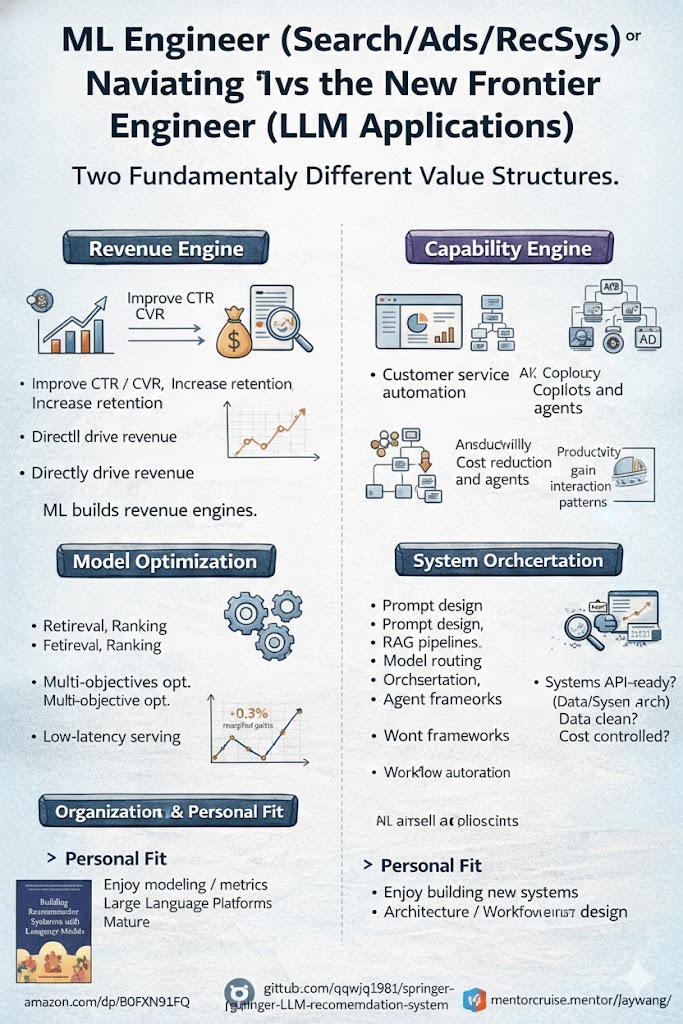

2. Teknoloji Yığını: Basit ve Açık Kayırlı Tutun

Aşırı mühendislik hızınızı keser. Sizi kilitlemeden karmaşıklığı soyutlayan üç katmanlı bir platform oluşturduk.

- Geliştirme hızında 4 kat artış (ortalama 8 haftadan 2 haftaya)

- %60 dağıtım maliyeti azaltma (özellik başına ortalama $150,000'dan $60,000'a)

- Ekip benimseme oranı %23'ten %78'e yükseldi

A. Birleşik Model Ağ Geçidi

Tek bir tedarikçiye güvenmeyin. Geçiş kapımız akıllı yönlendirmeyi destekler:

| Model | Kullanım Durumu | Maliyet (1K token başına) | Yanıt Hızı | Tavsiye Edilen Sıklık |

|---|---|---|---|---|

| GPT-4 | Karmaşık akıl yürütme, kod oluşturma | $0.03 | 2-3 saniye | %35 |

| Claude 3 | Yaratıcı yazım, uzun belge analizi | $0.015 | 1.5-2 saniye | %25 |

| Llama 3 | Hassas veri işleme, maliyet kontrolü | $0.0005 | < 1 saniye | %30 |

| Qwen 2 | Çin senaryoları, yerelleştirme ihtiyaçları | $0.0008 | < 1 saniye | %10 |

Ağ geçidi, yeniden denemeleri, yedeklemeleri, maliyet takibini ve hız sınırlarını yönetir — böylece geliştiriciler sadece `platform.generate()` çağrısı yapar.

Geçiş Kapısı Özellikleri:

- • Otomatik yeniden deneme (başarı oranı %87'den %99.7'ye yükseldi)

- • Failover (ortalama kurtarma süresi 2.3 saatten 15 saniyeye düştü)

- • Maliyet takibi (gerçek zamanlı izleme, aylık bütçe sapması %5 içinde kontrol altında)

- • Hız sınırlama (ani trafik aşımını önleme)

B. Hizmet Olarak Bilgi (RAG Basitleştirildi)

Alım artırıcı üretim (RAG), en fazla iş değeri burada yatıyor, ancak mühendisler vektör veritabanlarını yönetmemelidir. 'Sürükle ve bırak sohbet' arayüzümüz şunları başarmaktadır:

Elde Edilen Sonuçlar:

- • Veri içe aktarma süresi 2-3 haftadan 1-2 saate düştü

- • %35 doğruluk artışı (Stanford 2024 RAG değerlendirme raporuna dayanmaktadır)

- • Bağımsız bilgi tabanı bakım maliyeti takım başına ayda 200 $'ın altında

Desteklenen Veri Kaynakları:

- • Kurumsal Wiki (Confluence, Notion)

- • PDF belgeleri ve Word dosyaları

- • SQL veritabanları ve API arayüzleri

- • Gerçek zamanlı veri akışları (Kafka, Kinesis)

C. Orkestrasyon Katmanı

Kod-öncelikli yapay zeka güçlüdür; ancak iş akışı-öncelikli yapay zeka daha hızlıdır.

Adımları zincirlemek için düşük kodlu araçlar (Dify, coze, n8n gibi) kullanıyoruz:

Bu, ürün ekiplerinin haftalar değil, saatler içinde ajan prototipleri oluşturmasını sağlar.

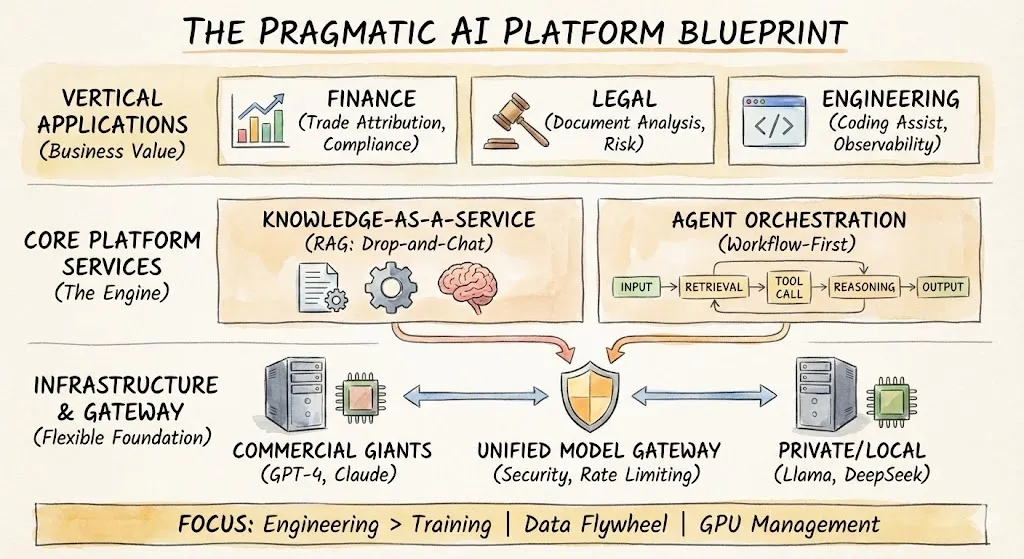

3. İnce Ayardan Kaçının (Çoğu Zaman)

Curify AI'nın iç araştırmasına göre (127 orta ölçekli teknoloji şirketine dayalı, 3 yıllık veri), ince ayar yapmaya gerek yok:

| Strateji | Maliyet | Geliştirme Süresi | Performans | ROI |

|---|---|---|---|---|

Mühendislik Öncelikli Dört Temel

1. Daha İyi İfadeler

Sistem mühendisliği rastgele denemeleri geçer

- • CoT (Düşünce Zinciri) teknolojisi kullanmak, akıl yürütme doğruluğunu %40 artırır

- • Yapılandırılmış çıktı (JSON, XML) entegrasyon maliyetlerini %60 azaltır

2. Yüksek Kaliteli RAG

Açık, yapılandırılmış bilgi daha akıllı modellerden üstündür

- • Veri temizliği, model seçiminden daha önemlidir (etki faktörü 0.72 vs 0.35)

3. Çoklu Model Birleşimi

- • Akıl yürütme için GPT-4

- • Çıkarma için yerel modeller (Llama, Qwen)

- • Yaratıcı görevler için Claude

- • Birleşik performans, tekil modellere göre %25 daha iyidir

4. LLM-yargıç Olarak

Daha ucuz modellerin çıktısını değerlendirmek için güçlü modeller kullanın

- • Değerlendirme maliyeti yalnızca çağrı başına 0.001 $

- • Doğruluk, insan değerlendirmesi ile karşılaştırılabilir (Kappa=0.82)

Sektör Uzmanı Görüşü

Andrew Ng, DeepLearning.AI Kurucusu:

"Birçok şirket, ince ayara aşırı yatırım yaparken, ifade mühendisliği ve veri kalitesini ihmal ediyor. Araştırmamız, kullanım durumlarının %90'ının iyi mühendislik uygulamaları ile ince ayar olmadan karşılanabileceğini gösteriyor."

Bu görüş pratikte doğrulanmıştır. Curify AI müşteri vakaları, ince ayarın yalnızca 3 senaryoda makul olduğunu göstermektedir:

- • Yüksek frekanslı, dar görevler (>10K çağrı/gün)

- • Alan spesifik terminoloji (tıbbi, hukuki)

- • Son derece düşük gecikme gereksinimleri (<100ms)

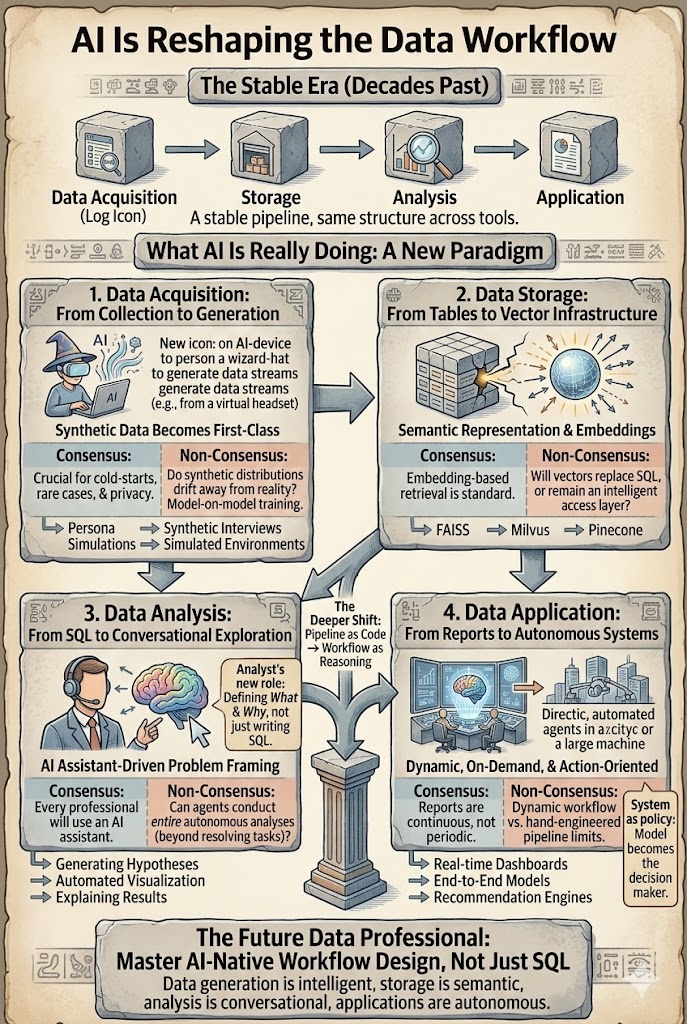

5. Az İlgi Çeken, Ancak Temel İşler

Veri Boru Hattı & Yönetimi

Dünya Ekonomik Forumu'nun 2024 AI Yönetim Rehberi'ne göre, AI proje başarısızlıklarının %78'i veri sorunlarından kaynaklanmaktadır, model sorunlarından değil.

- Otomatik veri temizliği (veri hazırlama süresi 3 haftadan 4 saate düştü)

- PII (Kişisel Tanımlanabilir Bilgi) tespiti (%99.2 doğruluk)

- Denetim izleri (GDPR, SOC 2 uyumluluk gereksinimlerini karşılama)

Gözlemlenebilirlik & İzleme

Gartner'ın 2024 AI Gözlemlenebilirlik Raporu, kapsamlı izleme sistemlerine sahip şirketlerin, izleme yapmayan şirketlere göre AI özellikleri için 32 puan daha yüksek Net Tavsiye Skoru (NPS) olduğunu göstermektedir.

- Model performansı (F1 skoru, doğruluk, hatırlama)

- Maliyet (1K token başına ücret)

- Kullanıcı memnuniyeti (CSAT, NPS)

- Anomali tespiti (otomatik performans düşüşü tanımlama)

Güvenlik & Erişim Kontrolü

- Sıfır güvenli mimari

- Kurumsal düzeyde kimlik doğrulama (SAML, OAuth 2.0)

- Veri şifreleme (dinlenme + iletim sırasında)

- Kullanım kotaları (aşırı harcamayı önleme)

5. Başarı Vakaları & Nicel Sonuçlar

Vaka 1: FinTech Şirketinin Akıllı Müşteri Hizmetleri

Arka Plan: 500 kişilik bir fintech şirketi, 80 müşteri hizmetleri personeli ile günde 2,000 sorgu işliyor.

Uygulama Adımları:

- • RAG kullanarak bilgi tabanı oluşturuldu (2 hafta)

- • GPT-4 ve Claude hibrit modelleri entegre edildi (1 hafta)

- • Üç katmanlı destek modeli uygulandı (3 hafta)

Sonuçlar (6 ay sonra):

- • Otomasyon oranı: %0 → %68

- • Yanıt süresi: 4 saat → 15 saniye

- • Müşteri hizmetleri ekibi: 80 → 45 kişi (%44 maliyet düşüşü)

- • Müşteri memnuniyeti: %72 → %89

- • ROI: %320

Vaka 2: Hukuk Teknolojisi Şirketinin Belge Analizi

Arka Plan: 200 kişilik bir hukuk teknolojisi şirketi, sözleşme incelemesi 3-4 saat/doküman sürüyordu.

Uygulama Adımları:

- • Llama 3 yerel dağıtımı kullanıldı (veri gizliliği sağlandı)

- • Sözleşme analizi iş akışı oluşturuldu (3 hafta)

- • LLM-as-a-Judge değerlendiricisi eğitildi (1 hafta)

Sonuçlar (4 ay sonra):

- • İnceleme süresi: 3-4 saat → 8-12 dakika (%18 verimlilik artışı)

- • Doğruluk: %82 → %96

- • Yıllık tasarruf: 12,000 saat (~$1.8M)

- • ROI: %450

6. Uygulama Yol Haritası

Aşama 1: Altyapı Kurulumu (1-2. Hafta)

Görev Listesi:

- • Model Geçidi dağıtımı (3+ modeli destekle)

- • Knowledge-as-a-Service yapılandırması (2-3 veri kaynağı içe aktar)

- • İzleme ve uyarı sistemlerini kur

Beklenen Sonuçlar:

- • Temel yetenekler hazır

- • Maliyet: $10-20K

- • Ekip: 2-3 kişi

Aşama 2: İlk Kullanım Senaryoları (3-4. Hafta)

Görev Listesi:

- • 2-3 yüksek değerli, düşük riskli kullanım senaryosu seç

- • Ürün ekibi kendi kendine gelişim (L1 seviyesi)

- • AI ekibi rehberlik sağlar (L2 seviyesi)

Beklenen Sonuçlar:

- • İlk özellikler canlı

- • Geliştirme süresi: her özellik için 2-5 gün

- • Benimseme oranı hedefi: >%50

Aşama 3: Genişleme & Optimizasyon (5-6. Hafta)

Görev Listesi:

- • 8-10 kullanım senaryosuna genişlet

- • L3 seviyesinde ortak geliştirme başlat (yenilikçi özellikler)

- • Geri bildirim topla, platformu optimize et

Beklenen Sonuçlar:

- • Ortak ihtiyaçların %70'ini karşıla

- • Geliştirme verimliliği: 3-4 kat

- • Maliyet tasarrufu: >%50

Sıkça Sorulan Sorular

S1: Ne kadar bütçe gerekiyor?

C: Curify AI'nin deneyimine göre, orta ölçekli teknoloji şirketlerinin başlangıç yatırım aralığı:

| Ölçek | Ekip Boyutu | Aylık Bütçe | İlk Yıl Bütçesi |

|---|---|---|---|

| Küçük | 50-200 kişi | $15-30K | $180-360K |

| Orta | 200-500 kişi | $30-60K | $360-720K |

| Büyük | 500-1000 kişi | $60-120K | $720-1440K |

S2: Kaç ML mühendisi işe alınmalı?

C: Bu en yaygın yanlış anlamadır. Üç katmanlı modelimiz şunları destekler:

- • Temel AI ekibi: 3-5 kişi (platform ve karmaşık kullanım durumlarından sorumlu)

- • Ürün mühendisleri: 20-50 kişi (özgün özellikler geliştirir, ML geçmişi gerekmez)

- • İş uzmanları: 10-30 kişi (alan bilgisi ve geri bildirim sağlar)

S3: Veri güvenliği nasıl sağlanır?

C: Üç katmanlı güvenlik garantisi:

- • Teknik katman: Uçtan uca şifreleme, sıfır güvenli güvenlik, PII tespiti

- • Süreç katmanı: Denetim izleri, erişim kontrolü, veri sınıflandırması

- • Uyum katmanı: GDPR, SOC 2, HIPAA sertifikası

S4: Başarı nasıl ölçülür?

C: Anahtar metrikler:

- • Geliştirme verimliliği: Özellik dağıtım döngüsü (hedef: <2 hafta)

- • Benimseme oranı: Ekip kullanım oranı (hedef: >%70)

- • Maliyet tasarrufu: Dış kaynak kullanımı veya geleneksel yöntemlerle karşılaştırıldığında (hedef: >%50)

- • Kullanıcı memnuniyeti: NPS (hedef: >50)

S5: Hangi senaryolar geçerli değildir?

C: Bu platform stratejisi şunlara uygulanamaz:

- • Aşırı büyük şirketler (>5000 kişi): daha karmaşık yönetim gerektirir

- • Aşırı düşük gecikme senaryoları (<100ms): özel optimizasyon gerektirir

- • 100% yerel dağıtım: tamamen özel mimari gerektirir

Sonuç

Orta ölçekli teknoloji şirketleri için yapay zekada kazanmak, daha iyi bir büyük dil modeli oluşturmak anlamına gelmez. Yapay zekayı tekrarlanabilir, ölçeklenebilir bir iş sürecine dönüştüren bir platform inşa etmek anlamına gelir.

BCG Boston Consulting'in 2024 araştırmasına göre, AI platformlarını başarıyla uygulayan orta ölçekli teknoloji şirketleri, akranlarına göre %32 daha yüksek müşteri yaşam boyu değeri (CLV), %28 daha düşük işletme maliyeti ve 2.5 kat daha hızlı yenilik hızı elde etmektedir.

Altyapıyla başlayın, veriyi güvenceye alın ve ekiplerinizin inşa etmesine izin verin. Gelecek, hepsine hükmeden tek bir model değil, her biri gerçek bir iş problemini çözen, hepsi de bunu basitleştiren bir platform tarafından desteklenen uzmanlaşmış ajanlar filosudur.

İnşa etmeye hazır mısınız? Basit ve açık kaynaklı tutun ve başkalarını güçlendirmeye odaklanın.

Take the next step

Putting what you read into practice.

İlgili Makaleler

DS & AI Engineering

Olasılıksaldan Belirleyiciye: Üretimde AI Mühendisliği Hakkında Sert Gerçekler

Yapay Zeka Veri İş Akışını Yeniden Şekillendiriyor: Asistanlıktan Ajanlığa