ИИ синхронизация губ в производстве: как на самом деле работают MuseTalk и Sync.co

Углубитесь в техническую архитектуру, которая поддерживает современные системы синхронизации губ на основе ИИ. Этот комплексный анализ рассматривает открытое решение MuseTalk, коммерческий API Sync.co и проектирование конвейера производственного уровня для дубляжа видео и анимации лица на уровне предприятия.

Архитектура Конвейера Синхронизации Губ от Начала до Конца

Конвейер синхронизации губ на уровне производства преобразует видео и аудио входы в идеально синхронизированный дублированный контент через несколько сложных этапов обработки. Полный рабочий процесс: Входное Видео → Обнаружение Лица → Извлечение Ориентиров → Анализ Аудио → Генерация Движений Губ → Реконструкция Лица → Постобработка → Выходное Видео.

Каждый этап решает конкретные технические задачи: обнаружение лица изолирует говорящих, извлечение ориентиров отслеживает лицевые особенности, анализ аудио обрабатывает речевые шаблоны, генерация движений губ создает синхронизированные анимации, реконструкция лица объединяет новые губы с существующими выражениями, а постобработка обеспечивает бесшовную интеграцию.

Современные системы, такие как MuseTalk и коммерческие API, достигают более 90% реализма благодаря комбинациям GAN (генеративные состязательные сети), диффузионных моделей и алгоритмов временной согласованности. Этот технический анализ исследует каждый компонент, их стратегии интеграции и компромиссы между открытыми и коммерческими решениями.

Почему Техническая Архитектура Важна для Синхронизации Губ

Реализм против Вычислительных Затрат: Модели более высокого разрешения производят более реалистичные результаты, но требуют значительных ресурсов GPU и времени обработки. Производственные системы должны балансировать качество с операционными затратами.

Временная Согласованность: Поддержание плавных переходов между кадрами и предотвращение мерцания или артефактов требует сложного временного моделирования и согласованных ограничений по всей последовательности видео.

Сохранение Идентичности: Система должна сохранять идентичность оригинального говорящего, изменяя только движения губ. Это требует тщательного разделения идентификационных признаков от лицевых движений, связанных с речью.

Проблемы Масштабируемости: Приложения в реальном времени требуют потоковой обработки и низкой задержки вывода, в то время как пакетная обработка может оптимизировать производительность и экономическую эффективность в производственных условиях.

Основные Технические Компоненты

Обнаружение Лица и Извлечение Ориентиров

Конвейер начинается с сложной технологии обнаружения лиц, которая может находить говорящих в любом кадре видео. Как только лица идентифицированы, система извлекает точные лицевые ориентиры - отображая 468 ключевых точек вокруг губ, глаз и других лицевых особенностей.

Это детальное отображение позволяет системе понимать точную форму и положение губ говорящего в любой момент времени, создавая основу для точной синхронизации губ. Технология работает надежно в различных условиях освещения, под разными углами и даже с несколькими людьми в кадре.

Обработка Аудио и Извлечение Особенностей

Конвейер обработки аудио преобразует целевую речь в временные особенности, управляющие генерацией синхронизации губ. Системы извлекают мел-спектрограммы (80 мел-бинов, 1024 FFT, 160 хоп), MFCC и выравнивания фонем через Wav2Vec2 встраивания (facebook/wav2vec2-base) и предварительную обработку librosa на 16kHz SR. Реализация загружает волновую форму через librosa.load(), вычисляет librosa.feature.melspectrogram(), преобразованную в дБ, обрабатывает через Wav2Vec2Processor/Wav2Vec2Model для контекстных встраиваний (last_hidden_state) и применяет принудительное выравнивание (get_phoneme_alignment(audio_path, transcript)) для точного временного выравнивания. Возвращаемый словарь содержит mel_spectrogram, audio_embeddings и phoneme_alignment — захватывая спектральные оболочки, временные границы фонем и семантические речевые шаблоны, которые напрямую соответствуют артикуляционным кинематикам губ.

Генерация Движений Губ с Помощью Нейронных Сетей

Основная генерация синхронизации губ использует сложные нейронные архитектуры для сопоставления аудио особенностей с соответствующими движениями губ. Современные системы используют комбинации временных сверточных сетей, трансформеров и GAN для генерации реалистичных форм губ, которые соответствуют целевому аудио, сохраняя идентичность говорящего.

Техническая Реализация:

Генерация движений губ с использованием временного GAN

import torch

import torch.nn as nn

class LipSyncGenerator(nn.Module):

def __init__(self, audio_dim=80, landmark_dim=51, hidden_dim=512):

super().__init__()

# Кодировщик аудио

self.audio_encoder = nn.Sequential(

nn.Conv1d(audio_dim, hidden_dim, kernel_size=3, padding=1),

nn.ReLU(),

nn.Conv1d(hidden_dim, hidden_dim, kernel_size=3, padding=1),

nn.ReLU(),

)

# Временной трансформер для моделирования последовательности

self.temporal_transformer = nn.TransformerEncoder(

nn.TransformerEncoderLayer(

d_model=hidden_dim,

nhead=8,

dim_feedforward=hidden_dim * 4

),

num_layers=6

)

# Декодер ориентиров

self.landmark_decoder = nn.Sequential(

nn.Linear(hidden_dim, hidden_dim),

nn.ReLU(),

nn.Linear(hidden_dim, landmark_dim),

nn.Tanh() # Нормализация координат ориентиров

)

# Слой сохранения идентичности

self.identity_encoder = nn.Sequential(

nn.Linear(landmark_dim * 2, hidden_dim), # Текущие + эталонные ориентиры

nn.ReLU(),

nn.Linear(hidden_dim, hidden_dim)

)

def forward(self, audio_features, reference_landmarks):

# Кодирование аудио особенностей

audio_encoded = self.audio_encoder(audio_features)

audio_encoded = audio_encoded.transpose(1, 2) # (B, T, D)

# Применение временного моделирования

temporal_features = self.temporal_transformer(audio_encoded)

# Генерация движений ориентиров

generated_landmarks = self.landmark_decoder(temporal_features)

# Сохранение идентичности говорящего

identity_features = self.identity_encoder(

torch.cat([generated_landmarks, reference_landmarks], dim=-1)

)

# Смешивание сгенерированных движений с сохранением идентичности

final_landmarks = generated_landmarks + 0.1 * identity_features

return final_landmarks

Инициализация и обучение генератора

generator = LipSyncGenerator()

optimizer = torch.optim.Adam(generator.parameters(), lr=1e-4)

Цикл обучения с использованием противоречивой потери

def train_lip_sync_model(generator, discriminator, dataloader, epochs=100):

for epoch in range(epochs):

for batch in dataloader:

audio_features, reference_landmarks, target_landmarks = batch

# Генерация фальшивых ориентиров

fake_landmarks = generator(audio_features, reference_landmarks)

# Противоречивое обучение

real_loss = discriminator(target_landmarks)

fake_loss = discriminator(fake_landmarks)

# Потеря генератора (противоречивая + восстановление)

g_loss = -fake_loss.mean() + nn.MSELoss()(fake_landmarks, target_landmarks)

# Обратное распространение

optimizer.zero_grad()

g_loss.backward()

optimizer.step()

Генератор учится сопоставлять аудио особенности с соответствующими движениями губ, в то время как дискриминатор обеспечивает реализм. Компонент сохранения идентичности сохраняет уникальные лицевые характеристики говорящего.

Реконструкция Лица и Смешивание

Реконструкция лица объединяет сгенерированные движения губ с оригинальными лицевыми особенностями, создавая бесшовный финальный результат. Этот этап использует рендеринг на основе изображений, смешивание по Пуассону и временное сглаживание для интеграции новых областей губ с существующими выражениями, сохраняя естественный вид.

Постобработка и контроль качества

На финальном этапе применяется временное сглаживание, цветокоррекция и удаление артефактов для обеспечения профессионального качества вывода. Продвинутые системы используют оптический поток для проверки согласованности и автоматизированные метрики качества для выявления потенциальных проблем до человеческой проверки.

Сравнение технической архитектуры

| Компонент | MuseTalk (с открытым исходным кодом) | Sync.co (коммерческий) | Корпоративный конвейер |

|---|---|---|---|

| Обнаружение лиц | MediaPipe | Пользовательская CNN | Многоуровневое обнаружение |

| Обработка аудио | Librosa + Wav2Vec2 | Собственная ASR | Пользовательские аудиомодели |

| Генерация губ | Временной GAN | Модели диффузии | Гибридный GAN + диффузия |

| Контроль качества | Базовые метрики | Автоматизированный QA | Человеческая + AI проверка |

| Скорость обработки | Средняя | Быстрая | Оптимизирована для масштаба |

| Настройка | Высокая | Ограниченная | Полная настройка |

| Точность | 85-90% | 90-95% | 95%+ |

Технические компромиссы:

- Открытый исходный код: Полный контроль, но требует технической экспертизы

- Коммерческий API: Проще интеграция, но ограниченная настройка

- Корпоративный: Максимальное качество и контроль, но более высокие затраты

Архитектура синхронизации губ Curify

Система синхронизации губ Curify представляет собой реализацию производственного уровня, объединяющую передовые исследования с надежностью для предприятий. Наша архитектура обрабатывает видеоконтент через несколько специализированных нейронных сетей, оптимизированных как для качества, так и для масштабируемости.

Основной технический стек:

Обработка лиц в многоуровневом масштабе: Использование ансамблевого обнаружения лиц и извлечения 468-точечных маркеров для точного отслеживания черт лица при различных условиях освещения и углах.

Продвинутая аудиовизуальная синхронизация: Пользовательская карта фонем к виземам с механизмами временного внимания обеспечивает идеальную синхронизацию между звуками речи и движениями рта.

Гибридная модель генерации: Сочетание GAN для реалистичности с моделями диффузии для временной согласованности, достигая визуального качества 95%+ даже в сложных сценариях.

Инфраструктура: Развернута на кластерах GPU с распределенной обработкой, обрабатывающей более 50 одновременных задач синхронизации губ. Система обрабатывает 1 минуту видео примерно за 3-5 минут в зависимости от сложности.

Конвейер качества: Многоступенчатое обеспечение качества, включая автоматизированное обнаружение артефактов, проверку временной согласованности и человеческую проверку для корпоративных клиентов.

Будущее технологии синхронизации губ на основе ИИ

Технология синхронизации губ на основе ИИ эволюционировала от исследовательских прототипов к системам, готовым к производству, которые могут обрабатывать рабочие процессы на уровне предприятий. Сочетание достижений в GAN, моделях диффузии и алгоритмах временной согласованности сделало возможным создание реалистичного дублированного контента в больших масштабах.

Для технических команд ключевое понимание заключается в том, что синхронизация губ теперь является решенной инженерной задачей, а не исследовательской проблемой. Оставшиеся возможности заключаются в оптимизации, обработке крайних случаев и интеграции с более широкими рабочими процессами локализации контента.

Поскольку эти системы продолжают улучшаться благодаря лучшим архитектурам моделей и большим наборам данных для обучения, мы приближаемся к будущему, где идеальная синхронизация губ доступна мгновенно для любого типа контента, позволяя действительно глобальной видеокоммуникации без визуальных компромиссов.

Take the next step

Putting what you read into practice.

Связанные статьи

video-translation-dubbing

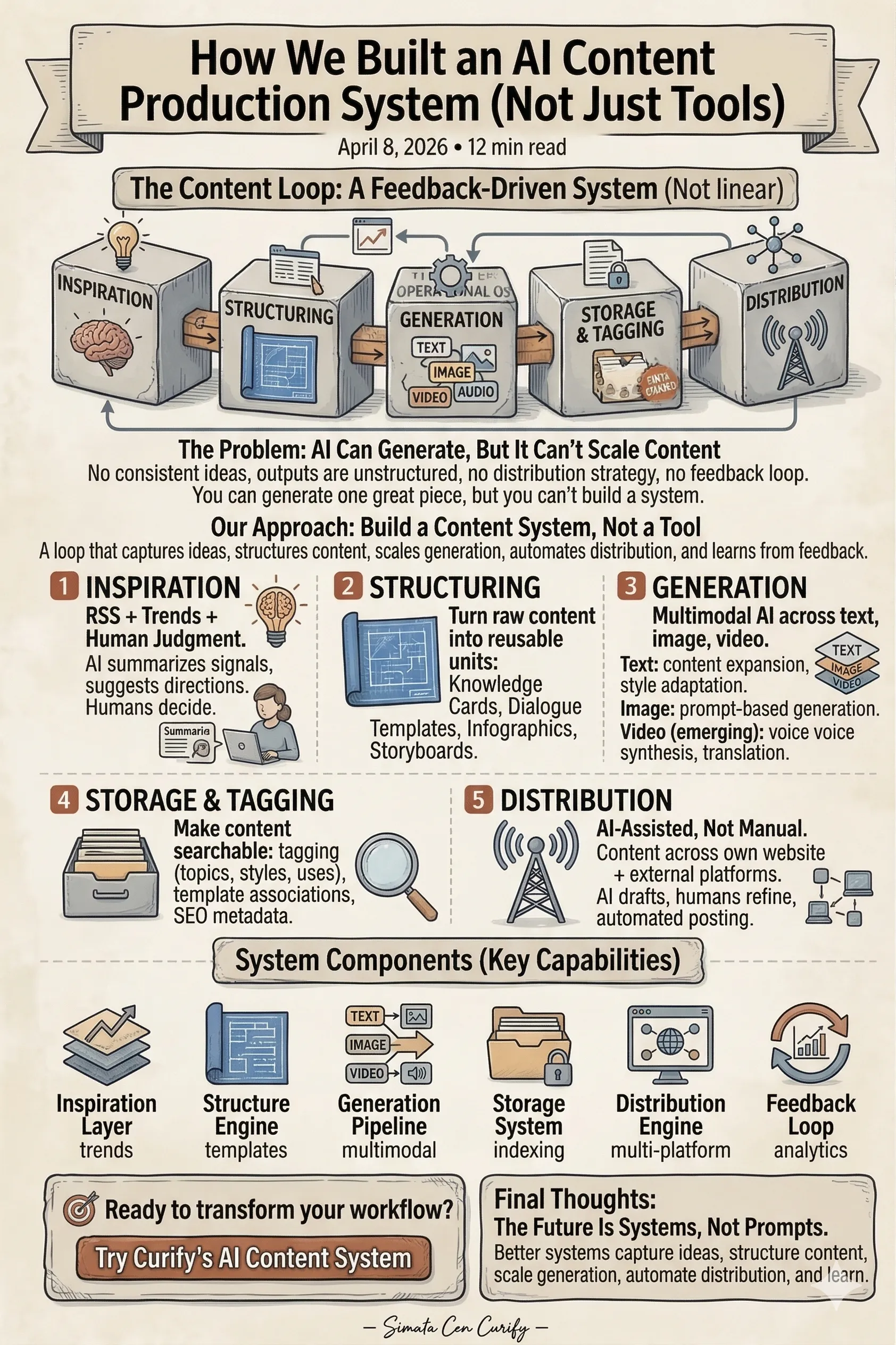

Как мы создали систему производства контента на основе ИИ (не просто инструменты)