Глубокое погружение: Технический обзор транскрипции

Большинство инструментов транскрипции останавливаются на преобразовании речи в текст. Этот глубокий анализ проходит через полный процесс транскрипции Curify: как аудио отделяется от фоновой музыки, как WhisperX работает с очищенной дорожкой, как диаризация спикеров разделяет перекрывающиеся голоса и как принудительное выравнивание возвращает временные метки на уровне слов в транскрипцию, чтобы выходные данные могли управлять инструментами субтитров, дубляжа и перевода на [/tools/video-transcript-generator](/tools/video-transcript-generator). Если вы хотите интегрировать транскрипцию в более крупный процесс, а не просто скачать SRT, это тот уровень, который большинство блогов пропускает.

Конвейер транскрипции видео от начала до конца

Конвейер транскрипции видео производственного уровня преобразует сырое видео в структурированный, синхронизированный по времени текст через несколько сложных этапов обработки. Полный рабочий процесс: Видео → Извлечение аудио → Сегментация → ASR (Автоматическое распознавание речи) → Выравнивание → Диаризация говорящих → Постобработка.

Каждый этап решает конкретные технические задачи: извлечение аудио изолирует речевой трек, сегментация разбивает длинное аудио на управляемые части, ASR преобразует речь в текст, выравнивание предоставляет временные метки на уровне слов, диаризация определяет, кто говорил когда, а постобработка очищает и форматирует финальный вывод.

Современные системы, такие как конвейер Curify, достигают точности более 95% даже в сложных условиях, сочетая Conv-TasNet для разделения аудио, WhisperX для распознавания речи и продвинутые алгоритмы кластеризации для идентификации говорящих. Этот технический глубокий анализ исследует каждый компонент и их стратегии интеграции.

Почему техническая архитектура важна для транскрипции

Торговля точностью и скоростью: Более крупные модели обеспечивают лучшую точность, но увеличивают время обработки и вычислительные затраты. Производственные системы должны балансировать эти факторы в зависимости от требований к использованию.

Проблемы масштабируемости: Транскрипция в реальном времени требует потоковой обработки и низкой задержки, в то время как пакетная обработка может оптимизировать пропускную способность и эффективность затрат.

Многоязычная сложность: Код-смешивание (смешивание языков в пределах предложений) и контент на разных языках требуют специализированных моделей, которые могут поддерживать контекст через языковые границы.

Надежность производства: Корпоративные системы нуждаются в механизмах резервирования, мониторинга качества и автоматического восстановления ошибок, чтобы справляться с крайними случаями, которые неизбежно возникают с реальным контентом.

Основные компоненты конвейера

Предварительная обработка аудио и сегментация

Конвейер начинается с сложной предварительной обработки аудио с использованием Conv-TasNet для разделения источников и сегментации аудио. Этот этап изолирует человеческую речь от фоновой музыки, окружающего шума и других аудиоисточников с помощью разделения аудио в временной области.

Техническая реализация:

# Разделение аудио с использованием Conv-TasNet

import torch

import torchaudio

from conv_tasnet import ConvTasNet

# Инициализация модели разделения источников

separator = ConvTasNet(

n_bases=512, # Количество базовых функций

kernel_size=16, # Размер свертки

stride=8, # Шаг для временных сверток

n_layers=8, # Количество сверточных слоев

n_src=2 # Количество источников для разделения

)

# Обработка аудиоволны на 16 кГц

audio_tensor, sample_rate = torchaudio.load('input_video.wav')

if sample_rate != 16000:

resampler = torchaudio.transforms.Resample(sample_rate, 16000)

audio_tensor = resampler(audio_tensor)

# Разделение источников

with torch.no_grad():

separated_sources = separator(audio_tensor)

speech_source = separated_sources[0] # Извлечение основной речи

Архитектура Conv-TasNet использует структуры свертки с кодированием-декодированием с временными сверточными сетями для разделения аудиоисточников непосредственно из сырых форм, избегая потерь информации, связанных с подходами на основе спектрограммы.

ASR (Речь в текст) с WhisperX

Чистая речь подается в WhisperX, улучшенную версию модели Whisper от OpenAI, оптимизированную для точности и скорости транскрипции. Система обрабатывает нескольких говорящих, диалекты и акценты с помощью диаризации говорящих — автоматически сегментируя аудио по идентичности говорящего.

Техническая реализация:

# Продвинутое распознавание речи с использованием WhisperX

import whisperx

import torch

from whisperx.utils import get_writer

# Загрузка модели WhisperX для транскрипции

model = whisperx.load_model("large-v3", device="cuda")

# Выполнение транскрипции с временными метками на уровне слов и диаризацией говорящих

result = model.transcribe(

speech_source,

batch_size=32, # Обработка партиями для эффективности

language="auto", # Автоопределение языка

task="transcribe",

word_timestamps=True, # Включение временных меток на уровне слов

print_progress=True

)

# Выравнивание вывода whisper с использованием принудительного выравнивания

model_a, metadata = whisperx.load_align_model(

language_code=result["language"],

device="cuda"

)

result = whisperx.align(

result["segments"],

model_a,

metadata,

speech_source,

device="cuda"

)

# Присвоение меток говорящим

diarize_model = whisperx.DiarizationPipeline(

use_auth_token=False,

device="cuda"

)

diarize_segments = diarize_model(speech_source)

result = whisperx.assign_word_speakers(diarize_segments, result)

WhisperX улучшает базовую модель Whisper за счет оптимизированного вывода, лучшей диаризации говорящих и улучшенной точности временных меток на уровне слов. Этап принудительного выравнивания обеспечивает точную синхронизацию между аудио и транскриптом.

Принудительное выравнивание и временные метки на уровне слов

Принудительное выравнивание предоставляет точные временные метки на уровне слов, которые необходимы для высококачественных субтитров, синхронизации видео и последующей обработки языка. На этом этапе специализированная акустическая модель принимает аудиосигнал и начальный транскрипт от системы ASR и выравнивает их с гораздо большей точностью, чем сырой вывод ASR. Вместо того чтобы знать только, когда начинается и заканчивается каждое предложение или сегмент, система оценивает точное начало и конец каждого слова, иногда даже на уровне фонем. Этот процесс выравнивания обычно использует вероятностные модели последовательностей, такие как скрытые марковские модели или нейронные акустические кодеры, чтобы вычислить наиболее вероятное время каждого слова, учитывая акустические данные и транскрипт. Результат — это богатая структура, где каждое слово аннотировано с временем начала, временем окончания и оценками уверенности, а сегменты дополнены детализированной временной метаданной. Эти точные временные метки позволяют точно отображать субтитры, позволяют редакторам переходить непосредственно к конкретным частям речи на временной шкале видео и создают надежную временную основу для последующих задач, таких как машинный перевод, дубляж, анализ синхронизации губ или поиск контента по большим медиа-библиотекам.

Реализация диаризации говорящих

Диаризация говорящих отвечает на вопрос "кто говорил когда" на протяжении аудио или видео файла, превращая сырой транскрипт в структурированный, осведомленный о говорящих разговор. Система сначала делит аудио на однородные сегменты, которые, вероятно, содержат одного доминирующего говорящего, а затем преобразует каждый сегмент в компактное числовое представление, называемое встраиванием говорящего, которое захватывает такие характеристики, как тембр, паттерны интонации и стиль речи. Используя эти встраивания, алгоритмы кластеризации группируют сегменты, которые звучат похоже, в последовательные идентичности говорящих, не требуя предварительных знаний о том, сколько говорящих присутствует или кто они. Продвинутые конвейеры диаризации могут адаптивно оценивать количество говорящих, уточнять границы, где говорящие перекрываются, и сглаживать метки, чтобы один и тот же человек получал один и тот же идентификатор говорящего на протяжении длинных записей. В результате диаризованный транскрипт связывает каждый сегмент, а часто и каждое слово, с устойчивой меткой говорящего, что позволяет применять такие приложения, как протоколы встреч с резюме по каждому говорящему, аналитика колл-центров, персонализированные рекомендации контента и более четкие субтитры, которые указывают, какой персонаж или участник говорит в каждый момент.

Постобработка и контроль качества

Этап постобработки и контроля качества преобразует сырые выходные данные модели в отполированный, готовый к производству транскрипт, который подходит для конечных пользователей и последующих систем. Постобработка обычно начинается с нормализации, такой как исправление регистра, расширение или стандартизация чисел, обработка аббревиатур и восстановление пунктуации, чтобы текст читался как естественный текст, а не как плоская последовательность токенов. Затем временные метки форматируются в стандартизированные временные коды субтитров, а транскрипт сегментируется на читаемые единицы субтитров или абзацы в зависимости от длины, продолжительности и языковых границ. Контроль качества добавляет уровень проверки к этому очищенному транскрипту: он агрегирует оценки уверенности на уровне слов в метрики на уровне сегментов, обнаруживает необычно низкие сегменты уверенности, резкие временные разрывы или подозрительные повторы и помечает их для проверки человеком или автоматической переработки. Дополнительные проверки могут обеспечить соблюдение стилей, удалить дисфлюенции или слова-заполнители, когда это уместно, и гарантировать, что метки говорящих остаются последовательными на протяжении всего файла. Вместе эти этапы постобработки и контроля качества обеспечивают, чтобы финальный вывод не только отражал то, что было сказано, но и соответствовал стандартам точности, читаемости и форматирования, необходимым для профессиональной транскрипции, локализации и рабочих процессов доступности.

Технические проблемы и решения

Перекрывающаяся речь: Одновременное говорение нескольких говорящих создает проблемы для ASR. Решения включают разделение аудиоисточников, модели для нескольких говорящих и сложные алгоритмы диаризации.

Многоязычное переключение: Код-смешивание между языками требует моделей, которые могут одновременно обрабатывать несколько языков. Продвинутые системы используют идентификацию языка и специализированные многоязычные модели.

Шумные условия: Фоновая музыка, окружающий шум и плохое качество аудио снижают точность транскрипции. Техники предварительной обработки аудио и разделения источников смягчают эти проблемы.

Задержка против точности: Приложения в реальном времени требуют низкой задержки, но могут жертвовать точностью. Производственные системы должны балансировать эти конкурирующие требования в зависимости от использования.

Проектирование производственной системы

Пакетная обработка против потоковой обработки: Пакетная обработка оптимизирует затраты и пропускную способность, в то время как потоковая обработка позволяет транскрибировать в реальном времени для живых приложений.

Оптимизация вывода на GPU: Квантование модели, пакетная обработка и параллелизация тензоров снижают вычислительные затраты при сохранении точности.

Оркестрация конвейера: Очереди сообщений (например, Azure Service Bus) координируют между этапами обработки, позволяя масштабируемые, устойчивые к сбоям рабочие процессы.

Стратегии оптимизации затрат: Динамическая пакетная обработка, спотовые экземпляры и сжатие модели снижают инфраструктурные затраты при сохранении соглашений об уровне обслуживания.

Сравнение технической архитектуры

| Компонент | Базовое ASR | WhisperX | Корпоративный конвейер |

|---|---|---|---|

| Обработка аудио | Один канал | Базовая фильтрация | Разделение Conv-TasNet |

| Распознавание речи | HMM/GMM | Трансформер | WhisperX + дообучение |

| Диаризация говорящих | Нет | Базовая кластеризация | Продвинутая кластеризация + профилирование голоса |

| Принудительное выравнивание | Нет | Базовое выравнивание | Выравнивание с точностью на уровне слов |

| Контроль качества | Ручной | Оценка уверенности | Автоматизированный + проверка человеком |

| Масштабируемость | Ограниченная | Средняя | Масштаб предприятия |

| Точность | 70-85% | 90-95% | 95-98% |

Технические компромиссы:

- Задержка против точности: Более крупные модели обеспечивают лучшую точность, но увеличивают время обработки

- Вычислительная стоимость: Ускорение на GPU имеет решающее значение для обработки на уровне производства

- Размер модели: Квантование снижает использование памяти, но может повлиять на точность в крайних случаях

- Поддержка языков: Многоязычные модели требуют больше хранилища и вычислительных ресурсов

Производственная архитектура транскрипции от Curify

Система транскрипции Curify представляет собой реализацию производственного уровня современных технологий обработки аудио, разработанную для масштабируемости, точности и надежности. Наша архитектура сочетает несколько специализированных нейронных сетей в едином конвейере, который обрабатывает видео контент от начала до конца с минимальным человеческим вмешательством.

Основные технические компоненты:

Стек обработки аудио: Используя Conv-TasNet для разделения источников и WhisperX для транскрипции, Curify достигает точности более 95% даже в шумных условиях. Система обрабатывает аудио с разрешением 16 кГц, применяя снижение шума в реальном времени и диаризацию говорящих для изоляции отдельных голосов.

Поток контроля качества: Автоматизированная оценка уверенности выявляет потенциальные ошибки транскрипции для проверки человеком. Система использует языковые модели, обученные на терминологии, специфичной для области, чтобы улучшить точность для технического контента, с возможностями дообучения для отраслевой лексики.

Инфраструктура: Развернута на кластерах GPU с распределенной обработкой, обрабатывающей более 100 одновременных заданий транскрипции. Система обрабатывает 1 час видео примерно за 2 минуты, в зависимости от сложности контента и качества аудио.

Оркестрация конвейера: Очереди Azure Service Bus координируют между этапами обработки, позволяя устойчивые к сбоям рабочие процессы, которые могут автоматически обрабатывать сбои и повторы. Система поддерживает как пакетную обработку для экономии затрат, так и потоковую для приложений в реальном времени.

🎯 Готовы реализовать продвинутые конвейеры транскрипции для вашей организации? Изучите технические решения транскрипции от Curify

Будущее технологий транскрипции видео

Технология транскрипции видео эволюционировала от базовых систем распознавания речи к сложным многоступенчатым конвейерам, которые объединяют достижения в области нейронных сетей, обработки аудио и методов оптимизации. Современные системы, такие как конвейер Curify, демонстрируют, как Conv-TasNet для разделения аудио, WhisperX для транскрипции и продвинутый контроль качества могут быть интегрированы в рабочие процессы промышленного уровня.

Для технических команд и разработчиков ключевое заключение заключается в том, что транскрипция видео больше не является исследовательской задачей, а представляет собой решенную инженерную проблему. Оставшиеся возможности заключаются в оптимизации, крайних случаях и интеграции, а не в фундаментальных ограничениях технологии. Поскольку эти системы продолжают улучшаться благодаря лучшим архитектурам моделей и большим наборам данных для обучения, мы приближаемся к будущему, где идеальная транскрипция доступна в масштабе для любого типа контента.

Описанная здесь техническая архитектура представляет собой текущее состояние искусства в 2026 году, но эта область продолжает быстро развиваться. Транскрипция в реальном времени, идентификация говорящего без примеров и автоматизированное резюмирование контента уже становятся новыми возможностями, которые еще больше изменят наш подход к обработке и анализу видео-контента.

Связанные статьи

video-translation-dubbing

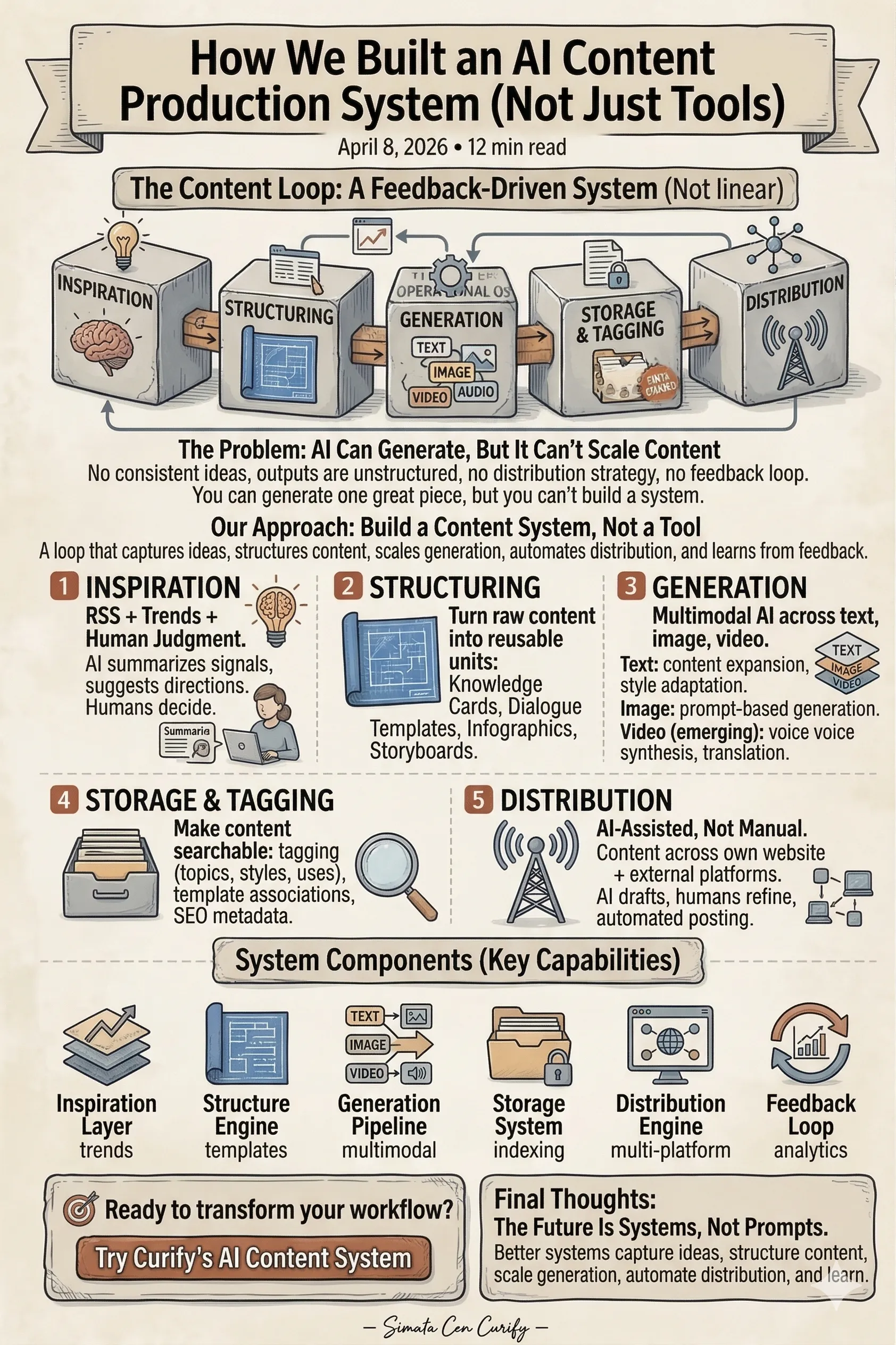

How We Built an AI Content Production System (Not Just Tools)

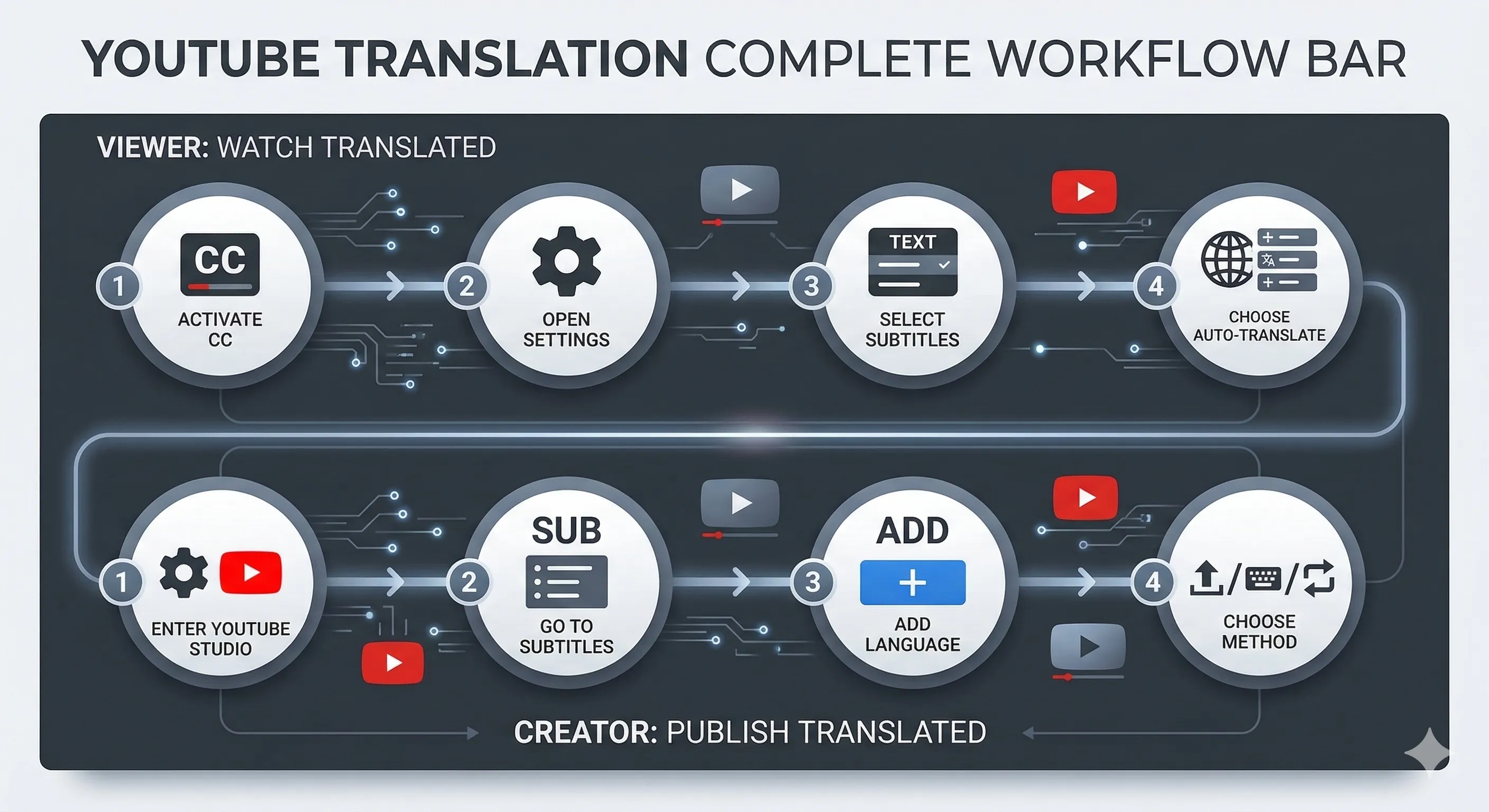

Inside Curify's Video Translation Pipeline: A Technical Deep-Dive