Как естественно дублировать видео в 2026 году: исправление артефактов клонирования голоса ИИ

Всеобъемлющее руководство по решению распространенных проблем дублирования с помощью инструментов ИИ. Сосредоточьтесь на проблемах, таких как роботизированный темп, недостаток эмоций и проблемы синхронизации губ.

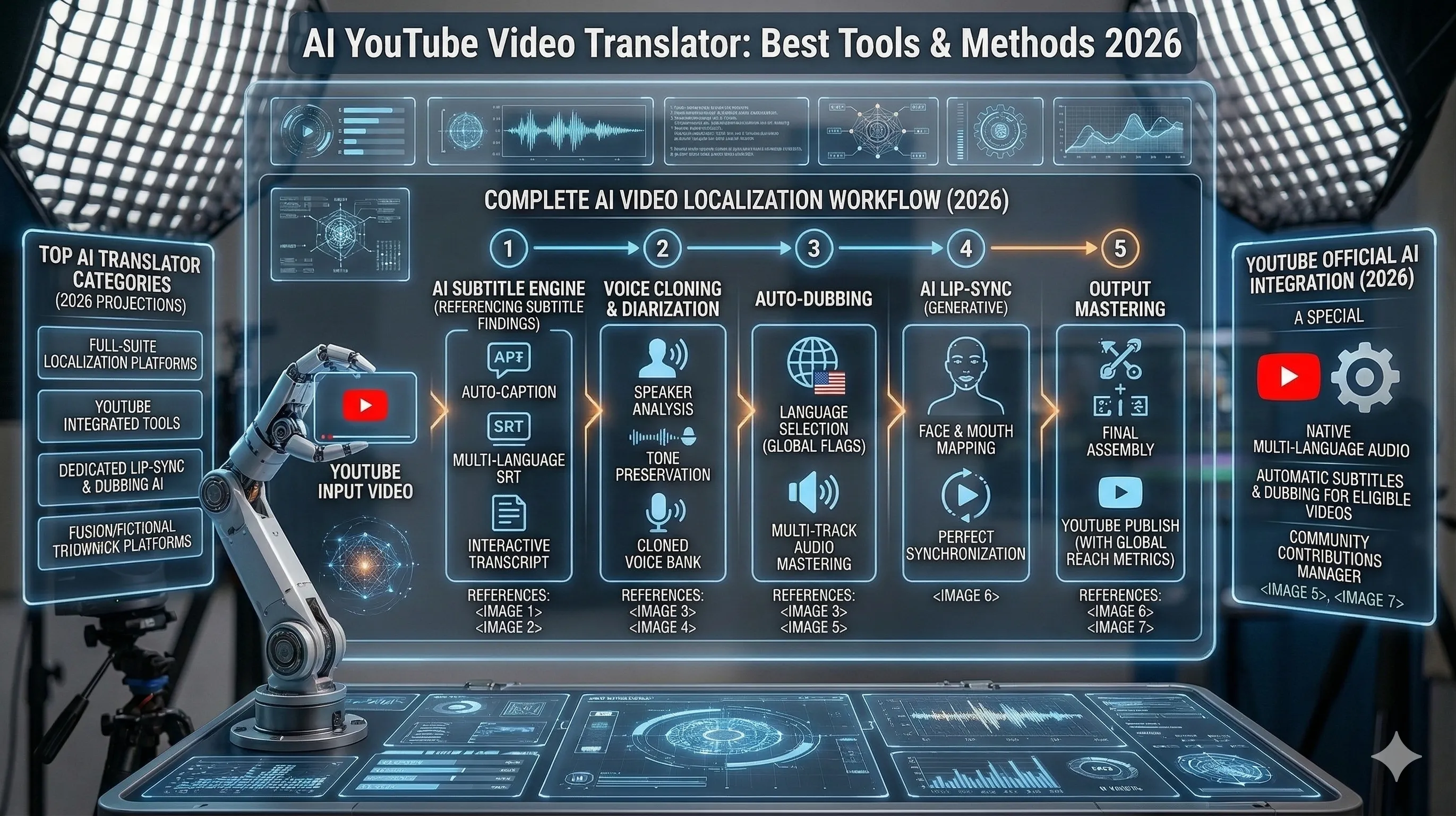

Дублирование видео с помощью ИИ произвело революцию в создании контента, но роботизированные артефакты и неестественный темп все еще преследуют многие производства. В 2026 году у нас есть лучшие инструменты и техники для преодоления этих проблем. Основная проблема заключается в том, как большинство дублирующих процессов рассматривают речь как чисто технический слой, а не как выступление. Многие системы все еще генерируют аудио с плоской просодией, непоследовательным акцентом и плохо рассчитанными паузами, что нарушает погружение, даже если голос звучит реалистично. Зрители очень чувствительны к несоответствиям во времени — когда эмоциональные моменты, микро-паузы или акценты предложения не совпадают с визуальным исполнением, результат кажется слегка «неправильным», даже если они не могут объяснить почему. Современные подходы решают эту проблему, сосредотачиваясь на управлении просодией и временной согласованности. Вместо линейной генерации речи новые модели включают синтез с учетом ритма, позволяя создателям контролировать темп на уровне фразы и слога. Это позволяет соответствовать движениям губ, сохранять драматические паузы и поддерживать намерение оригинального актера на разных языках. Техники, такие как принудительное выравнивание, тайминг на уровне фонем и кондиционирование с использованием эталонного аудио, теперь становятся стандартом в высококачественных процессах. Еще одно значительное улучшение связано с моделированием голоса с учетом контекста. Вместо генерации каждой строки изолированно, продвинутые системы поддерживают разговорную память — отслеживая тон, эмоциональное состояние и динамику говорящего на протяжении сцен. Это снижает тональные отклонения и обеспечивает согласованность персонажа, независимо от того, шепчет ли он, спорит или излагает информацию. Для контента с насыщенным повествованием этот сдвиг сам по себе значительно улучшает воспринимаемую реалистичность. Наконец, рост рабочих процессов с участием человека сократил разрыв между автоматизацией и качеством. Создатели теперь комбинируют генерацию ИИ с легкими слоями редактирования — уточняя паузы, регулируя акценты или регенерируя конкретные сегменты вместо целых клипов. Этот гибридный подход балансирует эффективность с творческим контролем, позволяя производственным командам масштабировать дублирование, при этом достигая результатов на уровне студии. Вместе эти достижения переводят дублирование с помощью ИИ из удобного инструмента в производственное решение, способное предоставлять естественные, эмоционально резонирующие выступления на разных языках без ущерба для скорости или масштабируемости.

Это руководство покажет вам, как исправить распространенные проблемы дублирования с помощью передовых инструментов ИИ, таких как MuseTalk, Emotion TTS и продвинутые техники постобработки. Мы выходим за рамки базовой генерации голоса, чтобы решить самые настойчивые точки отказа в рабочих процессах дублирования ИИ — отклонение синхронизации губ, монотонную подачу, несоответствия во времени и эмоциональную плоскость. Вы узнаете, как использовать MuseTalk для точного визуально-аудиального выравнивания, обеспечивая, чтобы сгенерированные речевые треки близко соответствовали движениям губ и мимике, даже в быстро развивающихся или насыщенных диалогом сценах. С аудиостороны мы разбираем, как использовать системы Emotion TTS для внедрения контролируемой выразительности в сгенерированные голоса. Вместо того чтобы полагаться на общие пресеты, руководство описывает, как настроить контуры высоты, темп и акценты, чтобы отразить намерение — будь то напряжение, сарказм или тонкие эмоциональные изменения в одной строке. Это позволяет вам перейти от «технически правильного» аудио к выступлениям, которые звучат по-человечески и контекстуально обоснованно. Мы также рассматриваем расширенные рабочие процессы постобработки, которые имеют критическое значение для качества финального вывода. Это включает в себя корректировки тайминга на уровне фонем, обрезку и удлинение тишины, вставку дыхания и пауз, а также техники мастеринга аудио, такие как соответствие эквалайзера и нормализация громкости, чтобы без швов интегрировать дублированные голоса в оригинальный саундтрек. Объединив эти инструменты и техники в единую цепочку, вы сможете систематически диагностировать и исправлять проблемы дублирования, а не полагаться на проб и ошибок — превращая непоследовательные выходы ИИ в отточенный, готовый к производству диалог.

Pro Tip

Распространенные проблемы дублирования ИИ

🤖 Роботизированный темп

Речь, сгенерированная ИИ, часто лишена естественного ритма и тайминга, что делает ее механической и отстраненной.

Потеря интереса зрителей

Неестественный темп нарушает погружение и снижает удержание зрителей до 40%.

😐 Недостаток эмоциональной нюансировки

Голоса ИИ испытывают трудности с передачей тонких эмоций, что делает драматические сцены плоскими.

Эмоциональная разобщенность

Отсутствие эмоциональных сигналов мешает зрителям связываться с персонажами и сюжетом.

👄 Несоответствия синхронизации губ

Плохое выравнивание между аудио и визуальными движениями губ создает эффект странной долины.

Нереалистичный внешний вид

Видимые ошибки синхронизации губ немедленно нарушают иллюзию естественной речи.

Преобразите свой дубляж видео с помощью ИИ

Объединив эти продвинутые техники и инструменты, вы сможете создать естественный, эмоционально привлекательный дубляж, который завораживает аудиторию. Будущее ИИ-дубляжа здесь, и оно более человечно, чем когда-либо.