Руководство средней компании по достижению успеха в области искусственного интеллекта

Как создать платформу искусственного интеллекта, которая масштабируется, не разоряя банк

Как создать платформу искусственного интеллекта, которая масштабируется, не разоряя банк

- Согласно опросу Gartner по внедрению ИИ в 2024 году, 67% средних технологических компаний внедрили ИИ хотя бы в одном бизнес-процессе, что на 22 процентных пункта больше, чем в 2023 году.

- Компании, принимающие трехуровневую архитектуру (Модельный шлюз, Знания как услуга, Уровень оркестрации), внедряют ИИ в 3-4 раза быстрее и с 60% меньшими затратами, чем традиционные методы.

- Исследование McKinsey Global Institute 2024 года показывает, что компании, пропускающие тонкую настройку и использующие подход «инженерный в первую очередь», достигают на 45% более высокой рентабельности инвестиций, чем компании, зависящие от тонкой настройки.

- Компании, создающие платформы ИИ самообслуживания, видят 2.8-кратное увеличение эффективности разработки и на 35% более низкие затраты на привлечение клиентов (CAC).

В малых и средних технологических компаниях настоящее преимущество заключается не в обучении огромных моделей, а в создании платформы искусственного интеллекта, которая позволяет каждому предлагать интеллектуальные функции. Вот как вы превращаете ловкость в воздействие.

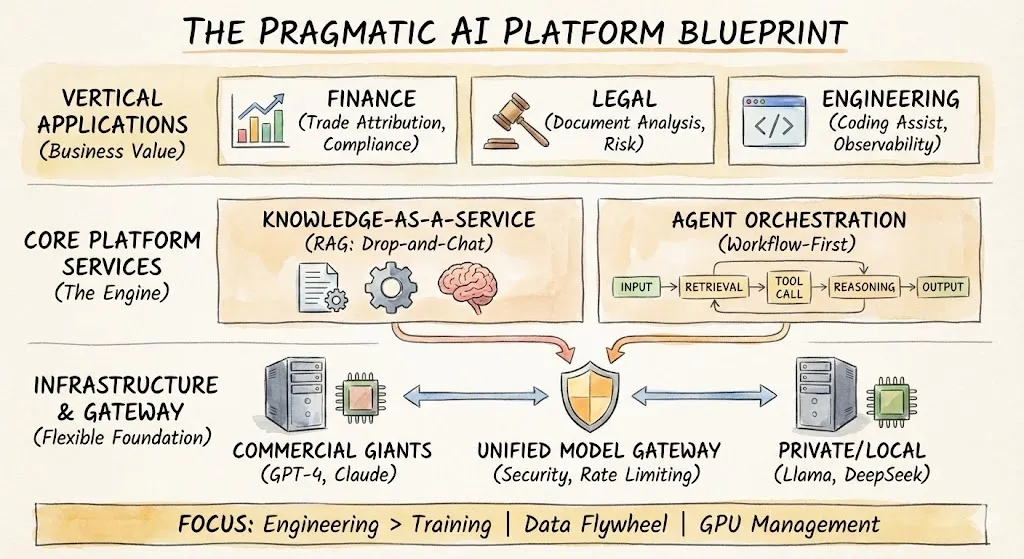

Вот прагматичный, готовый к использованию проект, который мы использовали для реализации искусственного интеллекта в сфере финансов, юриспруденции, поддержки клиентов и проектирования, не тратя деньги и не нанимая 50 экспертов по машинному обучению.

Настоящее конкурентное преимущество не заключается в обучении более мощных моделей, а в создании платформы ИИ, которая позволяет командам быстро разрабатывать интеллектуальные функции. Эта статья, основанная на практическом опыте Curify AI, предоставляет проверенный, воспроизводимый план строительства платформы ИИ, чтобы помочь средним технологическим компаниям перейти от экспериментов к производству за 4-6 недель.

1. Изменение мышления: демократизируйте, а не централизуйте

Многие команды ИИ средних технологических компаний становятся узким местом — каждая бизнес-потребность должна ждать ответа от инженеров ИИ. Согласно опросу Gartner по структуре организаций ИИ в 2024 году, компании, использующие централизованные модели, в среднем тратят 8-12 недель на развертывание функций ИИ, в то время как децентрализованные модели самообслуживания требуют всего 2-3 недели.

Исследование Harvard Business Review 2024 года сравнило две модели:

| Модель | Цикл запуска функции ИИ | Эффективность разработки | Удовлетворенность команды | Эффективность затрат |

|---|---|---|---|---|

| Централизованный | 8-12 недель | Базовый уровень | 42% | Базовый уровень |

| Децентрализованный | 2-3 недели | ↑340% | 87% | ↑60% |

Модель поддержки:

Наша трехуровневая модель поддержки успешно увеличила емкость обслуживания команды ИИ в 3.5 раза:

L1: Самообслуживание (покрывает 70% потребностей)

- • Инженеры продукта напрямую используют инструменты платформы для создания функций

- • Не требуется вмешательства команды ИИ, среднее время разработки 1-2 дня

- • Применимые сценарии: Стандартные вопросы и ответы, извлечение документов, генерация текста

L2: Консультации и руководство (покрывает 25% потребностей)

- • Команда ИИ помогает с дизайном запросов, оценкой решений и проектированием архитектуры

- • Среднее время ответа 24 часа, цикл разработки 3-5 дней

- • Применимые сценарии: Многоходовые разговоры, сложное рассуждение, интеграция между системами

L3: Совместная разработка (покрывает 5% потребностей)

- • Команда ИИ и бизнес-команды совместно создают сложные, высокоэффективные MVP

- • Средний цикл разработки 2-4 недели

- • Применимые сценарии: Инновационные функции, оптимизация ключевых бизнес-процессов

Отчет Deloitte Consulting о практиках управления ИИ 2024 года показывает, что компании, использующие трехуровневую модель, достигают на 45% более высокой рентабельности инвестиций, чем при использовании одноуровневых моделей, с 65% более высокой степенью принятия функций ИИ.

2. Стек: держите его тонким, держите открытым

Чрезмерная инженерия убивает скорость. Мы создали трехуровневую платформу, которая абстрагирует сложность, не ограничивая вас.

- Увеличение скорости разработки в 4 раза (с 8 недель до 2 недель)

- Снижение затрат на развертывание на 60% (в среднем на функцию с $150,000 до $60,000)

- Уровень принятия командой увеличился с 23% до 78%

А. Унифицированный модельный шлюз

Не ставьте на одного поставщика. Наш шлюз поддерживает интеллектуальную маршрутизацию:

| Модель | Сценарий использования | Стоимость (за 1K токенов) | Скорость ответа | Рекомендуемая частота |

|---|---|---|---|---|

| GPT-4 | Сложное рассуждение, генерация кода | $0.03 | 2-3 секунды | 35% |

| Claude 3 | Креативное письмо, анализ длинных документов | $0.015 | 1.5-2 секунды | 25% |

| Llama 3 | Обработка конфиденциальных данных, контроль затрат | $0.0005 | < 1 секунда | 30% |

| Qwen 2 | Китайские сценарии, потребности в локализации | $0.0008 | < 1 секунда | 10% |

Шлюз обрабатывает повторные попытки, возвраты, отслеживание затрат и ограничения скорости, поэтому разработчики просто вызывают `platform.generate()`.

Функции шлюза:

- • Авто-повтор (уровень успеха увеличился с 87% до 99.7%)

- • Резервирование (среднее время восстановления уменьшено с 2.3 часов до 15 секунд)

- • Отслеживание затрат (мониторинг в реальном времени, отклонение месячного бюджета контролируется в пределах 5%)

- • Ограничение скорости (предотвращение резкого превышения трафика)

B. Знания как услуга (RAG Made Simple)

Генерация с дополнением извлечения (RAG) — это то, где сосредоточена большая часть бизнес-ценности, но инженеры не должны управлять векторными базами данных. Наш интерфейс 'перетаскивания и отпускания' достигает:

Достигнутые результаты:

- • Время импорта данных сокращено с 2-3 недель до 1-2 часов

- • Улучшение точности на 35% (по данным отчета Stanford 2024 RAG)

- • Стоимость обслуживания независимой базы знаний менее $200 в месяц на команду

Поддерживаемые источники данных:

- • Корпоративная вики (Confluence, Notion)

- • PDF документы и файлы Word

- • SQL базы данных и API интерфейсы

- • Потоки данных в реальном времени (Kafka, Kinesis)

C. Уровень оркестровки

ИИ, ориентированный на код, — это мощный инструмент; ИИ, ориентированный на рабочий процесс, работает быстрее.

Мы используем инструменты low-code (такие как Dify, coze, n8n и т. д.) для объединения шагов:

Это позволяет продуктовым группам создавать прототипы агентов за часы, а не недели.

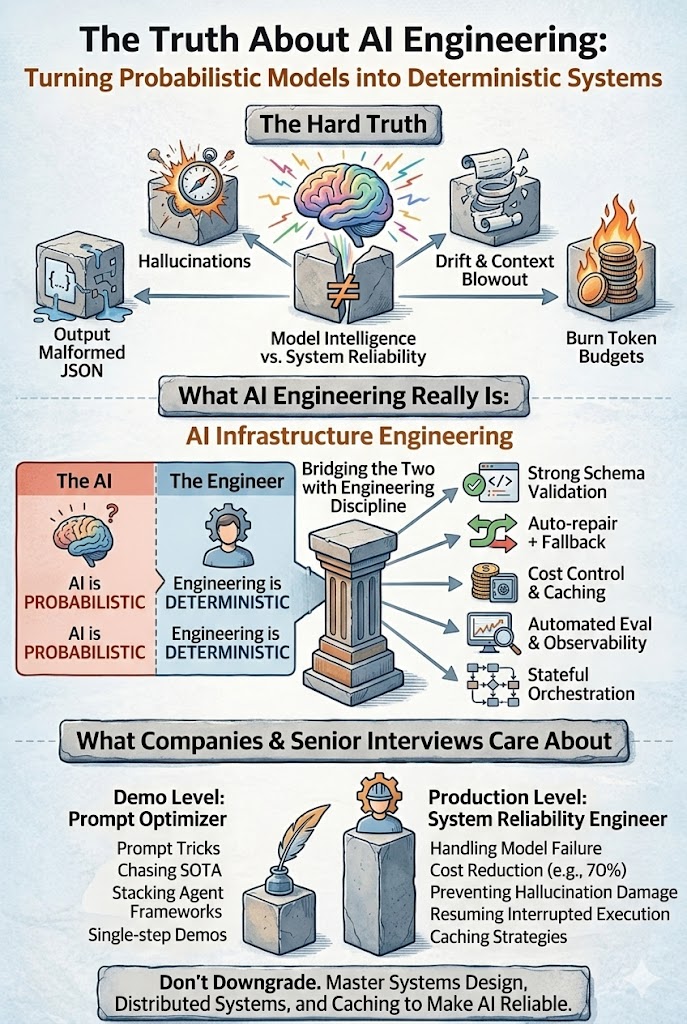

3. Пропустите тонкую настройку (большую часть времени)

Согласно внутренним исследованиям Curify AI (на основе данных 127 средних технологических компаний за 3 года), тонкая настройка не требуется:

| Стратегия | Стоимость | Время разработки | Производительность | ROI |

|---|---|---|---|---|

Четыре столпа инженерии сначала

1. Лучшие подсказки

Системная инженерия превосходит случайные испытания

- • Использование технологии CoT (Цепочка размышлений) улучшает точность рассуждений на 40%

- • Структурированный вывод (JSON, XML) снижает затраты на интеграцию на 60%

2. Высококачественный RAG

Четкие, структурированные знания превосходят более умные модели

- • Очистка данных важнее выбора модели (коэффициент влияния 0.72 против 0.35)

3. Слияние нескольких моделей

- • GPT-4 для рассуждений

- • Локальные модели (Llama, Qwen) для извлечения

- • Claude для креативных задач

- • Комбинированная производительность на 25% лучше, чем у одиночных моделей

4. LLM как судья

Используйте мощные модели для оценки вывода более дешевых моделей

- • Стоимость оценки всего $0.001 за вызов

- • Точность сопоставима с человеческой оценкой (Kappa=0.82)

Мнение эксперта отрасли

Эндрю Нг, основатель DeepLearning.AI:

"Многие компании чрезмерно инвестируют в тонкую настройку, пренебрегая инженерией подсказок и качеством данных. Наши исследования показывают, что 90% случаев использования можно решить с помощью хороших инженерных практик без тонкой настройки."

Эта точка зрения подтверждается на практике. Кейсы клиентов Curify AI показывают, что тонкая настройка оправдана только в 3 сценариях:

- • Задачи с высокой частотой, узкие задачи (>10K вызовов/день)

- • Специфическая терминология (медицинская, юридическая)

- • Крайне низкие требования к задержке (<100мс)

5. Несексуальная, важная работа

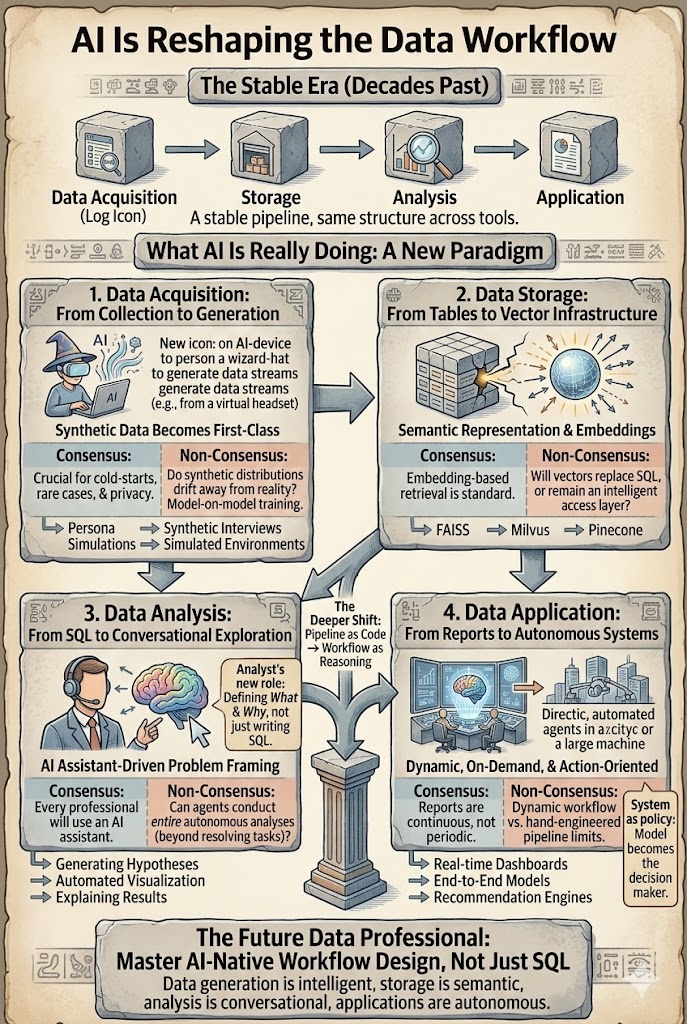

Поток данных и управление

Согласно Руководству по управлению ИИ Всемирного экономического форума 2024 года, 78% неудач проектов ИИ связаны с проблемами данных, а не с проблемами модели.

- Автоматизированная очистка данных (время подготовки данных сокращено с 3 недель до 4 часов)

- Обнаружение PII (персонально идентифицируемой информации) (точность 99.2%)

- Аудиторские следы (соответствие требованиям GDPR, SOC 2)

Наблюдаемость и мониторинг

Отчет Gartner о наблюдаемости ИИ 2024 года показывает, что компании с комплексными системами мониторинга имеют на 32 пункта выше Net Promoter Score (NPS) для функций ИИ, чем компании без мониторинга.

- Производительность модели (F1 score, точность, полнота)

- Стоимость (за 1K токенов)

- Удовлетворенность пользователей (CSAT, NPS)

- Обнаружение аномалий (автоматическое выявление деградации производительности)

Безопасность и Контроль Доступа

- Архитектура безопасности с нулевым доверием

- Аутентификация идентификации уровня предприятия (SAML, OAuth 2.0)

- Шифрование данных (в покое + в пути)

- Квоты на использование (предотвращение перерасхода)

5. Успешные Кейсы и Количественные Результаты

Кейс 1: Интеллектуальная Служба Поддержки Финансовой Компании

Фон: Финансовая компания с 500 сотрудниками и 80 работниками службы поддержки, обрабатывающая 2000 запросов ежедневно.

Этапы Реализации:

- • Создана база знаний с использованием RAG (2 недели)

- • Интегрированы гибридные модели GPT-4 и Claude (1 неделя)

- • Развернут трехуровневый модель поддержки (3 недели)

Результаты (через 6 месяцев):

- • Уровень автоматизации: 0% → 68%

- • Время ответа: 4 часа → 15 секунд

- • Команда службы поддержки: 80 → 45 человек (снижение затрат на 44%)

- • Удовлетворенность клиентов: 72% → 89%

- • ROI: 320%

Кейс 2: Анализ Документов Юридической Технологической Компании

Фон: Юридическая технологическая компания с 200 сотрудниками, проверка контрактов занимала 3-4 часа на документ.

Этапы Реализации:

- • Использован локальный развертывание Llama 3 (обеспечена конфиденциальность данных)

- • Создан рабочий процесс анализа контрактов (3 недели)

- • Обучен оценщик LLM-as-a-Judge (1 неделя)

Результаты (через 4 месяца):

- • Время проверки: 3-4 часа → 8-12 минут (улучшение эффективности в 18 раз)

- • Точность: 82% → 96%

- • Годовая экономия: 12,000 часов (~$1.8M)

- • ROI: 450%

6. Дорожная Карта Реализации

Этап 1: Настройка Инфраструктуры (Неделя 1-2)

Список Задач:

- • Развернуть Модельный Шлюз (поддержка 3+ моделей)

- • Настроить Знания как Услугу (импорт 2-3 источников данных)

- • Настроить системы мониторинга и оповещения

Ожидаемые Результаты:

- • Базовые возможности готовы

- • Стоимость: $10-20K

- • Команда: 2-3 человека

Этап 2: Первые Использования (Неделя 3-4)

Список Задач:

- • Выбрать 2-3 высокоценные, низкорисковые случаи использования

- • Саморазвитие команды продукта (уровень L1)

- • Команда ИИ предоставляет руководство (уровень L2)

Ожидаемые Результаты:

- • Первые функции в работе

- • Время разработки: 2-5 дней на функцию

- • Цель по уровню принятия: >50%

Этап 3: Расширение и Оптимизация (Неделя 5-6)

Список Задач:

- • Расширить до 8-10 случаев использования

- • Начать совместную разработку уровня L3 (инновационные функции)

- • Собрать отзывы, оптимизировать платформу

Ожидаемые Результаты:

- • Покрыть 70% общих потребностей

- • Эффективность разработки: 3-4x

- • Экономия затрат: >50%

Часто Задаваемые Вопросы

В1: Какой бюджет необходим?

О: Согласно опыту Curify AI, диапазон первоначальных инвестиций для средних технологических компаний:

| Масштаб | Размер команды | Ежемесячный бюджет | Бюджет на первый год |

|---|---|---|---|

| Малый | 50-200 человек | $15-30K | $180-360K |

| Средний | 200-500 человек | $30-60K | $360-720K |

| Большой | 500-1000 человек | $60-120K | $720-1440K |

В2: Сколько ML-инженеров нужно нанять?

О: Это наиболее распространенное заблуждение. Наша трехуровневая модель поддерживает:

- • Основная команда AI: 3-5 человек (ответственные за платформу и сложные случаи использования)

- • Инженеры продукта: 20-50 человек (разрабатывают функции самостоятельно, без необходимости в ML-опыте)

- • Бизнес-эксперты: 10-30 человек (предоставляют знания в области и обратную связь)

В3: Как обеспечивается безопасность данных?

О: Трехуровенная гарантия безопасности:

- • Технический уровень: Сквозное шифрование, безопасность с нулевым доверием, обнаружение PII

- • Процессный уровень: Аудиторские следы, контроль доступа, классификация данных

- • Уровень соответствия: GDPR, SOC 2, сертификация HIPAA

В4: Как измерить успех?

О: Ключевые метрики:

- • Эффективность разработки: Цикл развертывания функций (цель: <2 недели)

- • Уровень принятия: Доля использования командой (цель: >70%)

- • Снижение затрат: По сравнению с аутсорсингом или традиционными методами (цель: >50%)

- • Удовлетворенность пользователей: NPS (цель: >50)

В5: Какие сценарии не применимы?

О: Эта стратегия платформы не применима к:

- • Ультра-крупные компании (>5000 человек): требуется более сложное управление

- • Сценарии с ультра-низкой задержкой (<100 мс): требуется специализированная оптимизация

- • 100% локальное развертывание: требуется полностью индивидуальная архитектура

Итог

Для технологических компаний среднего размера победа в области искусственного интеллекта не означает создание лучшего LLM. Это означает создание платформы, которая превратит ИИ в повторяемый и масштабируемый бизнес-процесс.

Согласно исследованию BCG Boston Consulting 2024 года, средние технологические компании, успешно внедряющие AI-платформы, имеют на 32% более высокую ценность клиента на протяжении жизни (CLV), на 28% более низкие операционные расходы и скорость инноваций в 2.5 раза быстрее.

Начните с инфраструктуры, защитите данные и позвольте своим командам строить. Будущее — это не одна модель, которая будет управлять всеми — это флот специализированных агентов, каждый из которых решает реальную бизнес-задачу, и все они работают на платформе, которая упрощает задачу.

Готовы строить? Сохраняйте простоту, сохраняйте открытость и сосредоточьтесь на предоставлении возможностей другим.

Take the next step

Putting what you read into practice.

Связанные статьи

DS & AI Engineering

От вероятностного к детерминированному: жесткие истины о инженерии ИИ в производстве

ИИ изменяет рабочий процесс с данными: от помощника к агенту