심층 분석: 전사 기술 개요

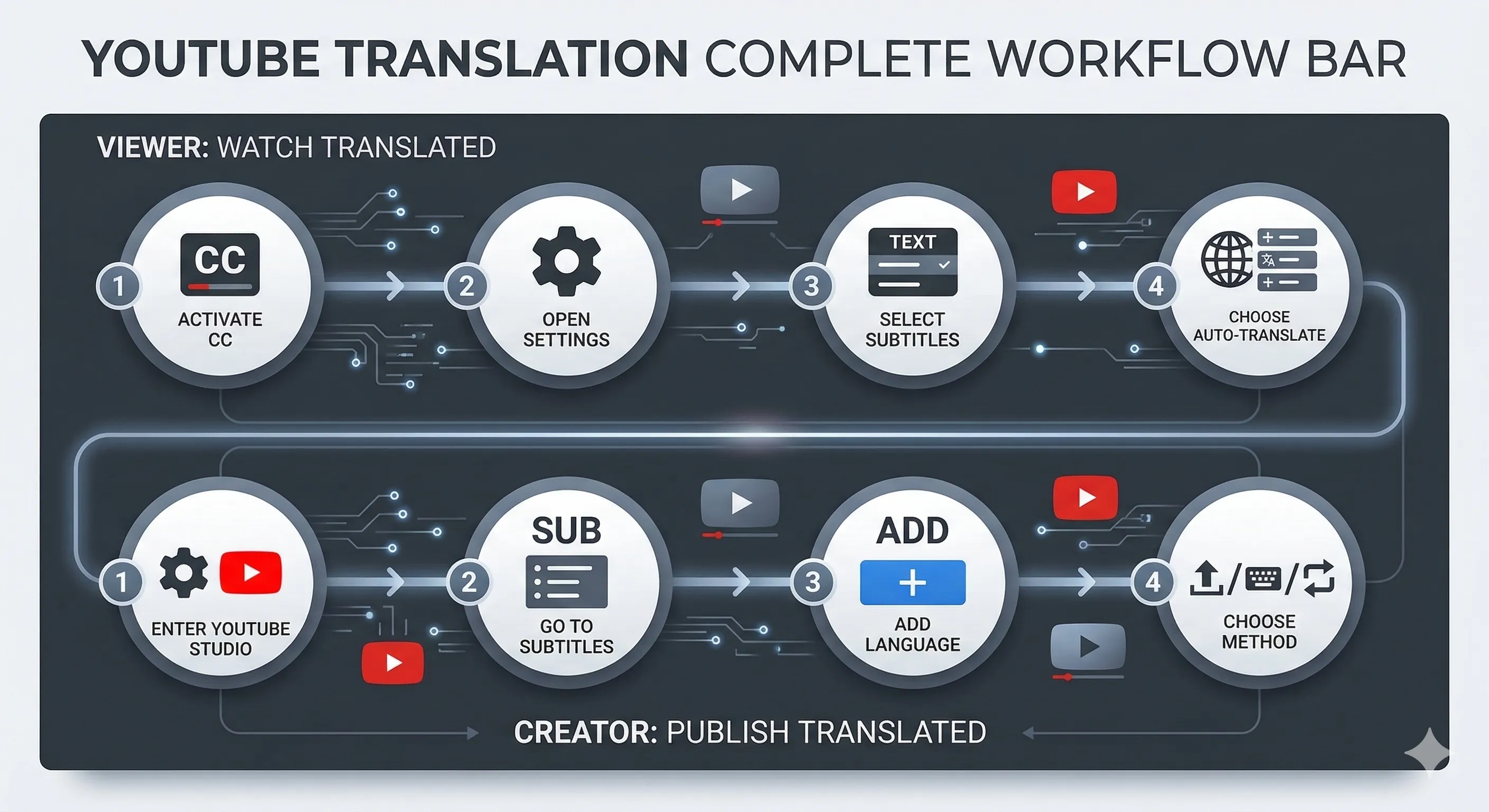

대부분의 전사 도구는 음성을 텍스트로 변환하는 데 그칩니다. 이 심층 분석에서는 Curify의 전체 전사 파이프라인을 다룹니다: 오디오가 배경 음악에서 어떻게 분리되는지, WhisperX가 정리된 트랙에서 어떻게 작동하는지, 화자 분리가 겹치는 목소리를 어떻게 나누는지, 강제 정렬이 단어 수준의 타임스탬프를 전사에 다시 넣어 출력이 [/tools/video-transcript-generator](/tools/video-transcript-generator)에서 자막, 더빙 및 번역 도구를 구동할 수 있도록 하는 방법을 설명합니다. SRT를 다운로드하는 것뿐만 아니라 더 큰 파이프라인에 전사를 통합하고 싶다면, 이것은 대부분의 블로그 게시물이 건너뛰는 레이어입니다.

종단 간 비디오 전사 파이프라인

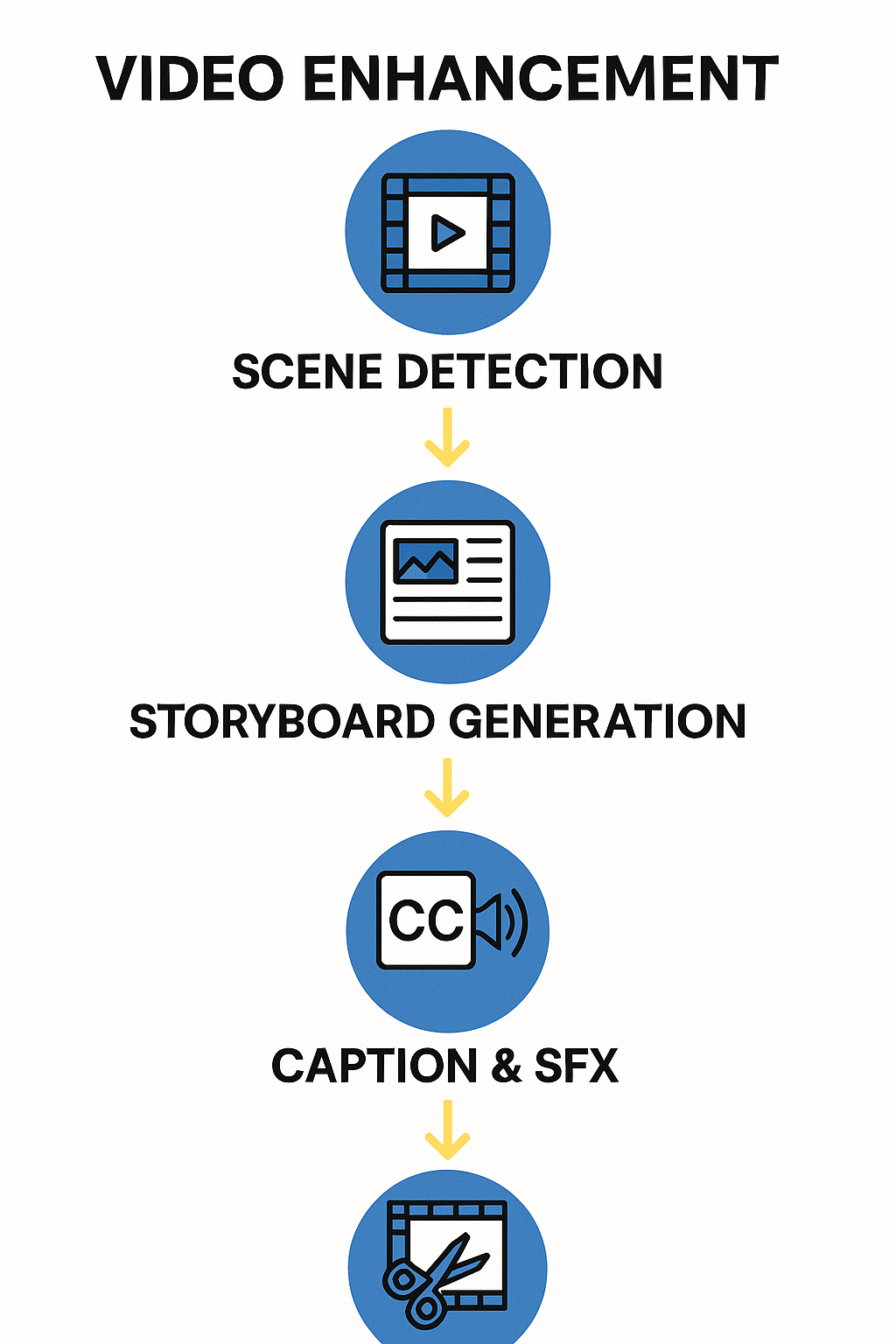

생산 등급 비디오 전사 파이프라인은 원시 비디오 콘텐츠를 구조화된 시간 동기화된 텍스트로 변환하는 여러 정교한 처리 단계를 거칩니다. 전체 워크플로: 비디오 → 오디오 추출 → 세분화 → ASR (자동 음성 인식) → 정렬 → 화자 구분 → 후처리.

각 단계는 특정 기술적 과제를 해결합니다: 오디오 추출은 음성 트랙을 분리하고, 세분화는 긴 오디오를 관리 가능한 청크로 나누며, ASR은 음성을 텍스트로 변환하고, 정렬은 단어 수준의 타임스탬프를 제공합니다. 화자 구분은 누가 언제 말했는지를 식별하고, 후처리는 최종 출력을 정리하고 형식을 지정합니다.

Curify의 파이프라인과 같은 현대 시스템은 Conv-TasNet을 오디오 분리에, WhisperX를 음성 인식에, 고급 클러스터링 알고리즘을 화자 식별에 결합하여 도전적인 조건에서도 95% 이상의 정확도를 달성합니다. 이 기술 심층 분석은 각 구성 요소와 그 통합 전략을 탐구합니다.

전사에 대한 기술 아키텍처의 중요성

정확도와 속도의 균형: 더 큰 모델은 더 나은 정확도를 제공하지만 처리 시간과 계산 비용을 증가시킵니다. 생산 시스템은 사용 사례 요구 사항에 따라 이러한 요소의 균형을 맞춰야 합니다.

확장성 문제: 실시간 전사는 스트리밍 처리와 저지연 추론을 요구하며, 배치 처리는 처리량과 비용 효율성을 최적화할 수 있습니다.

다국어 복잡성: 코드 스위칭(문장 내 언어 혼합) 및 교차 언어 콘텐츠는 언어 경계를 넘어 맥락을 유지할 수 있는 전문 모델이 필요합니다.

생산 신뢰성: 기업 시스템은 실제 콘텐츠에서 발생하는 엣지 케이스를 처리하기 위해 장애 조치 메커니즘, 품질 모니터링 및 자동 오류 복구가 필요합니다.

핵심 파이프라인 구성 요소

오디오 전처리 및 세분화

파이프라인은 Conv-TasNet을 사용하여 소스 분리 및 오디오 세분화를 통해 정교한 오디오 전처리로 시작합니다. 이 단계는 시간 영역 오디오 분리를 통해 배경 음악, 주변 소음 및 기타 오디오 소스에서 인간의 음성을 분리합니다.

기술 구현:

# Conv-TasNet을 사용한 오디오 분리

import torch

import torchaudio

from conv_tasnet import ConvTasNet

# 소스 분리 모델 초기화

separator = ConvTasNet(

n_bases=512, # 기초 함수 수

kernel_size=16, # 컨볼루션 커널 크기

stride=8, # 시간적 컨볼루션의 스트라이드

n_layers=8, # 컨볼루션 레이어 수

n_src=2 # 분리할 소스 수

)

# 16kHz에서 오디오 파형 처리

audio_tensor, sample_rate = torchaudio.load('input_video.wav')

if sample_rate != 16000:

resampler = torchaudio.transforms.Resample(sample_rate, 16000)

audio_tensor = resampler(audio_tensor)

# 소스 분리

with torch.no_grad():

separated_sources = separator(audio_tensor)

speech_source = separated_sources[0] # 주요 음성 추출

Conv-TasNet 아키텍처는 원시 파형에서 오디오 소스를 직접 분리하기 위해 시간적 컨볼루션 네트워크를 사용하는 컨볼루션 인코딩-디코딩 구조를 사용하여 스펙트로그램 기반 접근 방식과 관련된 정보 손실을 피합니다.

WhisperX를 사용한 ASR (음성-텍스트)

깨끗한 음성은 전사 정확도와 속도를 최적화한 OpenAI의 Whisper 모델의 향상된 버전인 WhisperX로 들어갑니다. 이 시스템은 화자 구분을 통해 여러 화자, 방언 및 억양을 처리하며, 오디오를 화자 신원에 따라 자동으로 세분화합니다.

기술 구현:

# WhisperX를 사용한 고급 음성 인식

import whisperx

import torch

from whisperx.utils import get_writer

# 전사를 위한 WhisperX 모델 로드

model = whisperx.load_model("large-v3", device="cuda")

# 단어 수준 타임스탬프 및 화자 구분과 함께 전사 수행

result = model.transcribe(

speech_source,

batch_size=32, # 효율성을 위해 배치로 처리

language="auto", # 언어 자동 감지

task="transcribe",

word_timestamps=True, # 단어 수준 타이밍 활성화

print_progress=True

)

# 강제 정렬을 사용하여 Whisper 출력을 정렬

model_a, metadata = whisperx.load_align_model(

language_code=result["language"],

device="cuda"

)

result = whisperx.align(

result["segments"],

model_a,

metadata,

speech_source,

device="cuda"

)

# 화자 레이블 지정

diarize_model = whisperx.DiarizationPipeline(

use_auth_token=False,

device="cuda"

)

diarize_segments = diarize_model(speech_source)

result = whisperx.assign_word_speakers(diarize_segments, result)

WhisperX는 최적화된 추론, 더 나은 화자 구분 및 향상된 단어 수준 타이밍 정확도를 통해 기본 Whisper 모델을 개선합니다. 강제 정렬 단계는 오디오와 전사 간의 정확한 동기화를 보장합니다.

강제 정렬 및 단어 수준 타임스탬프

강제 정렬은 고품질 자막, 비디오 동기화 및 후속 언어 처리를 위해 필수적인 정확한 단어 수준 타임스탬프를 제공합니다. 이 단계에서 전용 음향 모델은 ASR 시스템의 오디오 신호와 초기 전사를 가져와 훨씬 더 세밀한 정렬을 수행합니다. 각 문장이나 세그먼트의 시작과 끝만 아는 것이 아니라, 시스템은 각 단어의 정확한 시작과 끝을 추정합니다. 이 정렬 과정은 숨겨진 마르코프 모델이나 신경 음향 인코더와 같은 확률적 시퀀스 모델을 사용하여 음향 증거와 전사를 기반으로 각 단어의 가장 가능성이 높은 타이밍을 계산합니다. 결과는 각 단어에 시작 시간, 종료 시간 및 신뢰도 점수가 주석으로 달린 풍부한 구조이며, 세그먼트는 자세한 타이밍 메타데이터로 보강됩니다. 이러한 정확한 타임스탬프는 프레임 정확한 자막 렌더링을 가능하게 하고, 편집자가 비디오 타임라인에서 특정 발화 부분으로 직접 이동할 수 있게 하며, 기계 번역, 더빙, 립싱크 분석 또는 대규모 미디어 라이브러리에서 콘텐츠 기반 검색과 같은 후속 작업을 위한 신뢰할 수 있는 시간적 기반을 생성합니다.

화자 구분 구현

화자 구분은 오디오 또는 비디오 파일에서 "누가 언제 말했는가"라는 질문에 답하는 역할을 하여 원시 전사를 구조화된 화자 인식 대화로 변환합니다. 시스템은 먼저 오디오를 단일 지배 화자가 포함될 가능성이 있는 동질적 세그먼트로 나누고, 각 세그먼트를 음색, 피치 패턴 및 말하기 스타일과 같은 특성을 캡처하는 화자 임베딩이라는 간결한 수치 표현으로 변환합니다. 이러한 임베딩을 사용하여 클러스터링 알고리즘은 비슷하게 들리는 세그먼트를 일관된 화자 신원으로 그룹화하며, 화자의 수나 신원을 사전에 알 필요가 없습니다. 고급 화자 구분 파이프라인은 화자 수를 적응적으로 추정하고, 화자가 겹치는 경계를 정제하며, 긴 녹음에서 동일한 화자 ID가 할당되도록 레이블을 부드럽게 합니다. 결과적으로 생성된 전사는 각 세그먼트와 종종 각 단어에 안정적인 화자 레이블을 연관시켜 회의록, 화자별 요약, 콜센터 분석, 개인화된 콘텐츠 추천 및 각 순간에 어떤 캐릭터나 참가자가 말하고 있는지를 나타내는 더 명확한 자막과 같은 응용 프로그램을 가능하게 합니다.

후처리 및 품질 보증

후처리 및 품질 보증 단계는 원시 모델 출력을 최종 사용자 및 후속 시스템에 적합한 다듬어진 생산 준비 전사로 변환합니다. 후처리는 일반적으로 대문자 수정, 숫자 확장 또는 표준화, 약어 처리 및 구두점 복원과 같은 정규화 단계로 시작하여 텍스트가 자연스러운 산문처럼 읽히도록 합니다. 그런 다음 타임스탬프는 표준화된 자막 시간 코드로 형식을 지정하고, 전사는 길이, 지속 시간 및 언어적 경계를 기준으로 읽기 쉬운 자막 단위 또는 단락으로 세분화됩니다. 품질 보증은 이 정리된 전사 위에 검증 레이어를 추가합니다: 단어 수준의 신뢰도 점수를 세그먼트 수준 메트릭으로 집계하고, 비정상적으로 낮은 신뢰도 구간, 갑작스러운 타이밍 간격 또는 의심스러운 반복을 감지하여 이를 인간 검토 또는 자동 재처리를 위해 플래그합니다. 추가 검사는 스타일 가이드를 시행하고, 적절할 경우 불필요한 단어를 제거하며, 화자 레이블이 파일 전반에 걸쳐 일관성을 유지하도록 합니다. 이러한 후처리 및 QA 단계는 최종 출력이 단순히 말한 내용을 반영할 뿐만 아니라 전문 전사, 현지화 및 접근성 워크플로에 필요한 정확성, 가독성 및 형식 기준을 충족하도록 보장합니다.

기술적 도전과제 및 해결책

겹치는 발화: 여러 화자가 동시에 말하는 것은 ASR에 도전 과제를 만듭니다. 해결책으로는 오디오 소스 분리, 다중 화자 모델 및 정교한 화자 구분 알고리즘이 있습니다.

다국어 전환: 언어 간 코드 스위칭은 여러 언어를 동시에 처리할 수 있는 모델이 필요합니다. 고급 시스템은 언어 식별 및 전문 다국어 모델을 사용합니다.

소음 환경: 배경 음악, 주변 소음 및 열악한 오디오 품질은 전사 정확도를 감소시킵니다. 오디오 전처리 및 소스 분리 기술이 이러한 문제를 완화합니다.

지연 대 정확도: 실시간 응용 프로그램은 낮은 지연을 요구하지만 정확도를 희생할 수 있습니다. 생산 시스템은 사용 사례에 따라 이러한 경쟁 요구 사항의 균형을 맞춰야 합니다.

생산 시스템 설계

배치 대 스트리밍 처리: 배치 처리는 비용 및 처리량을 최적화하고, 스트리밍 처리는 실시간 응용 프로그램을 위한 전사를 가능하게 합니다.

GPU 추론 최적화: 모델 양자화, 배치 처리 및 텐서 병렬화는 정확도를 유지하면서 계산 비용을 줄입니다.

파이프라인 오케스트레이션: 메시지 큐(예: Azure Service Bus)는 처리 단계 간의 조정을 통해 확장 가능하고 내결함성 있는 워크플로를 가능하게 합니다.

비용 최적화 전략: 동적 배치, 스팟 인스턴스 및 모델 압축은 서비스 수준 계약을 유지하면서 인프라 비용을 줄입니다.

기술 아키텍처 비교

| 구성 요소 | 기본 ASR | WhisperX | 기업 파이프라인 |

|---|---|---|---|

| 오디오 처리 | 단일 채널 | 기본 필터링 | Conv-TasNet 분리 |

| 음성 인식 | HMM/GMM | 변환기 | WhisperX + 미세 조정 |

| 화자 구분 | 없음 | 기본 클러스터링 | 고급 클러스터링 + 음성 프로파일링 |

| 강제 정렬 | 없음 | 기본 정렬 | 단어 수준 정밀 정렬 |

| 품질 보증 | 수동 | 신뢰도 점수 | 자동화 + 인간 검토 |

| 확장성 | 제한적 | 중간 | 기업 규모 |

| 정확도 | 70-85% | 90-95% | 95-98% |

기술적 트레이드오프:

- 지연 대 정확도: 더 큰 모델은 더 나은 정확도를 제공하지만 처리 시간을 증가시킵니다.

- 계산 비용: GPU 가속은 생산 규모 처리에 필수적입니다.

- 모델 크기: 양자화는 메모리 사용량을 줄이지만 엣지 케이스의 정확도에 영향을 미칠 수 있습니다.

- 언어 지원: 다국어 모델은 더 많은 저장소 및 계산 리소스를 요구합니다.

Curify의 생산 전사 아키텍처

Curify의 전사 시스템은 최첨단 오디오 처리 기술의 생산 등급 구현을 나타내며, 규모, 정확성 및 신뢰성을 위해 설계되었습니다. 우리의 아키텍처는 여러 전문 신경망을 통합하여 최소한의 인간 개입으로 비디오 콘텐츠를 종단 간으로 처리하는 파이프라인을 구성합니다.

핵심 기술 구성 요소:

오디오 처리 스택: Conv-TasNet을 소스 분리에, WhisperX를 전사에 활용하여 Curify는 소음 환경에서도 95% 이상의 정확도를 달성합니다. 시스템은 16kHz 해상도로 오디오를 처리하며, 실시간 소음 감소 및 화자 구분을 적용하여 개별 음성을 분리합니다.

품질 보증 파이프라인: 자동화된 신뢰도 점수는 인간 검토를 위한 잠재적 전사 오류를 식별합니다. 이 시스템은 기술 콘텐츠의 정확성을 개선하기 위해 도메인 특정 용어로 훈련된 언어 모델을 사용하며, 산업별 어휘에 대한 미세 조정 기능을 제공합니다.

인프라: GPU 클러스터에 배포되어 100개 이상의 동시 전사 작업을 처리합니다. 이 시스템은 콘텐츠 복잡성과 오디오 품질에 따라 약 2분 만에 1시간의 비디오를 처리합니다.

파이프라인 오케스트레이션: Azure Service Bus 큐는 처리 단계 간의 조정을 통해 실패 및 재시도를 자동으로 처리할 수 있는 내결함성 워크플로를 가능하게 합니다. 이 시스템은 비용 효율성을 위한 배치 처리와 실시간 응용 프로그램을 위한 스트리밍을 모두 지원합니다.

🎯 조직을 위한 고급 전사 파이프라인을 구현할 준비가 되셨나요? Curify의 기술 전사 솔루션 탐색하기

비디오 전사 기술의 미래

비디오 전사 기술은 기본 음성 인식 시스템에서 신경망, 오디오 처리 및 최적화 기술의 발전을 결합한 정교한 다단계 파이프라인으로 발전했습니다. Curify의 파이프라인과 같은 현대 시스템은 오디오 분리를 위한 Conv-TasNet, 전사를 위한 WhisperX 및 고급 품질 보증이 생산 등급 워크플로에 통합될 수 있음을 보여줍니다.

기술 팀과 개발자에게 핵심 요점은 비디오 전사가 더 이상 연구 문제이 아니라 해결된 엔지니어링 과제라는 것입니다. 남은 기회는 기본 기술 제한이 아닌 최적화, 엣지 케이스 및 통합에 있습니다. 이러한 시스템이 더 나은 모델 아키텍처와 더 큰 훈련 데이터 세트를 통해 계속 개선됨에 따라, 우리는 모든 콘텐츠 유형에 대해 완벽한 전사가 대규모로 제공되는 미래에 가까워지고 있습니다.

여기에서 설명된 기술 아키텍처는 2026년 현재의 최첨단을 나타내지만, 이 분야는 계속해서 빠르게 발전하고 있습니다. 실시간 전사, 제로샷 화자 식별 및 자동 콘텐츠 요약은 비디오 콘텐츠 처리 및 분석 접근 방식을 더욱 변화시킬 새로운 기능으로 이미 등장하고 있습니다.

관련 기사

video-translation-dubbing

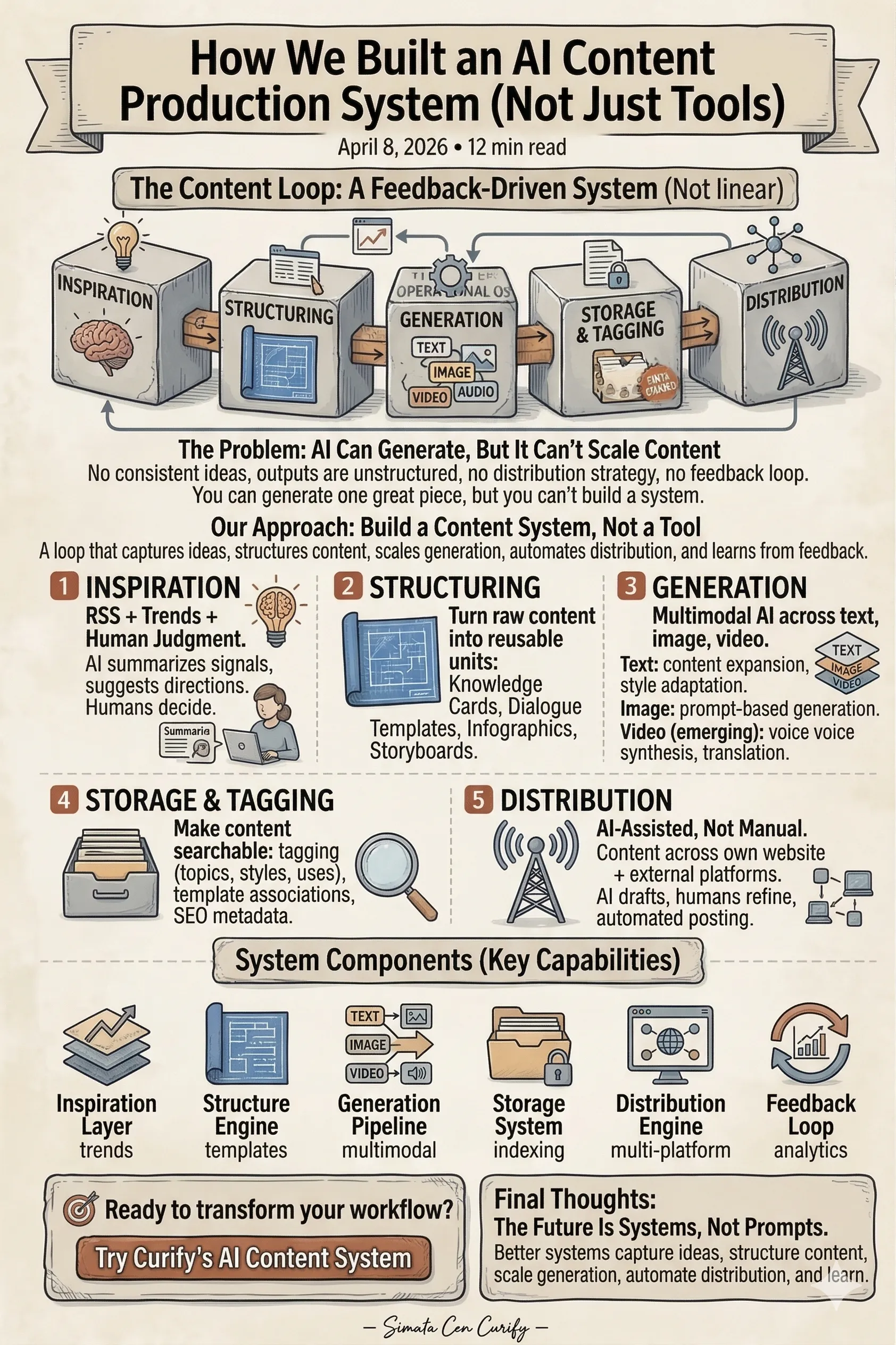

How We Built an AI Content Production System (Not Just Tools)

Inside Curify's Video Translation Pipeline: A Technical Deep-Dive