2026년에 YouTube 비디오를 영어로 번역하는 방법: 3가지 방법

스페인어, 일본어 또는 만다린으로 된 YouTube 비디오를 발견했는데 영어로 보고 싶으신가요? 아마도 필요한 튜토리얼이거나, 강의, 친구가 공유한 바이럴 클립, 또는 더 넓은 청중을 위해 게시하고 싶은 자신의 비디오일 수 있습니다. 2026년에는 세 가지 실제 옵션이 있으며, 적합한 방법은 시청, 학습 또는 게시 여부에 따라 다릅니다. 이 가이드는 자동 자막, 음성 클로닝을 통한 전체 더빙, 이중 자막의 세 가지 방법을 다루며, 실제로 중요한 거래를 설명합니다.

YouTube 비디오를 번역하는 3가지 방법

하나의 "YouTube 번역기"는 없으며, 하나의 문구 아래에 세 가지 다른 문제가 숨겨져 있습니다. (1) 당신은 자신의 언어로 비디오를 보고 싶습니다 — 자막으로 해결되며, 종종 가장 빠른 경로입니다. (2) 당신은 다른 언어로 게시 가능한 버전을 원합니다 — 음성 클로닝을 통한 전체 더빙으로 해결되며, 느리지만 더 공유 가능하게 됩니다. (3) 당신은 시청하면서 원어를 배우고 싶습니다 — 이중 자막으로 해결되며, 언어 학습의 최적 지점입니다.

이 가이드는 세 가지 방법을 모두 다룹니다. 각 방법은 캐주얼 사용을 위한 무료 또는 거의 무료 옵션과, 제작을 위해 원하는 품질을 처리하는 유료 옵션이 있습니다. "최고"가 아닌 사용 사례에 따라 선택하세요 — 각 방법은 서로 다른 문제를 해결합니다.

하나의 방법이 모든 것에 효과적이지 않은 이유

YouTube의 내장 자동 번역은 편리하지만 거칠게 작동합니다 — 일반적인 대화는 괜찮지만, 관용구, 속어, 억양, 기술 용어 및 맥락이 중요한 모든 곳에서 무너집니다. 5분짜리 클립에는 괜찮지만, 90분짜리 강의에서는 누적된 왜곡으로 인해 시청할 수 없게 됩니다.

더빙은 반대의 거래입니다: 제작은 느리지만 시청하기는 더 쉽습니다. 자막을 읽지 않는 청중(어린이, 노인, 다른 일을 하면서 시청하는 사람)에게 게시하는 경우, 더빙은 필수입니다.

이중 자막은 언어 학습자의 비밀 무기입니다 — 두 언어를 함께 쌓아 보여주어 원어를 들으면서 번역을 읽을 수 있습니다. 이는 실제로 *원어를 가르치는* 유일한 방법입니다.

아래의 세 가지 방법은 순위가 매겨져 있지 않습니다. 각 방법은 다른 두 방법보다 특정 문제를 더 잘 해결합니다.

세 가지 방법, 나란히

방법 1: 자동 자막 + 브라우저 번역 (무료, 가장 빠름)

최고의 사용처: 다른 언어로 단일 비디오를 빠르게 시청하는 것. 시간 투자: 30초.

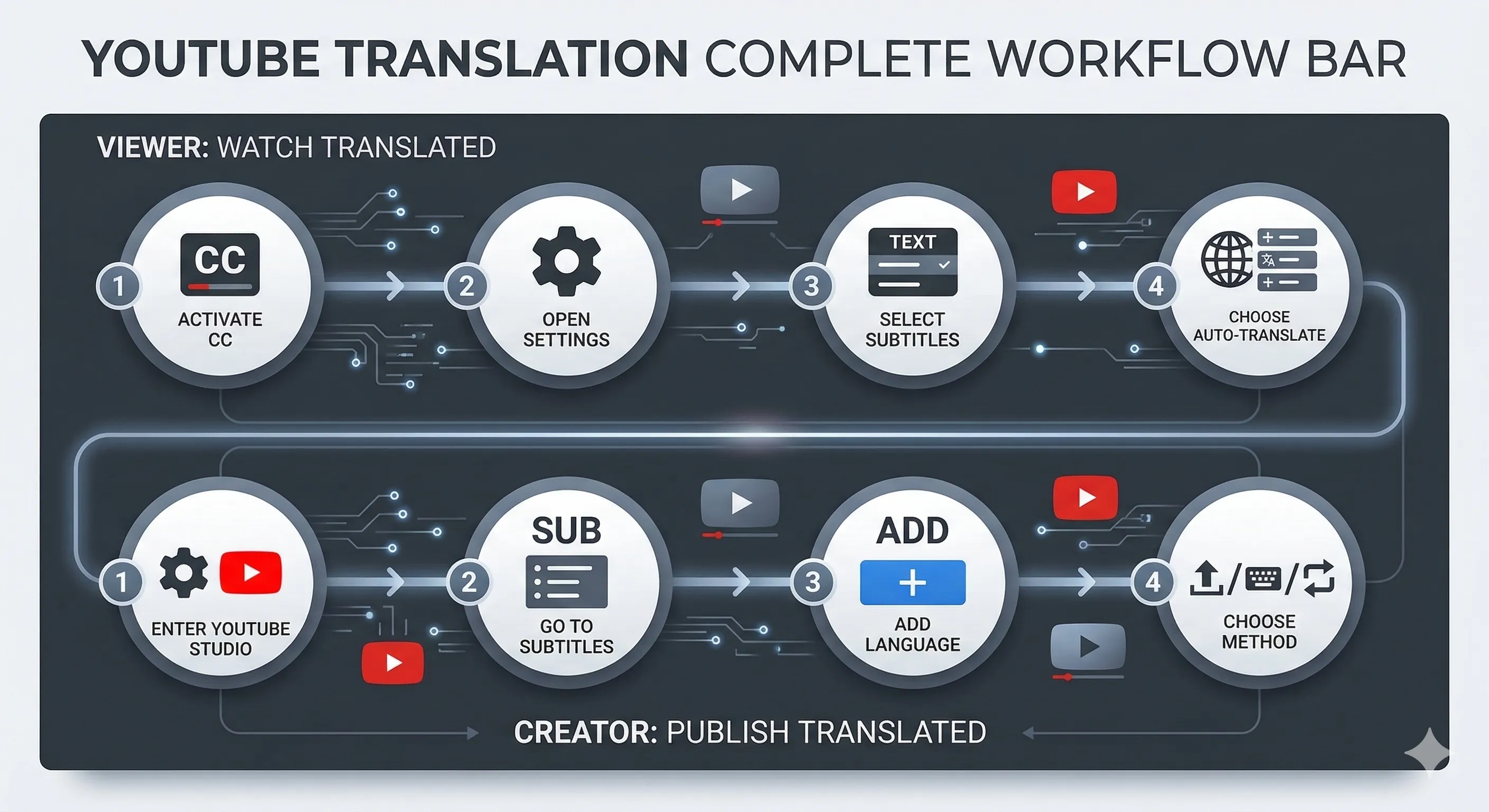

자막이 활성화된 모든 YouTube 비디오는 YouTube 자체에 의해 자동 번역될 수 있습니다. CC 버튼을 켜고, 설정 기어 → 자막 → 자동 번역 → 영어로 열어보세요. YouTube는 Google의 번역 백엔드를 사용하여 즉석에서 영어 번역을 생성합니다.

작동하는 것: 주요 언어 쌍(스페인어, 프랑스어, 독일어, 일본어, 한국어, 중국어)에서의 대화형 대화. 이 파이프라인은 무료이며 즉각적이며, 제작자가 자막을 비활성화하지 않은 모든 비디오에서 작동합니다.

문제가 되는 것: 기술 용어(프로그래밍 용어, 의료 용어, 틈새 취미), 강한 억양, 관용구, 빠른 말하기. 번역은 단어 수준이므로 문장 구조가 부서진 영어로 읽힐 수 있습니다. 그리고 제작자가 자막을 완전히 비활성화한 비디오에서는 이 방법이 전혀 적용되지 않습니다.

업그레이드 경로: YouTube의 자동 번역이 너무 많이 놓친 경우, 비디오 URL을 /tools/video-transcription에 붙여넣어 더 정제된 전사본을 얻으세요 — 느리지만 품질이 훨씬 높으며, 특히 기술 콘텐츠에서 그렇습니다.

방법 2: 음성 클로닝을 통한 전체 더빙 (유료, 공유 가능)

최고의 사용처: 자막을 읽지 않는 청중을 위해 다른 언어로 비디오를 재게시하는 것. 시간 투자: 비디오 1분당 5-15분의 처리 시간.

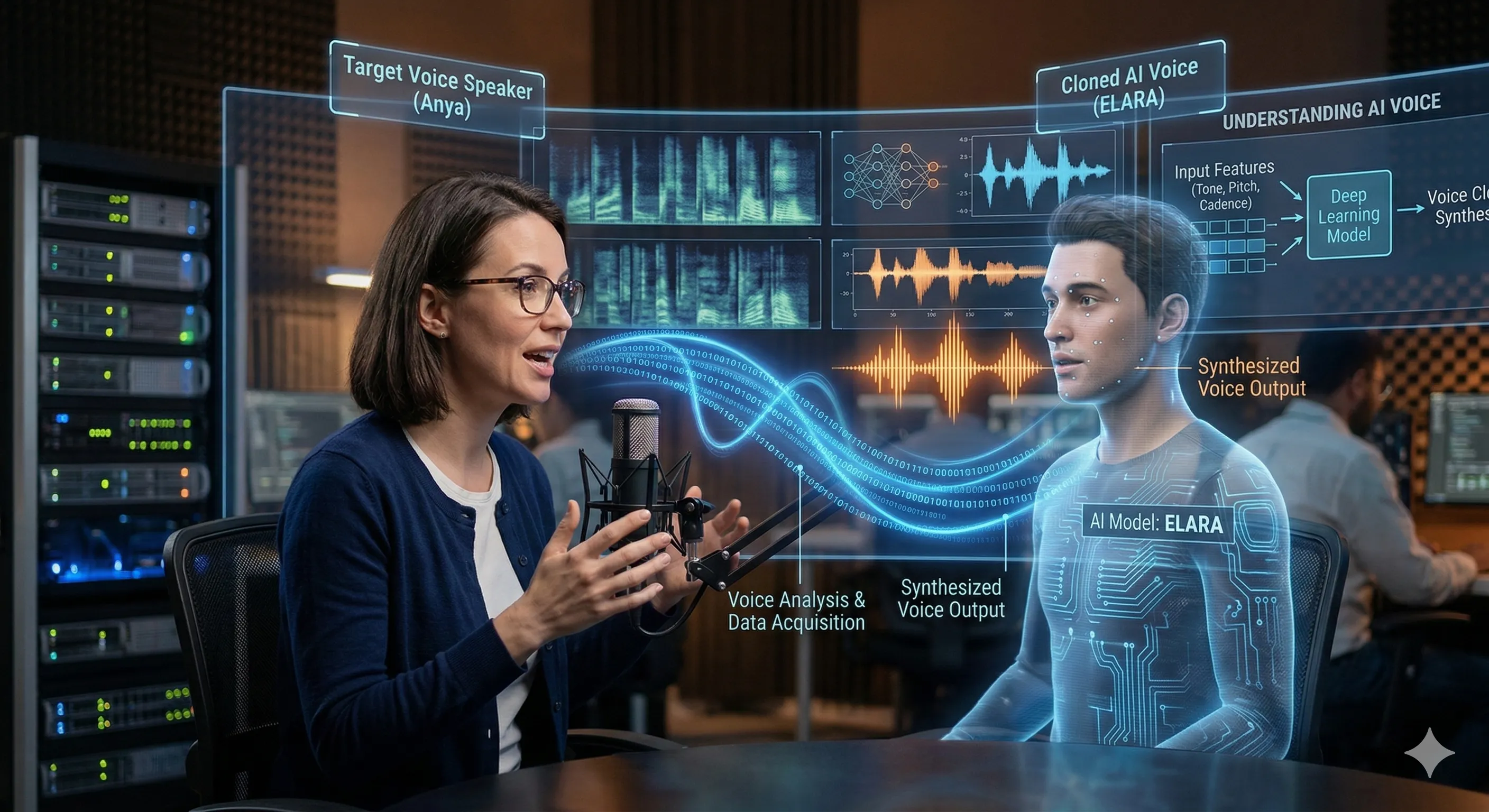

전체 더빙은 원래 오디오를 원래 화자의 목소리(클론)로 된 영어 트랙으로 교체한 후, 입술 동작을 정렬하여 더빙된 것처럼 보이지 않게 합니다. 결과는 화자가 실제로 영어 버전을 말했다고 들리는 시청 가능한 비디오입니다.

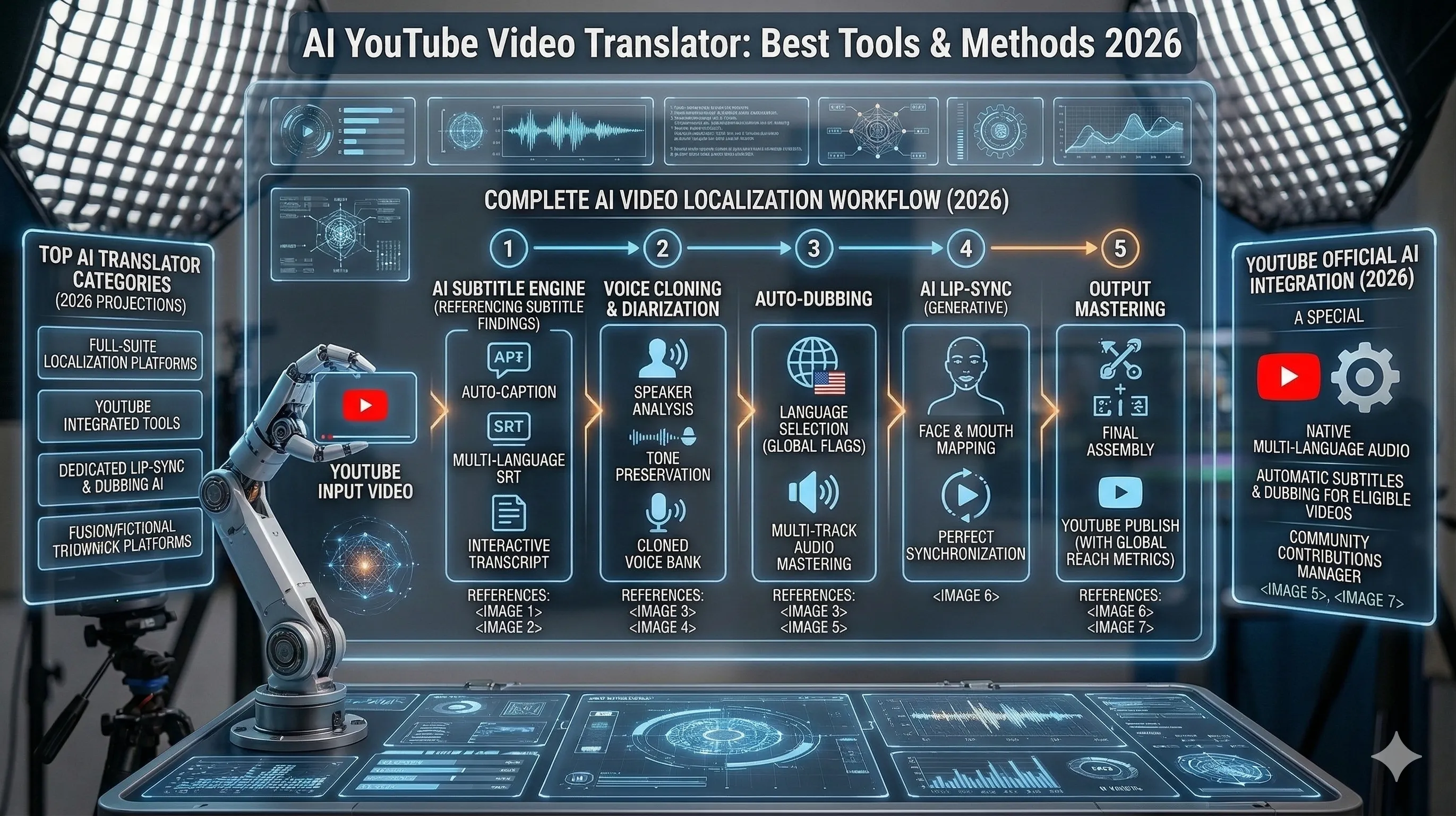

Curify의 작업 흐름은 /tools/video-dubbing에서: YouTube URL을 붙여넣거나 비디오를 업로드하고, 대상 언어를 선택하면 파이프라인이 다섯 단계를 실행합니다 — 배경 음악에서 음성을 분리하고, 오디오를 전사하고, 전사본을 번역하고, 화자의 목소리를 클론하고, 입술 동작을 재정렬합니다. 한 번의 업로드로 세 가지 아티팩트를 생성합니다: 더빙된 오디오, 입술 동작이 정렬된 새로운 비디오, 그리고 일치하는 자막 파일입니다.

작동하는 것: 정면에서 촬영된 대화형 콘텐츠 — 인터뷰, 강의 녹화, 제품 데모, 팟캐스트 비디오. 출력은 대화형 영상에 대해 게시 준비가 완료됩니다.

문제가 되는 것: 프로필 각도(입술 동기화 모델은 정면 화자를 기준으로 훈련됨), 두꺼운 수염이나 손으로 얼굴을 가리는 경우(모델이 입술 경계를 잃음), 긴 입술 정지. 화자가 카메라 밖에 있는 다큐멘터리 스타일의 B-roll의 경우, 해당 컷에서는 자막 전용 현지화로 돌아가야 합니다.

비용: 분당 요금. 10분짜리 대화형 비디오는 수동 더빙에 필요한 인간 시간과 비슷한 총 처리 시간을 소요하며, 비용은 아주 적습니다.

방법 3: 이중 자막 (무료 또는 유료, 학습에 최적)

최고의 사용처: 언어 학습자, ESL 교사, 자녀의 제2 언어 노출을 위해 비디오를 사용하는 부모. 시간 투자: 2-5분.

이중 자막은 두 언어를 함께 쌓아 보여줍니다 — 원어는 한 줄에, 영어 번역은 바로 아래에 있습니다. 원어를 들으면서 두 언어를 모두 읽을 수 있으며, 이는 실제로 언어 습득이 작동하는 방식입니다.

Curify의 작업 흐름은 /tools/bilingual-subtitles에서: YouTube URL을 붙여넣고, 원어와 대상 언어를 선택하면 도구가 두 언어가 동일한 타임스탬프에 정렬된 .srt 파일을 생성합니다. 비디오에 영구적으로 표시하거나, 전환 가능한 자막 트랙으로 첨부할 수 있습니다.

이 방법이 중요한 이유: 자막 전용 번역은 원어 오디오 신호를 완전히 제거합니다. 이중 자막은 이를 보존합니다. 시청하면서 언어를 배우는 것이 목표라면, 이는 실제로 그렇게 하는 유일한 방법입니다. 자녀에게 유산 언어를 가르치는 부모는 이를 특히 유용하게 여깁니다 — 아이는 원어 오디오를 듣고 두 가지 서면 형식을 나란히 볼 수 있습니다.

무료 대안: YouTube에서 원어 CC를 켜고, Language Reactor 또는 Subadub과 같은 브라우저 확장 프로그램을 사용하여 제2 언어 번역을 오버레이합니다. 생성된 .srt보다 덜 정확하지만 무료이며 다운로드 없이 브라우저에서 작동합니다.

세 가지 방법 중 선택하는 방법

방법 1(자동 자막)을 선택하세요. 지금 당장 단일 비디오를 보고 싶고, 다음 30초 안에 보고 싶으며, 일부 라인이 약간 틀릴 수 있는 것에 개의치 않는다면요.

방법 2(전체 더빙)을 선택하세요. 비디오를 청중을 위해 재게시하는 경우 — 자신의 YouTube 채널, 글로벌 팀을 위한 내부 교육 비디오, 판매하는 강의 등. 시청자가 자막을 읽지 않을 곳이라면요.

방법 3(이중 자막)을 선택하세요. 원어를 배우고 있거나, 가르치고 있거나, 언어 학습자를 위한 콘텐츠를 만들고 있다면요.

이 방법들을 조합할 수도 있습니다: 주요 대화형 세그먼트는 더빙(방법 2)하고, 교육 섹션에는 이중 자막(방법 3)을 사용하며, 화자가 카메라 밖에 있는 B-roll에서는 자동 번역(방법 1)을 사용하세요. Curify의 파이프라인은 한 번의 업로드로 세 가지 아티팩트를 생성하므로, 동일한 원본 비디오가 재업로드 없이 세 가지 청중에게 제공될 수 있습니다.

5단계: 게시 전에 품질 점검

어떤 방법을 선택하든, 게시하거나 공유하기 전에 다음 세 가지 점검을 수행하세요:

1. 무작위 타임스탬프 3개에서 번역을 점검하세요. 시작 부분 근처, 중간 부분, 끝 부분 근처에서 하나씩 선택하세요. 원본을 들으면서 번역을 읽어보세요. 세 곳 중 어느 곳에서라도 눈에 띄게 틀리면, 전체 전사본이 동일한 문제를 가질 가능성이 높습니다 — 다시 번역하거나 품질을 수용하세요.

2. 더빙된 오디오(Method 2 전용)를 들어보세요. 영어 문장이 원본보다 짧거나 길면, 입술 동기화가 어느 방향으로든 흐트러질 수 있습니다. 대부분의 파이프라인은 보완하기 위해 자동으로 패딩하거나 압축하지만, 그 결과가 급하게 들리거나 늘어질 수 있습니다. 눈에 띄면 다른 속도 전략으로 다시 렌더링하세요.

3. 프로필 샷에서 입술 동기화를 확인하세요(Method 2 전용). 이곳이 모델이 가장 자주 실패하는 곳입니다. 주요 감정적 순간이 측면에서 촬영되면, 그 라인에 대해 입술 동기화가 약간 틀리게 보일 것임을 수용하거나, 해당 라인에 대해 다른 각도로 전환하세요.

캐주얼 사용의 경우, 방법 1은 품질 점검이 필요 없습니다(좋거나 나쁘고, 10초 안에 알 수 있습니다). 방법 2와 3은 게시 전에 2분 정도의 스캔을 보상합니다.

도구 비교: 각 방법이 필요한 것

| 방법 | 도구 | 비용 | 시간 | 최적 사용처 |

|---|---|---|---|---|

| 자동 자막 | YouTube 내장 CC + 자동 번역 | 무료 | 30초 | 캐주얼 시청, 단일 비디오 |

| 자동 자막(개선) | Curify 비디오 전사 | 분당 요금 | 2-5분 | YouTube CC가 너무 많이 놓쳤을 때 |

| 전체 더빙 | Curify 비디오 더빙 | 분당 요금 | 5-15분/분 | 읽지 않는 시청자를 위한 재게시 |

| 전체 더빙(대안) | ElevenLabs Voice Studio | 구독 | 수동 설정 | 세밀한 음성 제어가 필요할 때 |

| 이중 자막 | Curify 이중 자막 | 분당 요금 | 2-5분 | 언어 학습, ESL 교육 |

| 이중 자막(무료) | Language Reactor + YouTube CC | 무료 | 브라우저 플러그인 | 시청하면서 배우기, 제작 없음 |

세 가지 Curify 도구는 하나의 파이프라인 백본을 공유합니다 — YouTube URL을 한 번 붙여넣고, 필요한 출력 형식을 선택하면 동일한 업로드로 자막 파일, 더빙된 오디오 또는 이중

.srt를 생성합니다. 각 형식에 대해 재인코딩 및 재업로드를 절약합니다.Curify가 세 가지 방법을 통합하는 방법

Curify의 /tools/video-dubbing 및 /tools/bilingual-subtitles는 공유 파이프라인에서 실행되므로, 단일 YouTube URL 업로드에서 세 가지 방법 출력을 모두 생성할 수 있습니다:

1. 전사본 (방법 1 업그레이드 경로) — 깨끗하고 시간 정렬된, 번역할 준비가 되거나 ChatGPT에 정제 작업을 맡길 수 있습니다.

2. 더빙된 비디오 (방법 2) — 클론된 목소리로 번역된 오디오, 입술 정렬, 동시에 생성된 일치하는 자막 파일.

3. 이중 자막 파일 (방법 3) — 원어 + 대상 언어가 동일한 타임스탬프에 정렬되어 비디오에 구워 넣거나 전환 가능한 트랙으로 첨부할 준비가 되어 있습니다.

도구는 입력을 공유하지만 서로 다른 출력을 생성하므로, 원본을 재업로드하지 않고도 아티팩트를 청중에 맞출 수 있습니다. 가격은 원본 비디오의 분당 요금이며, 구독이나 월 최소 요금이 없습니다.

각 파이프라인 단계가 어떻게 작동하는지 엔지니어의 관점을 원하신다면 — 오디오 소스 분리, 신경 번역, 음성 클로닝, 입술 동기화 정렬 — /blog/video-transcription-technical-deep-dive에서 제작 등급 아키텍처 분석을 확인하세요. 이 가이드는 동일한 파이프라인에 대한 사용자 관점입니다.

방법을 선택하고 파이프라인을 건너뛰세요

"YouTube 비디오를 영어로 번역하는 방법"은 하나의 질문이 아니라 세 가지 질문입니다. 방법 1 (자동 자막)은 캐주얼 시청을 처리합니다. 방법 2 (전체 더빙)은 게시를 처리합니다. 방법 3 (이중 자막)은 학습을 처리합니다. 2024년 이후 모든 세 가지 도구의 품질이 극적으로 향상되었습니다 — 예전에는 다섯 개의 개별 스크립트와 GPU가 필요했지만, 이제는 2026년에 단일 URL 붙여넣기로 가능합니다.

진지하게 받아들여야 할 경고 하나: 모든 AI 번역 파이프라인에는 엣지 케이스가 있습니다. 강한 억양, 기술 용어, 빠른 말하기, 프로필 각도 입술 동기화 — 이는 이론적인 것이 아니라 실제 실패 모드입니다. 게시하기 전에 출력을 점검하세요. 2분 검토는 훌륭한 번역 비디오와 처음 30초에 시청자를 잃는 비디오의 차이를 만듭니다.

Take the next step

Putting what you read into practice.