2026年に動画を自然にダビングする方法:AI音声クローンのアーティファクトを修正する

AIツールを使って一般的なダビングの課題を解決するための包括的なガイド。ロボットのペース、感情の欠如、リップシンクの問題に焦点を当てます。

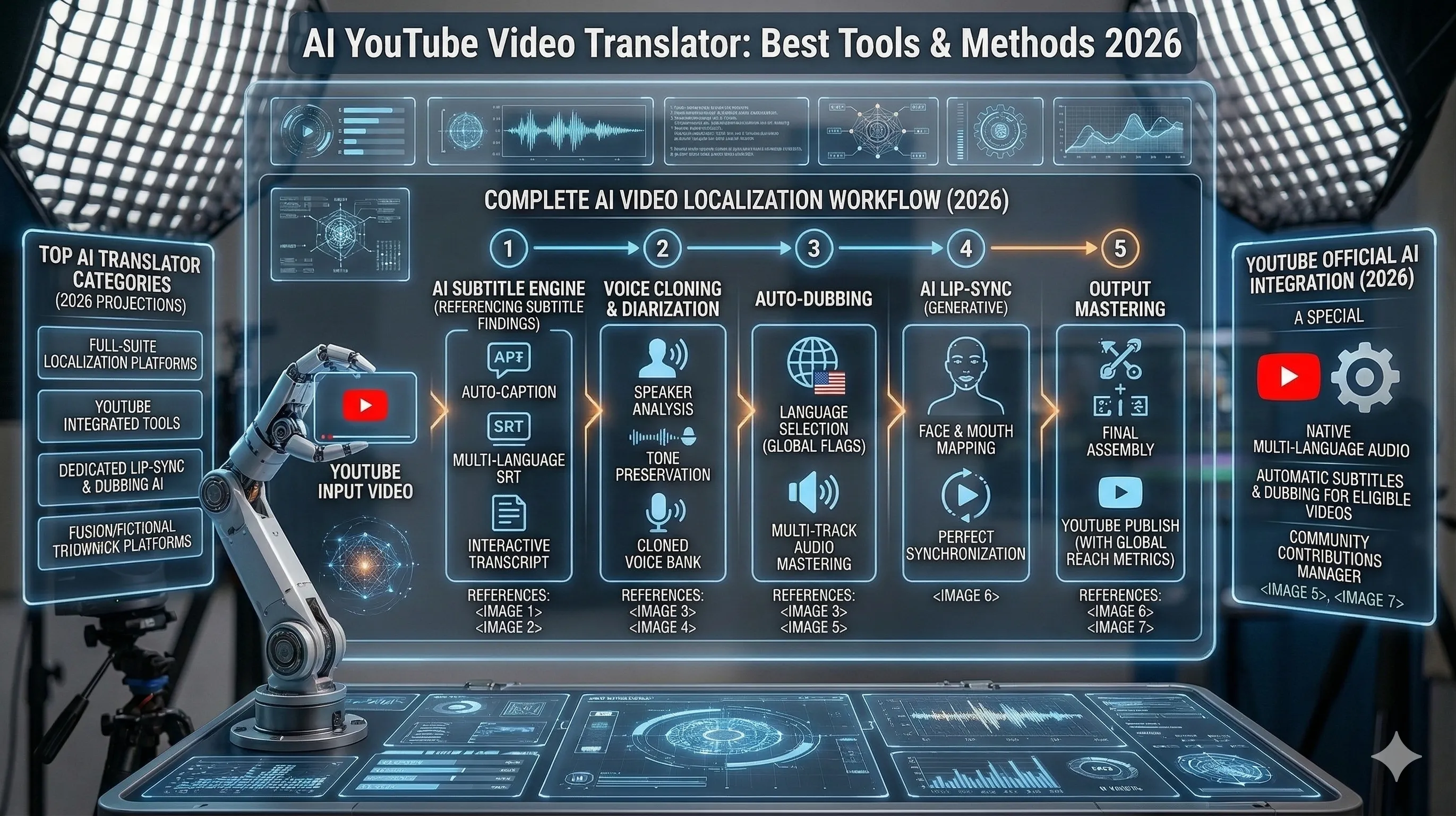

AI動画ダビングはコンテンツ制作を革命的に変えましたが、ロボットのアーティファクトや不自然なペースは依然として多くの制作を悩ませています。2026年には、これらの課題を克服するためのより良いツールと技術があります。核心の問題は、ほとんどのダビングパイプラインがスピーチを単なる技術的なレイヤーとして扱うのではなく、パフォーマンスとして扱うことにあります。多くのシステムは、フラットなプロソディ、一貫性のない強調、タイミングの悪いポーズでオーディオを生成し、声自体がリアルに聞こえても没入感を壊します。視聴者はタイミングの不一致に非常に敏感です—感情的なビート、マイクロポーズ、または文の強調が視覚的なパフォーマンスと一致しないと、結果は微妙に「ずれて」感じられます。現代のアプローチは、プロソディ制御と時間的整合性に焦点を当ててこれに対処します。スピーチを線形に生成するのではなく、新しいモデルはリズムを意識した合成を取り入れ、クリエイターがフレーズや音節レベルでペースを制御できるようにします。これにより、リップムーブメントを一致させ、ドラマティックなポーズを保持し、元の俳優の意図を言語を超えて維持することが可能になります。強制アライメント、音素レベルのタイミング、リファレンスオーディオの条件付けなどの技術は、現在高品質のパイプラインで標準になりつつあります。もう一つの大きな改善は、コンテキストを考慮した音声モデリングから来ています。各行を孤立して生成するのではなく、高度なシステムは会話の記憶を維持し、シーンを通じてトーン、感情状態、スピーカーのダイナミクスを追跡します。これによりトーンの漂流が減少し、キャラクターがささやいているとき、議論しているとき、または説明を行っているときに一貫して聞こえることが保証されます。物語重視のコンテンツにとって、このシフトだけで知覚されるリアリズムが大幅に向上します。最後に、人間が関与するワークフローの台頭により、自動化と品質のギャップが埋まりました。クリエイターは、AI生成と軽量編集レイヤーを組み合わせて、ポーズを微調整したり、強調を調整したり、特定のセグメントを再生成したりして、全体のクリップを再生成するのではなく、効率と創造的な制御のバランスを取ることができるようになりました。このハイブリッドアプローチにより、制作チームはダビングをスケールしながら、スタジオレベルの結果を達成できます。これらの進歩により、AIダビングは便利なツールから制作グレードのソリューションへと移行し、スピードやスケーラビリティを犠牲にすることなく、自然で感情的に共鳴するパフォーマンスを言語を超えて提供できるようになります。

このガイドでは、最先端のAIツールであるMuseTalk、Emotion TTS、および高度なポストプロセッシング技術を使用して一般的なダビングの問題を修正する方法を示します。基本的な音声生成を超えて、AIダビングワークフローの最も持続的な失敗ポイント—リップシンクのずれ、単調な配信、タイミングの不一致、感情の平坦さに対処します。MuseTalkを使用して視覚と音声の正確な整合性を確保し、生成されたスピーチトラックが口の動きや表情に密接に一致するようにする方法を学びます。オーディオの側では、Emotion TTSシステムを活用して生成された声に制御された表現力を注入する方法を解説します。一般的なプリセットに依存するのではなく、ガイドでは、緊張、皮肉、または単一の行内の微妙な感情の変化を反映するためにピッチの輪郭、ペース、強調を調整する方法を説明します。これにより、「技術的に正しい」オーディオから、人間的で文脈に根ざしたパフォーマンスに移行できます。また、最終出力品質に重要な違いをもたらす高度なポストプロセッシングワークフローについても説明します。これには、音素レベルのタイミング調整、サイレンストリミングと拡張、呼吸とポーズの挿入、EQマッチングやラウドネス正規化などのオーディオマスタリング技術が含まれ、ダビングされた声を元のサウンドトラックにシームレスにブレンドします。これらのツールと技術を統合されたパイプラインに組み合わせることで、試行錯誤に頼るのではなく、ダビングの問題を体系的に診断し修正できるようになり、一貫性のないAI出力を洗練された制作準備が整った対話に変えることができます。

Pro Tip

一般的なAIダビングの問題

🤖 ロボットのペース

AI生成のスピーチは自然なリズムとタイミングが欠けており、機械的で切り離された印象を与えます。

視聴者の関与の低下

不自然なペースは没入感を壊し、視聴者の保持率を最大40%低下させます。

😐 感情のニュアンスの欠如

AIの声は微妙な感情を伝えるのが難しく、ドラマティックなシーンが平坦に感じられます。

感情的な切断

感情的なキューが欠けているため、視聴者はキャラクターやストーリーとつながることができません。

👄 リップシンクの不一致

オーディオと視覚の口の動きの間の不適切な整合性が不気味な谷効果を生み出します。

非現実的な外観

目に見えるリップシンクのエラーは、自然なスピーチの幻想を即座に壊します。

AIで動画ダビングを変革する

これらの高度な技術とツールを組み合わせることで、観客を魅了する自然で感情的に引き込まれるダビングコンテンツを作成できます。AIダビングの未来はここにあり、これまで以上に人間らしいものです。