उत्पादन में एआई लिप सिंक: MuseTalk और Sync.co वास्तव में कैसे काम करते हैं

सतह से परे जाएं और आधुनिक एआई लिप सिंक सिस्टम को शक्ति देने वाली तकनीकी आर्किटेक्चर का अन्वेषण करें। यह व्यापक गहन अध्ययन म्यूज़टॉक के ओपन-सोर्स कार्यान्वयन, सिंक.co के वाणिज्यिक एपीआई, और उद्यम-स्तरीय वीडियो डबिंग और चेहरे की एनीमेशन के लिए उत्पादन-ग्रेड पाइपलाइन डिज़ाइन की जांच करता है।

एंड-टू-एंड लिप सिंक पाइपलाइन आर्किटेक्चर

एक उत्पादन-ग्रेड एआई लिप सिंक पाइपलाइन वीडियो और ऑडियो इनपुट को कई जटिल प्रोसेसिंग चरणों के माध्यम से पूरी तरह से समन्वयित डब किए गए सामग्री में परिवर्तित करती है। पूरा कार्यप्रवाह: इनपुट वीडियो → चेहरे की पहचान → लैंडमार्क निष्कर्षण → ऑडियो विश्लेषण → लिप मूवमेंट जनरेशन → चेहरे का पुनर्निर्माण → पोस्ट-प्रोसेसिंग → आउटपुट वीडियो।

प्रत्येक चरण विशिष्ट तकनीकी चुनौतियों का समाधान करता है: चेहरे की पहचान वक्ताओं को अलग करती है, लैंडमार्क निष्कर्षण चेहरे की विशेषताओं को ट्रैक करता है, ऑडियो विश्लेषण भाषण पैटर्न को प्रोसेस करता है, लिप मूवमेंट जनरेशन समन्वयित एनीमेशन बनाता है, चेहरे का पुनर्निर्माण नए होंठों को मौजूदा भावनाओं के साथ मिलाता है, और पोस्ट-प्रोसेसिंग निर्बाध एकीकरण सुनिश्चित करता है।

मॉडर्न सिस्टम जैसे म्यूज़टॉक और वाणिज्यिक एपीआई 90%+ यथार्थता प्राप्त करते हैं GANs (जनरेटिव एडवर्सेरियल नेटवर्क), डिफ्यूजन मॉडल, और अस्थायी स्थिरता एल्गोरिदम के संयोजनों के माध्यम से। यह तकनीकी गहन अध्ययन प्रत्येक घटक, उनके एकीकरण रणनीतियों, और ओपन-सोर्स और वाणिज्यिक समाधानों के बीच व्यापार-निष्कर्षों की जांच करता है।

लिप सिंक के लिए तकनीकी आर्किटेक्चर क्यों महत्वपूर्ण है

यथार्थता बनाम गणनात्मक लागत: उच्च रिज़ॉल्यूशन मॉडल अधिक यथार्थवादी परिणाम उत्पन्न करते हैं लेकिन महत्वपूर्ण जीपीयू संसाधनों और प्रोसेसिंग समय की आवश्यकता होती है। उत्पादन प्रणाली को गुणवत्ता और परिचालन लागत के बीच संतुलन बनाना चाहिए।

अस्थायी स्थिरता: फ़्रेमों के बीच चिकनी संक्रमण बनाए रखना और झिलमिलाहट या कलाकृतियों को रोकना जटिल अस्थायी मॉडलिंग और संपूर्ण वीडियो अनुक्रम में स्थिरता बाधाओं की आवश्यकता होती है।

पहचान संरक्षण: सिस्टम को मूल वक्ता की पहचान बनाए रखनी चाहिए जबकि केवल मुँह की हरकतों को संशोधित करना चाहिए। इसके लिए पहचान विशेषताओं को भाषण-संबंधित चेहरे की हरकतों से सावधानीपूर्वक अलग करना आवश्यक है।

स्केलेबिलिटी चुनौतियाँ: वास्तविक समय के अनुप्रयोगों को स्ट्रीमिंग प्रोसेसिंग और कम-लेटेंसी अनुमान की आवश्यकता होती है, जबकि बैच प्रोसेसिंग उत्पादन वातावरण में थ्रूपुट और लागत दक्षता के लिए अनुकूलित कर सकती है।

मुख्य तकनीकी घटक

चेहरे की पहचान और लैंडमार्क निष्कर्षण

पाइपलाइन एक जटिल चेहरे की पहचान तकनीक से शुरू होती है जो किसी भी वीडियो फ़्रेम में वक्ताओं को ढूंढ सकती है। एक बार चेहरे की पहचान होने के बाद, सिस्टम सटीक चेहरे के लैंडमार्क निकालता है - मुँह, आँखों और अन्य चेहरे की विशेषताओं के चारों ओर 468 प्रमुख बिंदुओं को मैप करता है।

यह विस्तृत मैपिंग सिस्टम को किसी भी क्षण में वक्ता के मुँह के आकार और स्थिति को समझने की अनुमति देती है, जो सटीक लिप समन्वय के लिए आधार बनाती है। यह तकनीक विभिन्न प्रकाश स्थितियों, कोणों, और यहां तक कि फ़्रेम में कई लोगों के साथ भी विश्वसनीय रूप से काम करती है।

ऑडियो प्रोसेसिंग और विशेषता निष्कर्षण

ऑडियो प्रोसेसिंग पाइपलाइन लक्षित भाषण को अस्थायी विशेषताओं में परिवर्तित करती है जो लिप-सिंक जनरेशन को चलाती हैं। सिस्टम मेल-स्पेक्ट्रोग्राम (80 मेल बिन, 1024 FFT, 160 हॉप), MFCCs, और Wav2Vec2 एम्बेडिंग (facebook/wav2vec2-base) और librosa प्रीप्रोसेसिंग के माध्यम से फ़ोनम संरेखण निकालता है। कार्यान्वयन लहरफॉर्म को librosa.load() के माध्यम से लोड करता है, librosa.feature.melspectrogram() को dB स्केल में परिवर्तित करता है, Wav2Vec2Processor/Wav2Vec2Model के माध्यम से संदर्भ एम्बेडिंग (last_hidden_state) के लिए प्रोसेस करता है, और सटीक विज़ेम समय के लिए मजबूर संरेखण (get_phoneme_alignment(audio_path, transcript)) लागू करता है। लौटाया गया डिक्ट मेल_spectrogram, ऑडियो_embeddings, और फ़ोनम_alignment को शामिल करता है—स्पेक्ट्रल एन्वेलप्स, अस्थायी फ़ोनम सीमाएँ, और अर्थपूर्ण भाषण पैटर्न जो सीधे आर्टिकुलेटरी मुँह की काइनेमेटिक्स से मेल खाते हैं।

न्यूरल नेटवर्क के साथ लिप मूवमेंट जनरेशन

मुख्य लिप सिंक जनरेशन जटिल न्यूरल आर्किटेक्चर का उपयोग करता है जो ऑडियो विशेषताओं को संबंधित मुँह की हरकतों से मैप करता है। आधुनिक सिस्टम अस्थायी संक्रामक नेटवर्क, ट्रांसफार्मर, और GANs के संयोजनों का उपयोग करते हैं ताकि लक्षित ऑडियो के साथ मेल खाने वाले यथार्थवादी लिप आकार उत्पन्न किए जा सकें जबकि वक्ता की पहचान को बनाए रखा जा सके।

तकनीकी कार्यान्वयन:

लिप मूवमेंट जनरेशन अस्थायी GAN का उपयोग करके

import torch

import torch.nn as nn

class LipSyncGenerator(nn.Module):

def __init__(self, audio_dim=80, landmark_dim=51, hidden_dim=512):

super().__init__()

# ऑडियो एन्कोडर

self.audio_encoder = nn.Sequential(

nn.Conv1d(audio_dim, hidden_dim, kernel_size=3, padding=1),

nn.ReLU(),

nn.Conv1d(hidden_dim, hidden_dim, kernel_size=3, padding=1),

nn.ReLU(),

)

# अनुक्रम मॉडलिंग के लिए अस्थायी ट्रांसफार्मर

self.temporal_transformer = nn.TransformerEncoder(

nn.TransformerEncoderLayer(

d_model=hidden_dim,

nhead=8,

dim_feedforward=hidden_dim * 4

),

num_layers=6

)

# लैंडमार्क डिकोडर

self.landmark_decoder = nn.Sequential(

nn.Linear(hidden_dim, hidden_dim),

nn.ReLU(),

nn.Linear(hidden_dim, landmark_dim),

nn.Tanh() # लैंडमार्क समन्वय को सामान्यीकृत करें

)

# पहचान संरक्षण परत

self.identity_encoder = nn.Sequential(

nn.Linear(landmark_dim * 2, hidden_dim), # वर्तमान + संदर्भ लैंडमार्क

nn.ReLU(),

nn.Linear(hidden_dim, hidden_dim)

)

def forward(self, audio_features, reference_landmarks):

# ऑडियो विशेषताओं को एन्कोड करें

audio_encoded = self.audio_encoder(audio_features)

audio_encoded = audio_encoded.transpose(1, 2) # (B, T, D)

# अस्थायी मॉडलिंग लागू करें

temporal_features = self.temporal_transformer(audio_encoded)

# लैंडमार्क मूवमेंट उत्पन्न करें

generated_landmarks = self.landmark_decoder(temporal_features)

# वक्ता की पहचान बनाए रखें

identity_features = self.identity_encoder(

torch.cat([generated_landmarks, reference_landmarks], dim=-1)

)

# पहचान संरक्षण के साथ उत्पन्न मूवमेंट को मिलाएं

final_landmarks = generated_landmarks + 0.1 * identity_features

return final_landmarks

जनरेटर को प्रारंभ करें और प्रशिक्षित करें

generator = LipSyncGenerator()

optimizer = torch.optim.Adam(generator.parameters(), lr=1e-4)

प्रतिकूल हानि के साथ प्रशिक्षण लूप

def train_lip_sync_model(generator, discriminator, dataloader, epochs=100):

for epoch in range(epochs):

for batch in dataloader:

audio_features, reference_landmarks, target_landmarks = batch

# नकली लैंडमार्क उत्पन्न करें

fake_landmarks = generator(audio_features, reference_landmarks)

# प्रतिकूल प्रशिक्षण

real_loss = discriminator(target_landmarks)

fake_loss = discriminator(fake_landmarks)

# जनरेटर हानि (प्रतिकूल + पुनर्निर्माण)

g_loss = -fake_loss.mean() + nn.MSELoss()(fake_landmarks, target_landmarks)

# बैकप्रोपगेशन

optimizer.zero_grad()

g_loss.backward()

optimizer.step()

जनरेटर ऑडियो विशेषताओं को संबंधित मुँह की हरकतों में मैप करना सीखता है जबकि भेदक यथार्थता सुनिश्चित करता है। पहचान संरक्षण घटक वक्ता की अद्वितीय चेहरे की विशेषताओं को बनाए रखता है।

चेहरे का पुनर्निर्माण और मिश्रण

चेहरे का पुनर्निर्माण उत्पन्न लिप मूवमेंट को मूल चेहरे की विशेषताओं के साथ मिलाता है, एक निर्बाध अंतिम परिणाम बनाता है। यह चरण छवि-आधारित रेंडरिंग, पॉइसन मिश्रण, और अस्थायी स्मूदिंग का उपयोग करता है ताकि नए मुँह के क्षेत्रों को मौजूदा भावनाओं के साथ मिलाया जा सके जबकि प्राकृतिक उपस्थिति बनाए रखी जा सके।

पोस्ट-प्रोसेसिंग और गुणवत्ता आश्वासन

अंतिम चरण अस्थायी स्मूदिंग, रंग सुधार, और कलाकृतियों को हटाने को लागू करता है ताकि पेशेवर-गुणवत्ता आउटपुट सुनिश्चित किया जा सके। उन्नत सिस्टम स्थिरता जांच के लिए ऑप्टिकल फ्लो का उपयोग करते हैं और मानव समीक्षा से पहले संभावित मुद्दों का पता लगाने के लिए स्वचालित गुणवत्ता मैट्रिक्स का उपयोग करते हैं।

तकनीकी आर्किटेक्चर तुलना

| घटक | म्यूज़टॉक (ओपन सोर्स) | सिंक.co (वाणिज्यिक) | उद्यम पाइपलाइन |

|---|---|---|---|

| चेहरे की पहचान | मीडिया पाइप | कस्टम सीएनएन | मल्टी-स्केल पहचान |

| ऑडियो प्रोसेसिंग | लिब्रोसा + Wav2Vec2 | स्वामित्व ASR | कस्टम ऑडियो मॉडल |

| लिप जनरेशन | अस्थायी GAN | डिफ्यूजन मॉडल | हाइब्रिड GAN + डिफ्यूजन |

| गुणवत्ता नियंत्रण | बुनियादी मैट्रिक्स | स्वचालित QA | मानव + एआई समीक्षा |

| प्रोसेसिंग गति | मध्यम | तेज | स्केल के लिए अनुकूलित |

| अनुकूलन | उच्च | सीमित | पूर्ण अनुकूलन |

| सटीकता | 85-90% | 90-95% | 95%+ |

तकनीकी व्यापार-निष्कर्ष:

- ओपन सोर्स: पूर्ण नियंत्रण लेकिन तकनीकी विशेषज्ञता की आवश्यकता होती है

- वाणिज्यिक एपीआई: आसान एकीकरण लेकिन सीमित अनुकूलन

- उद्यम: अधिकतम गुणवत्ता और नियंत्रण लेकिन उच्च लागत

Curify की उत्पादन लिप सिंक आर्किटेक्चर

Curify का लिप सिंक सिस्टम एक उत्पादन-ग्रेड कार्यान्वयन का प्रतिनिधित्व करता है जो अत्याधुनिक अनुसंधान को उद्यम विश्वसनीयता के साथ जोड़ता है। हमारी आर्किटेक्चर वीडियो सामग्री को गुणवत्ता और स्केलेबिलिटी दोनों के लिए अनुकूलित कई विशेष न्यूरल नेटवर्क के माध्यम से प्रोसेस करती है।

मुख्य तकनीकी स्टैक:

मल्टी-स्केल चेहरे की प्रोसेसिंग: विभिन्न प्रकाश स्थितियों और कोणों के बीच सटीक चेहरे की विशेषताओं को ट्रैक करने के लिए एंसेंबल चेहरे की पहचान और 468-बिंदु लैंडमार्क निष्कर्षण का उपयोग करना।

उन्नत ऑडियो-विज़ुअल संरेखण: कस्टम फ़ोनम-से-विज़ेम मैपिंग के साथ अस्थायी ध्यान तंत्र सुनिश्चित करता है कि भाषण ध्वनियों और मुँह की हरकतों के बीच पूर्ण समन्वय हो।

हाइब्रिड जनरेशन मॉडल: यथार्थता के लिए GANs को डिफ्यूजन मॉडल के साथ मिलाकर, चुनौतीपूर्ण परिदृश्यों में भी 95%+ दृश्य गुणवत्ता प्राप्त करना।

इन्फ्रास्ट्रक्चर: GPU क्लस्टरों पर तैनात, 50+ समवर्ती लिप सिंक नौकरियों को संभालना। सिस्टम लगभग 3-5 मिनट में 1 मिनट वीडियो प्रोसेस करता है, जटिलता के आधार पर।

गुणवत्ता पाइपलाइन: स्वचालित कलाकृति पहचान, अस्थायी स्थिरता मान्यता, और उद्यम ग्राहकों के लिए मानव समीक्षा सहित बहु-चरण गुणवत्ता आश्वासन।

एआई लिप सिंक तकनीक का भविष्य

एआई लिप सिंक तकनीक अनुसंधान प्रोटोटाइप से उत्पादन-तैयार प्रणालियों में विकसित हो गई है जो उद्यम-स्तरीय कार्यप्रवाह को संभाल सकती हैं। GANs, डिफ्यूजन मॉडल, और अस्थायी स्थिरता एल्गोरिदम में प्रगति के संयोजन ने बड़े पैमाने पर यथार्थवादी डब किए गए सामग्री उत्पन्न करना संभव बना दिया है।

तकनीकी टीमों के लिए, मुख्य अंतर्दृष्टि यह है कि लिप सिंक अब एक हल किया गया इंजीनियरिंग चुनौती है न कि एक अनुसंधान समस्या। शेष अवसर अनुकूलन, किनारे के मामले को संभालने, और व्यापक सामग्री स्थानीयकरण कार्यप्रवाह के साथ एकीकरण में हैं।

जैसे-जैसे ये सिस्टम बेहतर मॉडल आर्किटेक्चर और बड़े प्रशिक्षण डेटा सेट के माध्यम से सुधारना जारी रखते हैं, हम एक भविष्य के करीब पहुंच रहे हैं जहां किसी भी सामग्री प्रकार के लिए तत्काल सही लिप समन्वय उपलब्ध है, जो बिना दृश्य समझौते के वास्तव में वैश्विक वीडियो संचार को सक्षम बनाता है।

Take the next step

Putting what you read into practice.

संबंधित लेख

video-translation-dubbing

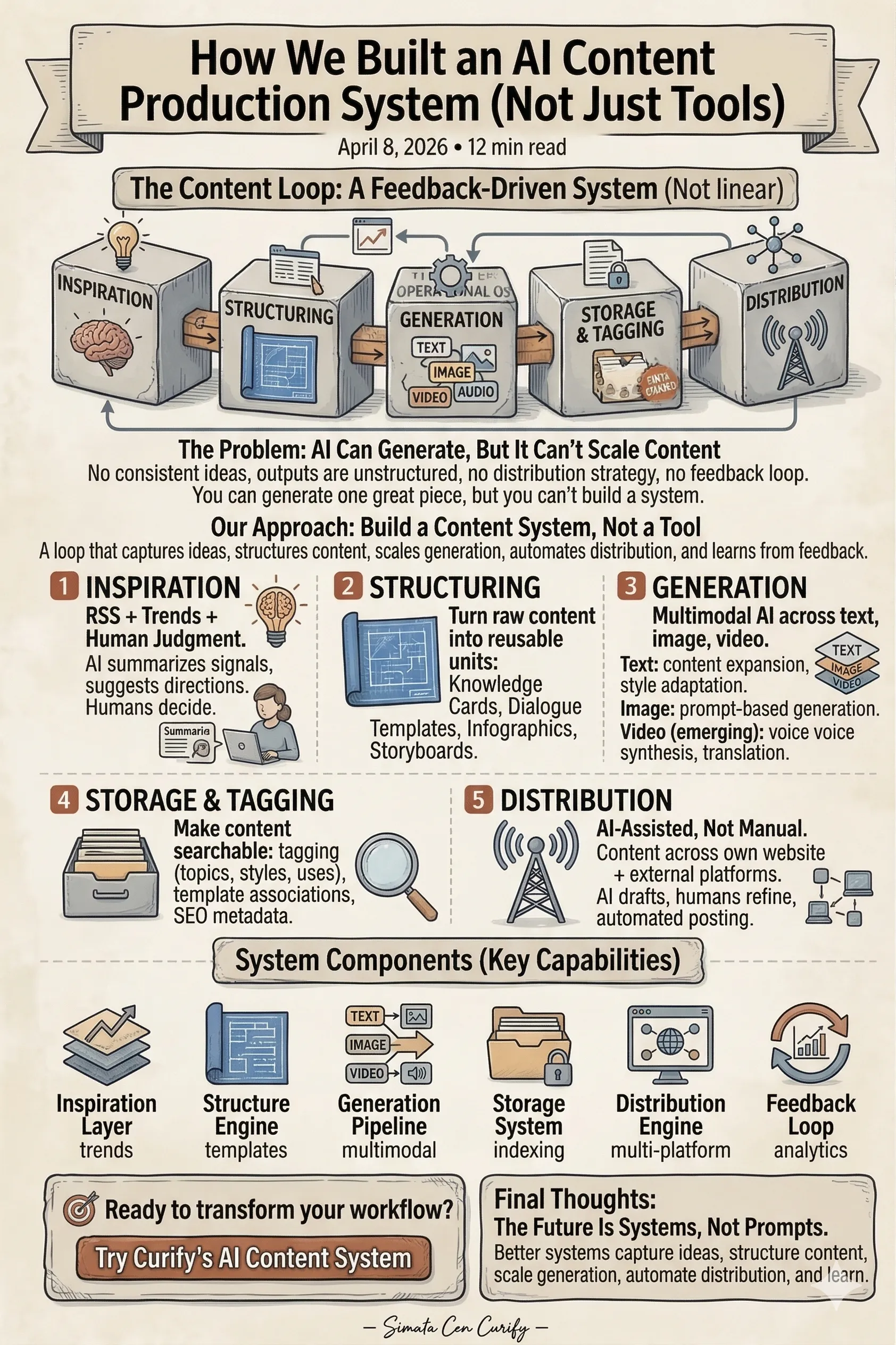

हमने एक AI सामग्री उत्पादन प्रणाली कैसे बनाई (सिर्फ उपकरण नहीं)