डीप डाइव: ट्रांसक्रिप्शन तकनीकी अवलोकन

अधिकांश ट्रांसक्रिप्शन उपकरण भाषण-से-टेक्स्ट पर रुक जाते हैं। यह गहन अध्ययन Curify की पूरी ट्रांसक्रिप्शन पाइपलाइन को दर्शाता है: ऑडियो को पृष्ठभूमि संगीत से कैसे अलग किया जाता है, WhisperX कैसे साफ ट्रैक पर चलता है, वक्ता डायरीकरण कैसे ओवरलैपिंग आवाजों को विभाजित करता है, और कैसे फोर्स्ड अलाइनमेंट शब्द-स्तरीय टाइमस्टैम्प को ट्रांसक्रिप्ट पर वापस रखता है ताकि आउटपुट [/tools/video-transcript-generator](/tools/video-transcript-generator) पर डाउनस्ट्रीम उपशीर्षक, डबिंग, और अनुवाद उपकरण चला सके। यदि आप ट्रांसक्रिप्शन को एक बड़े पाइपलाइन में एकीकृत करना चाहते हैं न कि केवल एक SRT डाउनलोड करना, तो यह वह परत है जिसे अधिकांश ब्लॉग पोस्ट छोड़ देते हैं।

एंड-टू-एंड वीडियो ट्रांसक्रिप्शन पाइपलाइन

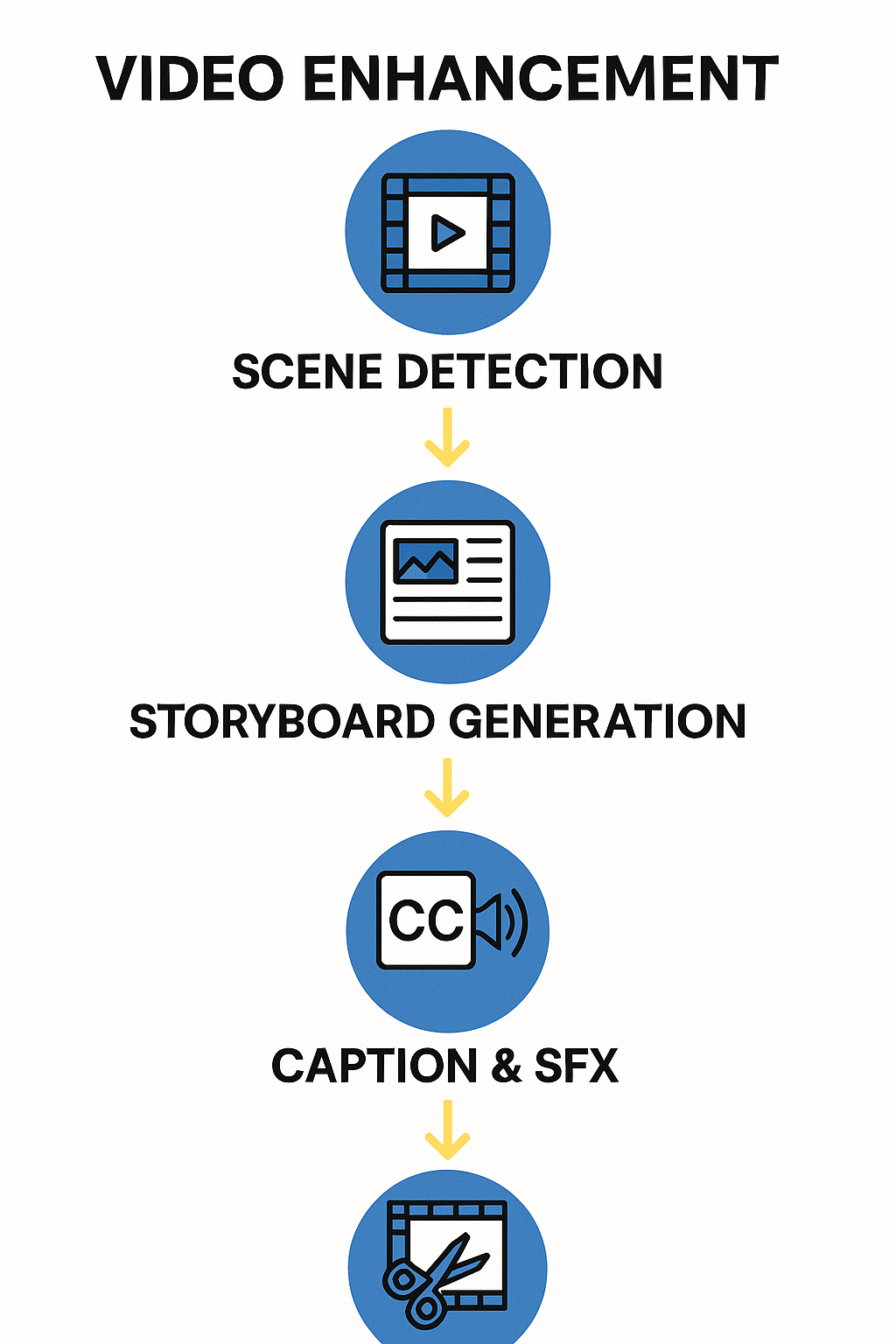

एक उत्पादन-ग्रेड वीडियो ट्रांसक्रिप्शन पाइपलाइन कच्चे वीडियो कंटेंट को कई जटिल प्रोसेसिंग चरणों के माध्यम से संरचित, समय-संक्रामक टेक्स्ट में बदलती है। संपूर्ण वर्कफ़्लो: वीडियो → ऑडियो निष्कर्षण → विभाजन → ASR (स्वचालित भाषण पहचान) → संरेखण → वक्ता डायरीकरण → पोस्ट-प्रोसेसिंग।

प्रत्येक चरण विशिष्ट तकनीकी चुनौतियों को संबोधित करता है: ऑडियो निष्कर्षण भाषण ट्रैक को अलग करता है, विभाजन लंबे ऑडियो को प्रबंधनीय टुकड़ों में तोड़ता है, ASR भाषण को टेक्स्ट में परिवर्तित करता है, संरेखण शब्द-स्तरीय टाइमस्टैम्प प्रदान करता है, डायरीकरण यह पहचानता है कि कब किसने बोला, और पोस्ट-प्रोसेसिंग अंतिम आउटपुट को साफ और प्रारूपित करता है।

आधुनिक सिस्टम जैसे Curify की पाइपलाइन 95%+ सटीकता प्राप्त करती है, यहां तक कि चुनौतीपूर्ण परिस्थितियों में भी, ऑडियो पृथक्करण के लिए Conv-TasNet, भाषण पहचान के लिए WhisperX, और वक्ता पहचान के लिए उन्नत क्लस्टरिंग एल्गोरिदम को मिलाकर। यह तकनीकी गहनता प्रत्येक घटक और उनके एकीकरण रणनीतियों का अन्वेषण करती है।

ट्रांसक्रिप्शन के लिए तकनीकी आर्किटेक्चर महत्वपूर्ण क्यों है

सटीकता बनाम गति व्यापार: बड़े मॉडल बेहतर सटीकता प्रदान करते हैं लेकिन प्रोसेसिंग समय और कंप्यूटेशनल लागत बढ़ाते हैं। उत्पादन प्रणाली को उपयोग मामले की आवश्यकताओं के आधार पर इन कारकों के बीच संतुलन बनाना चाहिए।

स्केलेबिलिटी चुनौतियाँ: वास्तविक समय ट्रांसक्रिप्शन के लिए स्ट्रीमिंग प्रोसेसिंग और कम-लेटेंसी अनुमान की आवश्यकता होती है, जबकि बैच प्रोसेसिंग थ्रूपुट और लागत दक्षता के लिए अनुकूलित कर सकती है।

बहुभाषी जटिलता: कोड-स्विचिंग (वाक्यों के भीतर भाषाओं का मिश्रण) और क्रॉस-लिंगुअल कंटेंट के लिए विशेष मॉडल की आवश्यकता होती है जो भाषा सीमाओं के पार संदर्भ बनाए रख सकते हैं।

उत्पादन विश्वसनीयता: एंटरप्राइज सिस्टम को वास्तविक दुनिया की सामग्री के साथ होने वाले किनारे के मामलों को संभालने के लिए फेलओवर तंत्र, गुणवत्ता निगरानी और स्वचालित त्रुटि पुनर्प्राप्ति की आवश्यकता होती है।

कोर पाइपलाइन घटक

ऑडियो पूर्व-प्रोसेसिंग और विभाजन

पाइपलाइन Conv-TasNet का उपयोग करके स्रोत पृथक्करण और ऑडियो विभाजन के लिए उन्नत ऑडियो पूर्व-प्रोसेसिंग के साथ शुरू होती है। यह चरण मानव भाषण को पृष्ठभूमि के संगीत, परिवेशीय शोर और अन्य ऑडियो स्रोतों से समय-डोमेन ऑडियो पृथक्करण के माध्यम से अलग करता है।

तकनीकी कार्यान्वयन:

# ऑडियो पृथक्करण Conv-TasNet का उपयोग करके

import torch

import torchaudio

from conv_tasnet import ConvTasNet

# स्रोत पृथक्करण मॉडल प्रारंभ करें

separator = ConvTasNet(

n_bases=512, # आधार कार्यों की संख्या

kernel_size=16, # संकुचन कर्नेल का आकार

stride=8, # अस्थायी संकुचन के लिए स्ट्राइड

n_layers=8, # संकुचन परतों की संख्या

n_src=2 # अलग करने के लिए स्रोतों की संख्या

)

# 16kHz पर ऑडियो तरंग रूपांतरित करें

audio_tensor, sample_rate = torchaudio.load('input_video.wav')

if sample_rate != 16000:

resampler = torchaudio.transforms.Resample(sample_rate, 16000)

audio_tensor = resampler(audio_tensor)

# स्रोत अलग करें

with torch.no_grad():

separated_sources = separator(audio_tensor)

speech_source = separated_sources[0] # प्राथमिक भाषण निकालें

Conv-TasNet आर्किटेक्चर कच्चे तरंग रूपों से ऑडियो स्रोतों को अलग करने के लिए अस्थायी संकुचन नेटवर्क के साथ संकुचन एन्कोडिंग-डिकोडिंग संरचनाओं का उपयोग करता है, जो स्पेक्ट्रोग्राम-आधारित दृष्टिकोणों से संबंधित जानकारी के नुकसान से बचता है।

ASR (स्पीच-से-टेक्स्ट) WhisperX के साथ

स्वच्छ भाषण WhisperX में फीड होता है, जो OpenAI के Whisper मॉडल का एक उन्नत संस्करण है जिसे ट्रांसक्रिप्शन सटीकता और गति के लिए अनुकूलित किया गया है। सिस्टम वक्ता डायरीकरण के माध्यम से कई वक्ताओं, बोलियों और उच्चारणों को संभालता है—स्वचालित रूप से वक्ता पहचान के द्वारा ऑडियो को विभाजित करता है।

तकनीकी कार्यान्वयन:

# उन्नत भाषण पहचान WhisperX का उपयोग करके

import whisperx

import torch

from whisperx.utils import get_writer

# ट्रांसक्रिप्शन के लिए WhisperX मॉडल लोड करें

model = whisperx.load_model("large-v3", device="cuda")

# शब्द-स्तरीय टाइमस्टैम्प और वक्ता डायरीकरण के साथ ट्रांसक्रिप्शन करें

result = model.transcribe(

speech_source,

batch_size=32, # दक्षता के लिए बैच में प्रोसेस करें

language="auto", # भाषा का स्वचालित पता लगाना

task="transcribe",

word_timestamps=True, # शब्द-स्तरीय समय सक्षम करें

print_progress=True

)

# मजबूर संरेखण का उपयोग करके व्हिस्पर आउटपुट को संरेखित करें

model_a, metadata = whisperx.load_align_model(

language_code=result["language"],

device="cuda"

)

result = whisperx.align(

result["segments"],

model_a,

metadata,

speech_source,

device="cuda"

)

# वक्ता लेबल असाइन करें

diarize_model = whisperx.DiarizationPipeline(

use_auth_token=False,

device="cuda"

)

diarize_segments = diarize_model(speech_source)

result = whisperx.assign_word_speakers(diarize_segments, result)

WhisperX आधार Whisper मॉडल में अनुकूलित अनुमान, बेहतर वक्ता डायरीकरण और बेहतर शब्द-स्तरीय समय सटीकता के माध्यम से सुधार करता है। मजबूर संरेखण चरण ऑडियो और ट्रांसक्रिप्ट के बीच सटीक समन्वय सुनिश्चित करता है।

मजबूर संरेखण और शब्द-स्तरीय टाइमस्टैम्प

मजबूर संरेखण सटीक शब्द-स्तरीय टाइमस्टैम्प प्रदान करता है जो उच्च गुणवत्ता वाले सबटाइटल, वीडियो समन्वय, और डाउनस्ट्रीम भाषा प्रोसेसिंग के लिए आवश्यक हैं। इस चरण में, एक समर्पित ध्वनिक मॉडल ऑडियो सिग्नल और ASR सिस्टम से प्रारंभिक ट्रांसक्रिप्ट लेता है और उन्हें कच्चे ASR आउटपुट की तुलना में बहुत अधिक बारीकी से संरेखित करता है। केवल यह जानने के बजाय कि प्रत्येक वाक्य या खंड कब शुरू और समाप्त होता है, सिस्टम हर शब्द के सटीक प्रारंभ और समाप्ति का अनुमान लगाता है, कभी-कभी तो ध्वन्यात्मक स्तर पर भी। यह संरेखण प्रक्रिया आमतौर पर संभाव्य अनुक्रम मॉडल, जैसे कि हिडन मार्कोव मॉडल या न्यूरल ध्वनिक एन्कोडर्स का उपयोग करती है, ताकि ऑडियो साक्ष्य और ट्रांसक्रिप्ट के आधार पर प्रत्येक शब्द के लिए सबसे संभावित समय की गणना की जा सके। परिणाम एक समृद्ध संरचना है जहाँ प्रत्येक शब्द को प्रारंभ समय, समाप्ति समय, और विश्वास स्कोर के साथ एनोटेट किया गया है, और खंडों को विस्तृत समय मेटाडेटा के साथ बढ़ाया गया है। ये सटीक टाइमस्टैम्प फ्रेम-सटीक सबटाइटल रेंडरिंग को सक्षम करते हैं, संपादकों को वीडियो टाइमलाइन में भाषण के विशिष्ट भागों पर सीधे कूदने की अनुमति देते हैं, और बाद के कार्यों जैसे मशीन अनुवाद, डबिंग, लिप-सिंक विश्लेषण, या बड़े मीडिया लाइब्रेरी में सामग्री-आधारित खोज के लिए एक विश्वसनीय अस्थायी रीढ़ बनाते हैं।

वक्ता डायरीकरण कार्यान्वयन

वक्ता डायरीकरण यह सुनिश्चित करने के लिए जिम्मेदार है कि "किसने कब बोला" एक ऑडियो या वीडियो फ़ाइल के दौरान, एक कच्चे ट्रांसक्रिप्ट को एक संरचित, वक्ता-जानकारी वाली बातचीत में बदलता है। सिस्टम पहले ऑडियो को समरूप खंडों में विभाजित करता है जो संभवतः एक प्रमुख वक्ता को शामिल करते हैं और फिर प्रत्येक खंड को एक संक्षिप्त संख्यात्मक प्रतिनिधित्व में परिवर्तित करता है जिसे वक्ता एम्बेडिंग कहा जाता है, जो स्वर, पिच पैटर्न, और बोलने की शैली जैसी विशेषताओं को कैप्चर करता है। इन एम्बेडिंग का उपयोग करके, क्लस्टरिंग एल्गोरिदम समान ध्वनि वाले खंडों को लगातार वक्ता पहचानियों में समूहित करते हैं, बिना यह जाने कि कितने वक्ता मौजूद हैं या वे कौन हैं। उन्नत डायरीकरण पाइपलाइनों में वक्ताओं की संख्या का अनुकूलन करने, जहां वक्ता ओवरलैप करते हैं, सीमाओं को परिष्कृत करने, और लेबल को चिकना करने की क्षमता होती है ताकि एक ही व्यक्ति को लंबे रिकॉर्डिंग में एक ही वक्ता आईडी सौंपा जा सके। परिणामी डायरीज़ किया गया ट्रांसक्रिप्ट प्रत्येक खंड, और अक्सर प्रत्येक शब्द, को एक स्थिर वक्ता लेबल के साथ जोड़ता है, जिससे मीटिंग मिनट्स जैसे अनुप्रयोगों के लिए प्रति-वक्ता सारांश, कॉल सेंटर विश्लेषण, व्यक्तिगत सामग्री अनुशंसाएँ, और स्पष्ट सबटाइटल बनाने की अनुमति मिलती है जो यह संकेत करते हैं कि प्रत्येक क्षण में कौन सा पात्र या प्रतिभागी बोल रहा है।

पोस्ट-प्रोसेसिंग और गुणवत्ता आश्वासन

पोस्ट-प्रोसेसिंग और गुणवत्ता आश्वासन चरण कच्चे मॉडल आउटपुट को एक पॉलिश, उत्पादन-तैयार ट्रांसक्रिप्ट में बदलता है जो अंतिम उपयोगकर्ताओं और डाउनस्ट्रीम सिस्टम के लिए उपयुक्त है। पोस्ट-प्रोसेसिंग आमतौर पर सामान्यीकरण चरणों के साथ शुरू होती है जैसे कि केस को ठीक करना, संख्याओं का विस्तार या मानकीकरण, संक्षिप्ताक्षरों को संभालना, और विराम चिह्न को पुनर्स्थापित करना ताकि टेक्स्ट स्वाभाविक गद्य की तरह पढ़े न कि फ्लैट टोकन अनुक्रम। फिर टाइमस्टैम्प को मानकीकृत सबटाइटल टाइमकोड में प्रारूपित किया जाता है और ट्रांसक्रिप्ट को लंबाई, अवधि, और भाषाई सीमाओं के अनुसार पढ़ने योग्य सबटाइटल इकाइयों या पैराग्राफ में विभाजित किया जाता है। गुणवत्ता आश्वासन इस साफ ट्रांसक्रिप्ट पर एक मान्यता परत जोड़ता है: यह शब्द-स्तरीय विश्वास स्कोर को खंड-स्तरीय मैट्रिक्स में संकलित करता है, असामान्य रूप से निम्न-विश्वास वाले अंशों, अचानक समय के अंतराल, या संदिग्ध पुनरावृत्तियों का पता लगाता है, और उन्हें मानव समीक्षा या स्वचालित पुनःप्रोसेसिंग के लिए झंडा करता है। अतिरिक्त जांच शैली गाइड को लागू कर सकती हैं, जब उपयुक्त हो, अव्यवस्थितता या भराव शब्दों को हटा सकती हैं, और यह सुनिश्चित कर सकती हैं कि वक्ता लेबल पूरे फ़ाइल में सुसंगत रहें। मिलकर, ये पोस्ट-प्रोसेसिंग और QA चरण सुनिश्चित करते हैं कि अंतिम आउटपुट न केवल यह दर्शाता है कि क्या कहा गया था, बल्कि यह भी पेशेवर ट्रांसक्रिप्शन, स्थानीयकरण, और सुलभता वर्कफ़्लो के लिए आवश्यक सटीकता, पठनीयता, और प्रारूपण मानकों को पूरा करता है।

तकनीकी चुनौतियाँ और समाधान

ओवरलैपिंग स्पीच: एक साथ कई वक्ताओं का बोलना ASR चुनौतियाँ पैदा करता है। समाधान में ऑडियो स्रोत पृथक्करण, मल्टी-स्पीकर मॉडल, और जटिल डायरीकरण एल्गोरिदम शामिल हैं।

बहुभाषी स्विचिंग: भाषाओं के बीच कोड-स्विचिंग के लिए ऐसे मॉडल की आवश्यकता होती है जो एक साथ कई भाषाओं को संभाल सकें। उन्नत सिस्टम भाषा पहचान और विशेष बहुभाषी मॉडलों का उपयोग करते हैं।

शोर वाले वातावरण: पृष्ठभूमि का संगीत, परिवेशीय शोर, और poor ऑडियो गुणवत्ता ट्रांसक्रिप्शन सटीकता को कम करती है। ऑडियो पूर्व-प्रोसेसिंग और स्रोत पृथक्करण तकनीक इन मुद्दों को कम करती हैं।

लेटेंसी बनाम सटीकता: वास्तविक समय के अनुप्रयोगों को कम लेटेंसी की आवश्यकता होती है लेकिन सटीकता का बलिदान कर सकते हैं। उत्पादन प्रणाली को उपयोग मामले के आधार पर इन प्रतिस्पर्धी आवश्यकताओं के बीच संतुलन बनाना चाहिए।

उत्पादन प्रणाली डिजाइन

बैच बनाम स्ट्रीमिंग प्रोसेसिंग: बैच प्रोसेसिंग लागत और थ्रूपुट के लिए अनुकूलित करती है, जबकि स्ट्रीमिंग प्रोसेसिंग लाइव अनुप्रयोगों के लिए वास्तविक समय ट्रांसक्रिप्शन सक्षम करती है।

GPU अनुमान अनुकूलन: मॉडल क्वांटाइजेशन, बैच प्रोसेसिंग, और टेन्सर समानांतरता गणनात्मक लागत को कम करती है जबकि सटीकता बनाए रखती है।

पाइपलाइन ऑर्केस्ट्रेशन: संदेश कतारें (जैसे Azure सेवा बस) प्रोसेसिंग चरणों के बीच समन्वय करती हैं, स्केलेबल, फॉल्ट-टॉलरेंट वर्कफ़्लो को सक्षम करती हैं।

लागत अनुकूलन रणनीतियाँ: डायनामिक बैचिंग, स्पॉट इंस्टेंस, और मॉडल संकुचन अवसंरचना लागत को कम करते हैं जबकि सेवा स्तर के अनुबंधों को बनाए रखते हैं।

तकनीकी आर्किटेक्चर तुलना

| घटक | बुनियादी ASR | WhisperX | एंटरप्राइज पाइपलाइन |

|---|---|---|---|

| ऑडियो प्रोसेसिंग | एकल चैनल | बुनियादी फ़िल्टरिंग | Conv-TasNet पृथक्करण |

| भाषण पहचान | HMM/GMM | ट्रांसफार्मर | WhisperX + फाइन-ट्यूनिंग |

| वक्ता डायरीकरण | कोई नहीं | बुनियादी क्लस्टरिंग | उन्नत क्लस्टरिंग + वॉयस प्रोफाइलिंग |

| मजबूर संरेखण | कोई नहीं | बुनियादी संरेखण | शब्द-स्तरीय सटीकता संरेखण |

| गुणवत्ता आश्वासन | मैनुअल | विश्वास स्कोरिंग | स्वचालित + मानव समीक्षा |

| स्केलेबिलिटी | सीमित | मध्यम | एंटरप्राइज स्केल |

| सटीकता | 70-85% | 90-95% | 95-98% |

तकनीकी व्यापार-निष्कर्ष:

- लेटेंसी बनाम सटीकता: बड़े मॉडल बेहतर सटीकता प्रदान करते हैं लेकिन प्रोसेसिंग समय बढ़ाते हैं

- गणनात्मक लागत: GPU त्वरक उत्पादन-स्तरीय प्रोसेसिंग के लिए आवश्यक है

- मॉडल आकार: क्वांटाइजेशन मेमोरी उपयोग को कम करता है लेकिन किनारे के मामलों की सटीकता को प्रभावित कर सकता है

- भाषा समर्थन: बहुभाषी मॉडल को अधिक भंडारण और गणनात्मक संसाधनों की आवश्यकता होती है

Curify की उत्पादन ट्रांसक्रिप्शन आर्किटेक्चर

Curify का ट्रांसक्रिप्शन सिस्टम अत्याधुनिक ऑडियो प्रोसेसिंग तकनीकों का उत्पादन-ग्रेड कार्यान्वयन है, जिसे स्केल, सटीकता और विश्वसनीयता के लिए इंजीनियर किया गया है। हमारी आर्किटेक्चर कई विशेषीकृत न्यूरल नेटवर्क को एकीकृत पाइपलाइन में जोड़ती है जो न्यूनतम मानव हस्तक्षेप के साथ वीडियो कंटेंट को अंत-से-अंत प्रोसेस करती है।

कोर तकनीकी घटक:

ऑडियो प्रोसेसिंग स्टैक: स्रोत पृथक्करण के लिए Conv-TasNet और ट्रांसक्रिप्शन के लिए WhisperX का उपयोग करके, Curify 95%+ सटीकता प्राप्त करता है यहां तक कि शोर वाले वातावरण में भी। सिस्टम 16kHz रिज़ॉल्यूशन पर ऑडियो प्रोसेस करता है, व्यक्तिगत आवाज़ों को अलग करने के लिए वास्तविक समय शोर में कमी और वक्ता डायरीकरण लागू करता है।

गुणवत्ता आश्वासन पाइपलाइन: स्वचालित विश्वास स्कोरिंग संभावित ट्रांसक्रिप्शन त्रुटियों की पहचान करती है मानव समीक्षा के लिए। सिस्टम तकनीकी सामग्री के लिए सटीकता में सुधार के लिए डोमेन-विशिष्ट शब्दावली पर प्रशिक्षित भाषा मॉडलों का उपयोग करता है, उद्योग-विशिष्ट शब्दावली के लिए फाइन-ट्यूनिंग क्षमताओं के साथ।

अवसंरचना: GPU क्लस्टरों पर तैनात, 100+ समवर्ती ट्रांसक्रिप्शन नौकरियों को संभालता है। सिस्टम लगभग 2 मिनट में 1 घंटे के वीडियो को प्रोसेस करता है, सामग्री की जटिलता और ऑडियो गुणवत्ता के आधार पर।

पाइपलाइन ऑर्केस्ट्रेशन: Azure सेवा बस कतारें प्रोसेसिंग चरणों के बीच समन्वय करती हैं, फॉल्ट-टॉलरेंट वर्कफ़्लो को सक्षम करती हैं जो स्वचालित रूप से विफलताओं और पुनः प्रयासों को संभाल सकती हैं। सिस्टम लागत दक्षता के लिए बैच प्रोसेसिंग और वास्तविक समय अनुप्रयोगों के लिए स्ट्रीमिंग दोनों का समर्थन करता है।

🎯 क्या आप अपने संगठन के लिए उन्नत ट्रांसक्रिप्शन पाइपलाइनों को लागू करने के लिए तैयार हैं? Curify के तकनीकी ट्रांसक्रिप्शन समाधानों का अन्वेषण करें

वीडियो ट्रांसक्रिप्शन तकनीक का भविष्य

वीडियो ट्रांसक्रिप्शन तकनीक बुनियादी भाषण पहचान प्रणालियों से विकसित होकर जटिल बहु-चरण पाइपलाइनों में बदल गई है जो न्यूरल नेटवर्क, ऑडियो प्रोसेसिंग और ऑप्टिमाइजेशन तकनीकों में प्रगति को जोड़ती हैं। आधुनिक प्रणालियाँ जैसे कि Curify का पाइपलाइन दिखाती हैं कि ऑडियो पृथक्करण के लिए Conv-TasNet, ट्रांसक्रिप्शन के लिए WhisperX, और उन्नत गुणवत्ता आश्वासन को उत्पादन-ग्रेड वर्कफ़्लो में कैसे एकीकृत किया जा सकता है।

तकनीकी टीमों और डेवलपर्स के लिए, मुख्य takeaway यह है कि वीडियो ट्रांसक्रिप्शन अब एक शोध समस्या नहीं है बल्कि एक हल की गई इंजीनियरिंग चुनौती है। शेष अवसर ऑप्टिमाइजेशन, एज केस, और एकीकरण में हैं न कि मौलिक तकनीकी सीमाओं में। जैसे-जैसे ये प्रणालियाँ बेहतर मॉडल आर्किटेक्चर और बड़े प्रशिक्षण डेटासेट के माध्यम से सुधार करती हैं, हम एक ऐसे भविष्य के करीब पहुँच रहे हैं जहाँ किसी भी सामग्री प्रकार के लिए परिपूर्ण ट्रांसक्रिप्शन बड़े पैमाने पर उपलब्ध है।

यहाँ वर्णित तकनीकी आर्किटेक्चर 2026 में कला की वर्तमान स्थिति का प्रतिनिधित्व करता है, लेकिन यह क्षेत्र तेजी से विकसित होता रहता है। रीयल-टाइम ट्रांसक्रिप्शन, जीरो-शॉट स्पीकर पहचान, और स्वचालित सामग्री संक्षेपण पहले से ही उभरती क्षमताएँ हैं जो वीडियो सामग्री प्रोसेसिंग और विश्लेषण के तरीके को और बदल देंगी।

संबंधित लेख

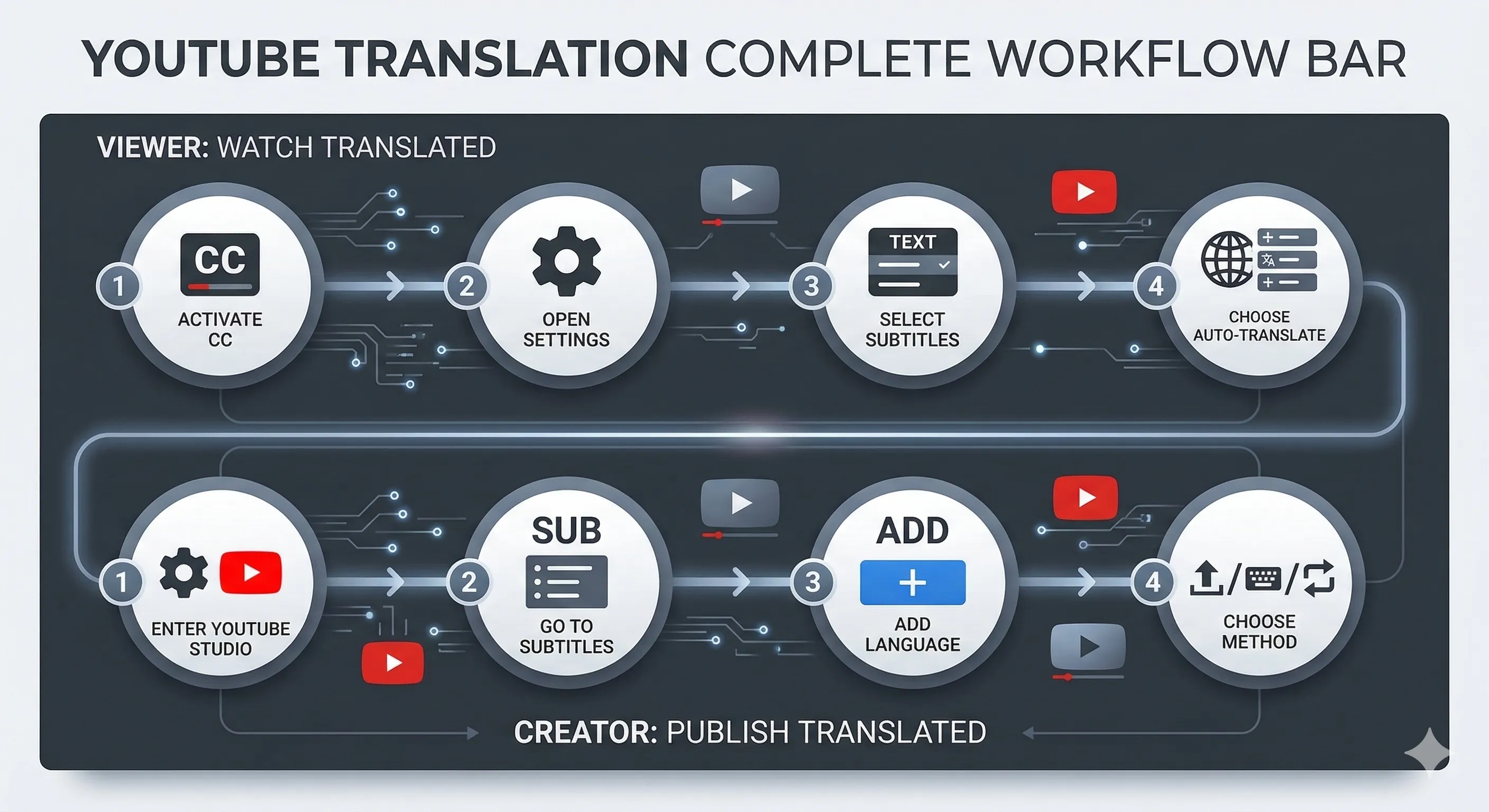

video-translation-dubbing

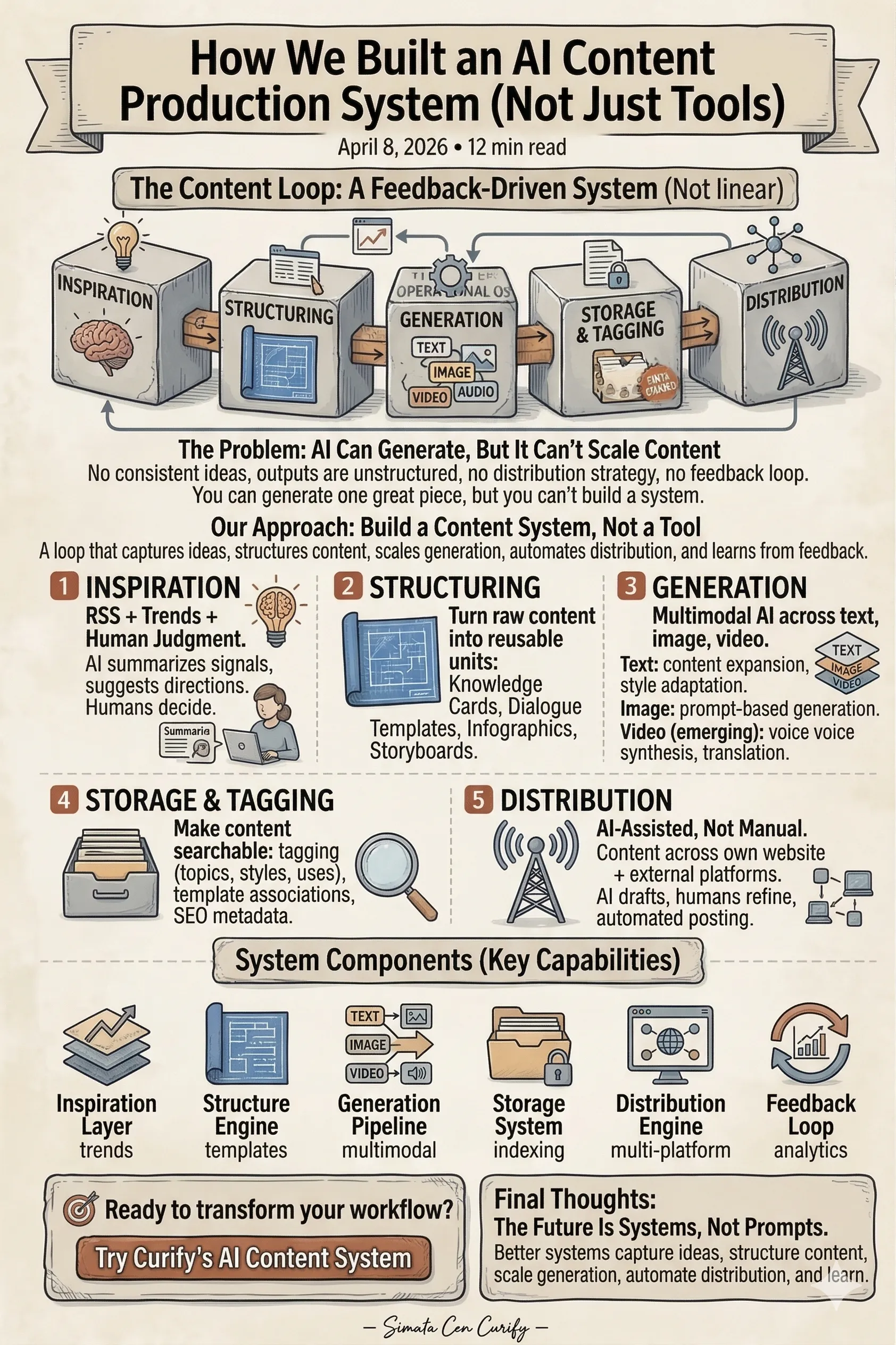

How We Built an AI Content Production System (Not Just Tools)

Inside Curify's Video Translation Pipeline: A Technical Deep-Dive