2026 में वीडियो को स्वाभाविक रूप से डब कैसे करें: AI वॉयस क्लोनिंग आर्टिफैक्ट्स को ठीक करना

AI उपकरणों के साथ सामान्य डबिंग चुनौतियों को हल करने के लिए एक व्यापक गाइड। रोबोटिक गति, भावना की कमी, और लिप-सिंक मुद्दों जैसे दर्द बिंदुओं पर ध्यान केंद्रित करें।

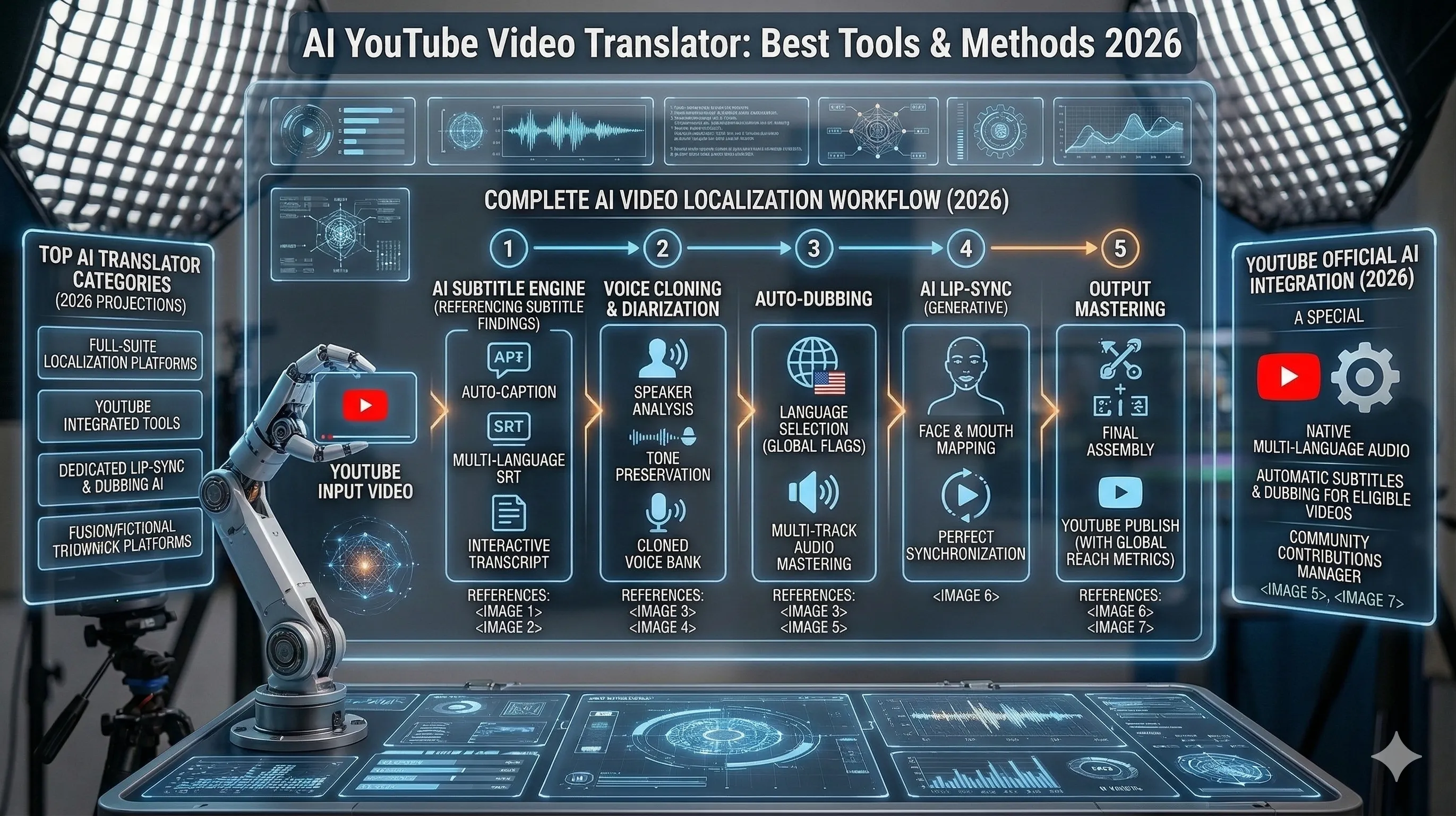

AI वीडियो डबिंग ने सामग्री निर्माण में क्रांति ला दी है, लेकिन रोबोटिक आर्टिफैक्ट्स और अस्वाभाविक गति अभी भी कई उत्पादन को परेशान करते हैं। 2026 में, हमारे पास इन चुनौतियों को पार करने के लिए बेहतर उपकरण और तकनीकें हैं। मुख्य समस्या यह है कि अधिकांश डबिंग पाइपलाइनों में भाषण को एक शुद्ध तकनीकी परत के रूप में देखा जाता है न कि एक प्रदर्शन के रूप में। कई सिस्टम अभी भी सपाट प्रोसोड़ी, असंगत जोर, और खराब समयबद्ध विराम के साथ ऑडियो उत्पन्न करते हैं, जो विसर्जन को तोड़ता है, भले ही आवाज़ स्वयं यथार्थवादी लगे। दर्शक समय के असंगतियों के प्रति अत्यधिक संवेदनशील होते हैं—जब भावनात्मक बीट, सूक्ष्म विराम, या वाक्य का जोर दृश्य प्रदर्शन के साथ मेल नहीं खाते, तो परिणाम सूक्ष्म रूप से "गलत" लगता है, भले ही वे यह स्पष्ट न कर सकें कि क्यों। आधुनिक दृष्टिकोण इस पर ध्यान केंद्रित करते हैं प्रोसोड़ी नियंत्रण और समय संबंधी संरेखण। भाषण को रैखिक रूप से उत्पन्न करने के बजाय, नए मॉडल ताल-जानकारी वाले संश्लेषण को शामिल करते हैं, जिससे निर्माताओं को वाक्यांश और स्वर के स्तर पर गति को नियंत्रित करने की अनुमति मिलती है। यह लिप मूवमेंट को मेल करने, नाटकीय विराम को बनाए रखने, और विभिन्न भाषाओं में मूल अभिनेता की मंशा को बनाए रखने की संभावना बनाता है। जैसे तकनीकें जैसे कि फोर्स्ड अलाइनमेंट, फोनीम-स्तरीय समय, और संदर्भ-ऑडियो कंडीशनिंग अब उच्च गुणवत्ता वाले पाइपलाइनों में मानक बन रही हैं। एक और बड़ा सुधार संदर्भ-जानकारी वाली आवाज़ मॉडलिंग से आता है। प्रत्येक पंक्ति को अलग-अलग उत्पन्न करने के बजाय, उन्नत सिस्टम संवादात्मक स्मृति बनाए रखते हैं—दृश्यों के बीच स्वर, भावनात्मक स्थिति, और वक्ता की गतिशीलता को ट्रैक करते हैं। यह स्वर की भटकन को कम करता है और सुनिश्चित करता है कि एक पात्र चाहे वह फुसफुसा रहा हो, बहस कर रहा हो, या व्याख्या कर रहा हो, स्थिर लगे। कथा-भारी सामग्री के लिए, यह बदलाव अकेले ही महसूस की गई यथार्थता में नाटकीय रूप से सुधार करता है। अंत में, मानव-इन-द-लूप कार्यप्रवाहों का उदय स्वचालन और गुणवत्ता के बीच की खाई को बंद कर देता है। निर्माता अब AI जनरेशन को हल्के संपादन परतों के साथ मिलाते हैं—विराम को ठीक करना, जोर को समायोजित करना, या पूरे क्लिप के बजाय विशिष्ट खंडों को फिर से उत्पन्न करना। यह हाइब्रिड दृष्टिकोण दक्षता को रचनात्मक नियंत्रण के साथ संतुलित करता है, जिससे उत्पादन टीमों को डबिंग को स्केल करने में सक्षम बनाता है जबकि स्टूडियो-स्तरीय परिणाम प्राप्त करते हैं। एक साथ, ये उन्नतियाँ AI डबिंग को एक उत्पादन-ग्रेड समाधान में बदल देती हैं, जो भाषाओं में प्राकृतिक, भावनात्मक रूप से गूंजने वाले प्रदर्शन प्रदान करने में सक्षम है बिना गति या स्केलेबिलिटी का बलिदान किए।

यह गाइड आपको दिखाएगी कि कैसे सामान्य डबिंग समस्याओं को ठीक करें जैसे कि MuseTalk, Emotion TTS, और उन्नत पोस्ट-प्रोसेसिंग तकनीकों का उपयोग करके। हम बुनियादी आवाज़ जनरेशन से परे जाते हैं ताकि AI डबिंग कार्यप्रवाहों में सबसे लगातार विफलता बिंदुओं को संबोधित किया जा सके—लिप-सिंक ड्रिफ्ट, मोनोटोन डिलीवरी, समय के असंगतियाँ, और भावनात्मक सपाटता। आप सीखेंगे कि कैसे MuseTalk का उपयोग करके दृश्य-ऑडियो संरेखण को सटीक रूप से सुनिश्चित करें, यह सुनिश्चित करते हुए कि उत्पन्न भाषण ट्रैक मुंह की गति और चेहरे के भावों के साथ निकटता से मेल खाते हैं, यहां तक कि तेज़-गति या संवाद-भारी दृश्यों में भी। ऑडियो पक्ष पर, हम यह समझाते हैं कि कैसे Emotion TTS सिस्टम का लाभ उठाकर उत्पन्न आवाज़ों में नियंत्रित अभिव्यक्ति डालें। सामान्य प्रीसेट पर निर्भर रहने के बजाय, गाइड यह बताता है कि कैसे पिच कंटूर, गति, और जोर को मंशा को दर्शाने के लिए ट्यून करें—चाहे वह तनाव, व्यंग्य, या एक ही पंक्ति के भीतर सूक्ष्म भावनात्मक बदलाव हो। यह आपको "तकनीकी रूप से सही" ऑडियो से मानव और संदर्भ में आधारित प्रदर्शन में स्थानांतरित करने की अनुमति देता है। हम उन्नत पोस्ट-प्रोसेसिंग कार्यप्रवाहों को भी कवर करते हैं जो अंतिम आउटपुट गुणवत्ता में महत्वपूर्ण अंतर लाते हैं। इसमें फोनीम-स्तरीय समय समायोजन, मौन ट्रिमिंग और विस्तार, सांस और विराम डालना, और ऑडियो मास्टरिंग तकनीकें जैसे EQ मिलान और लाउडनेस सामान्यीकरण शामिल हैं ताकि डब की गई आवाज़ों को मूल साउंडट्रैक में सहजता से मिलाया जा सके। इन उपकरणों और तकनीकों को एक समग्र पाइपलाइन में मिलाकर, आप डबिंग समस्याओं का व्यवस्थित रूप से निदान और ठीक कर सकेंगे बजाय इसके कि परीक्षण और त्रुटि पर निर्भर रहें—असंगत AI आउटपुट को पॉलिश, उत्पादन-तैयार संवाद में बदलना।

Pro Tip

सामान्य AI डबिंग समस्याएं

🤖 रोबोटिक गति

AI-जनित भाषण अक्सर प्राकृतिक ताल और समय की कमी होती है, जिससे यह यांत्रिक और अलग लगता है।

दर्शक की अनुत्तीर्णता

अस्वाभाविक गति विसर्जन को तोड़ती है और दर्शक की रिटेंशन को 40% तक कम कर देती है।

😐 भावनात्मक बारीकी की कमी

AI आवाज़ें सूक्ष्म भावनाओं को व्यक्त करने में संघर्ष करती हैं, जिससे नाटकीय दृश्य सपाट लगते हैं।

भावनात्मक डिस्कनेक्ट

भावनात्मक संकेतों की कमी दर्शकों को पात्रों और कहानी से जोड़ने से रोकती है।

👄 लिप-सिंक असंगतियाँ

ऑडियो और दृश्य लिप मूवमेंट के बीच खराब संरेखण एक अजीब घाटी प्रभाव पैदा करता है।

अवास्तविक उपस्थिति

दृश्यमान लिप-सिंक त्रुटियाँ तुरंत प्राकृतिक भाषण के भ्रम को तोड़ देती हैं।

AI के साथ अपने वीडियो डबिंग को बदलें

इन उन्नत तकनीकों और उपकरणों को मिलाकर, आप प्राकृतिक, भावनात्मक रूप से आकर्षक डब की गई सामग्री बना सकते हैं जो दर्शकों को आकर्षित करती है। AI डबिंग का भविष्य यहाँ है, और यह पहले से कहीं अधिक मानव है।