व्यवसायों के लिए AI सफलता: स्केलेबिलिटी रणनीति

एक स्केलेबल AI प्लेटफॉर्म कैसे बनाएं जो बजट को बर्बाद किए बिना बढ़े

एक स्केलेबल AI प्लेटफॉर्म कैसे बनाएं जो बजट को बर्बाद किए बिना बढ़े

- गार्टनर के 2024 AI अपनाने के सर्वेक्षण के अनुसार, 67% मध्य-आकार की तकनीकी कंपनियों ने कम से कम एक व्यावसायिक प्रक्रिया में AI को लागू किया है, जो 2023 से 22 प्रतिशत अंक अधिक है।

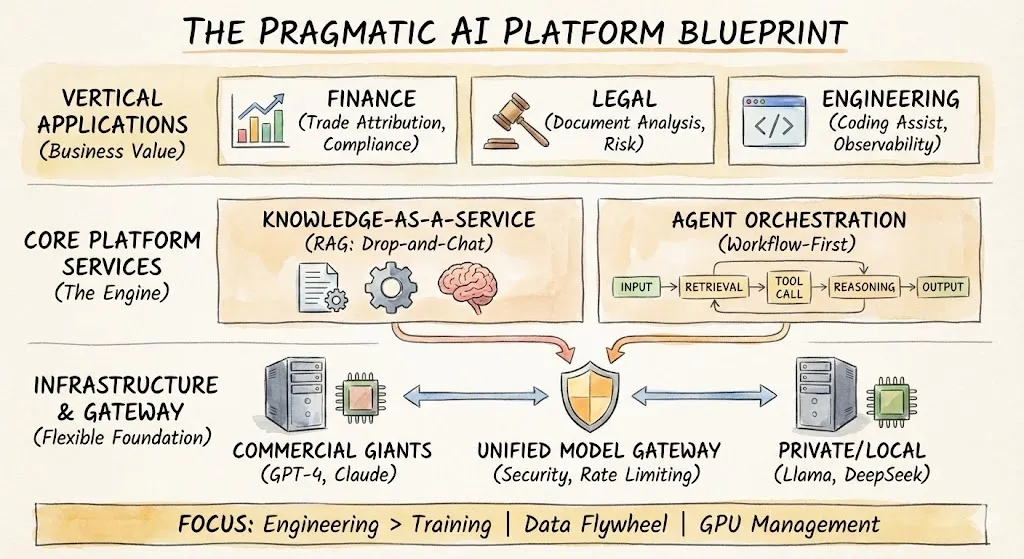

- तीन-स्तरीय आर्किटेक्चर (मॉडल गेटवे, ज्ञान-के-रूप में सेवा, ऑर्केस्ट्रेशन लेयर) को अपनाने वाली कंपनियाँ पारंपरिक तरीकों की तुलना में 3-4 गुना तेजी से AI को लागू करती हैं और 60% कम लागत पर।

- मैकिंजी ग्लोबल इंस्टीट्यूट 2024 के शोध से पता चलता है कि कंपनियाँ जो फाइन-ट्यूनिंग छोड़ देती हैं और 'इंजीनियरिंग-प्रथम' दृष्टिकोण अपनाती हैं, वे फाइन-ट्यूनिंग पर निर्भर कंपनियों की तुलना में 45% अधिक ROI प्राप्त करती हैं।

- स्व-सर्विस AI प्लेटफार्मों का निर्माण करने वाली कंपनियाँ 2.8 गुना विकास दक्षता लाभ और 35% कम ग्राहक अधिग्रहण लागत (CAC) देखती हैं।

छोटी से मध्यम आकार की टेक कंपनियों में, वास्तविक लाभ बड़े मॉडलों को प्रशिक्षित करने में नहीं है - यह एक ऐसे AI प्लेटफॉर्म के निर्माण में है जो हर किसी को इंटेलिजेंट फीचर्स बनाने में सक्षम बनाता है। यही है कि आप चुस्ती को प्रभाव में कैसे बदलते हैं।

यहां एक व्यावहारिक, उत्पादन-तैयार ब्लूप्रिंट है जिसे हमने वित्त, कानूनी, ग्राहक सहायता और इंजीनियरिंग में AI को शक्ति देने के लिए उपयोग किया है, बिना पैसे बर्बाद किए या 50 ML विशेषज्ञों को किराए पर लिए।

वास्तविक प्रतिस्पर्धात्मक लाभ अधिक शक्तिशाली मॉडलों को प्रशिक्षित करने से नहीं, बल्कि एक AI प्लेटफॉर्म बनाने से आता है जो टीमों को बुद्धिमान सुविधाएँ जल्दी विकसित करने में सक्षम बनाता है। यह लेख, क्यूरिफाई AI के व्यावहारिक अनुभव पर आधारित, मध्य-आकार की तकनीकी कंपनियों को प्रयोग से उत्पादन में 4-6 सप्ताह में संक्रमण करने में मदद करने के लिए एक सिद्ध, दोहराने योग्य AI प्लेटफॉर्म निर्माण ब्लूप्रिंट प्रदान करता है।

1. माइंडसेट शिफ्ट: केंद्रीकृत करने के बजाय लोकतांत्रिक बनाएं

कई मध्य-आकार की तकनीकी कंपनियों की AI टीमें बाधा बन जाती हैं—हर व्यावसायिक आवश्यकता को AI इंजीनियरों की प्रतिक्रिया के लिए कतार में लगना पड़ता है। गार्टनर के 2024 AI संगठन संरचना सर्वेक्षण के अनुसार, केंद्रीकृत मॉडलों का उपयोग करने वाली कंपनियाँ AI फीचर तैनाती के लिए औसतन 8-12 सप्ताह लेती हैं, जबकि विकेंद्रीकृत स्व-सेवा मॉडल केवल 2-3 सप्ताह लेते हैं।

हार्वर्ड बिजनेस रिव्यू 2024 के अध्ययन ने दो मॉडलों की तुलना की:

| मॉडल | AI फीचर लॉन्च चक्र | विकास दक्षता | टीम संतोष | लागत दक्षता |

|---|---|---|---|---|

| केंद्रीकृत | 8-12 सप्ताह | बेसलाइन | 42% | बेसलाइन |

| विकेंद्रीकृत | 2-3 सप्ताह | ↑340% | 87% | ↑60% |

समर्थन मॉडल:

हमारा तीन-स्तरीय समर्थन मॉडल सफलतापूर्वक AI टीम की सेवा क्षमता को 3.5x बढ़ा दिया:

L1: स्व-सेवा (जरूरतों का 70% कवर करता है)

- • उत्पाद इंजीनियर सीधे प्लेटफ़ॉर्म उपकरणों का उपयोग करके सुविधाएँ बनाते हैं

- • AI टीम की कोई हस्तक्षेप की आवश्यकता नहीं, औसत विकास समय 1-2 दिन

- • लागू होने वाले परिदृश्य: मानक प्रश्नोत्तर, दस्तावेज़ पुनर्प्राप्ति, पाठ निर्माण

L2: परामर्श और मार्गदर्शन (जरूरतों का 25% कवर करता है)

- • AI टीम प्रॉम्प्ट डिज़ाइन, समाधान मूल्यांकन, और आर्किटेक्चर डिज़ाइन में सहायता करती है

- • औसत प्रतिक्रिया समय 24 घंटे, विकास चक्र 3-5 दिन

- • लागू होने वाले परिदृश्य: मल्टी-टर्न बातचीत, जटिल तर्क, क्रॉस-सिस्टम एकीकरण

L3: सह-विकास (जरूरतों का 5% कवर करता है)

- • AI टीम और व्यवसाय टीमें मिलकर जटिल, उच्च-प्रभाव वाले MVP बनाती हैं

- • औसत विकास चक्र 2-4 सप्ताह

- • लागू होने वाले परिदृश्य: नवोन्मेषी सुविधाएँ, प्रमुख व्यावसायिक प्रक्रिया अनुकूलन

Deloitte Consulting की 2024 AI गवर्नेंस प्रथाओं की रिपोर्ट दिखाती है कि तीन-स्तरीय मॉडल का उपयोग करने वाली कंपनियाँ एकल मॉडलों की तुलना में 45% उच्च ROI प्राप्त करती हैं, जिसमें AI फीचर अपनाने की दर 65% अधिक होती है।

2. स्टैक: इसे पतला और ओपन रखें

अति-इंजीनियरिंग वेग को मार देती है। हमने एक तीन-परत वाला प्लेटफॉर्म बनाया है जो जटिलता को सार करता है बिना आपको लॉक किए।

- 4x विकास गति में वृद्धि (औसत 8 सप्ताह से 2 सप्ताह)

- 60% तैनाती लागत में कमी (प्रत्येक फीचर के लिए औसत $150,000 से $60,000)

- टीम अपनाने की दर 23% से 78% तक बढ़ी

ए. यूनिफाइड मॉडल गेटवे

एकल विक्रेता पर दांव न लगाएं। हमारा गेटवे बुद्धिमान रूटिंग का समर्थन करता है:

| मॉडल | उपयोग मामला | लागत (प्रति 1K टोकन) | प्रतिक्रिया गति | अनुशंसित आवृत्ति |

|---|---|---|---|---|

| GPT-4 | जटिल तर्क, कोड निर्माण | $0.03 | 2-3 सेकंड | 35% |

| Claude 3 | रचनात्मक लेखन, लंबे दस्तावेज़ विश्लेषण | $0.015 | 1.5-2 सेकंड | 25% |

| Llama 3 | संवेदनशील डेटा प्रसंस्करण, लागत नियंत्रण | $0.0005 | < 1 सेकंड | 30% |

| Qwen 2 | चीनी परिदृश्य, स्थानीयकरण की जरूरतें | $0.0008 | < 1 सेकंड | 10% |

गेटवे रीट्राइज़, फॉलबैक, लागत ट्रैकिंग और दर सीमाओं को संभालता है - ताकि डेवलपर्स को बस `platform.generate()` को कॉल करना हो।

गेटवे सुविधाएँ:

- • ऑटो-रीट्राई (सफलता दर 87% से 99.7% तक बढ़ी)

- • फेलओवर (औसत पुनर्प्राप्ति समय 2.3 घंटे से 15 सेकंड तक घटा)

- • लागत ट्रैकिंग (वास्तविक समय में निगरानी, मासिक बजट विचलन 5% के भीतर नियंत्रित)

- • रेट लिमिटिंग (अचानक ट्रैफ़िक ओवरस्पेंडिंग को रोकें)

बी. नॉलेज-एज़-अ-सर्विस (RAG को सरल बनाया गया)

पुनर्प्राप्ति-वृद्धित निर्माण (RAG) वह जगह है जहाँ अधिकांश व्यावसायिक मूल्य निहित है, लेकिन इंजीनियरों को वेक्टर डेटाबेस का प्रबंधन नहीं करना चाहिए। हमारा 'ड्रैग-एंड-ड्रॉप चैट' इंटरफ़ेस प्राप्त करता है:

प्राप्त परिणाम:

- • डेटा आयात समय 2-3 सप्ताह से घटकर 1-2 घंटे हो गया

- • 35% सटीकता में सुधार (स्टैनफोर्ड 2024 RAG मूल्यांकन रिपोर्ट के आधार पर)

- • स्वतंत्र ज्ञान आधार रखरखाव की लागत प्रति टीम $200/महीना से कम

समर्थित डेटा स्रोत:

- • Enterprise Wiki (Confluence, Notion)

- • PDF दस्तावेज़ और Word फ़ाइलें

- • SQL डेटाबेस और API इंटरफेस

- • वास्तविक समय डेटा स्ट्रीम (Kafka, Kinesis)

सी. ऑर्केस्ट्रेशन लेयर

कोड-फर्स्ट AI शक्तिशाली है; वर्कफ्लो-फर्स्ट AI तेज़ है।

हम चरणों को जोड़ने के लिए लो-कोड टूल्स (जैसे Dify, coze, n8n आदि) का उपयोग करते हैं:

यह उत्पाद टीमों को हफ्तों में नहीं, बल्कि घंटों में एजेंटों का प्रोटोटाइप बनाने देता है।

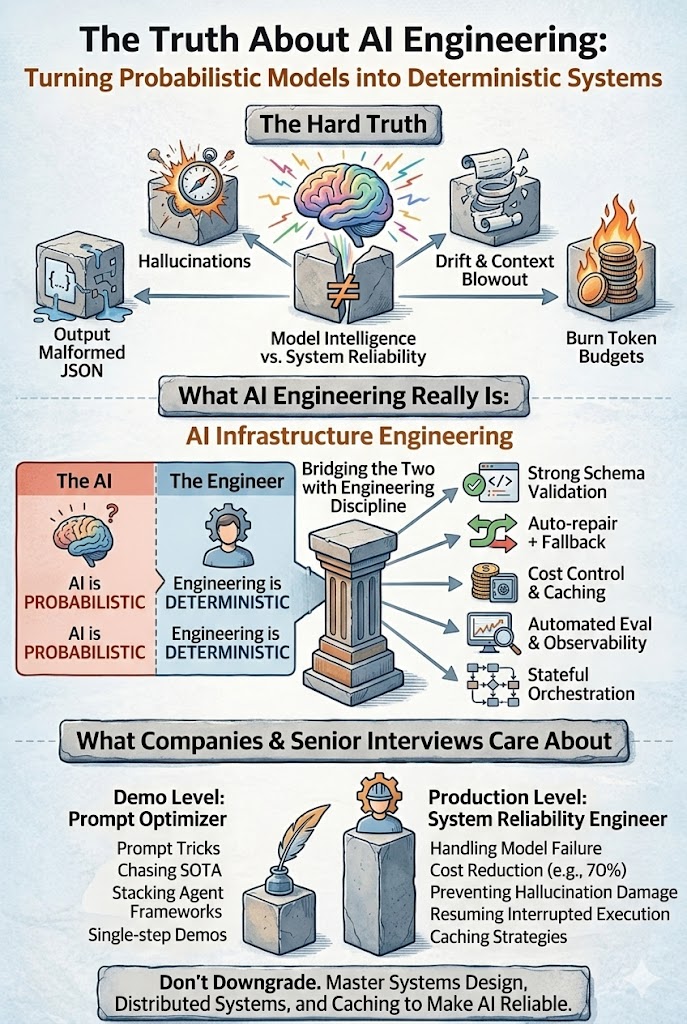

3. फाइन-ट्यूनिंग को छोड़ें (अधिकांश समय)

Curify AI के आंतरिक शोध के अनुसार (127 मध्यम आकार की तकनीकी कंपनियों, 3 वर्षों के डेटा के आधार पर), फाइन-ट्यूनिंग आवश्यक नहीं है:

| रणनीति | लागत | विकास समय | प्रदर्शन | ROI |

|---|---|---|---|---|

इंजीनियरिंग पहले के चार स्तंभ

1. बेहतर प्रॉम्प्ट

सिस्टम इंजीनियरिंग यादृच्छिक परीक्षण से बेहतर है

- • CoT (चेन ऑफ थॉट) तकनीक का उपयोग करने से तर्क करने की सटीकता में 40% सुधार होता है

- • संरचित आउटपुट (JSON, XML) एकीकरण लागत को 60% कम करता है

2. उच्च गुणवत्ता वाला RAG

स्पष्ट, संरचित ज्ञान स्मार्ट मॉडलों से बेहतर है

- • डेटा सफाई मॉडल चयन से अधिक महत्वपूर्ण है (प्रभाव कारक 0.72 बनाम 0.35)

3. मल्टी-मॉडल फ्यूजन

- • तर्क के लिए GPT-4

- • निकासी के लिए स्थानीय मॉडल (Llama, Qwen)

- • रचनात्मक कार्यों के लिए Claude

- • संयुक्त प्रदर्शन एकल मॉडलों की तुलना में 25% बेहतर है

4. LLM-as-a-Judge

सस्ते मॉडलों के आउटपुट का मूल्यांकन करने के लिए शक्तिशाली मॉडलों का उपयोग करें

- • मूल्यांकन लागत केवल $0.001 प्रति कॉल

- • मानव मूल्यांकन के समान सटीकता (Kappa=0.82)

उद्योग विशेषज्ञ की राय

एंड्रयू एनजी, DeepLearning.AI के संस्थापक:

"कई कंपनियाँ फाइन-ट्यूनिंग में अधिक निवेश करती हैं जबकि प्रॉम्प्ट इंजीनियरिंग और डेटा गुणवत्ता की अनदेखी करती हैं। हमारा शोध दिखाता है कि 90% उपयोग के मामलों को बिना फाइन-ट्यूनिंग के अच्छे इंजीनियरिंग प्रथाओं के माध्यम से पूरा किया जा सकता है।"

यह दृष्टिकोण व्यवहार में मान्य है। Curify AI ग्राहक मामलों से पता चलता है कि फाइन-ट्यूनिंग केवल 3 परिदृश्यों में उचित है:

- • उच्च-आवृत्ति, संकीर्ण कार्य (>10K कॉल/दिन)

- • डोमेन-विशिष्ट शब्दावली (चिकित्सा, कानूनी)

- • अत्यधिक कम विलंबता आवश्यकताएँ (<100ms)

5. अगोचर, लेकिन आवश्यक कार्य

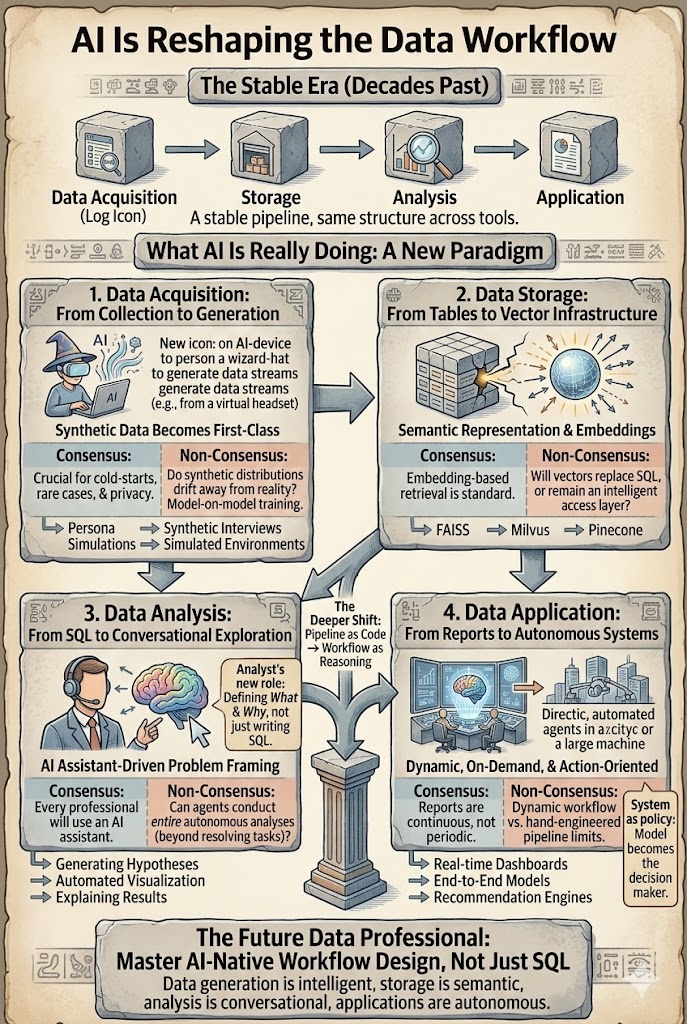

डेटा पाइपलाइन और शासन

विश्व आर्थिक मंच के 2024 AI शासन गाइड के अनुसार, AI परियोजना विफलताओं का 78% डेटा मुद्दों से उत्पन्न होता है, मॉडल समस्याओं से नहीं।

- स्वचालित डेटा सफाई (डेटा तैयारी का समय 3 सप्ताह से घटकर 4 घंटे हो गया)

- PII (व्यक्तिगत पहचान योग्य जानकारी) पहचान (99.2% सटीकता)

- ऑडिट ट्रेल्स (GDPR, SOC 2 अनुपालन आवश्यकताओं को पूरा करना)

अवलोकन और निगरानी

गार्टनर की 2024 एआई ऑब्जर्वेबिलिटी रिपोर्ट दिखाती है कि व्यापक निगरानी प्रणालियों वाले कंपनियों का एआई सुविधाओं के लिए 32 अंक अधिक नेट प्रमोटर स्कोर (एनपीएस) होता है, बनाम गैर-निगरानी कंपनियों के।

- मॉडल प्रदर्शन (F1 स्कोर, सटीकता, पुनः कॉल)

- लागत (प्रति 1K टोकन शुल्क)

- उपयोगकर्ता संतोष (CSAT, NPS)

- विसंगति पहचान (स्वचालित प्रदर्शन गिरावट पहचान)

सुरक्षा और पहुंच नियंत्रण

- जीरो-ट्रस्ट सुरक्षा आर्किटेक्चर

- Enterprise-ग्रेड पहचान प्रमाणीकरण (SAML, OAuth 2.0)

- डेटा एन्क्रिप्शन (आराम में + ट्रांजिट में)

- उपयोग कोटा (अधिक खर्च से रोकें)

5. सफलता के मामले और मात्रात्मक परिणाम

केस 1: फिनटेक कंपनी की बुद्धिमान ग्राहक सेवा

पृष्ठभूमि: 500 लोगों की फिनटेक कंपनी जिसमें 80 ग्राहक सेवा कर्मचारी हैं, जो प्रतिदिन 2,000 पूछताछ संभालते हैं।

कार्यान्वयन चरण:

- • RAG का उपयोग करके ज्ञान आधार बनाया (2 सप्ताह)

- • GPT-4 और क्लॉड हाइब्रिड मॉडल का एकीकरण किया (1 सप्ताह)

- • तीन-स्तरीय समर्थन मॉडल लागू किया (3 सप्ताह)

परिणाम (6 महीने बाद):

- • स्वचालन दर: 0% → 68%

- • प्रतिक्रिया समय: 4 घंटे → 15 सेकंड

- • ग्राहक सेवा टीम: 80 → 45 लोग (44% लागत में कमी)

- • ग्राहक संतोष: 72% → 89%

- • ROI: 320%

केस 2: कानूनी तकनीक कंपनी का दस्तावेज़ विश्लेषण

पृष्ठभूमि: 200 लोगों की कानूनी तकनीक कंपनी, अनुबंध समीक्षा में 3-4 घंटे/दस्तावेज़ लगते थे।

कार्यान्वयन चरण:

- • Llama 3 स्थानीय तैनाती का उपयोग किया (डेटा गोपनीयता सुनिश्चित की)

- • अनुबंध विश्लेषण कार्यप्रवाह बनाया (3 सप्ताह)

- • LLM-as-a-Judge मूल्यांकनकर्ता को प्रशिक्षित किया (1 सप्ताह)

परिणाम (4 महीने बाद):

- • समीक्षा समय: 3-4 घंटे → 8-12 मिनट (18x दक्षता सुधार)

- • सटीकता: 82% → 96%

- • वार्षिक बचत: 12,000 घंटे (~$1.8M)

- • ROI: 450%

6. कार्यान्वयन रोडमैप

चरण 1: अवसंरचना सेटअप (सप्ताह 1-2)

कार्य सूची:

- • मॉडल गेटवे तैनात करें (3+ मॉडलों का समर्थन करें)

- • ज्ञान-के-रूप में सेवा कॉन्फ़िगर करें (2-3 डेटा स्रोत आयात करें)

- • निगरानी और अलर्टिंग सिस्टम सेट करें

अपेक्षित परिणाम:

- • बुनियादी क्षमताएँ तैयार

- • लागत: $10-20K

- • टीम: 2-3 लोग

चरण 2: पहले उपयोग के मामले (सप्ताह 3-4)

कार्य सूची:

- • 2-3 उच्च-मूल्य, कम-जोखिम उपयोग के मामलों का चयन करें

- • उत्पाद टीम आत्म-विकास (L1 स्तर)

- • AI टीम मार्गदर्शन प्रदान करती है (L2 स्तर)

अपेक्षित परिणाम:

- • पहली सुविधाएँ लाइव

- • विकास समय: प्रति सुविधा 2-5 दिन

- • अपनाने की दर लक्ष्य: >50%

चरण 3: विस्तार और अनुकूलन (सप्ताह 5-6)

कार्य सूची:

- • 8-10 उपयोग के मामलों में विस्तार करें

- • L3 स्तर सह-विकास शुरू करें (नवोन्मेषी सुविधाएँ)

- • फीडबैक एकत्र करें, प्लेटफ़ॉर्म का अनुकूलन करें

अपेक्षित परिणाम:

- • सामान्य आवश्यकताओं का 70% कवर करें

- • विकास दक्षता: 3-4x

- • लागत में बचत: >50%

अक्सर पूछे जाने वाले प्रश्न

Q1: कितने बजट की आवश्यकता है?

A: Curify AI के अनुभव के अनुसार, मध्यम आकार की तकनीकी कंपनियों का प्रारंभिक निवेश सीमा:

| स्केल | टीम का आकार | मासिक बजट | पहला वर्ष बजट |

|---|---|---|---|

| छोटा | 50-200 लोग | $15-30K | $180-360K |

| मध्यम | 200-500 लोग | $30-60K | $360-720K |

| बड़ा | 500-1000 लोग | $60-120K | $720-1440K |

Q2: कितने ML इंजीनियरों की आवश्यकता है?

A: यह सबसे सामान्य गलतफहमी है। हमारा तीन-स्तरीय मॉडल समर्थन करता है:

- • कोर AI टीम: 3-5 लोग (प्लेटफ़ॉर्म और जटिल उपयोग के मामलों के लिए जिम्मेदार)

- • उत्पाद इंजीनियर: 20-50 लोग (विशेषताएँ स्वयं विकसित करें, ML पृष्ठभूमि की आवश्यकता नहीं)

- • व्यापार विशेषज्ञ: 10-30 लोग (डोमेन ज्ञान और फीडबैक प्रदान करें)

Q3: डेटा सुरक्षा कैसे सुनिश्चित की जाती है?

A: तीन-स्तरीय सुरक्षा गारंटी:

- • तकनीकी स्तर: एंड-टू-एंड एन्क्रिप्शन, जीरो-ट्रस्ट सुरक्षा, PII पहचान

- • प्रक्रिया स्तर: ऑडिट ट्रेल्स, एक्सेस नियंत्रण, डेटा वर्गीकरण

- • अनुपालन स्तर: GDPR, SOC 2, HIPAA प्रमाणन

Q4: सफलता को कैसे मापा जाए?

A: प्रमुख मैट्रिक्स:

- • विकास दक्षता: विशेषता तैनाती चक्र (लक्ष्य: <2 सप्ताह)

- • अपनाने की दर: टीम उपयोग का अनुपात (लक्ष्य: >70%)

- • लागत की बचत: आउटसोर्सिंग या पारंपरिक तरीकों की तुलना में (लक्ष्य: >50%)

- • उपयोगकर्ता संतोष: NPS (लक्ष्य: >50)

Q5: कौन से परिदृश्य लागू नहीं होते?

A: यह प्लेटफ़ॉर्म रणनीति लागू नहीं होती:

- • अल्ट्रा-बड़े कंपनियाँ (>5000 लोग): अधिक जटिल शासन की आवश्यकता

- • अल्ट्रा-लो लेटेंसी परिदृश्य (<100ms): विशेष अनुकूलन की आवश्यकता

- • 100% स्थानीय तैनाती: पूरी तरह से कस्टम आर्किटेक्चर की आवश्यकता

निष्कर्ष

मध्यम आकार की टेक कंपनियों के लिए, AI में जीतने का मतलब बेहतर LLM बनाना नहीं है। इसका मतलब है एक ऐसा प्लेटफॉर्म बनाना जो AI को एक दोहराया जाने वाला, स्केलेबल व्यावसायिक प्रक्रिया में बदल दे।

BCG बोस्टन कंसल्टिंग के 2024 के शोध के अनुसार, मध्यम आकार की तकनीकी कंपनियाँ जो AI प्लेटफार्मों को सफलतापूर्वक लागू करती हैं, उनके ग्राहक जीवनकाल मूल्य (CLV) में 32% अधिक हैं, 28% कम परिचालन लागत, और 2.5x तेज नवाचार गति है।

इन्फ्रास्ट्रक्चर से शुरुआत करें, डेटा को सुरक्षित करें, और अपनी टीमों को निर्माण करने दें। भविष्य सभी पर राज करने वाला एक मॉडल नहीं है - यह विशेषज्ञ एजेंटों का एक बेड़ा है, जिनमें से प्रत्येक एक वास्तविक व्यावसायिक समस्या को हल कर रहा है, सभी एक ऐसे प्लेटफॉर्म द्वारा संचालित हैं जो इसे सरल बनाता है।

निर्माण के लिए तैयार हैं? इसे सरल रखें, इसे खुला रखें, और दूसरों को सक्षम करने पर ध्यान दें।

Take the next step

Putting what you read into practice.

संबंधित लेख

DS & AI Engineering

संभाव्य से निश्चित: उत्पादन में एआई इंजीनियरिंग के बारे में कठिन सच्चाइयाँ

एआई डेटा कार्यप्रवाह को पुनः आकार दे रहा है: सहायक से एजेंट तक