Plongée approfondie : aperçu technique de la transcription

La plupart des outils de transcription s'arrêtent à la conversion de la parole en texte. Cette analyse approfondie présente le pipeline de transcription complet de Curify : comment l'audio est séparé de la musique de fond, comment WhisperX fonctionne sur la piste nettoyée, comment la diarisation des locuteurs divise les voix qui se chevauchent, et comment l'alignement forcé remet des horodatages au niveau des mots sur la transcription afin que la sortie puisse alimenter les outils de sous-titrage, de doublage et de traduction en aval à [/tools/video-transcript-generator](/tools/video-transcript-generator). Si vous souhaitez intégrer la transcription dans un pipeline plus large plutôt que de simplement télécharger un SRT, c'est la couche que la plupart des articles de blog omettent.

Pipeline de transcription vidéo de bout en bout

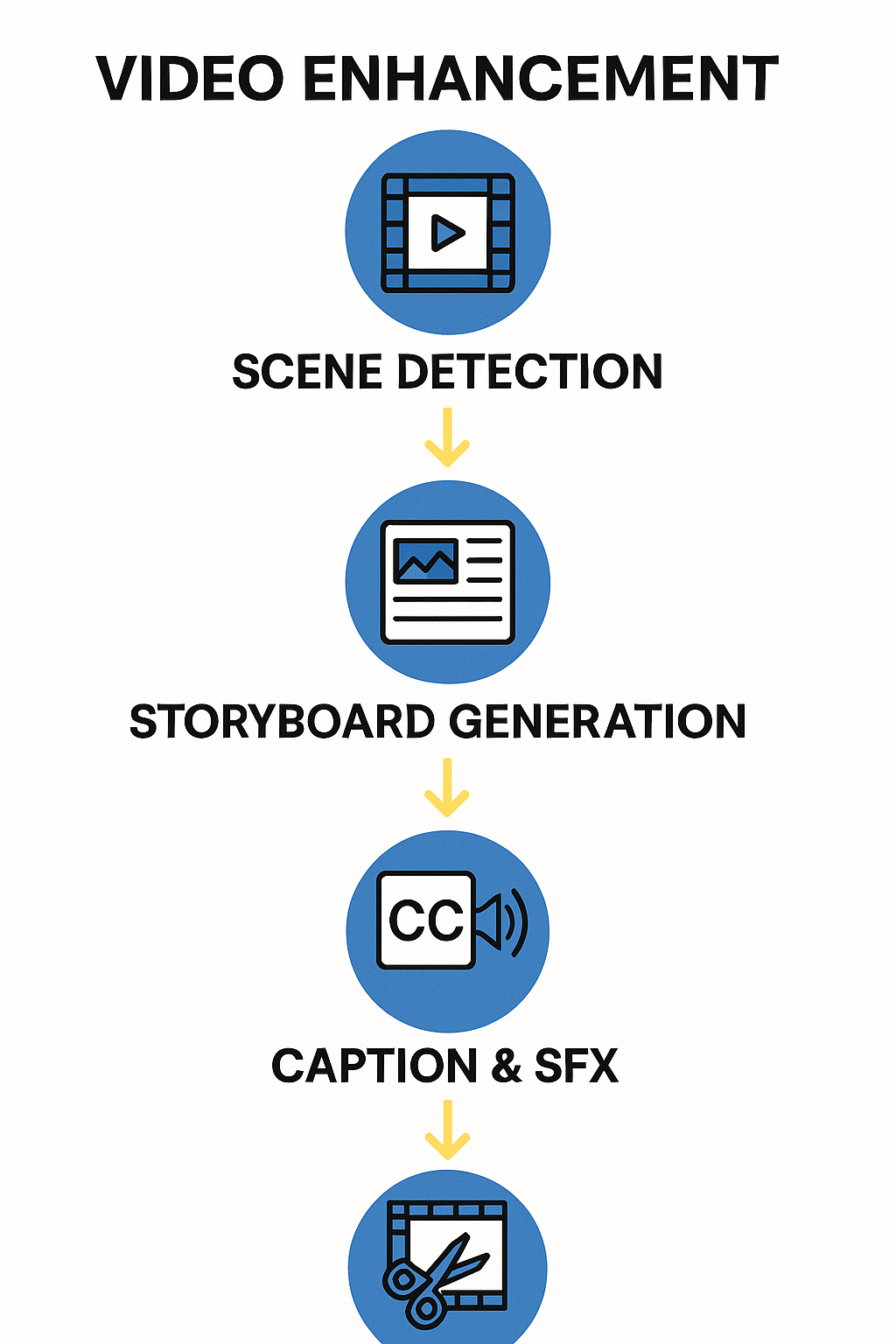

Un pipeline de transcription vidéo de qualité production transforme le contenu vidéo brut en texte structuré et synchronisé dans le temps à travers plusieurs étapes de traitement sophistiquées. Le flux de travail complet : Vidéo → Extraction audio → Segmentation → ASR (Reconnaissance automatique de la parole) → Alignement → Diarisation des intervenants → Post-traitement.

Chaque étape aborde des défis techniques spécifiques : l'extraction audio isole la piste vocale, la segmentation divise le long audio en morceaux gérables, l'ASR convertit la parole en texte, l'alignement fournit des horodatages au niveau des mots, la diarisation identifie qui a parlé quand, et le post-traitement nettoie et formate la sortie finale.

Des systèmes modernes comme le pipeline de Curify atteignent une précision de plus de 95 % même dans des conditions difficiles en combinant Conv-TasNet pour la séparation audio, WhisperX pour la reconnaissance vocale, et des algorithmes de clustering avancés pour l'identification des intervenants. Cette plongée technique approfondie explore chaque composant et leurs stratégies d'intégration.

Pourquoi l'architecture technique est importante pour la transcription

Compromis entre précision et vitesse : Des modèles plus grands offrent une meilleure précision mais augmentent le temps de traitement et les coûts computationnels. Les systèmes de production doivent équilibrer ces facteurs en fonction des exigences du cas d'utilisation.

Défis de scalabilité : La transcription en temps réel nécessite un traitement en streaming et une inférence à faible latence, tandis que le traitement par lots peut optimiser le débit et l'efficacité des coûts.

Complexité multilingue : Le code-switching (mélange de langues au sein des phrases) et le contenu interlingual nécessitent des modèles spécialisés capables de maintenir le contexte à travers les frontières linguistiques.

Fiabilité de production : Les systèmes d'entreprise ont besoin de mécanismes de basculement, de surveillance de la qualité et de récupération automatique des erreurs pour gérer les cas limites qui se produisent inévitablement avec du contenu du monde réel.

Composants clés du pipeline

Prétraitement audio et segmentation

Le pipeline commence par un prétraitement audio sophistiqué utilisant Conv-TasNet pour la séparation source et la segmentation audio. Cette étape isole la parole humaine de la musique de fond, du bruit ambiant et d'autres sources audio grce à la séparation audio dans le domaine temporel.

Mise en œuvre technique :

# Séparation audio utilisant Conv-TasNet

import torch

import torchaudio

from conv_tasnet import ConvTasNet

# Initialiser le modèle de séparation de source

separator = ConvTasNet(

n_bases=512, # Nombre de fonctions de base

kernel_size=16, # Taille du noyau de convolution

stride=8, # Pas pour les convolutions temporelles

n_layers=8, # Nombre de couches de convolution

n_src=2 # Nombre de sources à séparer

)

# Traiter la forme d'onde audio à 16 kHz

audio_tensor, sample_rate = torchaudio.load('input_video.wav')

if sample_rate != 16000:

resampler = torchaudio.transforms.Resample(sample_rate, 16000)

audio_tensor = resampler(audio_tensor)

# Séparer les sources

with torch.no_grad():

separated_sources = separator(audio_tensor)

speech_source = separated_sources[0] # Extraire la parole principale

L'architecture Conv-TasNet utilise des structures de codage-décodage convolutionnelles avec des réseaux de convolution temporelle pour séparer les sources audio directement à partir des formes d'onde brutes, évitant ainsi la perte d'information associée aux approches basées sur les spectrogrammes.

ASR (Reconnaissance de la parole) avec WhisperX

La parole propre alimente WhisperX, une version améliorée du modèle Whisper d'OpenAI optimisée pour la précision et la vitesse de transcription. Le système gère plusieurs intervenants, dialectes et accents grce à la diarisation des intervenants—segmentant automatiquement l'audio par identité de l'intervenant.

Mise en œuvre technique :

# Reconnaissance vocale avancée utilisant WhisperX

import whisperx

import torch

from whisperx.utils import get_writer

# Charger le modèle WhisperX pour la transcription

model = whisperx.load_model("large-v3", device="cuda")

# Effectuer la transcription avec des horodatages au niveau des mots et la diarisation des intervenants

result = model.transcribe(

speech_source,

batch_size=32, # Traiter par lots pour l'efficacité

language="auto", # Détection automatique de la langue

task="transcribe",

word_timestamps=True, # Activer le timing au niveau des mots

print_progress=True

)

# Aligner la sortie de whisper en utilisant l'alignement forcé

model_a, metadata = whisperx.load_align_model(

language_code=result["language"],

device="cuda"

)

result = whisperx.align(

result["segments"],

model_a,

metadata,

speech_source,

device="cuda"

)

# Assigner des étiquettes aux intervenants

diarize_model = whisperx.DiarizationPipeline(

use_auth_token=False,

device="cuda"

)

diarize_segments = diarize_model(speech_source)

result = whisperx.assign_word_speakers(diarize_segments, result)

WhisperX améliore le modèle de base Whisper grce à une inférence optimisée, une meilleure diarisation des intervenants et une précision améliorée des horodatages au niveau des mots. L'étape d'alignement forcé garantit une synchronisation précise entre l'audio et la transcription.

Alignement forcé et horodatages au niveau des mots

L'alignement forcé fournit des horodatages précis au niveau des mots qui sont essentiels pour des sous-titres de haute qualité, la synchronisation vidéo et le traitement linguistique en aval. À cette étape, un modèle acoustique dédié prend le signal audio et une transcription initiale du système ASR et les aligne à une granularité beaucoup plus fine que la sortie brute de l'ASR. Au lieu de seulement savoir quand chaque phrase ou segment commence et se termine, le système estime le début et la fin exacts de chaque mot, parfois même au niveau des phonèmes. Ce processus d'alignement utilise généralement des modèles de séquence probabilistes, tels que des modèles de Markov cachés ou des encodeurs acoustiques neuronaux, pour calculer le timing le plus probable de chaque mot donné les preuves acoustiques et la transcription. Le résultat est une structure riche où chaque mot est annoté avec un temps de début, un temps de fin et des scores de confiance, et les segments sont augmentés avec des métadonnées de timing détaillées. Ces horodatages précis permettent un rendu de sous-titres précis au niveau des images, permettent aux éditeurs de sauter directement à des parties spécifiques de la parole dans une chronologie vidéo, et créent une base temporelle fiable pour des tches ultérieures telles que la traduction automatique, le doublage, l'analyse de synchronisation labiale ou la recherche basée sur le contenu à travers de grandes bibliothèques de médias.

Mise en œuvre de la diarisation des intervenants

La diarisation des intervenants est responsable de répondre à la question "qui a parlé quand" tout au long d'un fichier audio ou vidéo, transformant une transcription brute en une conversation structurée et consciente des intervenants. Le système divise d'abord l'audio en segments homogènes qui sont susceptibles de contenir un seul intervenant dominant, puis convertit chaque segment en une représentation numérique compacte appelée embedding d'intervenant, qui capture des caractéristiques telles que le timbre, les motifs de hauteur et le style de parole. En utilisant ces embeddings, des algorithmes de clustering regroupent les segments qui sonnent similaires en identités d'intervenants cohérentes, sans nécessiter de connaissance préalable du nombre d'intervenants présents ou de qui ils sont. Des pipelines de diarisation avancés peuvent estimer de manière adaptative le nombre d'intervenants, affiner les frontières où les intervenants se chevauchent et lisser les étiquettes afin qu'une seule personne se voie attribuer le même ID d'intervenant à travers de longs enregistrements. La transcription diarisation résultante associe chaque segment, et souvent chaque mot, à une étiquette d'intervenant stable, permettant des applications telles que des comptes rendus de réunion avec des résumés par intervenant, des analyses de centres d'appels, des recommandations de contenu personnalisées, et des sous-titres plus clairs qui indiquent quel personnage ou participant parle à chaque moment.

Post-traitement et assurance qualité

L'étape de post-traitement et d'assurance qualité transforme les sorties brutes du modèle en une transcription polie, prête à la production, qui est adaptée aux utilisateurs finaux et aux systèmes en aval. Le post-traitement commence généralement par des étapes de normalisation telles que la correction de la casse, l'expansion ou la normalisation des nombres, le traitement des acronymes et la restauration de la ponctuation afin que le texte se lise comme une prose naturelle plutôt que comme une séquence plate de jetons. Les horodatages sont ensuite formatés en codes temporels de sous-titres standardisés et la transcription est segmentée en unités de sous-titres lisibles ou en paragraphes selon la longueur, la durée et les frontières linguistiques. L'assurance qualité ajoute une couche de validation au-dessus de cette transcription nettoyée : elle agrège les scores de confiance au niveau des mots en métriques au niveau des segments, détecte des passages à confiance exceptionnellement basse, des écarts de timing abrupts ou des répétitions suspectes, et les signale pour révision humaine ou re-traitement automatique. Des vérifications supplémentaires peuvent faire respecter des guides de style, supprimer des disfluences ou des mots de remplissage lorsque cela est approprié, et garantir que les étiquettes des intervenants restent cohérentes tout au long du fichier. Ensemble, ces étapes de post-traitement et d'assurance qualité garantissent que la sortie finale reflète non seulement ce qui a été dit, mais répond également aux normes de précision, de lisibilité et de formatage requises pour des flux de travail de transcription, de localisation et d'accessibilité professionnels.

Défis techniques et solutions

Discours chevauchant : Plusieurs intervenants parlant simultanément créent des défis pour l'ASR. Les solutions incluent la séparation des sources audio, des modèles multi-intervenants et des algorithmes de diarisation sophistiqués.

Changement multilingue : Le code-switching entre les langues nécessite des modèles capables de gérer plusieurs langues simultanément. Les systèmes avancés utilisent l'identification de langue et des modèles multilingues spécialisés.

Environnements bruyants : La musique de fond, le bruit ambiant et la mauvaise qualité audio réduisent la précision de la transcription. Les techniques de prétraitement audio et de séparation des sources atténuent ces problèmes.

Latence vs. Précision : Les applications en temps réel nécessitent une faible latence mais peuvent sacrifier la précision. Les systèmes de production doivent équilibrer ces exigences concurrentes en fonction du cas d'utilisation.

Conception du système de production

Traitement par lots vs en streaming : Le traitement par lots optimise les coûts et le débit, tandis que le traitement en streaming permet une transcription en temps réel pour des applications en direct.

Optimisation de l'inférence GPU : La quantification des modèles, le traitement par lots et la parallélisation des tenseurs réduisent les coûts computationnels tout en maintenant la précision.

Orchestration du pipeline : Les files d'attente de messages (comme Azure Service Bus) coordonnent entre les étapes de traitement, permettant des flux de travail évolutifs et tolérants aux pannes.

Stratégies d'optimisation des coûts : Le traitement par lots dynamique, les instances spot et la compression des modèles réduisent les coûts d'infrastructure tout en maintenant les accords de niveau de service.

Comparaison de l'architecture technique

| Composant | ASR de base | WhisperX | Pipeline d'entreprise |

|---|---|---|---|

| Traitement audio | Canal unique | Filtrage de base | Séparation Conv-TasNet |

| Reconnaissance vocale | HMM/GMM | Transformateur | WhisperX + ajustement fin |

| Diarisation des intervenants | Aucune | Clustering de base | Clustering avancé + profilage vocal |

| Alignement forcé | Aucune | Alignement de base | Alignement précis au niveau des mots |

| Assurance qualité | Manuelle | Scoring de confiance | Révision automatisée + humaine |

| Scalabilité | Limitée | Moyenne | Échelle d'entreprise |

| Précision | 70-85% | 90-95% | 95-98% |

Compromis techniques :

- Latence vs. Précision : Des modèles plus grands offrent une meilleure précision mais augmentent le temps de traitement

- Coût computationnel : L'accélération GPU est essentielle pour le traitement à l'échelle de la production

- Taille du modèle : La quantification réduit l'utilisation de la mémoire mais peut impacter la précision dans des cas limites

- Support linguistique : Les modèles multilingues nécessitent plus de stockage et de ressources computationnelles

Architecture de transcription de production de Curify

Le système de transcription de Curify représente une mise en œuvre de qualité production des technologies de traitement audio de pointe, conçu pour l'échelle, la précision et la fiabilité. Notre architecture combine plusieurs réseaux neuronaux spécialisés en un pipeline unifié qui traite le contenu vidéo de bout en bout avec un minimum d'intervention humaine.

Composants techniques clés :

Pile de traitement audio : Utilisant Conv-TasNet pour la séparation de source et WhisperX pour la transcription, Curify atteint une précision de plus de 95 % même dans des environnements bruyants. Le système traite l'audio à une résolution de 16 kHz, appliquant une réduction de bruit en temps réel et une diarisation des intervenants pour isoler les voix individuelles.

Pipeline d'assurance qualité : Le scoring de confiance automatisé identifie les erreurs potentielles de transcription pour révision humaine. Le système utilise des modèles linguistiques entraînés sur une terminologie spécifique au domaine pour améliorer la précision pour le contenu technique, avec des capacités d'ajustement fin pour le vocabulaire spécifique à l'industrie.

Infrastructure : Déployé sur des clusters GPU avec traitement distribué, gérant plus de 100 travaux de transcription simultanés. Le système traite 1 heure de vidéo en environ 2 minutes, selon la complexité du contenu et la qualité audio.

Orchestration du pipeline : Les files d'attente Azure Service Bus coordonnent entre les étapes de traitement, permettant des flux de travail tolérants aux pannes qui peuvent gérer les échecs et les réessais automatiquement. Le système prend en charge à la fois le traitement par lots pour l'efficacité des coûts et le streaming pour des applications en temps réel.

🎯 Prêt à mettre en œuvre des pipelines de transcription avancés pour votre organisation ? Explorez les solutions de transcription technique de Curify

L'avenir de la technologie de transcription vidéo

La technologie de transcription vidéo a évolué des systèmes de reconnaissance vocale basiques vers des pipelines sophistiqués en plusieurs étapes qui combinent des avancées dans les réseaux neuronaux, le traitement audio et les techniques d'optimisation. Les systèmes modernes comme le pipeline de Curify démontrent comment Conv-TasNet pour la séparation audio, WhisperX pour la transcription et une assurance qualité avancée peuvent être intégrés dans des flux de travail de production.

Pour les équipes techniques et les développeurs, le point clé est que la transcription vidéo n'est plus un problème de recherche mais un défi d'ingénierie résolu. Les opportunités restantes résident dans l'optimisation, les cas particuliers et l'intégration plutôt que dans des limitations technologiques fondamentales. À mesure que ces systèmes continuent de s'améliorer grce à de meilleures architectures de modèles et à des ensembles de données d'entraînement plus larges, nous nous rapprochons d'un avenir où la transcription parfaite est disponible à grande échelle pour tout type de contenu.

L'architecture technique décrite ici représente l'état de l'art actuel en 2026, mais le domaine continue d'évoluer rapidement. La transcription en temps réel, l'identification de locuteurs sans échantillon et la résumation automatisée de contenu sont déjà des capacités émergentes qui transformeront davantage notre approche du traitement et de l'analyse du contenu vidéo.

Articles Connexes

video-translation-dubbing

How We Built an AI Content Production System (Not Just Tools)

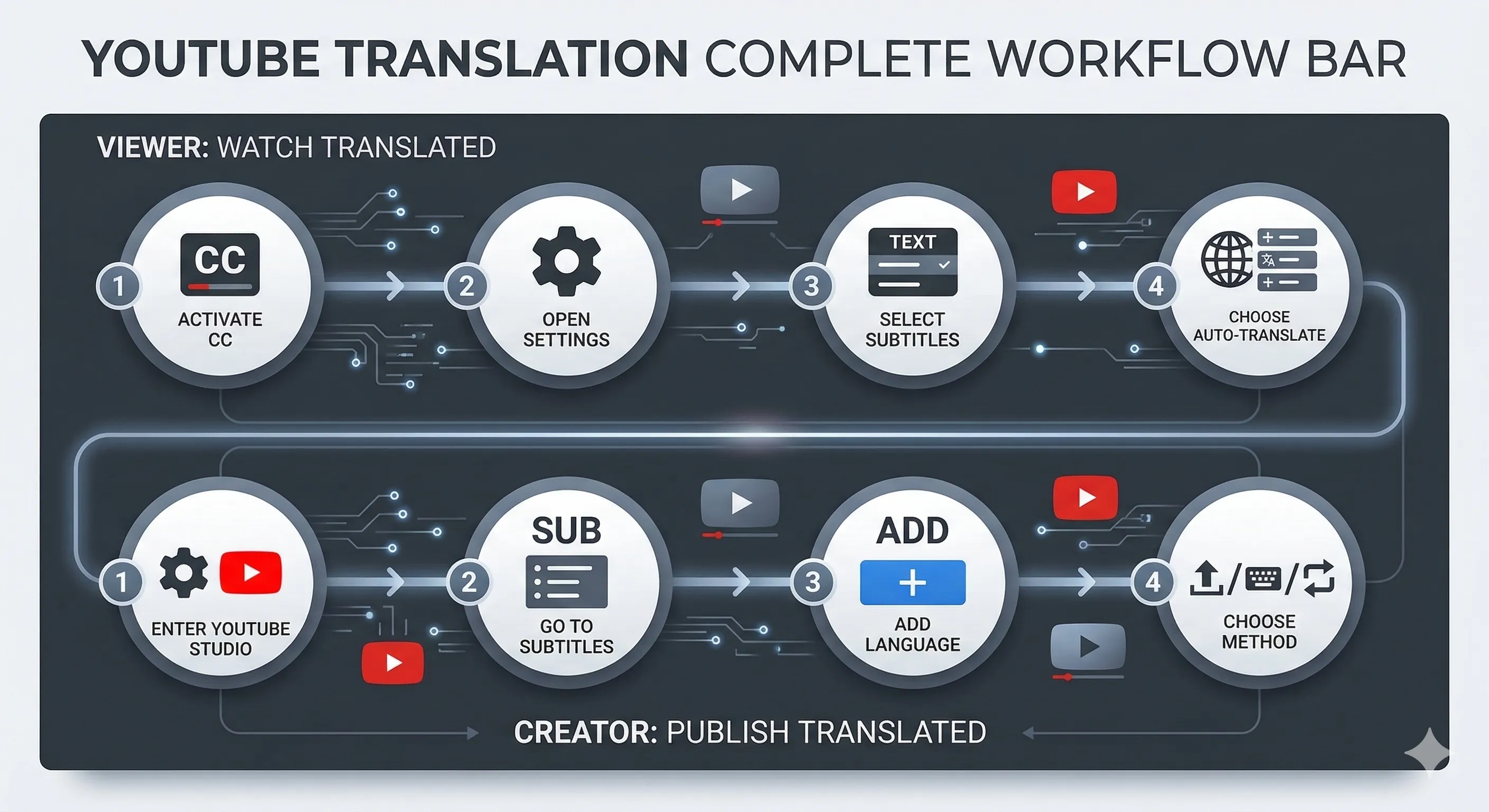

Inside Curify's Video Translation Pipeline: A Technical Deep-Dive