Synchronisation labiale IA en production : Comment MuseTalk et Sync.co fonctionnent vraiment

Allez au-delà de la surface et explorez l'architecture technique qui alimente les systèmes modernes de synchronisation labiale IA. Cette plongée approfondie examine l'implémentation open-source de MuseTalk, l'API commerciale de Sync.co et la conception de pipeline de production pour le doublage vidéo à l'échelle entreprise.

Architecture de Pipeline de Synchronisation Labiale de Bout en Bout

Un pipeline de synchronisation labiale IA de niveau production transforme les entrées vidéo et audio en contenu doublé parfaitement synchronisé à travers plusieurs étapes de traitement sophistiquées. Le flux de travail complet : Vidéo d'Entrée → Détection de Visage → Extraction de Points de Repère → Analyse Audio → Génération de Mouvements de Lèvres → Reconstruction Faciale → Post-traitement → Vidéo de Sortie.

Chaque étape aborde des défis techniques spécifiques : la détection de visage isole les locuteurs, l'extraction de points de repère suit les caractéristiques faciales, l'analyse audio traite les modèles de discours, la génération de mouvements de lèvres crée des animations synchronisées, la reconstruction faciale mélange de nouvelles lèvres avec des expressions existantes, et le post-traitement assure une intégration fluide.

Des systèmes modernes comme MuseTalk et des API commerciales atteignent plus de 90 % de réalisme grce à des combinaisons de GANs (Réseaux Antagonistes Génératifs), de modèles de diffusion et d'algorithmes de cohérence temporelle. Cette plongée technique explore chaque composant, leurs stratégies d'intégration et les compromis entre solutions open-source et commerciales.

Pourquoi l'Architecture Technique Est Importante pour la Synchronisation Labiale

Réalité vs. Coût Computationnel : Des modèles de résolution plus élevée produisent des résultats plus réalistes mais nécessitent des ressources GPU significatives et un temps de traitement. Les systèmes de production doivent équilibrer la qualité avec les coûts opérationnels.

Cohérence Temporelle : Maintenir des transitions fluides entre les images et prévenir le scintillement ou les artefacts nécessite une modélisation temporelle sophistiquée et des contraintes de cohérence à travers toute la séquence vidéo.

Préservation de l'Identité : Le système doit maintenir l'identité originale du locuteur tout en ne modifiant que les mouvements de la bouche. Cela nécessite une séparation soigneuse des caractéristiques d'identité des mouvements faciaux liés à la parole.

Défis de Scalabilité : Les applications en temps réel nécessitent un traitement en streaming et une inférence à faible latence, tandis que le traitement par lots peut être optimisé pour le débit et l'efficacité des coûts dans les environnements de production.

Composants Techniques Clés

Détection de Visage et Extraction de Points de Repère

Le pipeline commence par une technologie de détection de visage sophistiquée capable de localiser les locuteurs dans n'importe quelle image vidéo. Une fois les visages identifiés, le système extrait des points de repère faciaux précis - cartographiant 468 points clés autour de la bouche, des yeux et d'autres caractéristiques faciales.

Cette cartographie détaillée permet au système de comprendre la forme et la position exactes de la bouche du locuteur à tout moment, créant la base pour une synchronisation labiale précise. La technologie fonctionne de manière fiable dans différentes conditions d'éclairage, angles, et même avec plusieurs personnes dans le cadre.

Traitement Audio et Extraction de Caractéristiques

Le pipeline de traitement audio convertit la parole cible en caractéristiques temporelles entraînant la génération de synchronisation labiale. Les systèmes extraient des mel-spectrogrammes (80 bins mel, 1024 FFT, 160 hop), des MFCC et des alignements de phonèmes via des embeddings Wav2Vec2 (facebook/wav2vec2-base) et un prétraitement librosa à 16kHz SR. L'implémentation charge la forme d'onde via librosa.load(), calcule librosa.feature.melspectrogram() converti en échelle dB, traite à travers Wav2Vec2Processor/Wav2Vec2Model pour des embeddings contextuels (last_hidden_state), et applique un alignement forcé (get_phoneme_alignment(audio_path, transcript)) pour un timing viseme précis. Le dictionnaire retourné contient mel_spectrogram, audio_embeddings et phoneme_alignment—capturant les enveloppes spectrales, les frontières temporelles des phonèmes et les motifs de discours sémantiques qui se mappent directement aux cinématiques articulatoires de la bouche.

Génération de Mouvements de Lèvres avec des Réseaux Neuronaux

La génération de synchronisation labiale utilise des architectures neuronales sophistiquées pour mapper les caractéristiques audio aux mouvements de la bouche correspondants. Les systèmes modernes emploient des combinaisons de réseaux de convolution temporelle, de transformateurs et de GANs pour générer des formes de lèvres réalistes qui correspondent à l'audio cible tout en préservant l'identité du locuteur.

Implémentation Technique :

Génération de mouvements de lèvres utilisant un GAN temporel

import torch

import torch.nn as nn

class LipSyncGenerator(nn.Module):

def __init__(self, audio_dim=80, landmark_dim=51, hidden_dim=512):

super().__init__()

# Encodeur audio

self.audio_encoder = nn.Sequential(

nn.Conv1d(audio_dim, hidden_dim, kernel_size=3, padding=1),

nn.ReLU(),

nn.Conv1d(hidden_dim, hidden_dim, kernel_size=3, padding=1),

nn.ReLU(),

)

# Transformateur temporel pour la modélisation de séquence

self.temporal_transformer = nn.TransformerEncoder(

nn.TransformerEncoderLayer(

d_model=hidden_dim,

nhead=8,

dim_feedforward=hidden_dim * 4

),

num_layers=6

)

# Décodeur de points de repère

self.landmark_decoder = nn.Sequential(

nn.Linear(hidden_dim, hidden_dim),

nn.ReLU(),

nn.Linear(hidden_dim, landmark_dim),

nn.Tanh() # Normaliser les coordonnées des points de repère

)

# Couche de préservation de l'identité

self.identity_encoder = nn.Sequential(

nn.Linear(landmark_dim * 2, hidden_dim), # Points de repère actuels + de référence

nn.ReLU(),

nn.Linear(hidden_dim, hidden_dim)

)

def forward(self, audio_features, reference_landmarks):

# Encoder les caractéristiques audio

audio_encoded = self.audio_encoder(audio_features)

audio_encoded = audio_encoded.transpose(1, 2) # (B, T, D)

# Appliquer la modélisation temporelle

temporal_features = self.temporal_transformer(audio_encoded)

# Générer des mouvements de points de repère

generated_landmarks = self.landmark_decoder(temporal_features)

# Préserver l'identité du locuteur

identity_features = self.identity_encoder(

torch.cat([generated_landmarks, reference_landmarks], dim=-1)

)

# Mélanger les mouvements générés avec la préservation de l'identité

final_landmarks = generated_landmarks + 0.1 * identity_features

return final_landmarks

Initialiser et entraîner le générateur

generator = LipSyncGenerator()

optimizer = torch.optim.Adam(generator.parameters(), lr=1e-4)

Boucle d'entraînement avec perte antagoniste

def train_lip_sync_model(generator, discriminator, dataloader, epochs=100):

for epoch in range(epochs):

for batch in dataloader:

audio_features, reference_landmarks, target_landmarks = batch

# Générer des points de repère factices

fake_landmarks = generator(audio_features, reference_landmarks)

# Entraînement antagoniste

real_loss = discriminator(target_landmarks)

fake_loss = discriminator(fake_landmarks)

# Perte du générateur (antagoniste + reconstruction)

g_loss = -fake_loss.mean() + nn.MSELoss()(fake_landmarks, target_landmarks)

# Rétropropagation

optimizer.zero_grad()

g_loss.backward()

optimizer.step()

Le générateur apprend à mapper les caractéristiques audio aux mouvements de la bouche correspondants tandis que le discriminateur assure le réalisme. Le composant de préservation de l'identité maintient les caractéristiques faciales uniques du locuteur.

Reconstruction et Mélange du Visage

La reconstruction faciale combine les mouvements de lèvres générés avec les caractéristiques faciales originales, créant un résultat final homogène. Cette étape utilise le rendu basé sur l'image, le mélange de Poisson et le lissage temporel pour intégrer de nouvelles régions de la bouche avec des expressions existantes tout en maintenant une apparence naturelle.

Post-traitement et Assurance Qualité

La dernière étape applique un lissage temporel, une correction des couleurs et une suppression des artefacts pour garantir une sortie de qualité professionnelle. Les systèmes avancés utilisent le flux optique pour des vérifications de cohérence et des métriques de qualité automatisées pour détecter les problèmes potentiels avant la révision humaine.

Comparaison de l'Architecture Technique

| Composant | MuseTalk (Open Source) | Sync.co (Commercial) | Pipeline Entreprise |

|---|---|---|---|

| Détection de Visage | MediaPipe | CNN personnalisé | Détection multi-échelle |

| Traitement Audio | Librosa + Wav2Vec2 | ASR propriétaire | Modèles audio personnalisés |

| Génération de Lèvres | GAN Temporel | Modèles de Diffusion | GAN Hybride + Diffusion |

| Contrôle de Qualité | Métriques de base | QA automatisée | Révision humaine + IA |

| Vitesse de Traitement | Moyenne | Rapide | Optimisé pour l'échelle |

| Personnalisation | Élevée | Limitée | Personnalisation complète |

| Précision | 85-90% | 90-95% | 95%+ |

Compromis Techniques :

- Open Source : Contrôle total mais nécessite une expertise technique

- API Commerciale : Intégration plus facile mais personnalisation limitée

- Entreprise : Qualité et contrôle maximum mais coûts plus élevés

Architecture de Synchronisation Labiale de Production de Curify

Le système de synchronisation labiale de Curify représente une mise en œuvre de qualité production combinant des recherches à la pointe de la technologie avec la fiabilité d'entreprise. Notre architecture traite le contenu vidéo à travers plusieurs réseaux neuronaux spécialisés optimisés pour la qualité et l'évolutivité.

Stack Technique Principal :

Traitement de Visage Multi-Échelle : Utilisation de la détection de visage en ensemble et de l'extraction de points de repère à 468 points pour un suivi précis des caractéristiques faciales dans diverses conditions d'éclairage et angles.

Alignement Audio-Visuel Avancé : Cartographie phonème-à-visème personnalisée avec des mécanismes d'attention temporelle garantissant une synchronisation parfaite entre les sons de la parole et les mouvements de la bouche.

Modèle de Génération Hybride : Combinaison de GAN pour le réalisme avec des modèles de diffusion pour la cohérence temporelle, atteignant une qualité visuelle de 95%+ même dans des scénarios difficiles.

Infrastructure : Déployé sur des clusters GPU avec traitement distribué, gérant plus de 50 travaux de synchronisation labiale simultanés. Le système traite 1 minute de vidéo en environ 3-5 minutes selon la complexité.

Pipeline de Qualité : Assurance qualité multi-niveaux incluant la détection automatisée des artefacts, la validation de la cohérence temporelle et la révision humaine pour les clients d'entreprise.

L'Avenir de la Technologie de Synchronisation Labiale AI

La technologie de synchronisation labiale AI a évolué des prototypes de recherche vers des systèmes prêts pour la production capables de gérer des flux de travail à l'échelle entreprise. La combinaison des avancées dans les GAN, les modèles de diffusion et les algorithmes de cohérence temporelle a rendu possible la génération de contenu doublé réaliste à grande échelle.

Pour les équipes techniques, l'idée clé est que la synchronisation labiale est désormais un défi d'ingénierie résolu plutôt qu'un problème de recherche. Les opportunités restantes résident dans l'optimisation, la gestion des cas particuliers et l'intégration avec des flux de travail de localisation de contenu plus larges.

Alors que ces systèmes continuent de s'améliorer grce à de meilleures architectures de modèles et à des ensembles de données d'entraînement plus larges, nous nous rapprochons d'un avenir où la synchronisation labiale parfaite est disponible instantanément pour tout type de contenu, permettant une communication vidéo véritablement mondiale sans compromis visuel.

Take the next step

Putting what you read into practice.

Articles Connexes

video-translation-dubbing

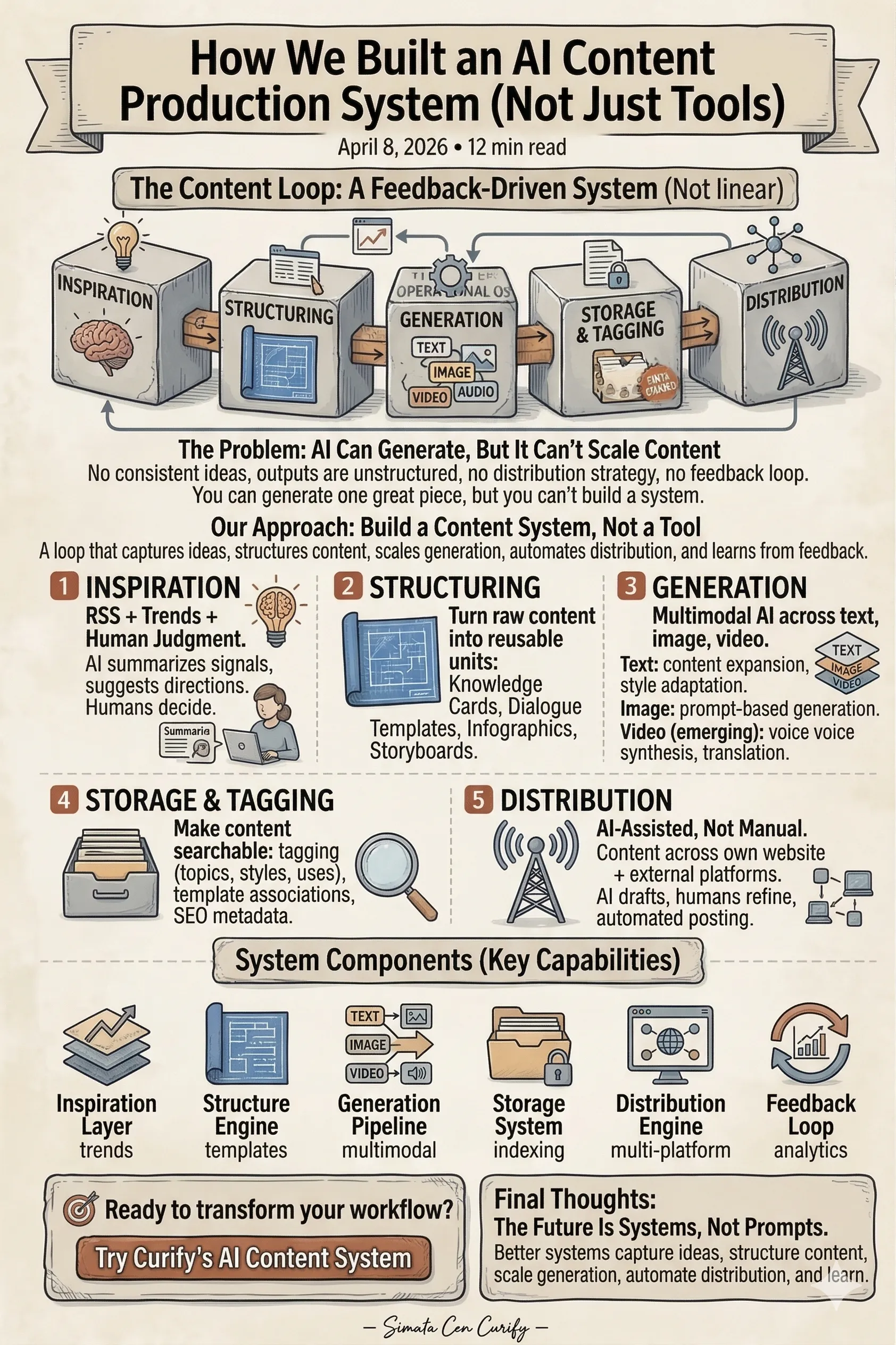

Comment nous avons construit un système de production de contenu AI (pas seulement des outils)