Comment Doubler des Vidéos Naturellement en 2026 : Corriger les Artefacts de Clonage Vocal IA

Un guide complet pour résoudre les défis courants du doublage avec des outils IA. Concentrez-vous sur des points de douleur comme le rythme robotique, le manque d'émotion et les problèmes de synchronisation labiale.

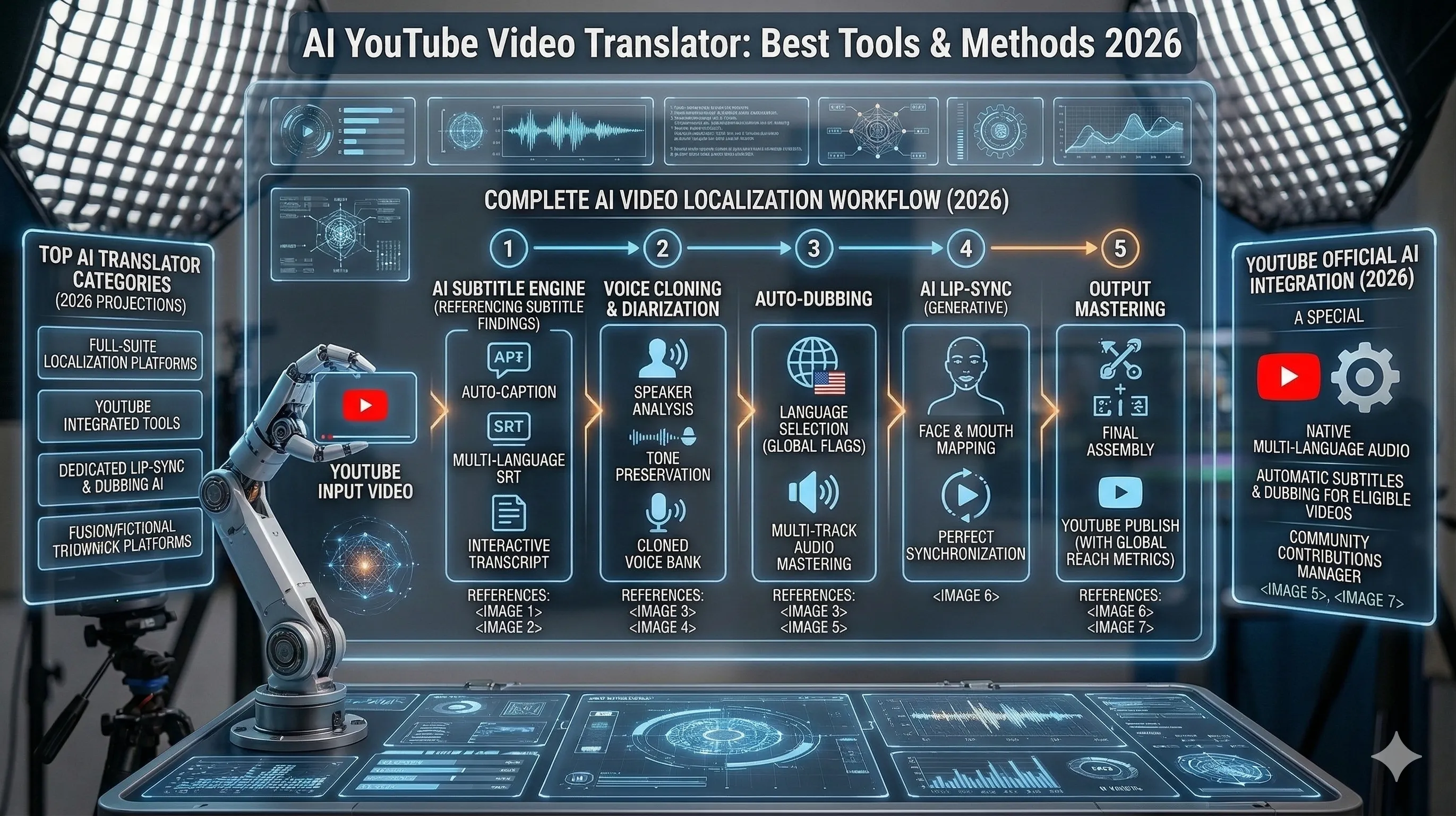

Le doublage vidéo par IA a révolutionné la création de contenu, mais les artefacts robotiques et le rythme non naturel continuent de nuire à de nombreuses productions. En 2026, nous disposons de meilleurs outils et techniques pour surmonter ces défis. Le problème central réside dans la façon dont la plupart des pipelines de doublage traitent la parole comme une couche purement technique plutôt que comme une performance. De nombreux systèmes génèrent encore de l'audio avec une prosodie plate, une emphase incohérente et des pauses mal chronométrées, ce qui rompt l'immersion même lorsque la voix elle-même semble réaliste. Les spectateurs sont très sensibles aux décalages de timing : lorsque les moments émotionnels, les micro-pauses ou l'accentuation des phrases ne s'alignent pas avec la performance visuelle, le résultat semble subtilement « décalé », même s'ils ne peuvent pas articuler pourquoi. Les approches modernes abordent cela en se concentrant sur le contrôle de la prosodie et l'alignement temporel. Au lieu de générer la parole de manière linéaire, les nouveaux modèles intègrent une synthèse consciente du rythme, permettant aux créateurs de contrôler le rythme au niveau des phrases et des syllabes. Cela permet de faire correspondre les mouvements des lèvres, de préserver les pauses dramatiques et de maintenir l'intention originale de l'acteur à travers les langues. Des techniques comme l'alignement forcé, le chronométrage au niveau des phonèmes et le conditionnement audio de référence deviennent désormais standard dans les pipelines de haute qualité. Une autre amélioration majeure provient de la modélisation vocale consciente du contexte. Au lieu de générer chaque ligne de manière isolée, les systèmes avancés maintiennent une mémoire conversationnelle—suivant le ton, l'état émotionnel et la dynamique des locuteurs à travers les scènes. Cela réduit le dérive tonal et garantit qu'un personnage sonne de manière cohérente qu'il chuchote, se dispute ou livre une exposition. Pour un contenu riche en narration, ce changement améliore considérablement le réalisme perçu. Enfin, l'essor des flux de travail avec intervention humaine a comblé le fossé entre automatisation et qualité. Les créateurs combinent désormais la génération IA avec des couches d'édition légères—ajustant les pauses, modifiant l'emphase ou régénérant des segments spécifiques au lieu de clips entiers. Cette approche hybride équilibre efficacité et contrôle créatif, permettant aux équipes de production de développer le doublage tout en atteignant des résultats de niveau studio. Ensemble, ces avancées font passer le doublage IA d'un outil de commodité à une solution de qualité de production, capable de fournir des performances naturelles et émotionnellement résonnantes à travers les langues sans sacrifier la vitesse ou l'évolutivité.

Ce guide vous montrera comment corriger les problèmes courants de doublage en utilisant des outils IA de pointe comme MuseTalk, Emotion TTS et des techniques avancées de post-traitement. Nous allons au-delà de la génération vocale de base pour aborder les points de défaillance les plus persistants dans les flux de travail de doublage IA—le décalage de synchronisation labiale, la livraison monotone, les décalages de timing et la platitude émotionnelle. Vous apprendrez à utiliser MuseTalk pour un alignement visuel-audio précis, garantissant que les pistes de parole générées correspondent étroitement aux mouvements des lèvres et aux expressions faciales, même dans des scènes rapides ou riches en dialogues. Du côté audio, nous décomposons comment tirer parti des systèmes Emotion TTS pour injecter une expressivité contrôlée dans les voix générées. Au lieu de s'appuyer sur des préréglages génériques, le guide explique comment ajuster les contours de hauteur, le rythme et l'emphase pour refléter l'intention—qu'il s'agisse de tension, de sarcasme ou de subtils changements émotionnels au sein d'une seule ligne. Cela vous permet de passer d'un audio « techniquement correct » à des performances qui semblent humaines et contextualisées. Nous couvrons également des flux de travail avancés de post-traitement qui font une différence critique dans la qualité de sortie finale. Cela inclut des ajustements de chronométrage au niveau des phonèmes, la coupe et l'extension de silence, l'insertion de respirations et de pauses, et des techniques de mastering audio telles que l'égalisation et la normalisation du volume pour intégrer les voix doublées de manière transparente dans la bande sonore originale. En combinant ces outils et techniques dans un pipeline cohérent, vous serez en mesure de diagnostiquer et de corriger systématiquement les problèmes de doublage plutôt que de vous fier à des essais et erreurs—transformant les sorties IA incohérentes en dialogues polis et prêts pour la production.

Pro Tip

Problèmes Courants de Doublage IA

🤖 Rythme Robotique

La parole générée par IA manque souvent de rythme et de timing naturels, ce qui la rend mécanique et détachée.

Désengagement des Spectateurs

Un rythme non naturel rompt l'immersion et réduit la rétention des spectateurs jusqu'à 40%.

😐 Manque de Nuance Émotionnelle

Les voix IA ont du mal à transmettre des émotions subtiles, rendant les scènes dramatiques plates.

Déconnexion Émotionnelle

L'absence d'indices émotionnels empêche les spectateurs de se connecter avec les personnages et l'histoire.

👄 Décalages de Synchronisation Labiale

Un mauvais alignement entre l'audio et les mouvements des lèvres visuels crée un effet de vallée étrange.

Apparence Iréaliste

Des erreurs visibles de synchronisation labiale rompent immédiatement l'illusion d'un discours naturel.

Transformez Votre Doublage Vidéo avec l'IA

En combinant ces techniques et outils avancés, vous pouvez créer un contenu doublé naturel et émotionnellement engageant qui captive les audiences. L'avenir du doublage IA est là, et il est plus humain que jamais.