Profundización: Visión técnica de la transcripción

La mayoría de las herramientas de transcripción se detienen en el reconocimiento de voz a texto. Este análisis profundo recorre el pipeline completo de transcripción de Curify: cómo se separa el audio de la música de fondo, cómo WhisperX se ejecuta contra la pista limpia, cómo la diarización de hablantes divide voces superpuestas y cómo la alineación forzada coloca marcas de tiempo a nivel de palabra en la transcripción para que la salida pueda impulsar herramientas de subtítulos, doblaje y traducción en [/tools/video-transcript-generator](/tools/video-transcript-generator). Si deseas integrar la transcripción en un pipeline más grande en lugar de solo descargar un SRT, esta es la capa que la mayoría de las publicaciones de blogs omiten.

Pipeline de transcripción de video de extremo a extremo

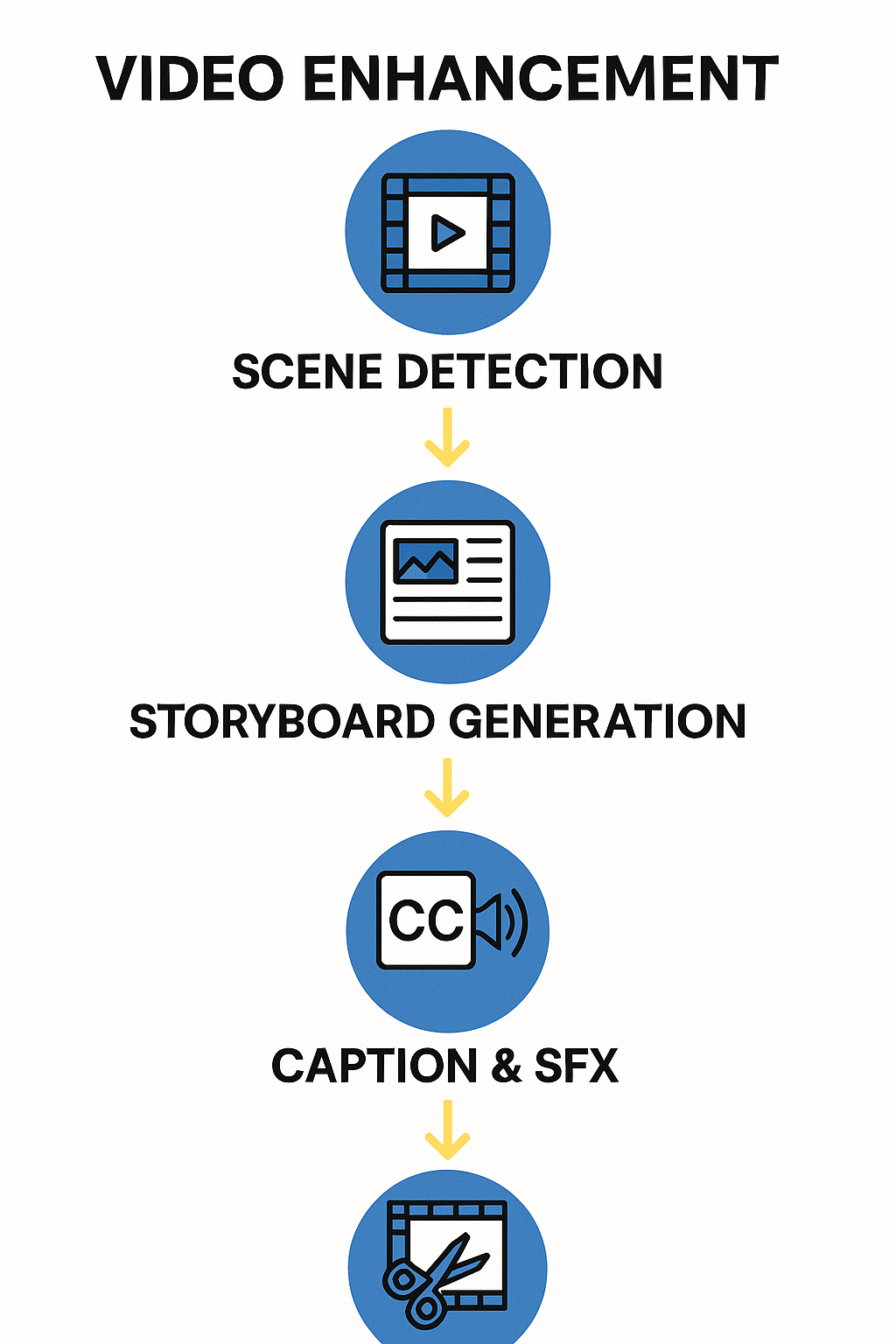

Un pipeline de transcripción de video de grado de producción transforma contenido de video en bruto en texto estructurado y sincronizado en el tiempo a través de múltiples etapas de procesamiento sofisticadas. El flujo de trabajo completo: Video → Extracción de audio → Segmentación → ASR (Reconocimiento Automático de Voz) → Alineación → Diarización de hablantes → Post-procesamiento.

Cada etapa aborda desafíos técnicos específicos: la extracción de audio aísla la pista de habla, la segmentación divide el audio largo en fragmentos manejables, ASR convierte el habla en texto, la alineación proporciona marcas de tiempo a nivel de palabra, la diarización identifica quién habló cuándo, y el post-procesamiento limpia y formatea la salida final.

Sistemas modernos como el pipeline de Curify logran más del 95% de precisión incluso en condiciones desafiantes al combinar Conv-TasNet para separación de audio, WhisperX para reconocimiento de voz y algoritmos de agrupamiento avanzados para identificación de hablantes. Esta profunda inmersión técnica explora cada componente y sus estrategias de integración.

Por qué la arquitectura técnica es importante para la transcripción

Compromisos entre precisión y velocidad: Modelos más grandes proporcionan mejor precisión pero aumentan el tiempo de procesamiento y los costos computacionales. Los sistemas de producción deben equilibrar estos factores según los requisitos del caso de uso.

Desafíos de escalabilidad: La transcripción en tiempo real requiere procesamiento en streaming y inferencia de baja latencia, mientras que el procesamiento por lotes puede optimizar el rendimiento y la eficiencia de costos.

Complejidad multilingüe: El cambio de código (mezcla de idiomas dentro de las oraciones) y el contenido cruzado requieren modelos especializados que puedan mantener el contexto a través de las fronteras del idioma.

Confiabilidad de producción: Los sistemas empresariales necesitan mecanismos de conmutación por error, monitoreo de calidad y recuperación automática de errores para manejar los casos extremos que inevitablemente ocurren con contenido del mundo real.

Componentes del pipeline central

Preprocesamiento de audio y segmentación

El pipeline comienza con un sofisticado preprocesamiento de audio utilizando Conv-TasNet para separación de fuentes y segmentación de audio. Esta etapa aísla el habla humana de la música de fondo, ruido ambiental y otras fuentes de audio a través de separación de audio en el dominio del tiempo.

Implementación técnica:

# Separación de audio utilizando Conv-TasNet

import torch

import torchaudio

from conv_tasnet import ConvTasNet

# Inicializar el modelo de separación de fuentes

separator = ConvTasNet(

n_bases=512, # Número de funciones base

kernel_size=16, # Tamaño del kernel de convolución

stride=8, # Stride para convoluciones temporales

n_layers=8, # Número de capas de convolución

n_src=2 # Número de fuentes a separar

)

# Procesar la forma de onda de audio a 16kHz

audio_tensor, sample_rate = torchaudio.load('input_video.wav')

if sample_rate != 16000:

resampler = torchaudio.transforms.Resample(sample_rate, 16000)

audio_tensor = resampler(audio_tensor)

# Separar fuentes

with torch.no_grad():

separated_sources = separator(audio_tensor)

speech_source = separated_sources[0] # Extraer el habla primaria

La arquitectura de Conv-TasNet utiliza estructuras de codificación-decodificación convolucionales con redes neuronales convolucionales temporales para separar fuentes de audio directamente de formas de onda en bruto, evitando la pérdida de información asociada con enfoques basados en espectrogramas.

ASR (Voz a Texto) con WhisperX

El habla limpia se alimenta a WhisperX, una versión mejorada del modelo Whisper de OpenAI optimizada para precisión y velocidad de transcripción. El sistema maneja múltiples hablantes, dialectos y acentos a través de la diarización de hablantes, segmentando automáticamente el audio por identidad del hablante.

Implementación técnica:

# Reconocimiento de voz avanzado utilizando WhisperX

import whisperx

import torch

from whisperx.utils import get_writer

# Cargar el modelo WhisperX para transcripción

model = whisperx.load_model("large-v3", device="cuda")

# Realizar la transcripción con marcas de tiempo a nivel de palabra y diarización de hablantes

result = model.transcribe(

speech_source,

batch_size=32, # Procesar en lotes para eficiencia

language="auto", # Detección automática del idioma

task="transcribe",

word_timestamps=True, # Habilitar el tiempo a nivel de palabra

print_progress=True

)

# Alinear la salida de whisper utilizando alineación forzada

model_a, metadata = whisperx.load_align_model(

language_code=result["language"],

device="cuda"

)

result = whisperx.align(

result["segments"],

model_a,

metadata,

speech_source,

device="cuda"

)

# Asignar etiquetas de hablante

diarize_model = whisperx.DiarizationPipeline(

use_auth_token=False,

device="cuda"

)

diarize_segments = diarize_model(speech_source)

result = whisperx.assign_word_speakers(diarize_segments, result)

WhisperX mejora el modelo base de Whisper a través de inferencia optimizada, mejor diarización de hablantes y mayor precisión en el tiempo a nivel de palabra. El paso de alineación forzada asegura una sincronización precisa entre audio y transcripción.

Alineación forzada y marcas de tiempo a nivel de palabra

La alineación forzada proporciona marcas de tiempo precisas a nivel de palabra que son esenciales para subtítulos de alta calidad, sincronización de video y procesamiento de lenguaje posterior. En esta etapa, un modelo acústico dedicado toma la señal de audio y una transcripción inicial del sistema ASR y las alinea con una granularidad mucho más fina que la salida ASR en bruto. En lugar de solo saber cuándo comienza y termina cada oración o segmento, el sistema estima el inicio y el final exactos de cada palabra, a veces incluso a nivel de fonema. Este proceso de alineación típicamente utiliza modelos de secuencia probabilística, como modelos ocultos de Markov o codificadores acústicos neuronales, para calcular el momento más probable de cada palabra dada la evidencia acústica y la transcripción. El resultado es una estructura rica donde cada palabra está anotada con tiempo de inicio, tiempo de finalización y puntajes de confianza, y los segmentos se enriquecen con metadatos de tiempo detallados. Estas marcas de tiempo precisas permiten la representación de subtítulos con precisión de fotograma, permiten a los editores saltar directamente a partes específicas del habla en una línea de tiempo de video y crean una base temporal confiable para tareas posteriores como traducción automática, doblaje, análisis de sincronización labial o búsqueda basada en contenido a través de grandes bibliotecas de medios.

Implementación de diarización de hablantes

La diarización de hablantes es responsable de responder a la pregunta "quién habló cuándo" a lo largo de un archivo de audio o video, convirtiendo una transcripción en bruto en una conversación estructurada y consciente del hablante. El sistema primero divide el audio en segmentos homogéneos que probablemente contengan un solo hablante dominante y luego convierte cada segmento en una representación numérica compacta llamada incrustación de hablante, que captura características como timbre, patrones de tono y estilo de habla. Usando estas incrustaciones, algoritmos de agrupamiento agrupan segmentos que suenan similares en identidades de hablante consistentes, sin requerir conocimiento previo de cuántos hablantes están presentes o quiénes son. Los pipelines de diarización avanzados pueden estimar adaptativamente el número de hablantes, refinar los límites donde los hablantes se superponen y suavizar etiquetas para que una sola persona reciba la misma ID de hablante a lo largo de grabaciones largas. La transcripción diarizada resultante asocia cada segmento, y a menudo cada palabra, con una etiqueta de hablante estable, permitiendo aplicaciones como actas de reuniones con resúmenes por hablante, análisis de centros de llamadas, recomendaciones de contenido personalizadas y subtítulos más claros que indican qué personaje o participante está hablando en cada momento.

Post-procesamiento y aseguramiento de calidad

La etapa de post-procesamiento y aseguramiento de calidad transforma las salidas del modelo en bruto en una transcripción pulida y lista para producción que es adecuada para usuarios finales y sistemas posteriores. El post-procesamiento típicamente comienza con pasos de normalización como corregir mayúsculas, expandir o estandarizar números, manejar acrónimos y restaurar puntuación para que el texto se lea como prosa natural en lugar de una secuencia plana de tokens. Luego, las marcas de tiempo se formatean en códigos de tiempo de subtítulos estandarizados y la transcripción se segmenta en unidades de subtítulos legibles o párrafos según la longitud, duración y límites lingüísticos. El aseguramiento de calidad agrega una capa de validación sobre esta transcripción limpia: agrega puntajes de confianza a nivel de palabra en métricas a nivel de segmento, detecta pasajes de confianza inusualmente baja, brechas de tiempo abruptas o repeticiones sospechosas, y los marca para revisión humana o reprocesamiento automático. Verificaciones adicionales pueden hacer cumplir guías de estilo, eliminar disfluencias o palabras de relleno cuando sea apropiado y asegurar que las etiquetas de hablante permanezcan consistentes a lo largo del archivo. Juntas, estas etapas de post-procesamiento y aseguramiento de calidad aseguran que la salida final no solo refleje lo que se dijo, sino que también cumpla con los estándares de precisión, legibilidad y formato requeridos para flujos de trabajo de transcripción, localización y accesibilidad profesionales.

Desafíos técnicos y soluciones

Discurso superpuesto: Múltiples hablantes hablando simultáneamente crean desafíos para ASR. Las soluciones incluyen separación de fuentes de audio, modelos de múltiples hablantes y algoritmos de diarización sofisticados.

Cambio multilingüe: El cambio de código entre idiomas requiere modelos que puedan manejar múltiples idiomas simultáneamente. Los sistemas avanzados utilizan identificación de idioma y modelos multilingües especializados.

Entornos ruidosos: La música de fondo, el ruido ambiental y la mala calidad de audio reducen la precisión de la transcripción. Las técnicas de preprocesamiento de audio y separación de fuentes mitigan estos problemas.

Latencia vs. Precisión: Las aplicaciones en tiempo real requieren baja latencia pero pueden sacrificar precisión. Los sistemas de producción deben equilibrar estos requisitos en competencia según el caso de uso.

Diseño del sistema de producción

Procesamiento por lotes vs. en streaming: El procesamiento por lotes optimiza costos y rendimiento, mientras que el procesamiento en streaming permite la transcripción en tiempo real para aplicaciones en vivo.

Optimización de inferencia en GPU: La cuantización de modelos, el procesamiento por lotes y la paralelización de tensores reducen costos computacionales mientras mantienen precisión.

Orquestación de pipeline: Las colas de mensajes (como Azure Service Bus) coordinan entre etapas de procesamiento, permitiendo flujos de trabajo escalables y tolerantes a fallos.

Estrategias de optimización de costos: El procesamiento dinámico por lotes, instancias de spot y compresión de modelos reducen costos de infraestructura mientras mantienen acuerdos de nivel de servicio.

Comparación de arquitectura técnica

| Componente | ASR básico | WhisperX | Pipeline empresarial |

|---|---|---|---|

| Procesamiento de audio | Canal único | Filtrado básico | Separación Conv-TasNet |

| Reconocimiento de voz | HMM/GMM | Transformador | WhisperX + ajuste fino |

| Diarización de hablantes | Ninguno | Agrupamiento básico | Agrupamiento avanzado + perfilado de voz |

| Alineación forzada | Ninguno | Alineación básica | Alineación de precisión a nivel de palabra |

| Aseguramiento de calidad | Manual | Puntuación de confianza | Revisión automatizada + humana |

| Escalabilidad | Limitada | Media | Escala empresarial |

| Precisión | 70-85% | 90-95% | 95-98% |

Compromisos técnicos:

- Latencia vs. Precisión: Modelos más grandes proporcionan mejor precisión pero aumentan el tiempo de procesamiento

- Costo computacional: La aceleración por GPU es esencial para el procesamiento a escala de producción

- Tamaño del modelo: La cuantización reduce el uso de memoria pero puede afectar la precisión en casos límite

- Soporte de idiomas: Los modelos multilingües requieren más almacenamiento y recursos computacionales

La arquitectura de transcripción de producción de Curify

El sistema de transcripción de Curify representa una implementación de grado de producción de tecnologías de procesamiento de audio de vanguardia, diseñado para escala, precisión y confiabilidad. Nuestra arquitectura combina múltiples redes neuronales especializadas en un pipeline unificado que procesa contenido de video de extremo a extremo con mínima intervención humana.

Componentes técnicos centrales:

Stack de procesamiento de audio: Utilizando Conv-TasNet para separación de fuentes y WhisperX para transcripción, Curify logra más del 95% de precisión incluso en entornos ruidosos. El sistema procesa audio a una resolución de 16kHz, aplicando reducción de ruido en tiempo real y diarización de hablantes para aislar voces individuales.

Pipeline de aseguramiento de calidad: La puntuación de confianza automatizada identifica posibles errores de transcripción para revisión humana. El sistema utiliza modelos de lenguaje entrenados en terminología específica del dominio para mejorar la precisión en contenido técnico, con capacidades de ajuste fino para vocabulario específico de la industria.

Infraestructura: Desplegado en clústeres de GPU con procesamiento distribuido, manejando más de 100 trabajos de transcripción concurrentes. El sistema procesa 1 hora de video en aproximadamente 2 minutos, dependiendo de la complejidad del contenido y la calidad del audio.

Orquestación de pipeline: Las colas de Azure Service Bus coordinan entre etapas de procesamiento, permitiendo flujos de trabajo tolerantes a fallos que pueden manejar automáticamente fallos y reintentos. El sistema admite tanto procesamiento por lotes para eficiencia de costos como streaming para aplicaciones en tiempo real.

🎯 ¿Listo para implementar pipelines de transcripción avanzados para tu organización? Explora las soluciones de transcripción técnica de Curify

El futuro de la tecnología de transcripción de video

La tecnología de transcripción de video ha evolucionado de sistemas básicos de reconocimiento de voz a sofisticadas tuberías de múltiples etapas que combinan avances en redes neuronales, procesamiento de audio y técnicas de optimización. Sistemas modernos como la tubería de Curify demuestran cómo Conv-TasNet para separación de audio, WhisperX para transcripción y aseguramiento de calidad avanzado pueden integrarse en flujos de trabajo de calidad de producción.

Para equipos técnicos y desarrolladores, la conclusión clave es que la transcripción de video ya no es un problema de investigación, sino un desafío de ingeniería resuelto. Las oportunidades restantes se encuentran en la optimización, casos extremos e integración, en lugar de limitaciones tecnológicas fundamentales. A medida que estos sistemas continúan mejorando a través de mejores arquitecturas de modelos y conjuntos de datos de entrenamiento más grandes, nos estamos acercando a un futuro donde la transcripción perfecta está disponible a gran escala para cualquier tipo de contenido.

La arquitectura técnica descrita aquí representa el estado actual del arte en 2026, pero el campo continúa evolucionando rápidamente. La transcripción en tiempo real, la identificación de hablantes en cero disparos y la resumación automatizada de contenido son capacidades emergentes que transformarán aún más nuestra forma de abordar el procesamiento y análisis de contenido de video.

Artículos Relacionados

video-translation-dubbing

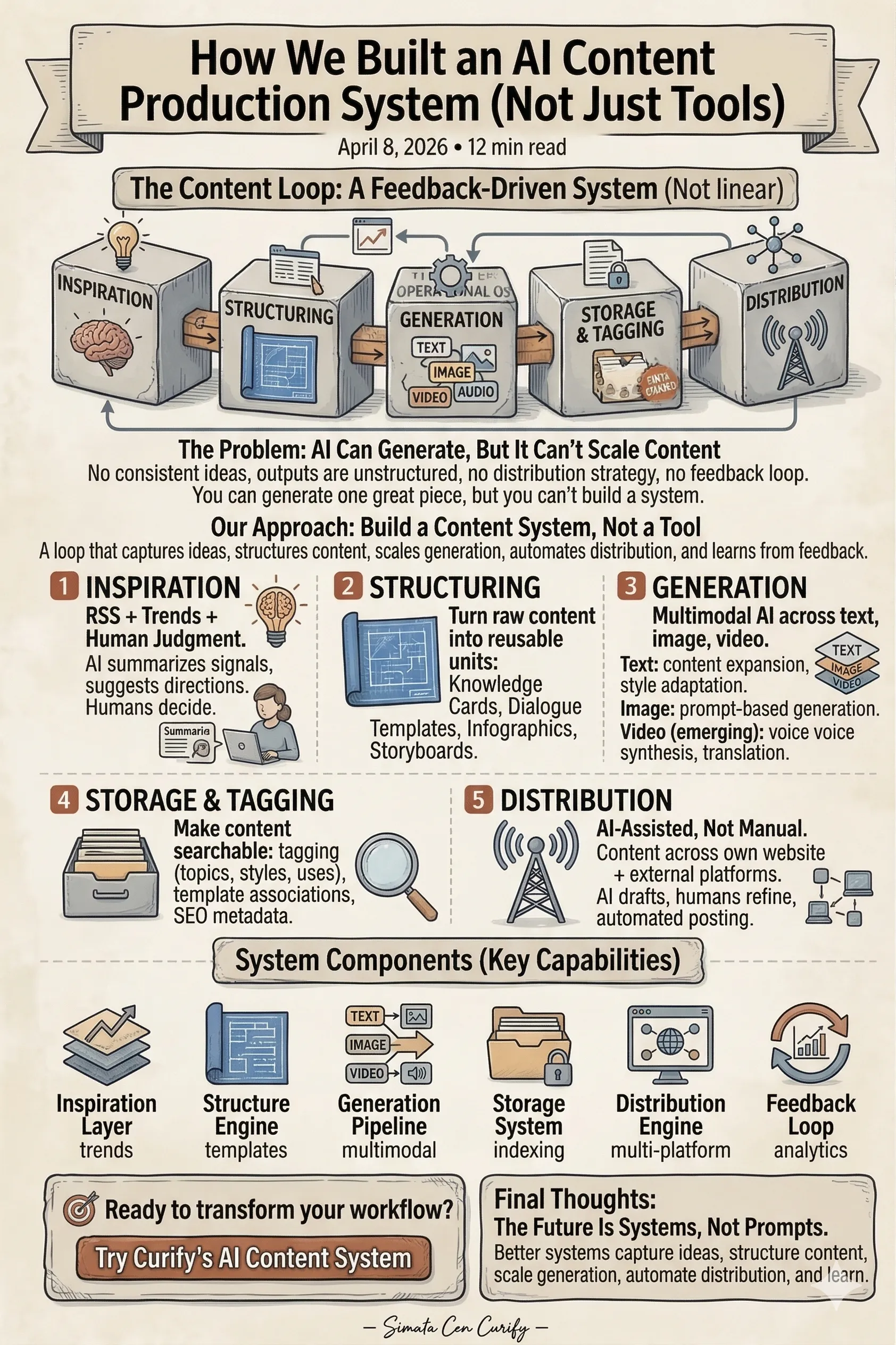

How We Built an AI Content Production System (Not Just Tools)

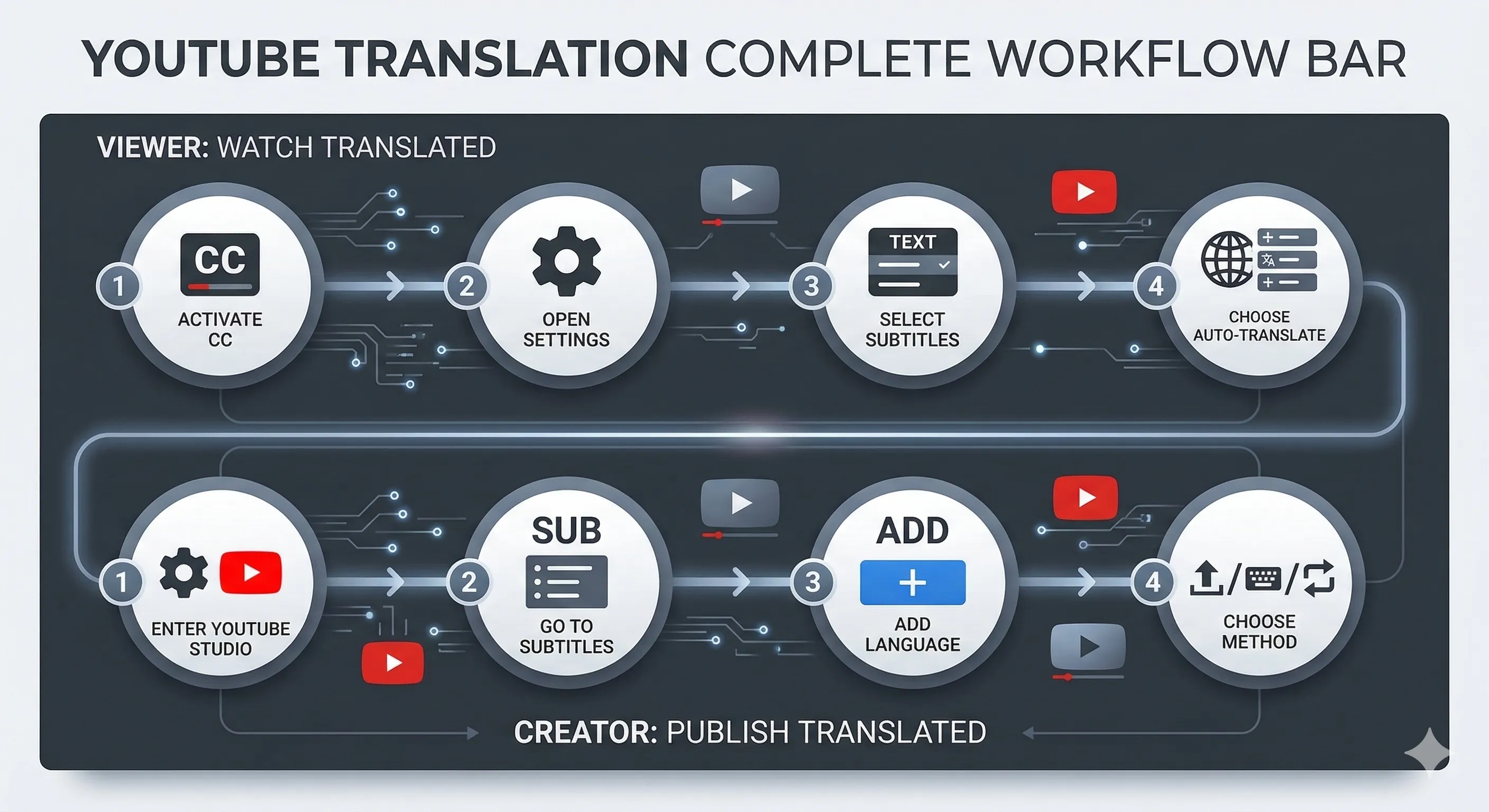

Inside Curify's Video Translation Pipeline: A Technical Deep-Dive