Cómo Traducir un Video de YouTube al Inglés: 3 Métodos en 2026

Te encuentras con un video de YouTube en español, japonés o mandarín, y lo quieres en inglés. Tal vez sea un tutorial que realmente necesitas, una conferencia de curso, un clip viral que compartió tu amigo, o tu propio video que quieres publicar para una audiencia más amplia. En 2026, tienes tres opciones reales, y la correcta depende de si estás viendo, aprendiendo o publicando. Esta guía repasa las tres: subtítulos automáticos, doblaje completo con clonación de voz y subtítulos bilingües, con los compromisos que realmente importan.

Tres Maneras de Traducir un Video de YouTube

No hay un solo "traductor de YouTube" porque hay tres problemas diferentes ocultos bajo una misma frase. (1) Quieres ver un video en tu idioma — resuelto por subtítulos, a menudo el camino más rápido. (2) Quieres una versión publicable en otro idioma — resuelto por doblaje completo con clonación de voz, más lento pero más compartible. (3) Quieres aprender el idioma original mientras miras — resuelto por subtítulos bilingües, el punto dulce del aprendizaje de idiomas.

Esta guía cubre las tres. Cada método tiene una opción gratuita o casi gratuita para uso casual y una opción de pago que maneja el pulido que querrías para producción. Elige según el caso de uso, no por cuál es el "mejor" — resuelven problemas diferentes.

Por Qué un Solo Método No Funciona para Todo

La auto-traducción integrada de YouTube es conveniente pero imprecisa — maneja diálogos comunes bien y se desmorona en modismos, jerga, acentos, jerga técnica y cualquier lugar donde el contexto importa. Para un clip de 5 minutos está bien; para una conferencia de curso de 90 minutos, la deriva acumulativa lo hace inobservable.

El doblaje es el comercio opuesto: más lento de producir pero más fácil de ver. Si estás publicando para una audiencia que no leerá subtítulos (niños, espectadores mayores, cualquiera que esté viendo mientras hace otra cosa), el doblaje es innegociable.

Los subtítulos bilingües son el arma secreta del aprendiz de idiomas — muestran ambos idiomas apilados juntos para que leas la traducción mientras escuchas el original. Este es el único método que realmente *te enseña* el idioma original mientras miras.

Los tres métodos a continuación no están clasificados. Cada uno resuelve un problema específico mejor que los otros dos.

Tres Métodos, Uno al Lado del Otro

Método 1: Subtítulos Automáticos + Traducción del Navegador (Gratis, Más Rápido)

Mejor para: ver rápidamente un solo video en otro idioma. Inversión de tiempo: 30 segundos.

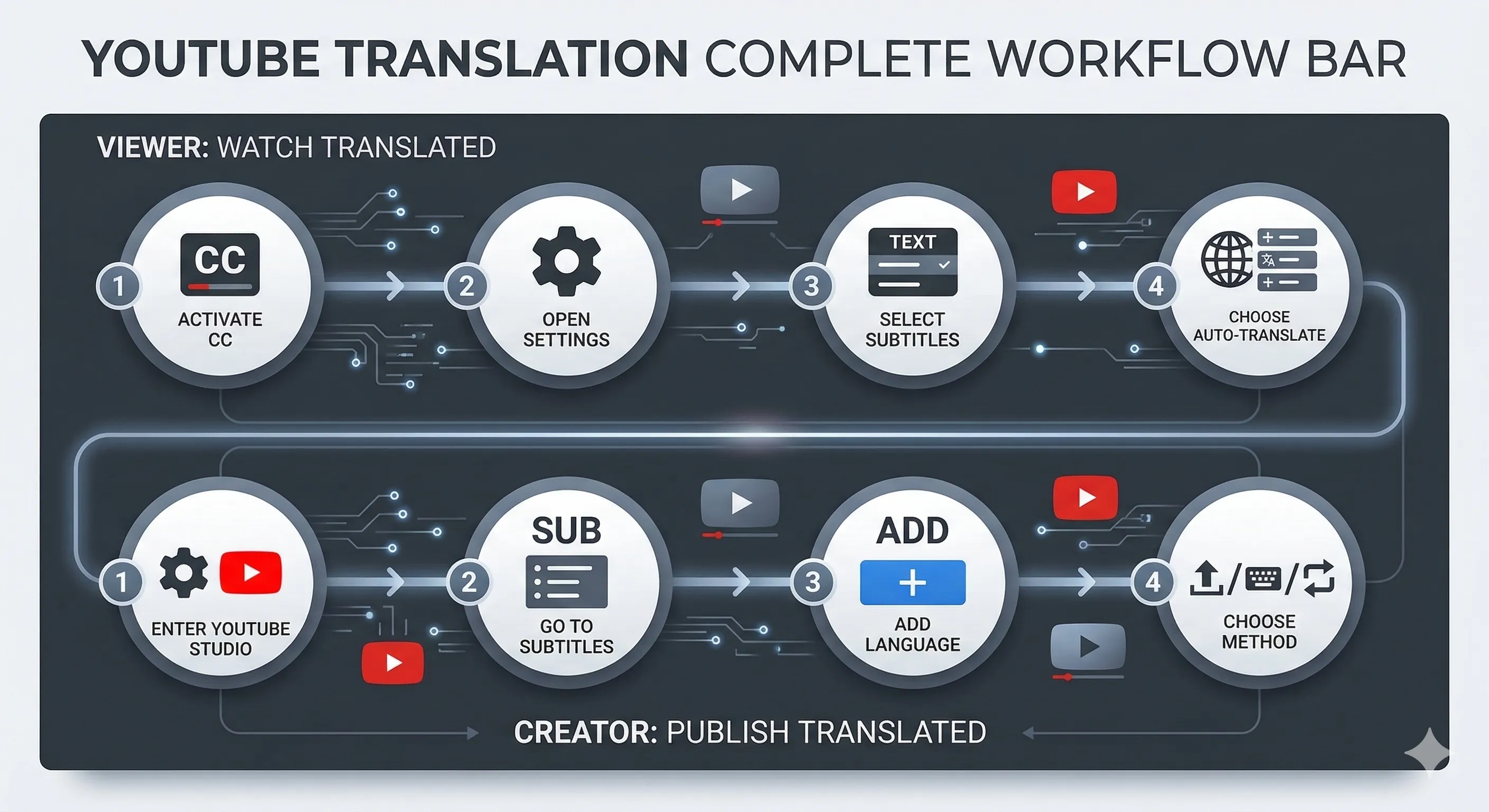

Cada video de YouTube que tiene subtítulos habilitados puede ser auto-traducido por YouTube mismo. Activa el botón CC, abre el engranaje de configuración → Subtítulos → Auto-traducir → Inglés. YouTube genera una traducción al inglés al instante utilizando el backend de traducción de Google.

Lo que funciona: diálogo conversacional en pares de idiomas principales (español, francés, alemán, japonés, coreano, chino se decodifican bien). La pipeline es gratuita, instantánea y funciona en cada video donde el creador no ha deshabilitado los subtítulos.

Lo que falla: jerga técnica (términos de programación, vocabulario médico, pasatiempos de nicho), acentos fuertes, modismos, habla rápida. Las traducciones son a nivel de palabra, por lo que la estructura de la oración puede leerse como inglés roto. Y en videos donde el creador deshabilitó completamente los subtítulos, este método no se aplica en absoluto.

Ruta de actualización: si la auto-traducción de YouTube falla demasiado, pega la URL del video en /tools/video-transcription para obtener una transcripción más pulida — más lenta pero de mucho mayor calidad, especialmente en contenido técnico.

Método 2: Doblaje Completo con Clonación de Voz (De Pago, Compartible)

Mejor para: republicar el video en otro idioma para una audiencia que no leerá subtítulos. Inversión de tiempo: 5-15 minutos de procesamiento por minuto de video.

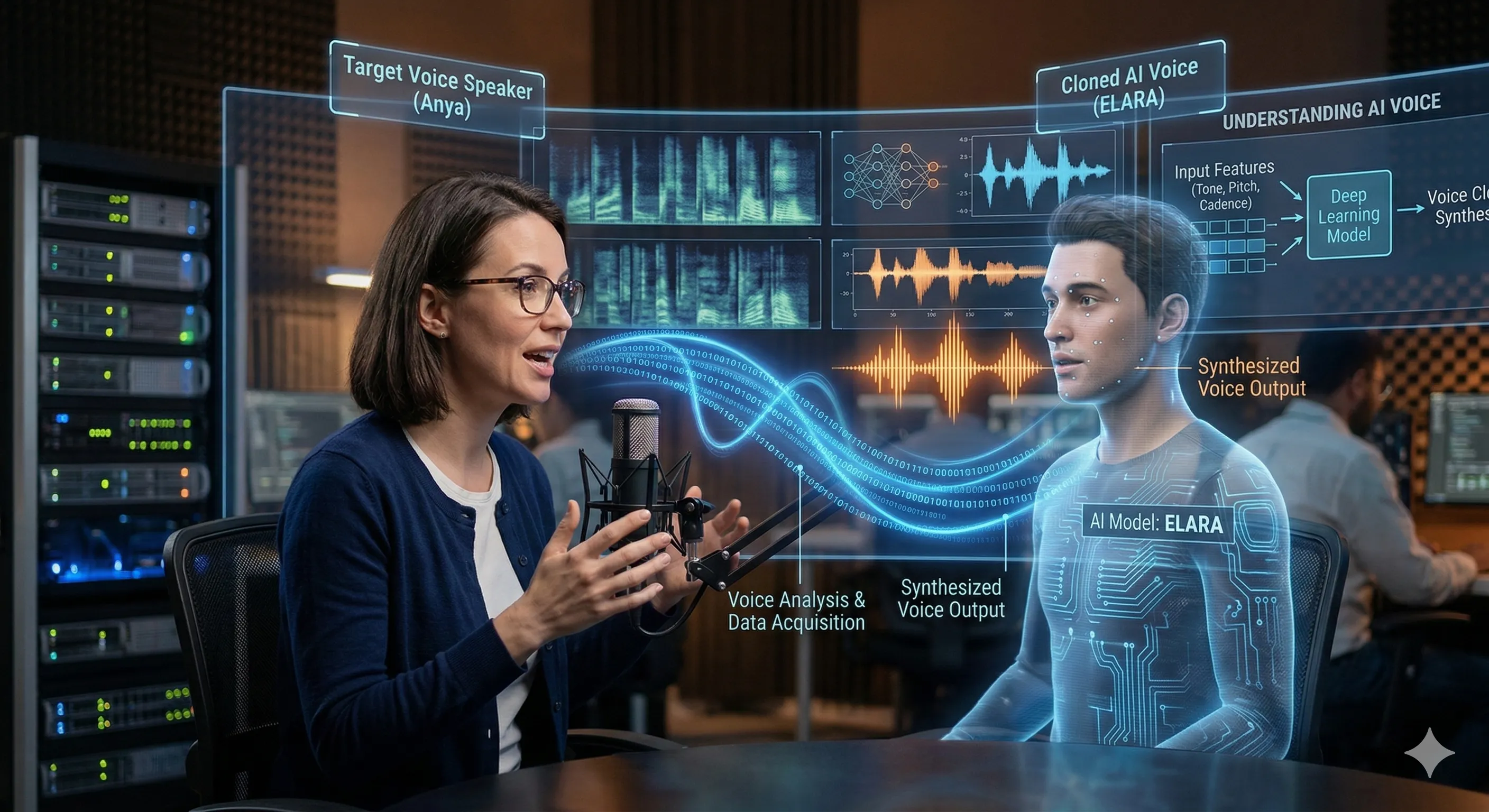

El doblaje completo reemplaza el audio original con una pista en inglés en la voz del hablante original (clonada), luego alinea los movimientos de la boca a través de lip-sync para que no parezca doblado. El resultado es un video que se puede ver y que suena como si el hablante realmente hubiera dicho la versión en inglés.

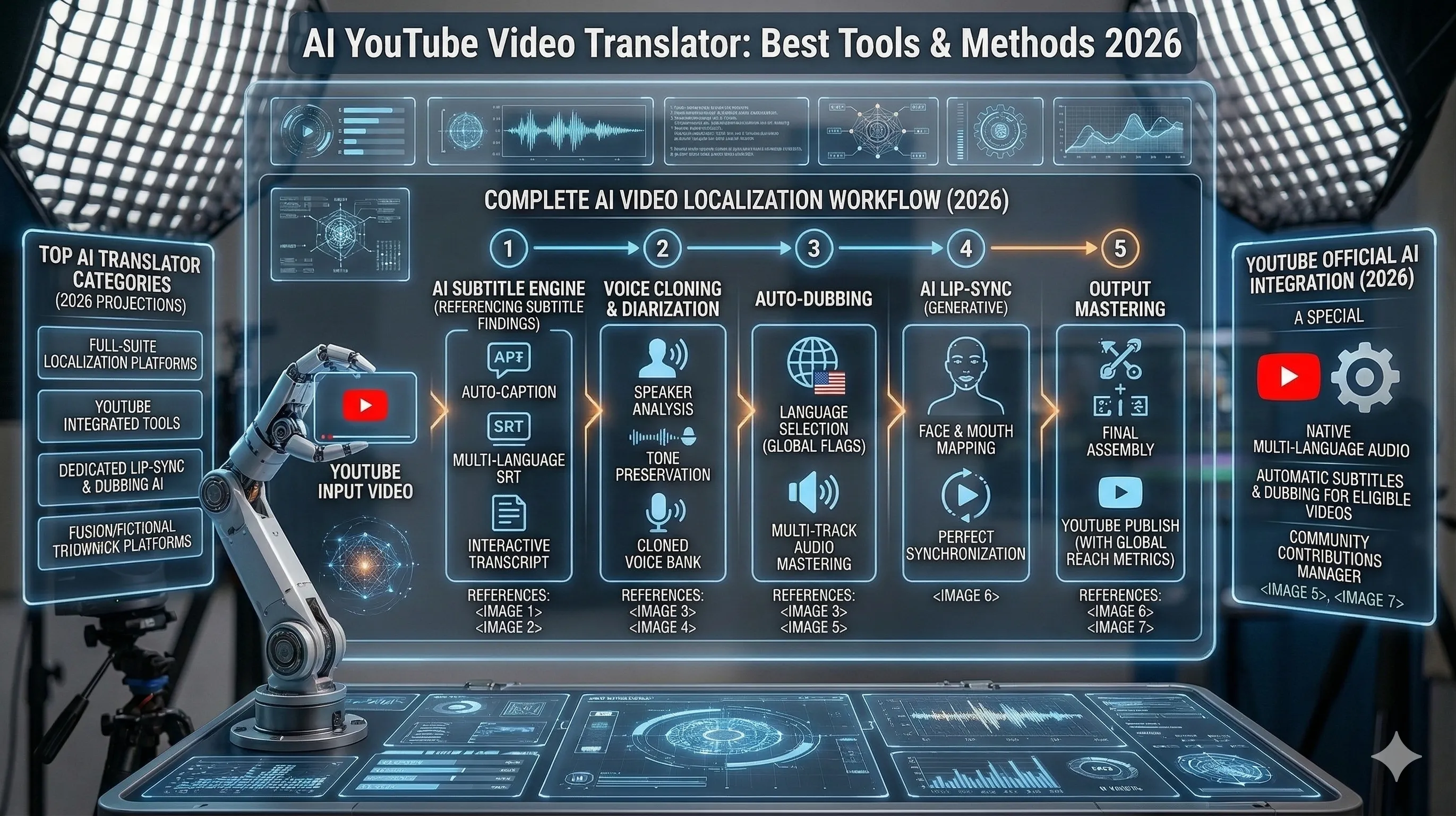

El flujo de trabajo en Curify en /tools/video-dubbing: pega una URL de YouTube o sube el video, elige el idioma de destino, y la pipeline corre cinco etapas: separar el habla de la música de fondo, transcribir el audio, traducir la transcripción, clonar la voz del hablante y re-alinear los movimientos de la boca. Una carga produce tres artefactos: el audio doblado, el nuevo video con movimientos de boca alineados y un archivo de subtítulos correspondiente.

Lo que funciona: contenido de cabeza hablante grabado de frente — entrevistas, grabaciones de cursos, demostraciones de productos, video de pódcast. La salida está lista para publicar para metraje de cabeza hablante.

Lo que falla: ángulos de perfil (el modelo de lip-sync está entrenado en hablantes de frente), barbas pesadas u oclusiones de mano a cara (el modelo pierde el límite de la boca), y pausas largas con la boca cerrada. Para B-roll de estilo documental con el hablante fuera de cámara, planea recurrir a la localización solo con subtítulos en esos cortes.

Costo: pago por minuto. Un video de 10 minutos de cabeza hablante toma aproximadamente el mismo tiempo total de procesamiento que un doblaje manual tomaría en horas humanas, a una pequeña fracción del costo.

Método 3: Subtítulos Bilingües (Gratis o de Pago, Mejor para Aprender)

Mejor para: aprendices de idiomas, profesores de ESL, padres que usan video para la exposición al segundo idioma de los niños. Inversión de tiempo: 2-5 minutos.

Los subtítulos bilingües muestran ambos idiomas apilados juntos — el original en una línea, la traducción al inglés directamente debajo. Escuchas el idioma original mientras lees ambos, que es cómo funciona realmente la adquisición del idioma en la práctica.

El flujo de trabajo de Curify en /tools/bilingual-subtitles: pega una URL de YouTube, elige los idiomas de origen y destino, y la herramienta genera un archivo .srt con ambos idiomas alineados a las mismas marcas de tiempo. Quémalo en el video para una exhibición permanente, o adjúntalo como una pista de subtítulos intercambiable.

Por qué este método importa: la traducción solo con subtítulos elimina completamente las pistas de audio originales. Los subtítulos bilingües las preservan. Si tu objetivo es aprender el idioma *mientras miras*, este es el único método que realmente lo hace. Los padres que enseñan a los niños un idioma patrimonial encuentran esto especialmente útil: el niño escucha el audio original y ve ambas formas escritas lado a lado.

Alternativa gratuita: activa el CC en el idioma original en YouTube + usa una extensión de navegador como Language Reactor o Subadub para superponer una traducción en un segundo idioma. Menos precisa que un .srt generado, pero gratuita y funciona en el navegador sin ninguna descarga.

Cómo Elegir Entre los Tres Métodos

Elige el Método 1 (subtítulos automáticos) si solo quieres ver un solo video ahora mismo, en los próximos 30 segundos, y no te importa que algunas líneas puedan estar ligeramente incorrectas.

Elige el Método 2 (doblaje completo) si estás republicando el video para una audiencia — tu propio canal de YouTube, un video de capacitación interno para un equipo global, un curso que estás vendiendo. En cualquier lugar donde el espectador no esté leyendo subtítulos.

Elige el Método 3 (subtítulos bilingües) si estás aprendiendo el idioma original, enseñándolo o creando contenido para aprendices de idiomas.

También puedes apilarlos: dobla los segmentos principales de cabeza hablante (Método 2), usa subtítulos bilingües para las secciones educativas (Método 3), y recurre a la auto-traducción para B-roll donde el hablante está fuera de cámara (Método 1). La pipeline de Curify produce los tres artefactos de una sola carga, por lo que el mismo video fuente puede servir a las tres audiencias sin necesidad de volver a cargar.

Paso 5: Verificación de Calidad Antes de Publicar

Cualquiera que sea el método que elijas, haz estas tres verificaciones antes de publicar o compartir:

1. Verifica la traducción en al menos 3 marcas de tiempo aleatorias. Elige una cerca del inicio, una en el medio, una cerca del final. Lee la traducción mientras escuchas el original. Si está notablemente incorrecta en cualquiera de las tres, toda la transcripción probablemente tiene el mismo problema — re-traduce o acepta la calidad.

2. Escucha el audio doblado (solo Método 2) para el ritmo. Si las oraciones en inglés son más cortas o más largas que el original, el lip-sync se desviará en cualquier dirección. La mayoría de las pipelines auto-padean o auto-comprimen para compensar, pero el resultado puede sonar apresurado o estirado. Re-renderiza con una estrategia de ritmo diferente si es notable.

3. Verifica el lip-sync en tomas de perfil (solo Método 2). Aquí es donde el modelo falla con más frecuencia. Si un momento emocional clave se graba de lado, acepta que el lip-sync se verá ligeramente incorrecto allí — o corta a un ángulo diferente para esa línea.

Para uso casual, el Método 1 no necesita verificación de calidad (es lo suficientemente bueno o no lo es, y lo sabrás en 10 segundos). Los Métodos 2 y 3 recompensan una revisión de 2 minutos antes de publicar.

Comparación de Herramientas: Lo Que Cada Método Necesita

| Método | Herramienta | Costo | Tiempo | Mejor Para |

|---|---|---|---|---|

| Subtítulos automáticos | CC integrado de YouTube + auto-traducción | Gratis | 30 seg | Ver casual, videos individuales |

| Subtítulos automáticos (mejor) | Curify Video Transcription | Pago por minuto | 2-5 min | Cuando el CC de YouTube falla demasiado |

| Doblaje completo | Curify Video Dubbing | Pago por minuto | 5-15 min/min | Republicar para espectadores que no leen |

| Doblaje completo (alternativa) | ElevenLabs Voice Studio | Suscripción | Configuración manual | Cuando necesitas control de voz detallado |

| Subtítulos bilingües | Curify Bilingual Subtitles | Pago por minuto | 2-5 min | Aprendizaje de idiomas, enseñanza de ESL |

| Subtítulos bilingües (gratis) | Language Reactor + CC de YouTube | Gratis | Plugin de navegador | Aprender mientras miras, sin producción |

Las tres herramientas de Curify comparten una única columna vertebral de pipeline — pega una URL de YouTube una vez, elige los formatos de salida que necesitas, y la misma carga produce el archivo de subtítulos, audio doblado o bilingüe

.srt. Ahorra re-codificación y re-carga para cada formato.Cómo Curify Une los Tres Métodos

Los /tools/video-dubbing y /tools/bilingual-subtitles de Curify funcionan en una pipeline compartida, por lo que puedes producir todas las salidas de los tres métodos a partir de una única carga de URL de YouTube:

1. La transcripción (ruta de actualización del Método 1) — limpia, alineada en el tiempo, lista para traducir o entregar a ChatGPT para un pase de pulido.

2. El video doblado (Método 2) — audio traducido en una voz clonada, alineada con los labios, con un archivo de subtítulos correspondiente producido al mismo tiempo.

3. El archivo de subtítulos bilingües (Método 3) — idioma original + idioma de destino alineados a las mismas marcas de tiempo, listos para quemar en el video o adjuntar como una pista intercambiable.

Las herramientas comparten entradas pero producen diferentes salidas, por lo que puedes hacer coincidir el artefacto con la audiencia sin volver a cargar la fuente. La fijación de precios es por minuto de video fuente; sin suscripción, sin mínimo mensual.

Si quieres la visión del ingeniero sobre cómo funciona cada etapa de la pipeline — separación de audio, traducción neural, clonación de voz, alineación de lip-sync — consulta el desglose de arquitectura de grado de producción en /blog/video-transcription-technical-deep-dive. Esta guía es la vista del usuario de la misma pipeline.

Elige el Método, Omite la Pipeline

"¿Cómo traduzco un video de YouTube al inglés" son tres preguntas diferentes en una. Método 1 (subtítulos automáticos) maneja la visualización casual. Método 2 (doblaje completo) maneja la publicación. Método 3 (subtítulos bilingües) maneja el aprendizaje. Las herramientas para los tres han mejorado drásticamente desde 2024 — lo que solía requerir cinco scripts separados y una GPU ahora es un solo pegado de URL en 2026.

La única advertencia a tomar en serio: cada pipeline de traducción de IA tiene casos límite. Acentos fuertes, jerga técnica, habla rápida, lip-sync en ángulo de perfil — estos son modos de falla reales, no teóricos. Verifica la salida antes de comprometerte a publicar. La revisión de 2 minutos es la diferencia entre un gran video traducido y uno que pierde espectadores en los primeros 30 segundos.

Take the next step

Putting what you read into practice.

Artículos Relacionados

Video Translation

Traducción de Videos de YouTube con IA: Mejores Herramientas, Métodos y Resultados 2026