Sincronización Labial con IA en Producción: Cómo Funcionan Realmente MuseTalk y Sync.co

Ve más allá de la superficie y explora la arquitectura técnica que impulsa los modernos sistemas de sincronización labial AI. Este profundo análisis examina la implementación de código abierto de MuseTalk, la API comercial de Sync.co y el diseño de pipeline de grado de producción para doblaje de video a escala empresarial.

Arquitectura del Pipeline de Sincronización Labial de Extremo a Extremo

Un pipeline de sincronización labial AI de grado de producción transforma entradas de video y audio en contenido doblado perfectamente sincronizado a través de múltiples etapas de procesamiento sofisticadas. El flujo de trabajo completo: Video de Entrada → Detección de Rostros → Extracción de Puntos de Referencia → Análisis de Audio → Generación de Movimiento Labial → Reconstrucción Facial → Post-procesamiento → Video de Salida.

Cada etapa aborda desafíos técnicos específicos: la detección de rostros aísla a los hablantes, la extracción de puntos de referencia rastrea características faciales, el análisis de audio procesa patrones de habla, la generación de movimiento labial crea animaciones sincronizadas, la reconstrucción facial mezcla nuevos labios con expresiones existentes y el post-procesamiento asegura una integración fluida.

Sistemas modernos como MuseTalk y APIs comerciales logran más del 90% de realismo a través de combinaciones de GANs (Redes Generativas Antagónicas), modelos de difusión y algoritmos de consistencia temporal. Este análisis técnico explora cada componente, sus estrategias de integración y los compromisos entre soluciones de código abierto y comerciales.

Por qué la Arquitectura Técnica Importa para la Sincronización Labial

Realismo vs. Costo Computacional: Los modelos de mayor resolución producen resultados más realistas pero requieren recursos de GPU significativos y tiempo de procesamiento. Los sistemas de producción deben equilibrar la calidad con los costos operativos.

Consistencia Temporal: Mantener transiciones suaves entre fotogramas y prevenir parpadeos o artefactos requiere modelado temporal sofisticado y restricciones de consistencia a lo largo de toda la secuencia de video.

Preservación de la Identidad: El sistema debe mantener la identidad original del hablante mientras solo modifica los movimientos de la boca. Esto requiere una separación cuidadosa de las características de identidad de los movimientos faciales relacionados con el habla.

Desafíos de Escalabilidad: Las aplicaciones en tiempo real requieren procesamiento en streaming y inferencia de baja latencia, mientras que el procesamiento por lotes puede optimizarse para rendimiento y eficiencia de costos en entornos de producción.

Componentes Técnicos Clave

Detección de Rostros y Extracción de Puntos de Referencia

El pipeline comienza con tecnología sofisticada de detección de rostros que puede localizar hablantes en cualquier fotograma de video. Una vez que se identifican los rostros, el sistema extrae puntos de referencia faciales precisos, mapeando 468 puntos clave alrededor de la boca, los ojos y otras características faciales.

Este mapeo detallado permite al sistema entender la forma y posición exactas de la boca del hablante en cualquier momento, creando la base para una sincronización labial precisa. La tecnología funciona de manera confiable en diferentes condiciones de iluminación, ángulos e incluso con múltiples personas en el fotograma.

Procesamiento de Audio y Extracción de Características

El pipeline de procesamiento de audio convierte el habla objetivo en características temporales que impulsan la generación de sincronización labial. Los sistemas extraen mel-espectrogramas (80 mel bins, 1024 FFT, 160 hop), MFCCs y alineaciones de fonemas a través de incrustaciones Wav2Vec2 (facebook/wav2vec2-base) y preprocesamiento librosa a 16kHz SR. La implementación carga la forma de onda a través de librosa.load(), calcula librosa.feature.melspectrogram() convertido a escala dB, procesa a través de Wav2Vec2Processor/Wav2Vec2Model para incrustaciones contextuales (last_hidden_state) y aplica alineación forzada (get_phoneme_alignment(audio_path, transcript)) para un temporizado preciso de visemas. El diccionario devuelto contiene mel_spectrogram, audio_embeddings y phoneme_alignment, capturando envolventes espectrales, límites temporales de fonemas y patrones de habla semántica que se mapean directamente a la cinemática de la boca articulatoria.

Generación de Movimiento Labial con Redes Neuronales

La generación de sincronización labial central utiliza arquitecturas neuronales sofisticadas para mapear características de audio a movimientos de boca correspondientes. Los sistemas modernos emplean combinaciones de redes neuronales convolucionales temporales, transformadores y GANs para generar formas de labios realistas que coinciden con el audio objetivo mientras preservan la identidad del hablante.

Implementación Técnica:

Generación de movimiento labial usando GAN temporal

import torch

import torch.nn as nn

class LipSyncGenerator(nn.Module):

def __init__(self, audio_dim=80, landmark_dim=51, hidden_dim=512):

super().__init__()

# Codificador de audio

self.audio_encoder = nn.Sequential(

nn.Conv1d(audio_dim, hidden_dim, kernel_size=3, padding=1),

nn.ReLU(),

nn.Conv1d(hidden_dim, hidden_dim, kernel_size=3, padding=1),

nn.ReLU(),

)

# Transformador temporal para modelado de secuencias

self.temporal_transformer = nn.TransformerEncoder(

nn.TransformerEncoderLayer(

d_model=hidden_dim,

nhead=8,

dim_feedforward=hidden_dim * 4

),

num_layers=6

)

# Decodificador de puntos de referencia

self.landmark_decoder = nn.Sequential(

nn.Linear(hidden_dim, hidden_dim),

nn.ReLU(),

nn.Linear(hidden_dim, landmark_dim),

nn.Tanh() # Normaliza las coordenadas de los puntos de referencia

)

# Capa de preservación de identidad

self.identity_encoder = nn.Sequential(

nn.Linear(landmark_dim * 2, hidden_dim), # Puntos de referencia actuales + de referencia

nn.ReLU(),

nn.Linear(hidden_dim, hidden_dim)

)

def forward(self, audio_features, reference_landmarks):

# Codifica características de audio

audio_encoded = self.audio_encoder(audio_features)

audio_encoded = audio_encoded.transpose(1, 2) # (B, T, D)

# Aplica modelado temporal

temporal_features = self.temporal_transformer(audio_encoded)

# Genera movimientos de puntos de referencia

generated_landmarks = self.landmark_decoder(temporal_features)

# Preserva la identidad del hablante

identity_features = self.identity_encoder(

torch.cat([generated_landmarks, reference_landmarks], dim=-1)

)

# Mezcla movimientos generados con preservación de identidad

final_landmarks = generated_landmarks + 0.1 * identity_features

return final_landmarks

Inicializa y entrena el generador

generator = LipSyncGenerator()

optimizer = torch.optim.Adam(generator.parameters(), lr=1e-4)

Bucle de entrenamiento con pérdida adversarial

def train_lip_sync_model(generator, discriminator, dataloader, epochs=100):

for epoch in range(epochs):

for batch in dataloader:

audio_features, reference_landmarks, target_landmarks = batch

# Genera puntos de referencia falsos

fake_landmarks = generator(audio_features, reference_landmarks)

# Entrenamiento adversarial

real_loss = discriminator(target_landmarks)

fake_loss = discriminator(fake_landmarks)

# Pérdida del generador (adversarial + reconstrucción)

g_loss = -fake_loss.mean() + nn.MSELoss()(fake_landmarks, target_landmarks)

# Retropropagación

optimizer.zero_grad()

g_loss.backward()

optimizer.step()

El generador aprende a mapear características de audio a movimientos de boca correspondientes mientras que el discriminador asegura realismo. El componente de preservación de identidad mantiene las características faciales únicas del hablante.

Reconstrucción y Mezcla Facial

La reconstrucción facial combina los movimientos labiales generados con las características faciales originales, creando un resultado final sin costuras. Esta etapa utiliza renderizado basado en imágenes, mezcla de Poisson y suavizado temporal para integrar nuevas regiones de la boca con expresiones existentes mientras mantiene una apariencia natural.

Post-procesamiento y Aseguramiento de Calidad

La etapa final aplica suavizado temporal, corrección de color y eliminación de artefactos para garantizar una salida de calidad profesional. Los sistemas avanzados utilizan flujo óptico para comprobaciones de consistencia y métricas de calidad automatizadas para detectar problemas potenciales antes de la revisión humana.

Comparación de Arquitectura Técnica

| Componente | MuseTalk (Código Abierto) | Sync.co (Comercial) | Pipeline Empresarial |

|---|---|---|---|

| Detección Facial | MediaPipe | CNN Personalizado | Detección a múltiples escalas |

| Procesamiento de Audio | Librosa + Wav2Vec2 | ASR Propietario | Modelos de audio personalizados |

| Generación de Labios | GAN Temporal | Modelos de Difusión | GAN Híbrido + Difusión |

| Control de Calidad | Métricas básicas | QA Automatizado | Revisión Humana + IA |

| Velocidad de Procesamiento | Media | Rápido | Optimizado para escala |

| Personalización | Alta | Limitada | Personalización completa |

| Precisión | 85-90% | 90-95% | 95%+ |

Compensaciones Técnicas:

- Código Abierto: Control total pero requiere experiencia técnica

- API Comercial: Integración más fácil pero personalización limitada

- Empresarial: Máxima calidad y control pero costos más altos

Arquitectura de Sincronización de Labios de Producción de Curify

El sistema de sincronización de labios de Curify representa una implementación de grado de producción que combina investigación de vanguardia con fiabilidad empresarial. Nuestra arquitectura procesa contenido de video a través de múltiples redes neuronales especializadas optimizadas tanto para calidad como para escalabilidad.

Pila Técnica Central:

Procesamiento Facial a Múltiples Escalas: Utilizando detección facial en conjunto y extracción de puntos de referencia de 468 puntos para un seguimiento preciso de características faciales en diversas condiciones de iluminación y ángulos.

Alineación Audio-Visual Avanzada: Mapeo personalizado de fonemas a visemas con mecanismos de atención temporal asegura una sincronización perfecta entre los sonidos del habla y los movimientos de la boca.

Modelo de Generación Híbrido: Combinando GANs para realismo con modelos de difusión para consistencia temporal, logrando una calidad visual del 95%+ incluso en escenarios desafiantes.

Infraestructura: Desplegado en clústeres de GPU con procesamiento distribuido, manejando más de 50 trabajos de sincronización de labios concurrentes. El sistema procesa 1 minuto de video en aproximadamente 3-5 minutos dependiendo de la complejidad.

Pipeline de Calidad: Aseguramiento de calidad en múltiples etapas que incluye detección automatizada de artefactos, validación de consistencia temporal y revisión humana para clientes empresariales.

El Futuro de la Tecnología de Sincronización de Labios con IA

La tecnología de sincronización de labios con IA ha evolucionado de prototipos de investigación a sistemas listos para producción que pueden manejar flujos de trabajo a escala empresarial. La combinación de avances en GANs, modelos de difusión y algoritmos de consistencia temporal ha hecho posible generar contenido doblado realista a gran escala.

Para los equipos técnicos, la clave es que la sincronización de labios ahora es un desafío de ingeniería resuelto en lugar de un problema de investigación. Las oportunidades restantes radican en la optimización, el manejo de casos extremos y la integración con flujos de trabajo de localización de contenido más amplios.

A medida que estos sistemas continúan mejorando a través de mejores arquitecturas de modelos y conjuntos de datos de entrenamiento más grandes, nos estamos acercando a un futuro donde la sincronización de labios perfecta está disponible instantáneamente para cualquier tipo de contenido, permitiendo una comunicación de video verdaderamente global sin compromisos visuales.

Take the next step

Putting what you read into practice.

Artículos Relacionados

video-translation-dubbing

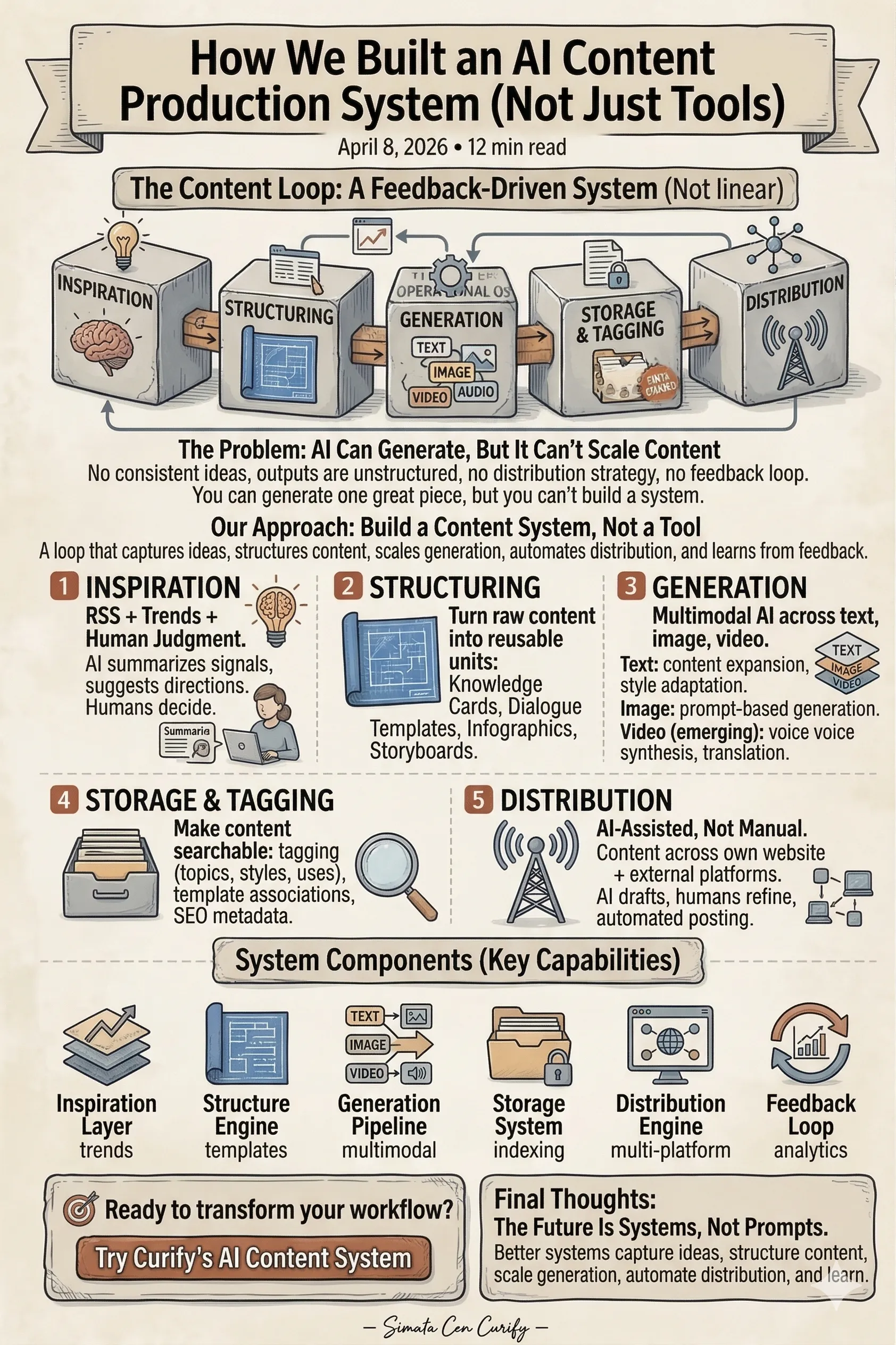

Cómo Construimos un Sistema de Producción de Contenido AI (No Solo Herramientas)