Cómo Duplicar Videos de Forma Natural en 2026: Solucionando Artefactos de Clonación de Voz de IA

Una guía completa para resolver desafíos comunes de doblaje con herramientas de IA. Enfócate en puntos críticos como el ritmo robótico, la falta de emoción y los problemas de sincronización labial.

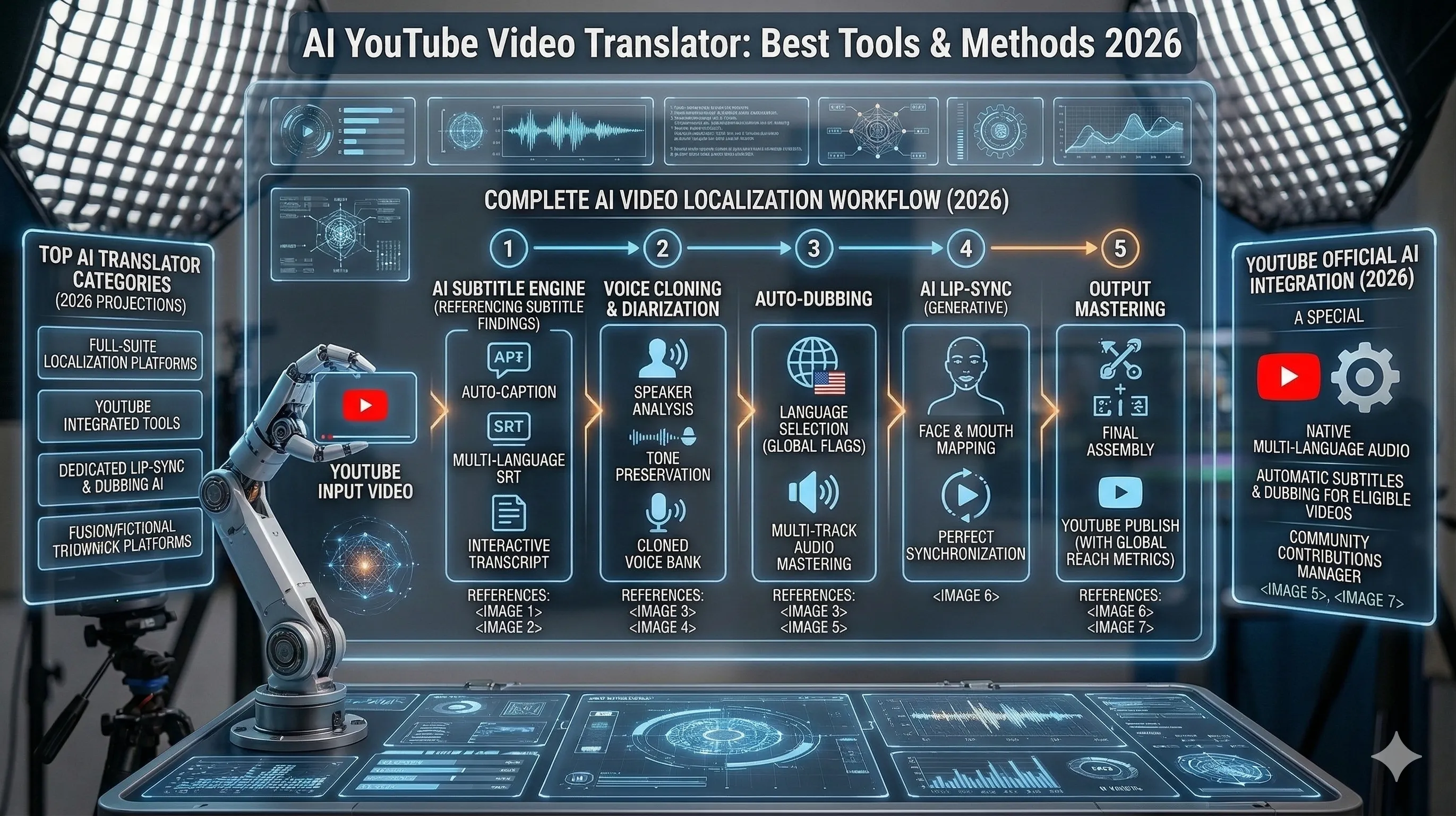

El doblaje de videos con IA ha revolucionado la creación de contenido, pero los artefactos robóticos y el ritmo antinatural aún afectan muchas producciones. En 2026, tenemos mejores herramientas y técnicas para superar estos desafíos. El problema central radica en cómo la mayoría de los flujos de trabajo de doblaje tratan el habla como una capa puramente técnica en lugar de una actuación. Muchos sistemas aún generan audio con prosodia plana, énfasis inconsistente y pausas mal cronometradas, lo que rompe la inmersión incluso cuando la voz en sí suena realista. Los espectadores son muy sensibles a los desajustes de tiempo: cuando los momentos emocionales, micro-pausas o el estrés de las oraciones no se alinean con la actuación visual, el resultado se siente sutilmente “fuera de lugar”, incluso si no pueden articular por qué. Los enfoques modernos abordan esto al centrarse en el control de prosodia y la alineación temporal. En lugar de generar el habla de manera lineal, los modelos más nuevos incorporan síntesis consciente del ritmo, permitiendo a los creadores controlar el ritmo a nivel de frase y sílaba. Esto hace posible igualar los movimientos labiales, preservar las pausas dramáticas y mantener la intención original del actor en diferentes idiomas. Técnicas como la alineación forzada, el cronometraje a nivel de fonema y la acondicionamiento de audio de referencia se están convirtiendo en estándar en flujos de trabajo de alta calidad. Otra mejora importante proviene del modelado de voz consciente del contexto. En lugar de generar cada línea de forma aislada, los sistemas avanzados mantienen memoria conversacional, rastreando el tono, el estado emocional y la dinámica del hablante a través de las escenas. Esto reduce la deriva tonal y asegura que un personaje suene consistente ya sea que esté susurrando, discutiendo o entregando una exposición. Para contenido con mucha narrativa, este cambio por sí solo mejora drásticamente el realismo percibido. Finalmente, el auge de los flujos de trabajo con humanos en el circuito ha cerrado la brecha entre la automatización y la calidad. Los creadores ahora combinan la generación de IA con capas de edición ligeras, ajustando pausas, modificando énfasis o regenerando segmentos específicos en lugar de clips enteros. Este enfoque híbrido equilibra la eficiencia con el control creativo, permitiendo a los equipos de producción escalar el doblaje mientras logran resultados de nivel de estudio. Juntos, estos avances mueven el doblaje de IA de una herramienta de conveniencia a una solución de grado de producción, capaz de ofrecer actuaciones naturales y emocionalmente resonantes en diferentes idiomas sin sacrificar velocidad o escalabilidad.

Esta guía te mostrará cómo solucionar problemas comunes de doblaje utilizando herramientas de IA de vanguardia como MuseTalk, Emotion TTS y técnicas avanzadas de post-procesamiento. Vamos más allá de la generación de voz básica para abordar los puntos de falla más persistentes en los flujos de trabajo de doblaje de IA: desajuste de sincronización labial, entrega monótona, desajustes de tiempo y planitud emocional. Aprenderás a utilizar MuseTalk para una alineación visual-audio precisa, asegurando que las pistas de habla generadas coincidan estrechamente con los movimientos de la boca y las expresiones faciales, incluso en escenas rápidas o con mucho diálogo. En el lado del audio, desglosamos cómo aprovechar los sistemas Emotion TTS para inyectar expresividad controlada en las voces generadas. En lugar de depender de ajustes genéricos, la guía explica cómo ajustar los contornos de tono, el ritmo y el énfasis para reflejar la intención, ya sea tensión, sarcasmo o cambios emocionales sutiles dentro de una sola línea. Esto te permite pasar de audio “técnicamente correcto” a actuaciones que se sienten humanas y contextualizadas. También cubrimos flujos de trabajo avanzados de post-procesamiento que marcan una diferencia crítica en la calidad de salida final. Esto incluye ajustes de tiempo a nivel de fonema, recorte y extensión de silencios, inserción de respiraciones y pausas, y técnicas de masterización de audio como igualación de EQ y normalización de volumen para mezclar voces dobladas sin problemas en la banda sonora original. Al combinar estas herramientas y técnicas en un flujo de trabajo cohesivo, podrás diagnosticar y solucionar sistemáticamente problemas de doblaje en lugar de depender de prueba y error, convirtiendo salidas inconsistentes de IA en diálogos pulidos y listos para producción.

Pro Tip

Problemas Comunes de Doblaje con IA

🤖 Ritmo Robótico

El habla generada por IA a menudo carece de ritmo y tiempo natural, sonando mecánica y distante.

Desconexión del Espectador

Un ritmo antinatural rompe la inmersión y reduce la retención del espectador hasta en un 40%.

😐 Falta de Matiz Emocional

Las voces de IA luchan por transmitir emociones sutiles, haciendo que las escenas dramáticas se sientan planas.

Desconexión Emocional

La falta de señales emocionales impide que los espectadores se conecten con los personajes y la historia.

👄 Desajustes de Sincronización Labial

Una mala alineación entre el audio y los movimientos labiales visuales crea un efecto de valle inquietante.

Apariencia Irrealista

Los errores visibles de sincronización labial rompen inmediatamente la ilusión del habla natural.

Transforma tu Doblaje de Video con IA

Al combinar estas técnicas y herramientas avanzadas, puedes crear contenido doblado natural y emocionalmente atractivo que cautive a las audiencias. El futuro del doblaje con IA está aquí, y es más humano que nunca.