Die besten KI-Tools zum Stimmenklonen im Jahr 2026: ElevenLabs vs F5-TTS vs OpenVoice

Die meisten Beiträge zu diesem Thema listen 10+ Tools in einer Rangliste auf. Das ist nicht hilfreich – drei Tools decken fast jeden realen Anwendungsfall ab, und die Unterschiede zwischen ihnen sind deutlich. Dieser Leitfaden wählt die drei aus, benennt, worin jedes tatsächlich am besten ist, und hebt den einen gemeinsamen Anwendungsfall (Synchronisation eines Videos in eine andere Sprache unter Beibehaltung Ihrer Stimme) hervor, bei dem Sie überhaupt kein Stimmenklon-Tool benötigen.

Für wen das gedacht ist

Ersteller, die ein Tool auswählen, um ihre eigene Stimme für Erzählungen, Hörbücher oder eine benutzerdefinierte TTS-Funktion zu klonen. Produktteams, die eine Stimmenklon-Funktion in einem SaaS ausliefern. Lokalisierungsteams, die Open Source vs. kommerziell in Betracht ziehen. Wenn Sie versuchen, ein YouTube-Video in eine andere Sprache mit Ihrer eigenen Stimme zu lokalisieren, springen Sie zum Was ist, wenn Sie kein Stimmenklon-Tool benötigen? – das ist ein anderes Problem und ein anderes Tool.

Schneller Käuferleitfaden – was wirklich zählt

Vier Dimensionen sind wichtig; der Rest ist Marketingtext.

1. Zustimmung & Legalität (die einzige Regel, die zuerst zählt). Jemandes Stimme ohne ausdrückliche schriftliche Zustimmung zu klonen, ist ein rechtliches Desaster – die DSGVO behandelt Stimmen als biometrische Daten in der EU; die FCC-Entscheidung von 2024 macht es in den USA illegal für Robocalls. Tools wie Descript und Resemble erzwingen eine Zustimmungskontrolle vor dem Klonen. Tools wie F5-TTS überlassen die Richtlinien Ihnen. Wählen Sie entsprechend.

2. Preismodell. Abrechnung pro Zeichen (ElevenLabs, AWS Polly, Azure) skaliert linear – gut für geringes Volumen, schmerzhaft im großen Maßstab. Abonnements begrenzen Ihre Ausgaben. Open-Source selbstgehostet (F5-TTS, OpenVoice) tauscht Dollar gegen GPU-Kosten + Ingenieurzeit.

3. Sprachtreue vs. Probenlänge. "Sofort"-Klonen benötigen 10-30 Sekunden Referenzaudio und bieten 70-80% Treue. "Professionelle" Klone benötigen 30+ Minuten sauberes Studioaudio und erreichen über 95%. Wählen Sie die Stufe, die zu Ihrem Anwendungsfall passt – ein Podcast-Intro benötigt mehr Treue als ein internes Tool.

4. Wo die Audiodaten gespeichert sind. Einige Anbieter gewähren sich eine "unbefristete Lizenz", um Ihre hochgeladene Stimme für Modellforschung und -entwicklung zu verwenden. Lesen Sie die Datenschutzrichtlinie. Wenn Sie nicht möchten, dass Ihre Sprachdaten Ihre Infrastruktur verlassen, hosten Sie F5-TTS oder OpenVoice selbst.

Wie wir diese drei ausgewählt haben

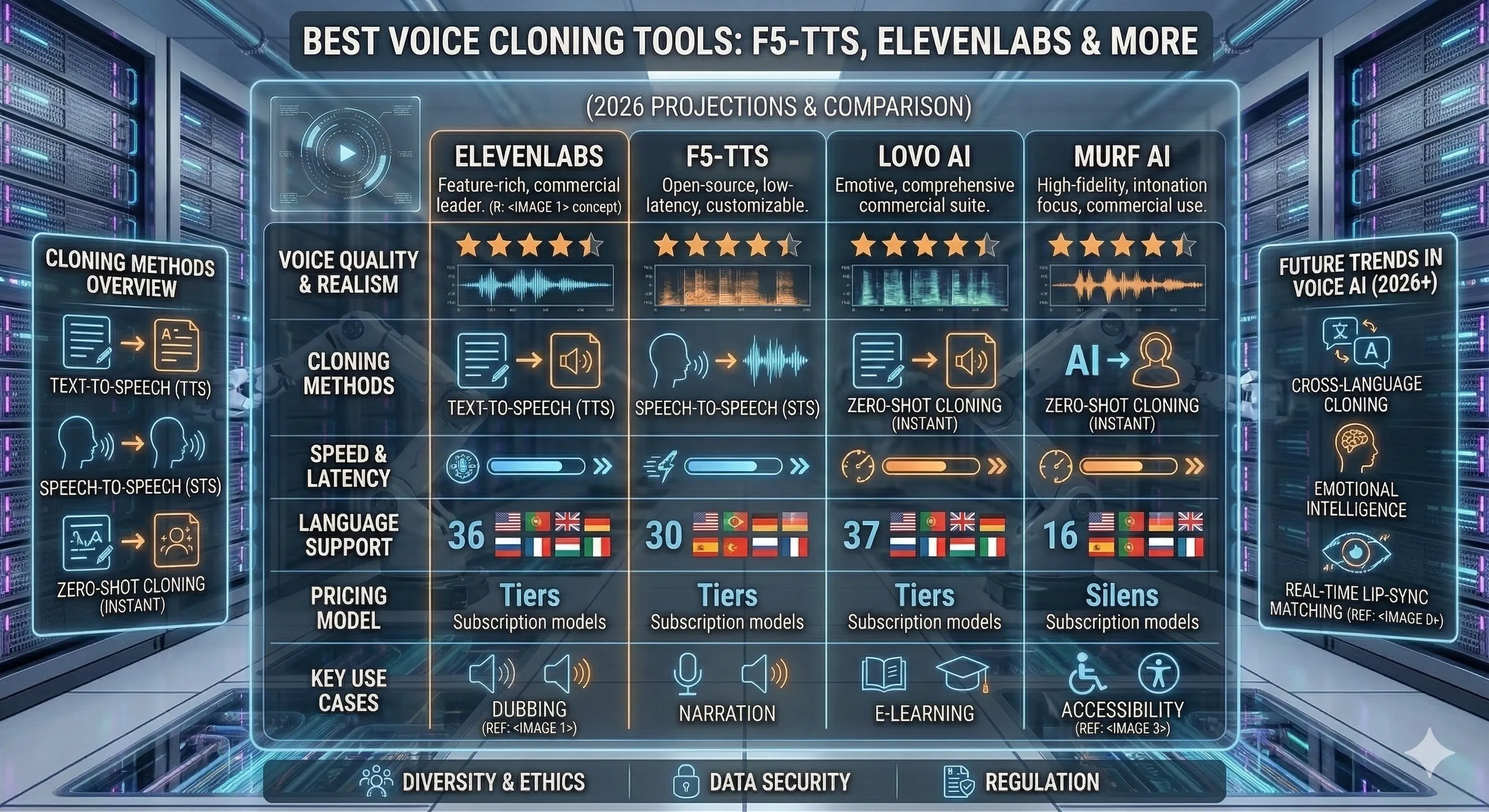

Die meisten Listen "bester Sprachklon-Tools" sind 15 Einträge lang, weil Pufferung SEO hilft. Wir sind anderer Meinung. Drei Kategorien decken fast jeden realen Anwendungsfall ab – kommerzielle Politur, Open-Source-Selbsthosting und leichte Open-Source-Alternativen. Wir haben 12 Tools ausgeschlossen, die sich mit diesen drei überschneiden (Murf, Play.ht, Speechify, Lovo, Listnr, TTSMaker usw. sitzen alle im gleichen kommerziellen Politur-Bereich wie ElevenLabs; Fish Audio, Hume, Respeecher zielen auf Film-/empathische Nischen ab). Wenn Sie die lange Liste möchten, die ist nur eine Google-Suche entfernt. Wenn Sie eine Entscheidung möchten, lesen Sie weiter.

Die drei Tools, die einen Vergleich wert sind

Abgesehen vom Marketingtext lässt sich der Bereich Stimmenklonen in drei Kategorien unterteilen: der polierte kommerzielle Marktführer (ElevenLabs), das Open-Source-Arbeitstier (F5-TTS) und die leichte Open-Source-Alternative, wenn F5-TTS nicht passt (OpenVoice). Jedes hat einen anderen Leser. Wählen Sie das aus, das Ihren Anforderungen entspricht.

1. ElevenLabs

Der kommerzielle Marktführer für poliertes Stimmenklonen

- Best for: Benutzerdefinierte Stimmen für Produkte, Hörbücher, IVR, Charakterstimmen für Medien

- Pricing: Abrechnung pro Zeichen – kostenloses Kontingent begrenzt; kostenpflichtige Pläne beginnen bei ca. 5 $/Monat

- Languages: Über 30 Sprachen mit reifer Sprachbibliothek

- Notable limitation: Geschlossene Plattform mit Inhaltsrichtlinien für Stimmenklonen (Zustimmungsüberprüfung erforderlich für benutzerdefinierte Stimmen); Kosten pro Zeichen summieren sich bei hohem Volumen

Wählen Sie ElevenLabs, wenn Sie ein Stimmenklon-Tool mit den wenigsten Ingenieureingriffen und der höchsten Grundqualität benötigen und Sie mit einer Anbieterbindung einverstanden sind. Die API und die Sprachbibliothek sind die ausgereiftesten in der Kategorie. Wenn Sie eine Produktfunktion entwickeln, bei der Ihre Benutzer ihre eigene Stimme klonen, ist dies der Weg mit dem geringsten Widerstand.

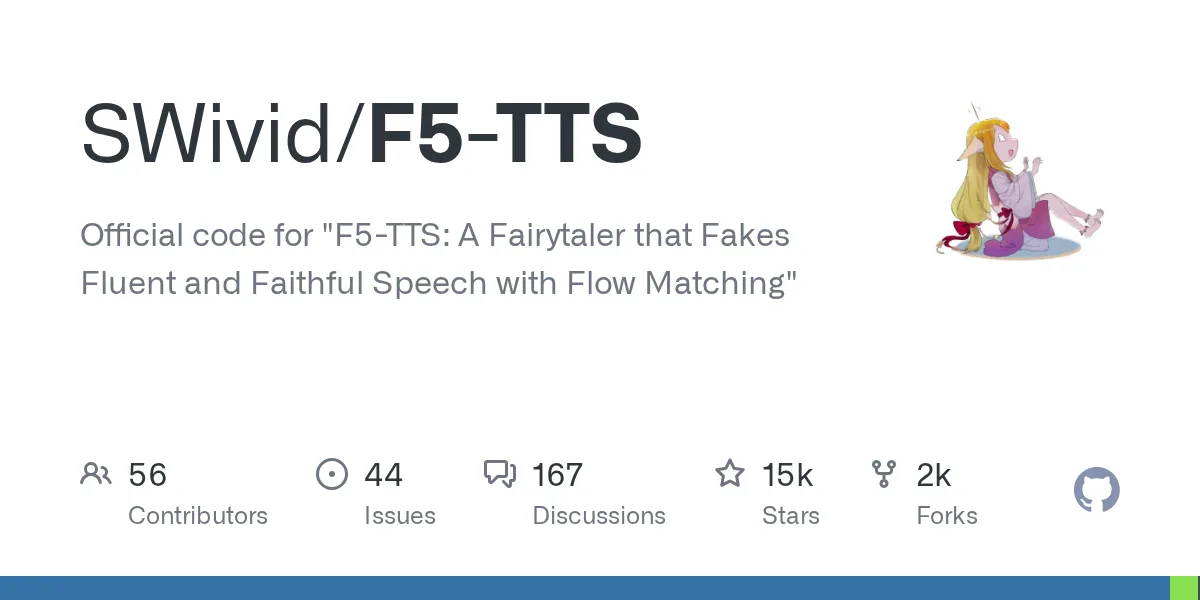

2. F5-TTS

Das Open-Source-Arbeitstier, null-shot mehrsprachig

- Best for: Selbstgehostetes Stimmenklonen, technische Teams, benutzerdefinierte Inferenz, Batch-Generierung

- Pricing: Kostenlos (selbstgehostet) – GPU-Kosten sind das Minimum

- Languages: Mehrsprachiger Null-Shot-Transfer; Community-Finetunes für ressourcenarme Sprachen

- Notable limitation: Benötigt eine GPU und Infrastruktur für Inferenz; Prosodie kann bei langen Clips (>30-45s) ohne Chunking abdriften; expressive Extreme (Lachen, Schreien) schwächen sich ab

Wählen Sie F5-TTS, wenn Sie Ingenieurressourcen haben, null Kosten pro Clip in großem Maßstab wünschen oder Datenresidenz / Selbsthosting für die Einhaltung benötigen. Das Modell verwendet Flow-Matching mit einem Diffusion Transformer – wettbewerbsfähig mit kommerziellen Ausgaben, sobald Sie Schritte und Präzision anpassen. Referenz-Repo: SWivid/F5-TTS; 2025 Papier auf OpenReview.

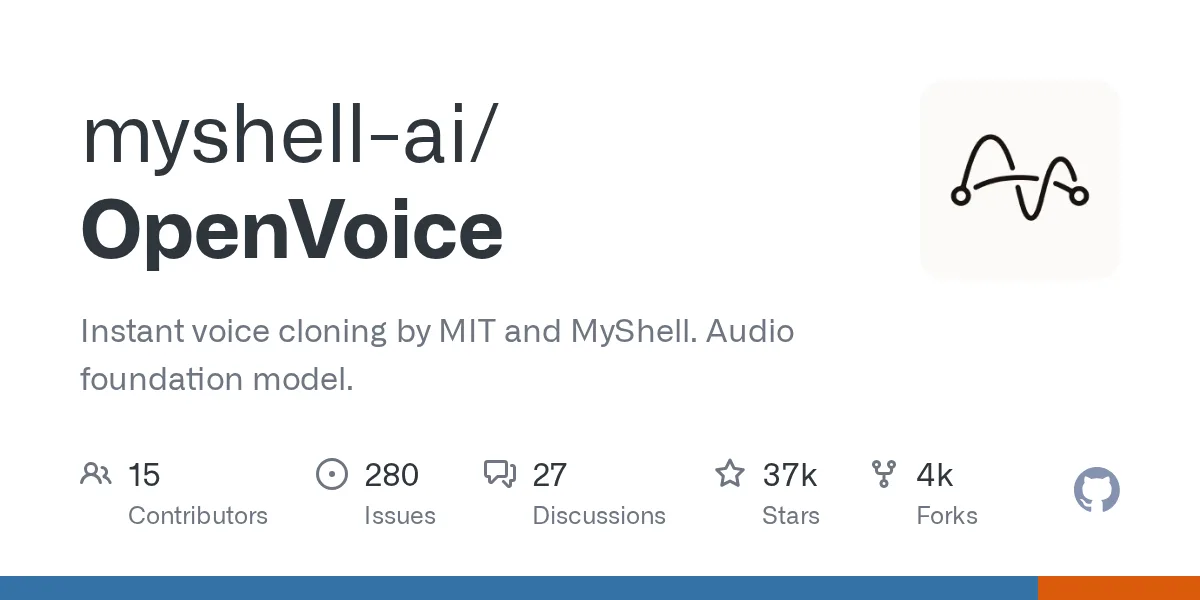

3. OpenVoice

Leichte Open-Source-Alternative, MIT-Lizenz

- Best for: Einzelclip-Klon, ressourcenschonende Umgebungen, permissive Lizenzierung

- Pricing: Kostenlos (MIT-Lizenz, selbstgehostet)

- Languages: 4+ Sprachen sofort verfügbar; Sprachstilübertragung zwischen ihnen

- Notable limitation: Geringere Sprachqualität als kommerzielle Marktführer; ressourcenschonendes Modell, daher weniger der Feinabstimmungsmöglichkeiten, die F5-TTS bietet

Wählen Sie OpenVoice, wenn F5-TTS nicht zu Ihren Anforderungen passt — Sie benötigen ein kleineres Modell, das auf schwächerer Hardware läuft, eine permissive Lizenz für kommerzielle Nutzung oder eine einfachere API. Der Qualitätskompromiss ist real, aber für nicht-kritische Anwendungsfälle (Entwurfsversionen, interne Tools, Prototypen für Barrierefreiheit) handhabbar.

Nebeneinander

Die gleichen vier Dimensionen über die drei Tools. Verwenden Sie dies, um die Entscheidung zu triangulieren, nachdem Sie die einzelnen Tool-Boxen gelesen haben.

| ElevenLabs | F5-TTS | OpenVoice | |

|---|---|---|---|

| Best for | Benutzerdefinierte Stimmen für Produkte, Hörbücher, IVR, Charakterstimmen für Medien | Selbstgehostetes Stimmenklonen, technische Teams, benutzerdefinierte Inferenz, Batch-Generierung | Einzelclip-Klon, ressourcenschonende Umgebungen, permissive Lizenzierung |

| Pricing | Abrechnung pro Zeichen – kostenloses Kontingent begrenzt; kostenpflichtige Pläne beginnen bei ca. 5 $/Monat | Kostenlos (selbstgehostet) – GPU-Kosten sind das Minimum | Kostenlos (MIT-Lizenz, selbstgehostet) |

| Languages | Über 30 Sprachen mit reifer Sprachbibliothek | Mehrsprachiger Null-Shot-Transfer; Community-Finetunes für ressourcenarme Sprachen | 4+ Sprachen sofort verfügbar; Sprachstilübertragung zwischen ihnen |

| Limitation | Geschlossene Plattform mit Inhaltsrichtlinien für Stimmenklonen (Zustimmungsüberprüfung erforderlich für benutzerdefinierte Stimmen); Kosten pro Zeichen summieren sich bei hohem Volumen | Benötigt eine GPU und Infrastruktur für Inferenz; Prosodie kann bei langen Clips (>30-45s) ohne Chunking abdriften; expressive Extreme (Lachen, Schreien) schwächen sich ab | Geringere Sprachqualität als kommerzielle Marktführer; ressourcenschonendes Modell, daher weniger der Feinabstimmungsmöglichkeiten, die F5-TTS bietet |

Welches für welchen Anwendungsfall

- Benutzerdefinierte Stimme für ein SaaS-Feature, Hörbuch oder IVR → ElevenLabs. Ausgereift, poliert, niedrige technische Anforderungen.

- Voice Cloning in großem Maßstab, selbstgehostet → F5-TTS. Kostenlos pro Clip, volle Kontrolle, GPU ist das Minimum.

- Ressourcenschonende Umgebung oder permissive Lizenz benötigt → OpenVoice. Leichteres Modell, MIT.

- Ein Video in eine andere Sprache lokalisieren und dabei die Stimme des Sprechers beibehalten → alle drei überspringen. Lesen Sie den nächsten Abschnitt.

Was ist, wenn Sie kein Voice Cloning *Tool* benötigen?

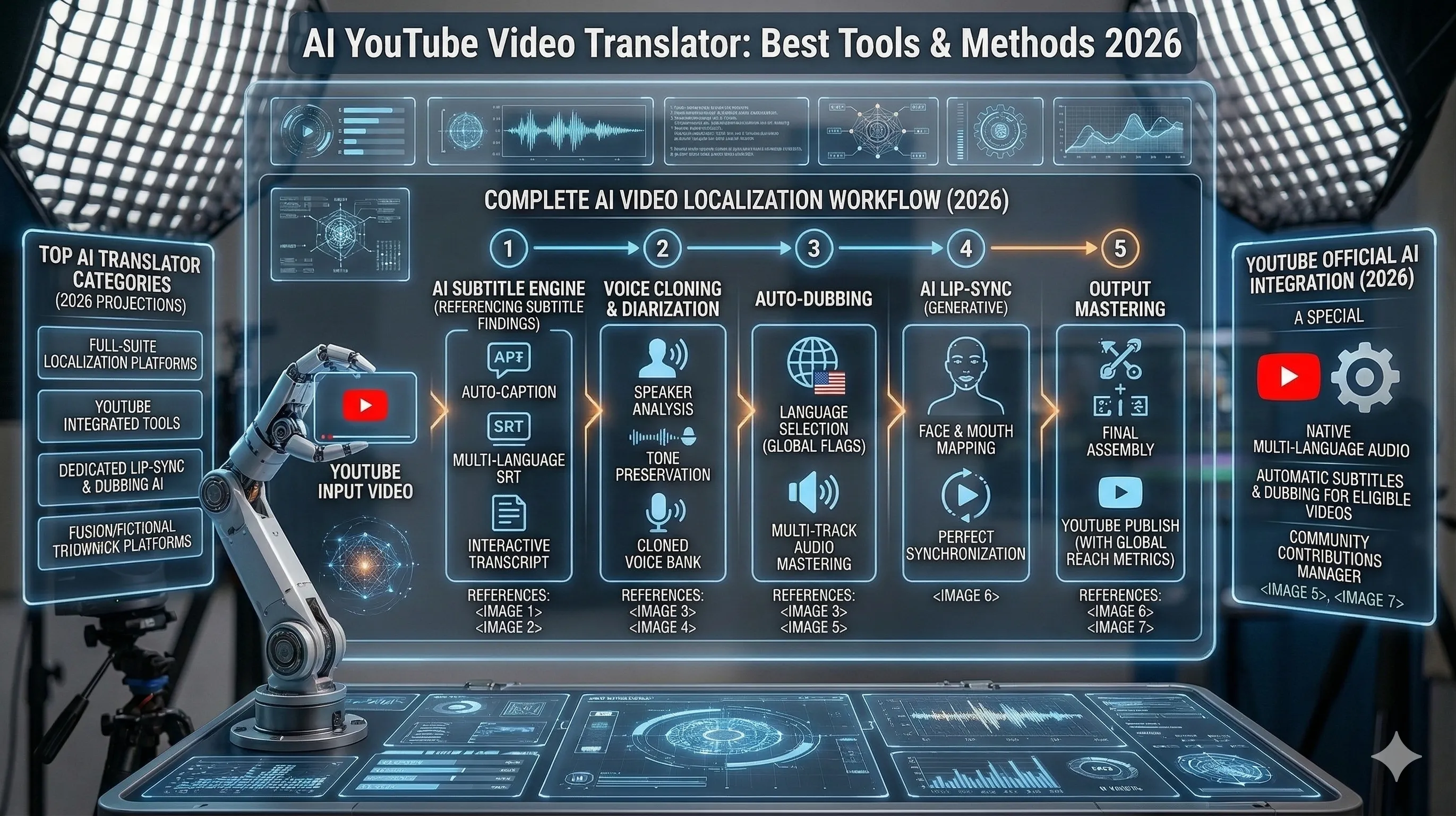

Die meisten Leser, die auf "beste Voice Cloning Tools" landen, versuchen tatsächlich, ein spezifisches Problem zu lösen: ein Video so klingen zu lassen wie der ursprüngliche Sprecher in einer anderen Sprache. Wenn das auf Sie zutrifft, benötigen Sie kein Voice Cloning Tool — Sie benötigen ein Synchronisationstool, das Voice Cloning intern verwendet.

Curify Video Dubbing klont die Stimme des ursprünglichen Sprechers aus dem Quellvideo, übersetzt den Ton, passt ihn an die Quellzeit an und liefert eine synchronisierte Spur in der Zielsprache mit bewahrter Identität des Sprechers. Das Voice Cloning ist unsichtbar — laden Sie ein Video hoch, wählen Sie eine Sprache, erhalten Sie eine Synchronisation. Die Pipeline basiert auf der gleichen F5-TTS-Linie, die oben behandelt wurde; der Unterschied ist, dass wir die Ausrichtung, Lippen-Synchronisation und Untertitelgenerierung darum kümmern, sodass Sie diese Teile nicht selbst zusammenstellen müssen.

Wann dies die richtige Wahl ist: Lokalisierung eines YouTube-Videos, eines Kursmoduls, einer Produktdemonstration, eines Webinars, eines Tutorials.

Wann es nicht ist: Klonen einer Stimme für eine TTS-API, IVR, Hörbuchnarration oder ein SaaS-Feature, bei dem Benutzer ihre eigene Stimme klonen — für diese Fälle bleiben Sie bei ElevenLabs oder F5-TTS oben. Andere Kategorie, anderes Tool.

Rechtliche Aspekte, die Sie kennen sollten, bevor Sie eine Stimme klonen

Keine Rechtsberatung – sprechen Sie mit einem Anwalt für Ihre Gerichtsbarkeit. Dennoch zeigen drei verteidigbare Praktiken überall auf:

- Zustimmung und Rechte. Holen Sie sich die ausdrückliche schriftliche Zustimmung des Stimmeneigentümers. Dokumentieren Sie die Herkunft des Referenzaudio. Die Persönlichkeitsrechte bestehen in einigen US-Bundesstaaten über den Tod hinaus; ein Anwalt kann dies für Sie klären.

- Offenlegung. Kennzeichnen Sie synthetische oder erheblich veränderte Stimmen, wo es die Plattform oder Gerichtsbarkeit erfordert. YouTube bietet während des Uploads einen Offenlegungsweg – nutzen Sie ihn.

- Vorsicht bei Telefonie. Die Erklärung der FCC von 2024 machte KI-generierte Stimmen in Robocalls ohne vorherige ausdrückliche Zustimmung illegal gemäß dem TCPA. Wenn Ihr Anwendungsfall die Telefonie berührt, ist dies der Blocker.

Häufig gestellte Fragen

Ist KI-Stimmklonen 2026 legal?

Es ist ein juristisches Flickwerk. USA: kein Bundesgesetz gegen Stimmklonen an sich, aber staatliche Rechte an der Öffentlichkeit treten bei nicht einvernehmlicher Nutzung in Kraft; die FCC-Entscheidung von 2024 macht KI-Stimmen in Robocalls illegal. EU: Die DSGVO behandelt Stimmen als biometrische Daten – ausdrückliche Zustimmung erforderlich, und Sie müssen die Verwendung für das Modelltraining offenlegen. Holen Sie sich immer ausdrückliche schriftliche Zustimmung vom Stimmeninhaber, dokumentieren Sie es und kennzeichnen Sie synthetische Inhalte, wo die Plattform es verlangt (YouTube, TikTok).

Wie viel Audio benötige ich, um eine Stimme zu klonen?

Hängt von der Stufe ab. Sofort-Klone (ElevenLabs Instant, OpenVoice) benötigen 10-30 Sekunden Referenzaudio und bieten 70-80% Treue. Professionelle Klone (ElevenLabs Professional, F5-TTS Finetune) benötigen 30+ Minuten sauberes Studioaudio und erreichen über 95% Treue. Wenn Sie Ihre eigene Stimme für ein Podcast-Intro klonen, ist die Sofort-Stufe in Ordnung. Wenn Sie eine Produktfunktion bereitstellen, gehen Sie professionell.

Kann ich die Stimme eines Prominenten für ein persönliches Projekt klonen?

Nein. Jede seriöse Plattform (ElevenLabs, Resemble, Respeecher) verbietet dies in ihren Nutzungsbedingungen. Es verstößt gegen die Rechte an der Öffentlichkeit in den meisten US-Bundesstaaten und das Urheberrecht in vielen Jurisdiktionen. Selbst wenn Sie ein Open-Source-Modell selbst hosten, ist die Verbreitung der Ausgabe eines Prominentenklons rechtlich angreifbar. Tun Sie es nicht.

Was ist der Unterschied zwischen Stimmklonen und Text-zu-Sprache (TTS)?

TTS wandelt geschriebenen Text in Sprache um, indem eine bereits vorhandene Stimme verwendet wird (oft eine kuratierte Stock-Stimme). Stimmklonen erzeugt Sprache in der Stimme einer bestimmten Person, die aus einer Referenzprobe erfasst wurde. Die meisten modernen Plattformen (ElevenLabs, F5-TTS) bieten beides an – sie sind TTS-Engines mit Klonen als Funktion. "Stimmklon-Tool" bedeutet normalerweise "die TTS-Engine, die ich verwende, um eine Stimme zu klonen."

Was ist Sprach-zu-Sprach (STS)?

Anderer Mechanismus: Sie nehmen sich auf, wie Sie eine Zeile vortragen (mit Ihrem Ton, Tempo, Emotion), und das Tool überträgt Ihre Darbietung auf eine andere Zielstimme. Nützlich für das Synchronisieren, wenn Sie möchten, dass die synchronisierte Stimme die emotionale Darbietung des ursprünglichen Schauspielers erbt. Respeecher ist darauf spezialisiert; ElevenLabs und andere haben es als Funktion. Anderes Problem als beim reinen Stimmklonen.

Ich möchte nur ein YouTube-Video in meiner eigenen Stimme synchronisieren. Welches Tool?

Keines der drei oben genannten allein – Sie würden eine Pipeline zusammenstellen. Sie müssten: (1) das Originalaudio extrahieren, (2) die Stimme des Sprechers klonen, (3) das Skript übersetzen, (4) synchronisiertes Audio in der geklonten Stimme generieren, (5) es an die Zeit des Quellvideos anpassen, (6) optional Lippenbewegungen synchronisieren. Curify Video Dubbing erledigt alle sechs Schritte von Anfang bis Ende. Stimmklonen ist intern; Sie laden ein Video hoch, wählen eine Sprache, erhalten eine Synchronisation. Andere Kategorie als "ein Stimmklon-Tool."

Die kurze Version

Drei Tools, eine Entscheidung: ElevenLabs, wenn Sie ein Produkt ausliefern und Politur + geringe Ingenieureingriffe wünschen; F5-TTS, wenn Sie eine GPU haben und keine Kosten pro Clip in großem Maßstab wollen; OpenVoice, wenn Sie ein leichteres Modell mit großzügiger Lizenzierung benötigen. Und wenn Ihr echtes Problem darin besteht, ein Video mit Ihrer eigenen Stimme zu synchronisieren, probieren Sie Curify – das Stimmenklonen erfolgt automatisch und Sie müssen keines der drei oben genannten lernen.

Take the next step

Putting what you read into practice.