Vertiefung: Technische Übersicht zur Transkription

Die meisten Transkriptionstools hören bei der Spracherkennung auf. Dieser tiefgehende Artikel beschreibt die vollständige Transkriptionspipeline von Curify: wie das Audio von Hintergrundmusik getrennt wird, wie WhisperX gegen den bereinigten Track läuft, wie die Sprecherdiarisierung überlappende Stimmen trennt und wie die erzwungene Ausrichtung Zeitstempel auf Wortebene wieder auf das Transkript setzt, sodass die Ausgabe nachgelagerte Untertitel-, Dubbing- und Übersetzungstools bei [/tools/video-transcript-generator](/tools/video-transcript-generator) steuern kann. Wenn Sie Transkription in eine größere Pipeline integrieren möchten, anstatt nur ein SRT herunterzuladen, ist dies die Ebene, die die meisten Blogbeiträge überspringen.

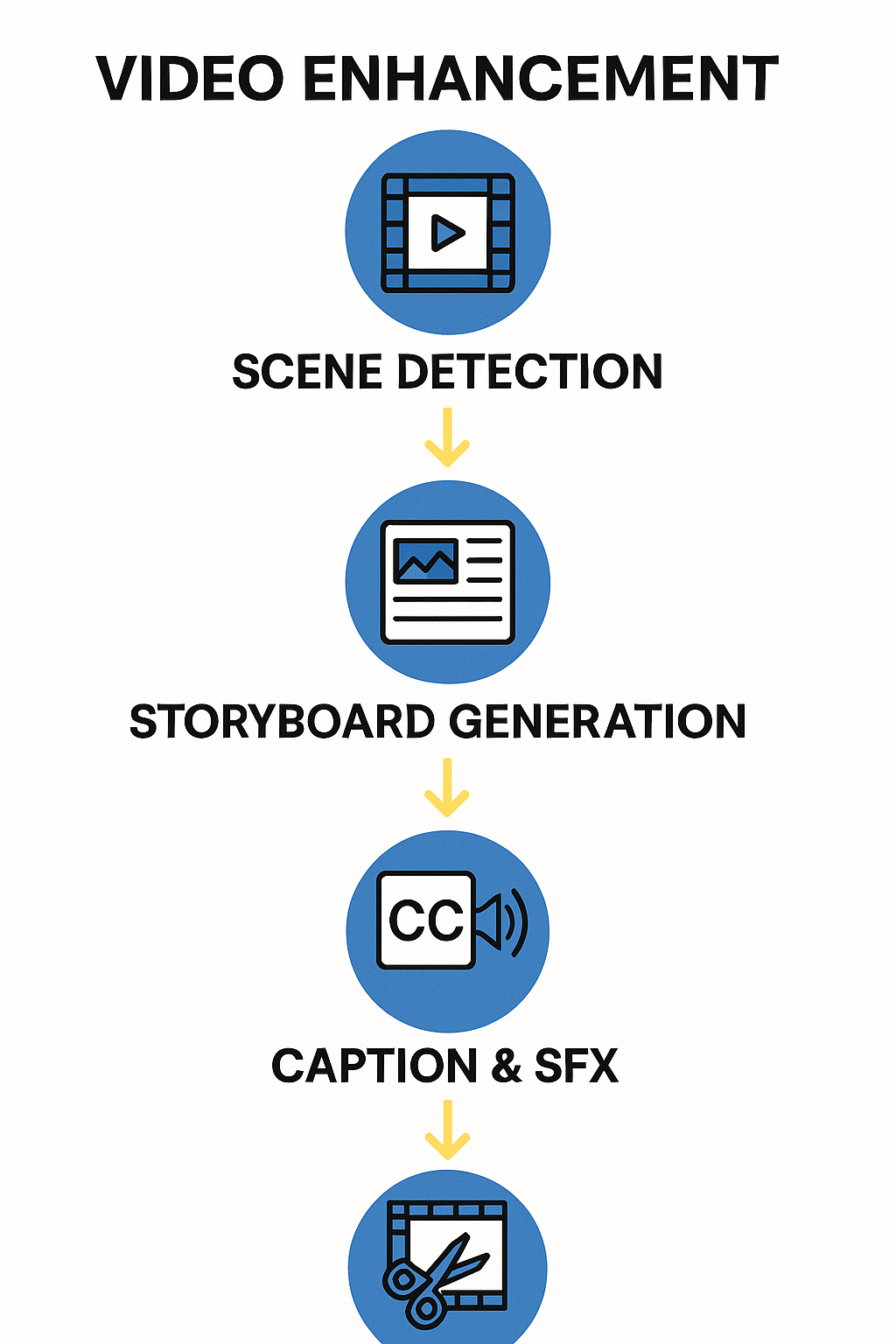

End-to-End-Video-Transkriptions-Pipeline

Eine produktionsgerechte Video-Transkriptions-Pipeline verwandelt rohe Video-Inhalte in strukturierte, zeitlich synchronisierte Texte durch mehrere anspruchsvolle Verarbeitungsstufen. Der vollständige Workflow: Video → Audioextraktion → Segmentierung → ASR (Automatische Spracherkennung) → Ausrichtung → Sprecherdiarisierung → Nachbearbeitung.

Jede Stufe adressiert spezifische technische Herausforderungen: Die Audioextraktion isoliert die Sprachspur, die Segmentierung zerlegt lange Audios in handhabbare Abschnitte, ASR wandelt Sprache in Text um, die Ausrichtung liefert Zeitstempel auf Wortebene, die Diarisierung identifiziert, wer wann sprach, und die Nachbearbeitung reinigt und formatiert das endgültige Ergebnis.

Moderne Systeme wie Curifys Pipeline erreichen über 95 % Genauigkeit, selbst unter schwierigen Bedingungen, indem sie Conv-TasNet für die Audio-Trennung, WhisperX für die Spracherkennung und fortschrittliche Cluster-Algorithmen für die Sprecheridentifikation kombinieren. Diese technische Vertiefung untersucht jede Komponente und deren Integrationsstrategien.

Warum technische Architektur für die Transkription wichtig ist

Genauigkeits- vs. Geschwindigkeitskompromisse: Größere Modelle bieten bessere Genauigkeit, erhöhen jedoch die Verarbeitungszeit und die Rechenkosten. Produktionssysteme müssen diese Faktoren basierend auf den Anforderungen des Anwendungsfalls ausbalancieren.

Herausforderungen bei der Skalierbarkeit: Echtzeit-Transkription erfordert Streaming-Verarbeitung und latenzarme Inferenz, während die Batch-Verarbeitung für Durchsatz und Kosteneffizienz optimiert werden kann.

Mehrsprachige Komplexität: Code-Switching (Mischung von Sprachen innerhalb von Sätzen) und mehrsprachige Inhalte erfordern spezialisierte Modelle, die den Kontext über Sprachgrenzen hinweg aufrechterhalten können.

Produktionszuverlässigkeit: Unternehmenssysteme benötigen Failover-Mechanismen, Qualitätsüberwachung und automatisierte Fehlerbehebung, um die Randfälle zu bewältigen, die bei realen Inhalten unvermeidlich auftreten.

Kernpipeline-Komponenten

Audio-Vorverarbeitung und Segmentierung

Die Pipeline beginnt mit einer anspruchsvollen Audio-Vorverarbeitung unter Verwendung von Conv-TasNet zur Quelltrennung und Audio-Segmentierung. Diese Stufe isoliert menschliche Sprache von Hintergrundmusik, Umgebungsgeräuschen und anderen Audioquellen durch zeitliche Audio-Trennung.

Technische Implementierung:

# Audio-Trennung mit Conv-TasNet

import torch

import torchaudio

from conv_tasnet import ConvTasNet

# Initialisieren Sie das Modell zur Quelltrennung

separator = ConvTasNet(

n_bases=512, # Anzahl der Basisfunktionen

kernel_size=16, # Größe des Faltungskernels

stride=8, # Schrittweite für zeitliche Faltungen

n_layers=8, # Anzahl der Faltungsschichten

n_src=2 # Anzahl der Quellen, die getrennt werden sollen

)

# Verarbeiten Sie das Audio-Wellenform bei 16 kHz

audio_tensor, sample_rate = torchaudio.load('input_video.wav')

if sample_rate != 16000:

resampler = torchaudio.transforms.Resample(sample_rate, 16000)

audio_tensor = resampler(audio_tensor)

# Quellen trennen

with torch.no_grad():

separated_sources = separator(audio_tensor)

speech_source = separated_sources[0] # Primäre Sprache extrahieren

Die Conv-TasNet-Architektur verwendet konvolutionale Encoder-Decoder-Strukturen mit zeitlichen konvolutionalen Netzwerken, um Audioquellen direkt aus rohen Wellenformen zu trennen und Informationsverluste zu vermeiden, die mit spektralen Ansätzen verbunden sind.

ASR (Speech-to-Text) mit WhisperX

Saubere Sprache wird in WhisperX eingespeist, eine verbesserte Version von OpenAIs Whisper-Modell, das für Transkriptionsgenauigkeit und -geschwindigkeit optimiert ist. Das System verarbeitet mehrere Sprecher, Dialekte und Akzente durch Sprecherdiarisierung – das automatische Segmentieren von Audio nach Sprecheridentität.

Technische Implementierung:

# Fortschrittliche Spracherkennung mit WhisperX

import whisperx

import torch

from whisperx.utils import get_writer

# Laden Sie das WhisperX-Modell für die Transkription

model = whisperx.load_model("large-v3", device="cuda")

# Führen Sie die Transkription mit Zeitstempeln auf Wortebene und Sprecherdiarisierung durch

result = model.transcribe(

speech_source,

batch_size=32, # In Batches zur Effizienz verarbeiten

language="auto", # Sprache automatisch erkennen

task="transcribe",

word_timestamps=True, # Zeitstempel auf Wortebene aktivieren

print_progress=True

)

# Synchronisieren Sie die Whisper-Ausgabe mit erzwungener Ausrichtung

model_a, metadata = whisperx.load_align_model(

language_code=result["language"],

device="cuda"

)

result = whisperx.align(

result["segments"],

model_a,

metadata,

speech_source,

device="cuda"

)

# Weisen Sie Sprecherbezeichnungen zu

diarize_model = whisperx.DiarizationPipeline(

use_auth_token=False,

device="cuda"

)

diarize_segments = diarize_model(speech_source)

result = whisperx.assign_word_speakers(diarize_segments, result)

WhisperX verbessert das Basis-Whisper-Modell durch optimierte Inferenz, bessere Sprecherdiarisierung und verbesserte Genauigkeit der Zeitstempel auf Wortebene. Der Schritt der erzwungenen Ausrichtung gewährleistet eine präzise Synchronisation zwischen Audio und Transkript.

Erzwungene Ausrichtung und Zeitstempel auf Wortebene

Die erzwungene Ausrichtung liefert präzise Zeitstempel auf Wortebene, die für hochwertige Untertitel, Videosynchronisation und nachgelagerte Sprachverarbeitung unerlässlich sind. In dieser Phase nimmt ein spezielles akustisches Modell das Audiosignal und ein anfängliches Transkript vom ASR-System und richtet sie mit einer viel feineren Granularität aus als die Roh-ASR-Ausgabe. Anstatt nur zu wissen, wann jeder Satz oder Abschnitt beginnt und endet, schätzt das System den genauen Beginn und das Ende jedes Wortes, manchmal sogar auf Phonemebene. Dieser Ausrichtungsprozess verwendet typischerweise probabilistische Sequenzmodelle, wie versteckte Markov-Modelle oder neuronale akustische Encoder, um die wahrscheinlichste Zeit für jedes Wort basierend auf den akustischen Beweisen und dem Transkript zu berechnen. Das Ergebnis ist eine reichhaltige Struktur, in der jedes Wort mit Startzeit, Endzeit und Vertrauensbewertungen annotiert ist, und Segmente mit detaillierten Zeitmetadaten angereichert sind. Diese präzisen Zeitstempel ermöglichen eine framegenaue Untertitelung, erlauben es Editoren, direkt zu bestimmten Teilen der Sprache in einer Videotimeline zu springen, und schaffen ein zuverlässiges zeitliches Rückgrat für spätere Aufgaben wie maschinelle Übersetzung, Synchronisation, Lippen-Synchronanalyse oder inhaltsbasierte Suche in großen Medienbibliotheken.

Implementierung der Sprecherdiarisierung

Die Sprecherdiarisierung ist dafür verantwortlich, die Frage zu beantworten, "wer wann sprach" während einer Audio- oder Videodatei und verwandelt ein rohes Transkript in ein strukturiertes, sprecherbewusstes Gespräch. Das System unterteilt zunächst das Audio in homogene Segmente, die wahrscheinlich einen dominanten Sprecher enthalten, und wandelt jedes Segment in eine kompakte numerische Darstellung um, die als Sprecher-Embedding bezeichnet wird und Merkmale wie Timbre, Tonhöhenmuster und Sprechstil erfasst. Mithilfe dieser Embeddings gruppieren Cluster-Algorithmen Segmente, die ähnlich klingen, in konsistente Sprecheridentitäten, ohne vorherige Kenntnisse darüber, wie viele Sprecher vorhanden sind oder wer sie sind. Fortschrittliche Diarisierungs-Pipelines können adaptiv die Anzahl der Sprecher schätzen, Grenzen verfeinern, an denen Sprecher sich überschneiden, und Labels glätten, sodass eine einzelne Person über lange Aufnahmen hinweg dieselbe Sprecher-ID zugewiesen bekommt. Das resultierende diarisierte Transkript verknüpft jedes Segment und oft jedes Wort mit einem stabilen Sprecherlabel, was Anwendungen wie Besprechungsprotokolle mit zusammenfassenden Informationen pro Sprecher, Call-Center-Analysen, personalisierte Inhaltsempfehlungen und klarere Untertitel ermöglicht, die anzeigen, welcher Charakter oder Teilnehmer in jedem Moment spricht.

Nachbearbeitung und Qualitätssicherung

Die Nachbearbeitungs- und Qualitätssicherungsphase verwandelt rohe Modelloutputs in ein poliertes, produktionsbereites Transkript, das für Endbenutzer und nachgelagerte Systeme geeignet ist. Die Nachbearbeitung beginnt typischerweise mit Normalisierungsschritten wie der Korrektur von Groß- und Kleinschreibung, der Erweiterung oder Standardisierung von Zahlen, der Handhabung von Akronymen und der Wiederherstellung von Interpunktion, sodass der Text wie natürliche Prosa und nicht wie eine flache Sequenz von Tokens gelesen wird. Zeitstempel werden dann in standardisierte Untertitel-Zeitcodes formatiert und das Transkript wird in lesbare Untertitel-Einheiten oder Absätze unterteilt, je nach Länge, Dauer und linguistischen Grenzen. Die Qualitätssicherung fügt dieser bereinigten Transkription eine Validierungsebene hinzu: Sie aggregiert Vertrauensbewertungen auf Wortebene in segmentbezogene Metriken, erkennt ungewöhnlich niedrige Vertrauenspassagen, abrupte Timing-Lücken oder verdächtige Wiederholungen und kennzeichnet sie zur menschlichen Überprüfung oder automatischen Nachbearbeitung. Zusätzliche Überprüfungen können Stilrichtlinien durchsetzen, Unflüssigkeiten oder Füllwörter entfernen, wenn dies angebracht ist, und sicherstellen, dass Sprecherlabels im gesamten Dokument konsistent bleiben. Zusammen gewährleisten diese Nachbearbeitungs- und QA-Schritte, dass das endgültige Ergebnis nicht nur widerspiegelt, was gesagt wurde, sondern auch die Genauigkeits-, Lesbarkeits- und Formatierungsstandards erfüllt, die für professionelle Transkription, Lokalisierung und Zugänglichkeits-Workflows erforderlich sind.

Technische Herausforderungen und Lösungen

Überlappende Sprache: Mehrere Sprecher, die gleichzeitig sprechen, schaffen ASR-Herausforderungen. Lösungen umfassen die Trennung von Audioquellen, Mehrsprecher-Modelle und anspruchsvolle Diarisierungsalgorithmen.

Mehrsprachiges Wechseln: Code-Switching zwischen Sprachen erfordert Modelle, die mehrere Sprachen gleichzeitig verarbeiten können. Fortschrittliche Systeme verwenden Sprachidentifikation und spezialisierte mehrsprachige Modelle.

Geräuschige Umgebungen: Hintergrundmusik, Umgebungsgeräusche und schlechte Audioqualität verringern die Transkriptionsgenauigkeit. Audio-Vorverarbeitungs- und Quelltrennungstechniken mindern diese Probleme.

Latenz vs. Genauigkeit: Echtzeitanwendungen erfordern geringe Latenz, können jedoch die Genauigkeit opfern. Produktionssysteme müssen diese konkurrierenden Anforderungen basierend auf dem Anwendungsfall ausbalancieren.

Entwurf des Produktionssystems

Batch- vs. Streaming-Verarbeitung: Die Batch-Verarbeitung optimiert für Kosten und Durchsatz, während die Streaming-Verarbeitung Echtzeit-Transkription für Live-Anwendungen ermöglicht.

GPU-Inferenzoptimierung: Modellquantisierung, Batch-Verarbeitung und Tensorparallelisierung reduzieren die Rechenkosten, während die Genauigkeit erhalten bleibt.

Pipeline-Orchestrierung: Nachrichtenwarteschlangen (wie Azure Service Bus) koordinieren zwischen den Verarbeitungsstufen und ermöglichen skalierbare, fehlertolerante Workflows.

Kostenoptimierungsstrategien: Dynamisches Batching, Spot-Instanzen und Modellkompression senken die Infrastrukturkosten, während die Service Level Agreements eingehalten werden.

Vergleich der technischen Architektur

| Komponente | Basis-ASR | WhisperX | Unternehmens-Pipeline |

|---|---|---|---|

| Audioverarbeitung | Einzelkanal | Grundlegende Filterung | Conv-TasNet-Trennung |

| Spracherkennung | HMM/GMM | Transformer | WhisperX + Feinabstimmung |

| Sprecherdiarisierung | Keine | Grundlegendes Clustering | Fortgeschrittenes Clustering + Sprachprofiling |

| Erzwungene Ausrichtung | Keine | Grundlegende Ausrichtung | Präzise Ausrichtung auf Wortebene |

| Qualitätssicherung | Manuell | Vertrauensbewertung | Automatisierte + menschliche Überprüfung |

| Skalierbarkeit | Begrenzt | Mittel | Unternehmensgröße |

| Genauigkeit | 70-85% | 90-95% | 95-98% |

Technische Kompromisse:

- Latenz vs. Genauigkeit: Größere Modelle bieten bessere Genauigkeit, erhöhen jedoch die Verarbeitungszeit

- Rechenkosten: GPU-Beschleunigung ist für die Verarbeitung im Produktionsmaßstab unerlässlich

- Modellgröße: Quantisierung reduziert den Speicherbedarf, kann jedoch die Genauigkeit in Grenzfällen beeinträchtigen

- Sprachunterstützung: Mehrsprachige Modelle erfordern mehr Speicher- und Rechenressourcen

Curifys Produktions-Transkriptionsarchitektur

Curifys Transkriptionssystem stellt eine produktionsgerechte Implementierung modernster Audioverarbeitungstechnologien dar, die für Skalierbarkeit, Genauigkeit und Zuverlässigkeit entwickelt wurden. Unsere Architektur kombiniert mehrere spezialisierte neuronale Netzwerke in einer einheitlichen Pipeline, die Video-Inhalte end-to-end mit minimalem menschlichen Eingriff verarbeitet.

Kerntechnische Komponenten:

Audioverarbeitungs-Stack: Mit Conv-TasNet zur Quelltrennung und WhisperX zur Transkription erreicht Curify über 95 % Genauigkeit, selbst in geräuschvollen Umgebungen. Das System verarbeitet Audio mit einer Auflösung von 16 kHz, wendet Echtzeit-Geräuschreduzierung und Sprecherdiarisierung an, um einzelne Stimmen zu isolieren.

Qualitätssicherungs-Pipeline: Automatisierte Vertrauensbewertungen identifizieren potenzielle Transkriptionsfehler zur menschlichen Überprüfung. Das System verwendet Sprachmodelle, die auf branchenspezifische Terminologie trainiert sind, um die Genauigkeit für technische Inhalte zu verbessern, mit Feinabstimmungsmöglichkeiten für branchenspezifischen Wortschatz.

Infrastruktur: Bereitgestellt auf GPU-Clustern mit verteilter Verarbeitung, die über 100 gleichzeitige Transkriptionsjobs verarbeitet. Das System verarbeitet 1 Stunde Video in etwa 2 Minuten, abhängig von der Komplexität des Inhalts und der Audioqualität.

Pipeline-Orchestrierung: Azure Service Bus-Warteschlangen koordinieren zwischen den Verarbeitungsstufen und ermöglichen fehlertolerante Workflows, die automatisch mit Fehlern und Wiederholungen umgehen können. Das System unterstützt sowohl die Batch-Verarbeitung zur Kosteneffizienz als auch das Streaming für Echtzeitanwendungen.

🎯 Bereit, fortschrittliche Transkriptions-Pipelines für Ihre Organisation zu implementieren? Entdecken Sie Curifys technische Transkriptionslösungen

Die Zukunft der Video-Transkriptionstechnologie

Die Technologie zur Video-Transkription hat sich von einfachen Spracherkennungssystemen zu komplexen mehrstufigen Pipelines entwickelt, die Fortschritte in neuronalen Netzwerken, Audioverarbeitung und Optimierungstechniken kombinieren. Moderne Systeme wie die Pipeline von Curify zeigen, wie Conv-TasNet zur Audio-Trennung, WhisperX zur Transkription und fortschrittliche Qualitätssicherung in produktionsreife Workflows integriert werden können.

Für technische Teams und Entwickler ist die wichtigste Erkenntnis, dass die Video-Transkription kein Forschungsproblem mehr ist, sondern eine gelöste ingenieurtechnische Herausforderung. Die verbleibenden Möglichkeiten liegen in der Optimierung, in Randfällen und in der Integration, nicht in grundlegenden technologischen Einschränkungen. Während diese Systeme durch bessere Modellarchitekturen und größere Trainingsdatensätze weiterhin verbessert werden, nähern wir uns einer Zukunft, in der perfekte Transkription in großem Maßstab für jeden Inhaltstyp verfügbar ist.

Die hier beschriebene technische Architektur stellt den aktuellen Stand der Technik im Jahr 2026 dar, aber das Feld entwickelt sich weiterhin schnell. Echtzeit-Transkription, Zero-Shot-Sprecheridentifikation und automatisierte Inhaltszusammenfassungen sind bereits aufkommende Fähigkeiten, die weiter transformieren werden, wie wir die Verarbeitung und Analyse von Videoinhalten angehen.

Verwandte Artikel

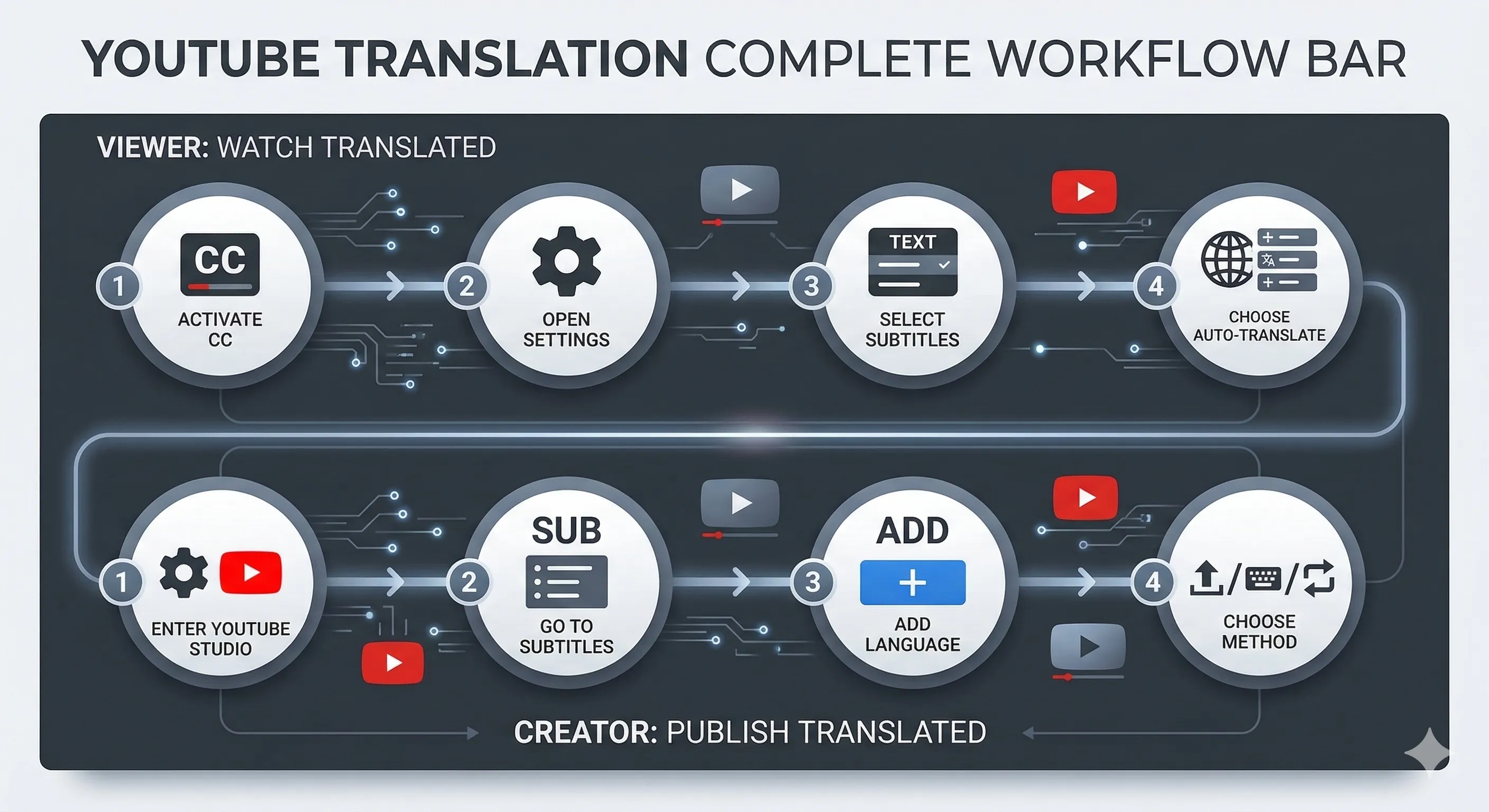

video-translation-dubbing

How We Built an AI Content Production System (Not Just Tools)

Inside Curify's Video Translation Pipeline: A Technical Deep-Dive