So übersetzen Sie ein YouTube-Video ins Englische: 3 Methoden im Jahr 2026

Sie haben ein YouTube-Video auf Spanisch, Japanisch oder Mandarin gefunden – und möchten es auf Englisch. Vielleicht ist es ein Tutorial, das Sie wirklich brauchen, eine Kursvorlesung, ein viraler Clip, den Ihr Freund geteilt hat, oder Ihr eigenes Video, das Sie für ein breiteres Publikum veröffentlichen möchten. Im Jahr 2026 haben Sie drei echte Optionen, und die richtige hängt davon ab, ob Sie zuschauen, lernen oder veröffentlichen. Dieser Leitfaden behandelt alle drei – automatische Untertitel, vollständige Synchronisation mit Sprachklonung und zweisprachige Untertitel – mit den Kompromissen, die tatsächlich wichtig sind.

Drei Möglichkeiten, ein YouTube-Video zu übersetzen

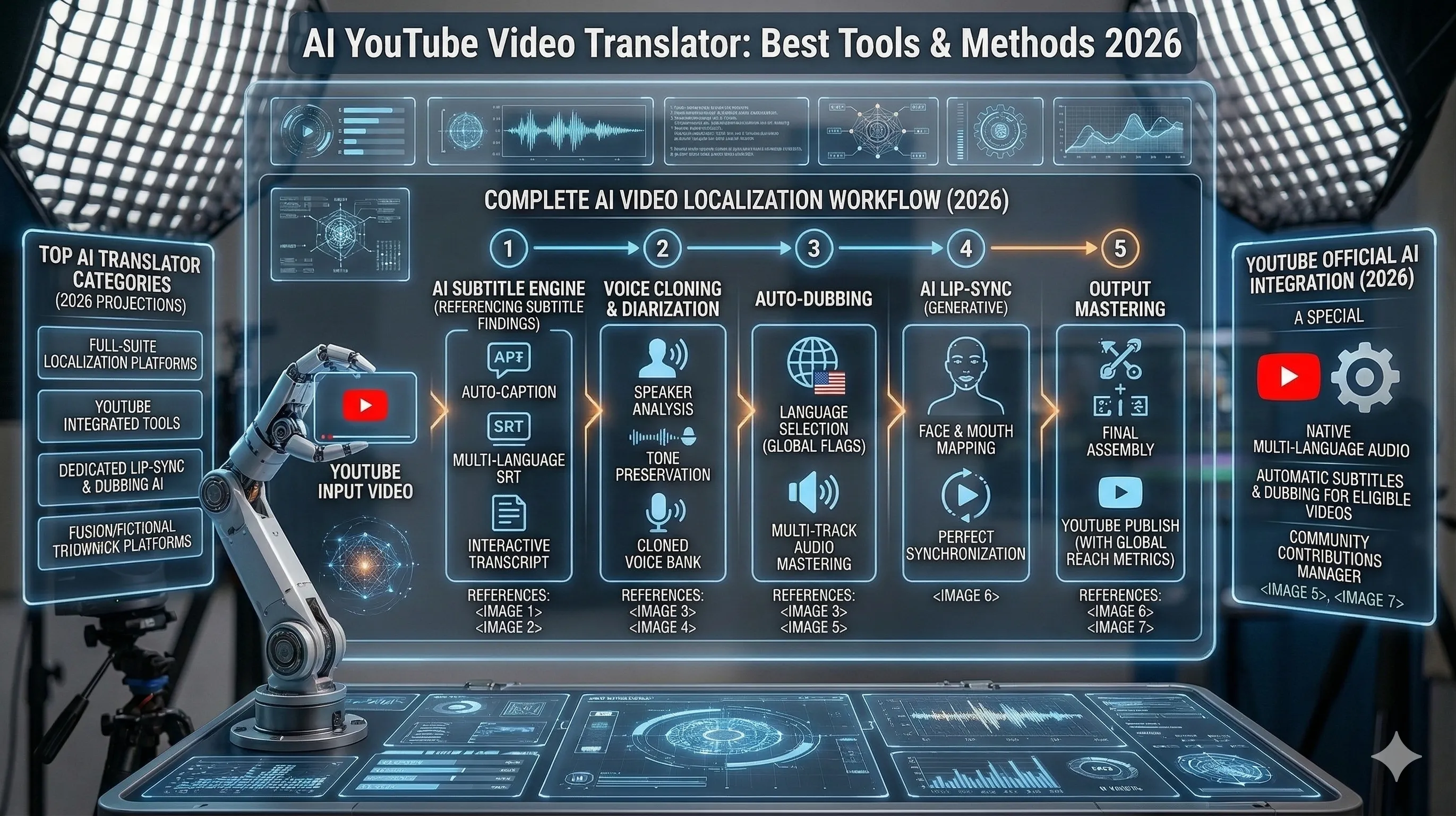

Es gibt keinen einzelnen "YouTube-Übersetzer", da drei verschiedene Probleme hinter einem Begriff verborgen sind. (1) Sie möchten ein Video in Ihrer Sprache ansehen – gelöst durch Untertitel, oft der schnellste Weg. (2) Sie möchten eine veröffentlichbare Version in einer anderen Sprache – gelöst durch vollständige Synchronisation mit Sprachklonung, langsamer, aber besser teilbar. (3) Sie möchten die Ausgangssprache beim Ansehen lernen – gelöst durch zweisprachige Untertitel, der ideale Punkt zum Sprachenlernen.

Dieser Leitfaden behandelt alle drei. Jede Methode hat eine kostenlose oder nahezu kostenlose Option für den gelegentlichen Gebrauch und eine kostenpflichtige Option, die den Feinschliff bietet, den Sie für die Produktion wünschen. Wählen Sie nach Anwendungsfall, nicht danach, welche am "besten" ist – sie lösen unterschiedliche Probleme.

Warum eine einzige Methode nicht für alles funktioniert

YouTubes integrierte automatische Übersetzung ist praktisch, aber grob – sie bewältigt gängige Dialoge ganz gut und scheitert an Idiomen, Slang, Akzenten, technischem Jargon und überall dort, wo der Kontext wichtig ist. Für einen 5-minütigen Clip ist das in Ordnung; für eine 90-minütige Kursvorlesung macht die kumulative Abweichung es unansehbar.

Synchronisation ist der gegenteilige Kompromiss: langsamer in der Produktion, aber einfacher anzusehen. Wenn Sie an ein Publikum veröffentlichen, das keine Untertitel lesen wird (Kinder, ältere Zuschauer, jeder, der etwas anderes tut), ist Synchronisation unverzichtbar.

Zweisprachige Untertitel sind die Geheimwaffe des Sprachlerners – zeigen Sie beide Sprachen übereinander gestapelt, sodass Sie die Übersetzung lesen, während Sie das Original hören. Dies ist die einzige Methode, die Ihnen tatsächlich die Ausgangssprache beibringt, während Sie zuschauen.

Die drei Methoden unten sind nicht nach Rang geordnet. Jede löst ein spezifisches Problem besser als die anderen beiden.

Drei Methoden, nebeneinander

Methode 1: Auto-Untertitel + Browser-Übersetzung (Kostenlos, Schnellste)

Am besten für: schnelles Ansehen eines einzelnen Videos in einer anderen Sprache. Zeitaufwand: 30 Sekunden.

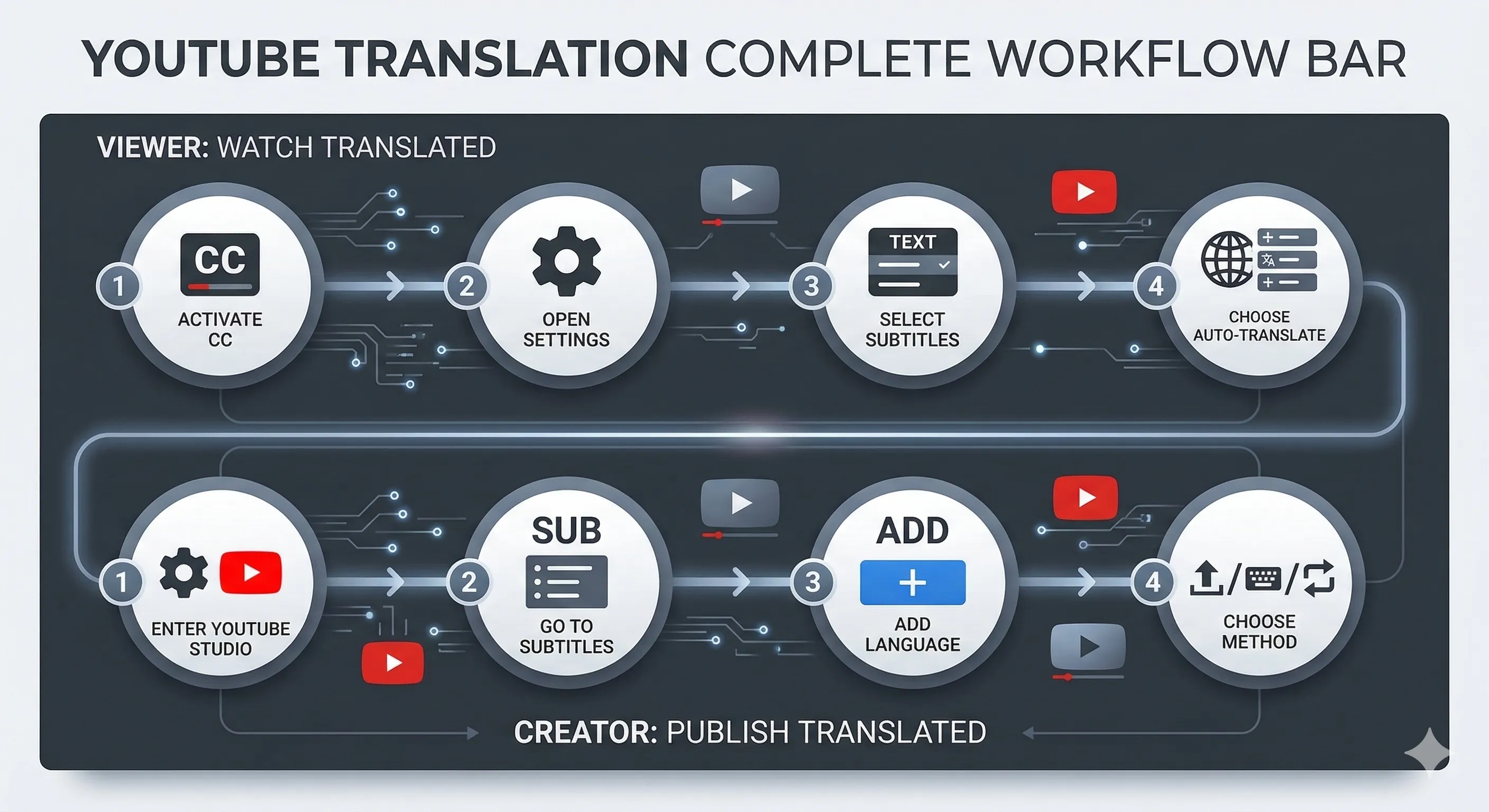

Jedes YouTube-Video, das Untertitel aktiviert hat, kann von YouTube selbst automatisch übersetzt werden. Aktivieren Sie die CC-Taste, öffnen Sie das Einstellungszahnrad → Untertitel → Automatische Übersetzung → Englisch. YouTube generiert eine englische Übersetzung in Echtzeit mit Googles Übersetzungs-Backend.

Was funktioniert: gesprächiger Dialog in großen Sprachpaaren (Spanisch, Französisch, Deutsch, Japanisch, Koreanisch, Chinesisch werden gut entschlüsselt). Die Pipeline ist kostenlos, sofort und funktioniert bei jedem Video, bei dem der Ersteller die Untertitel nicht deaktiviert hat.

Was nicht funktioniert: technischer Jargon (Programmierbegriffe, medizinisches Vokabular, Nischenhobbys), starke Akzente, Idiome, schnelles Sprechen. Die Übersetzungen sind auf Wortebene, sodass die Satzstruktur wie gebrochenes Englisch wirken kann. Und bei Videos, bei denen der Ersteller die Untertitel vollständig deaktiviert hat, ist diese Methode überhaupt nicht anwendbar.

Upgrade-Pfad: Wenn YouTubes automatische Übersetzung zu viel verpasst, fügen Sie die Video-URL in /tools/video-transcription ein, um ein besseres Transkript zu erhalten – langsamer, aber von viel höherer Qualität, insbesondere bei technischem Inhalt.

Methode 2: Vollständige Synchronisation mit Sprachklonung (Kostenpflichtig, Teilbar)

Am besten für: das Video in einer anderen Sprache für ein Publikum, das keine Untertitel lesen wird, neu zu veröffentlichen. Zeitaufwand: 5-15 Minuten Verarbeitungszeit pro Minute Video.

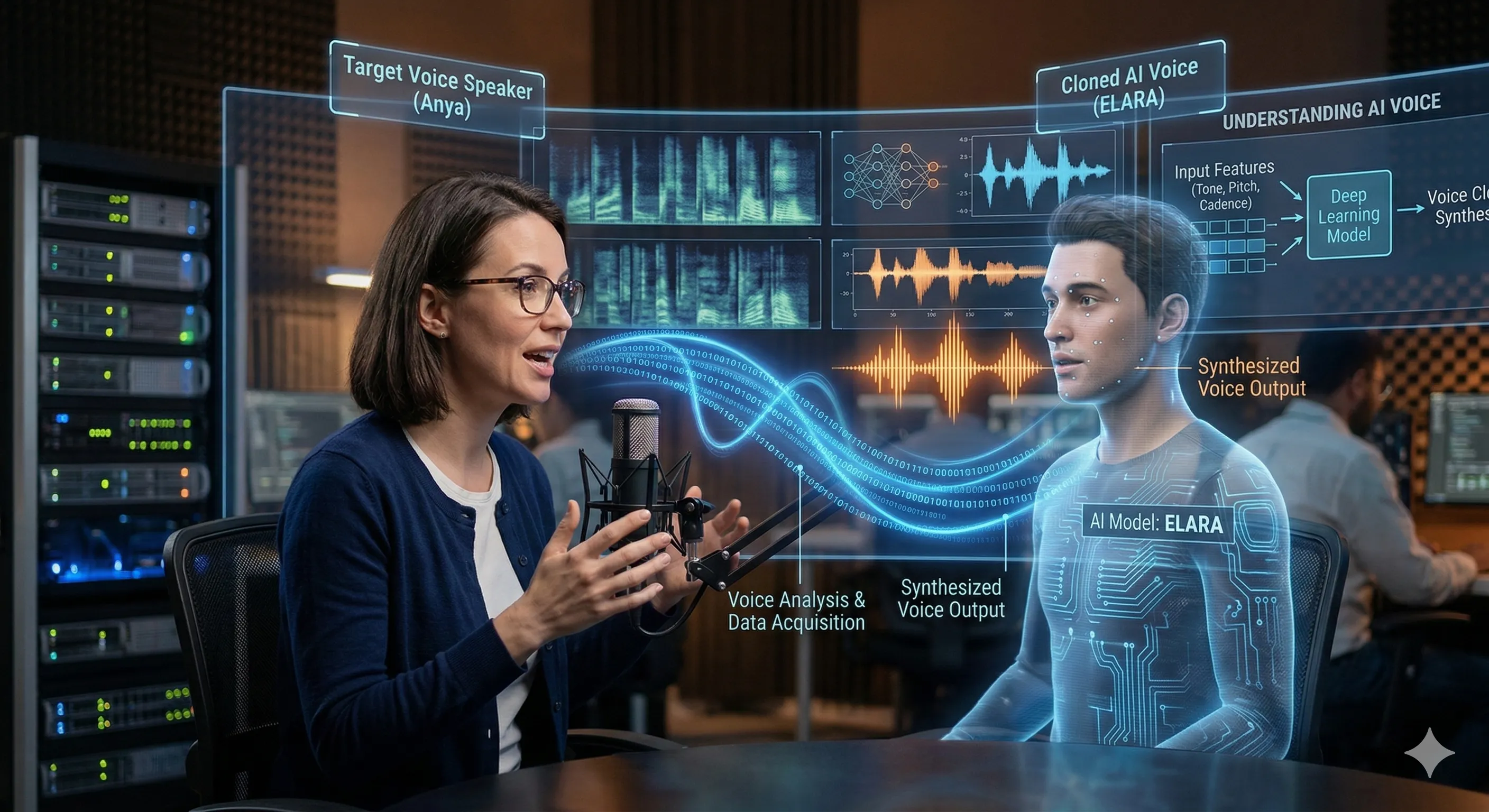

Die vollständige Synchronisation ersetzt den Originalton durch eine englische Spur in der Stimme des ursprünglichen Sprechers (kloniert), und synchronisiert die Mundbewegungen über Lip-Sync, sodass es nicht wie eine Überdubbing aussieht. Das Ergebnis ist ein ansehbares Video, das so klingt, als hätte der Sprecher tatsächlich die englische Version gesagt.

Der Workflow auf Curify unter /tools/video-dubbing: Fügen Sie eine YouTube-URL ein oder laden Sie das Video hoch, wählen Sie die Zielsprache aus, und die Pipeline durchläuft fünf Phasen – trennt die Sprache von der Hintergrundmusik, transkribiert den Ton, übersetzt das Transkript, klont die Stimme des Sprechers und synchronisiert die Mundbewegungen neu. Ein Upload produziert drei Artefakte: den synchronisierten Ton, das neue Video mit synchronisierten Mundbewegungen und eine passende Untertiteldatei.

Was funktioniert: Talking-Head-Inhalte, die frontal aufgenommen wurden – Interviews, Kursaufzeichnungen, Produktdemonstrationen, Podcast-Videos. Das Ergebnis ist bereit zur Veröffentlichung für Talking-Head-Material.

Was nicht funktioniert: Profilwinkel (das Lip-Sync-Modell ist auf frontal sprechende Personen trainiert), starke Bärte oder Hand-zu-Gesicht-Blockierungen (das Modell verliert die Mundgrenze) und lange gehaltene Mundpausen. Für dokumentarische B-Roll mit dem Sprecher außerhalb der Kamera sollten Sie auf die Untertitel-only-Lokalisierung bei diesen Schnitten zurückgreifen.

Kosten: Bezahlung pro Minute. Ein 10-minütiges Talking-Head-Video benötigt etwa die gleiche Gesamtverarbeitungszeit wie eine manuelle Synchronisation in menschlichen Stunden, zu einem kleinen Bruchteil der Kosten.

Methode 3: Zweisprachige Untertitel (Kostenlos oder Kostenpflichtig, Am besten zum Lernen)

Am besten für: Sprachlerner, ESL-Lehrer, Eltern, die Videos für die zweite Sprachförderung von Kindern nutzen. Zeitaufwand: 2-5 Minuten.

Zweisprachige Untertitel zeigen beide Sprachen übereinander gestapelt – die Originalsprache auf einer Zeile, die englische Übersetzung direkt darunter. Sie hören die Ausgangssprache, während Sie beide lesen, was der tatsächlichen Sprachaneignung in der Praxis entspricht.

Der Curify-Workflow unter /tools/bilingual-subtitles: Fügen Sie eine YouTube-URL ein, wählen Sie die Ausgangs- und Zielsprache aus, und das Tool generiert eine .srt-Datei mit beiden Sprachen, die auf die gleichen Zeitstempel ausgerichtet sind. Brennen Sie es ins Video für eine permanente Anzeige oder fügen Sie es als umschaltbare Untertitelspur hinzu.

Warum diese Methode wichtig ist: Die Übersetzung nur mit Untertiteln lässt die Audiohinweise der Ausgangssprache vollständig weg. Zweisprachige Untertitel bewahren sie. Wenn Ihr Ziel darin besteht, die Sprache *während des Ansehens* zu lernen, ist dies die einzige Methode, die das tatsächlich tut. Eltern, die ihren Kindern eine Herkunftssprache beibringen, finden dies besonders nützlich – das Kind hört den Originalton und sieht beide schriftlichen Formen nebeneinander.

Kostenlose Alternative: Aktivieren Sie die Originalsprache CC auf YouTube + verwenden Sie eine Browsererweiterung wie Language Reactor oder Subadub, um eine Übersetzung in einer zweiten Sprache zu überlagern. Weniger präzise als ein generiertes .srt, aber kostenlos und funktioniert im Browser ohne Download.

So wählen Sie zwischen den drei Methoden

Wählen Sie Methode 1 (Auto-Untertitel), wenn Sie einfach nur jetzt sofort ein einzelnes Video ansehen möchten, in den nächsten 30 Sekunden, und es Ihnen nichts ausmacht, dass einige Zeilen möglicherweise leicht abweichen.

Wählen Sie Methode 2 (vollständige Synchronisation), wenn Sie das Video für ein Publikum neu veröffentlichen – Ihren eigenen YouTube-Kanal, ein internes Schulungsvideo für ein globales Team, einen Kurs, den Sie verkaufen. Überall dort, wo der Zuschauer keine Untertitel lesen wird.

Wählen Sie Methode 3 (zweisprachige Untertitel), wenn Sie die Ausgangssprache lernen, sie unterrichten oder Inhalte für Sprachlerner erstellen.

Sie können sie auch kombinieren: synchronisieren Sie die Haupt-Talking-Head-Segmente (Methode 2), verwenden Sie zweisprachige Untertitel für die Bildungsabschnitte (Methode 3) und greifen Sie auf die automatische Übersetzung für B-Roll zurück, wo der Sprecher außerhalb der Kamera ist (Methode 1). Curifys Pipeline produziert alle drei Artefakte aus einem Upload, sodass dasselbe Ausgangsvideo allen drei Zielgruppen dienen kann, ohne erneut hochzuladen.

Schritt 5: Qualitätsprüfung vor der Veröffentlichung

Egal, welche Methode Sie wählen, führen Sie diese drei Überprüfungen vor der Veröffentlichung oder dem Teilen durch:

1. Überprüfen Sie die Übersetzung an mindestens 3 zufälligen Zeitstempeln. Wählen Sie einen nahe dem Anfang, einen in der Mitte, einen nahe dem Ende. Lesen Sie die Übersetzung, während Sie das Original hören. Wenn es an einem der drei deutlich abweicht, hat das gesamte Transkript wahrscheinlich dasselbe Problem – übersetzen Sie erneut oder akzeptieren Sie die Qualität.

2. Hören Sie den synchronisierten Ton (nur Methode 2) auf das Tempo. Wenn englische Sätze kürzer oder länger als das Original sind, wird das Lip-Sync in die eine oder andere Richtung abdriften. Die meisten Pipelines polstern oder komprimieren automatisch, um dies auszugleichen, aber das Ergebnis kann gehetzt oder gestreckt klingen. Rendern Sie mit einer anderen Tempo-Strategie neu, wenn es auffällig ist.

3. Überprüfen Sie das Lip-Sync bei Profilaufnahmen (nur Methode 2). Hier scheitert das Modell am häufigsten. Wenn ein wichtiger emotionaler Moment von der Seite aufgenommen wird, akzeptieren Sie, dass das Lip-Sync dort leicht abweichen wird – oder schneiden Sie für diese Zeile zu einem anderen Winkel.

Für den gelegentlichen Gebrauch benötigt Methode 1 keine Qualitätsprüfung (es ist gut genug oder nicht, und Sie werden es in 10 Sekunden wissen). Methoden 2 und 3 belohnen eine 2-minütige Überprüfung vor der Veröffentlichung.

Werkzeugvergleich: Was jede Methode benötigt

| Methode | Werkzeug | Kosten | Zeit | Am besten für |

|---|---|---|---|---|

| Auto-Untertitel | YouTube integrierte CC + automatische Übersetzung | Kostenlos | 30 Sek | Gelegentliches Ansehen, einzelne Videos |

| Auto-Untertitel (besser) | Curify Video Transcription | Bezahlung pro Minute | 2-5 Min | Wenn YouTube CC zu viel verpasst |

| Vollständige Synchronisation | Curify Video Dubbing | Bezahlung pro Minute | 5-15 Min/Min | Neuveröffentlichung für nicht lesende Zuschauer |

| Vollständige Synchronisation (Alternative) | ElevenLabs Voice Studio | Abonnement | Manuelle Einrichtung | Wenn Sie feinkörnige Sprachkontrolle benötigen |

| Zweisprachige Untertitel | Curify Bilingual Subtitles | Bezahlung pro Minute | 2-5 Min | Sprachen lernen, ESL-Unterricht |

| Zweisprachige Untertitel (kostenlos) | Language Reactor + YouTube CC | Kostenlos | Browser-Plugin | Lernen beim Ansehen, keine Produktion |

Die drei Curify-Tools teilen sich eine Pipeline-Basis – fügen Sie einmal eine YouTube-URL ein, wählen Sie die benötigten Ausgabeformate aus, und dasselbe Upload produziert die Untertiteldatei, den synchronisierten Ton oder die zweisprachige

.srt. Spart das erneute Kodieren und Hochladen für jedes Format.Wie Curify die drei Methoden zusammenbringt

Curifys /tools/video-dubbing und /tools/bilingual-subtitles laufen auf einer gemeinsamen Pipeline, sodass Sie alle drei Methodenoutputs aus einem einzigen YouTube-URL-Upload erzeugen können:

1. Das Transkript (Upgrade-Pfad für Methode 1) – sauber, zeitlich abgestimmt, bereit zur Übersetzung oder zur Übergabe an ChatGPT für einen Feinschliff.

2. Das synchronisierte Video (Methode 2) – übersetzter Ton in einer geklonten Stimme, lippsynchronisiert, mit einer passenden Untertiteldatei, die zur gleichen Zeit produziert wird.

3. Die zweisprachige Untertiteldatei (Methode 3) – Original + Zielsprache, die auf die gleichen Zeitstempel ausgerichtet sind, bereit, ins Video gebrannt oder als umschaltbare Spur angehängt zu werden.

Die Tools teilen Eingaben, produzieren jedoch unterschiedliche Ausgaben, sodass Sie das Artefakt dem Publikum anpassen können, ohne die Quelle erneut hochzuladen. Die Preisgestaltung erfolgt pro Minute des Ausgangsvideos; kein Abonnement, kein monatliches Minimum.

Wenn Sie die Sicht des Ingenieurs darauf haben möchten, wie jede Pipeline-Phase funktioniert – Audioquellen-Trennung, neuronale Übersetzung, Sprachklonung, Lip-Sync-Ausrichtung – sehen Sie sich den technischen Architekturüberblick unter /blog/video-transcription-technical-deep-dive an. Dieser Leitfaden ist die Sicht des Benutzers auf dieselbe Pipeline.

Wählen Sie die Methode, überspringen Sie die Pipeline

"Wie übersetze ich ein YouTube-Video ins Englische" sind drei verschiedene Fragen in einer. Methode 1 (Auto-Untertitel) behandelt gelegentliches Ansehen. Methode 2 (vollständige Synchronisation) behandelt die Veröffentlichung. Methode 3 (zweisprachige Untertitel) behandelt das Lernen. Die Werkzeuge für alle drei sind seit 2024 dramatisch besser geworden – was früher fünf separate Skripte und eine GPU erforderte, ist jetzt im Jahr 2026 ein einziger URL-Eintrag.

Die eine Warnung, die ernst genommen werden sollte: Jede KI-Übersetzungspipeline hat Randfälle. Starke Akzente, technischer Jargon, schnelles Sprechen, Lip-Sync bei Profilansichten – das sind echte Fehlerquellen, keine theoretischen. Überprüfen Sie das Ergebnis, bevor Sie sich zur Veröffentlichung verpflichten. Die 2-minütige Überprüfung ist der Unterschied zwischen einem großartigen übersetzten Video und einem, das in den ersten 30 Sekunden Zuschauer verliert.

Take the next step

Putting what you read into practice.

Verwandte Artikel

Video Translation

KI YouTube Video Übersetzung: Beste Tools, Methoden & Ergebnisse 2026