深入探讨:转录技术概述

大多数转录工具停留在语音转文本。这篇深入探讨讲解了Curify的完整转录流程:音频如何与背景音乐分离,WhisperX如何在清理后的音轨上运行,发言者分离如何分割重叠的声音,以及强制对齐如何将单词级时间戳重新放回转录文本中,以便输出可以驱动下游字幕、配音和翻译工具,位于[/tools/video-transcript-generator](/tools/video-transcript-generator)。如果您想将转录集成到更大的流程中,而不仅仅是下载SRT,这是大多数博客文章跳过的层级。

端到端视频转录管道

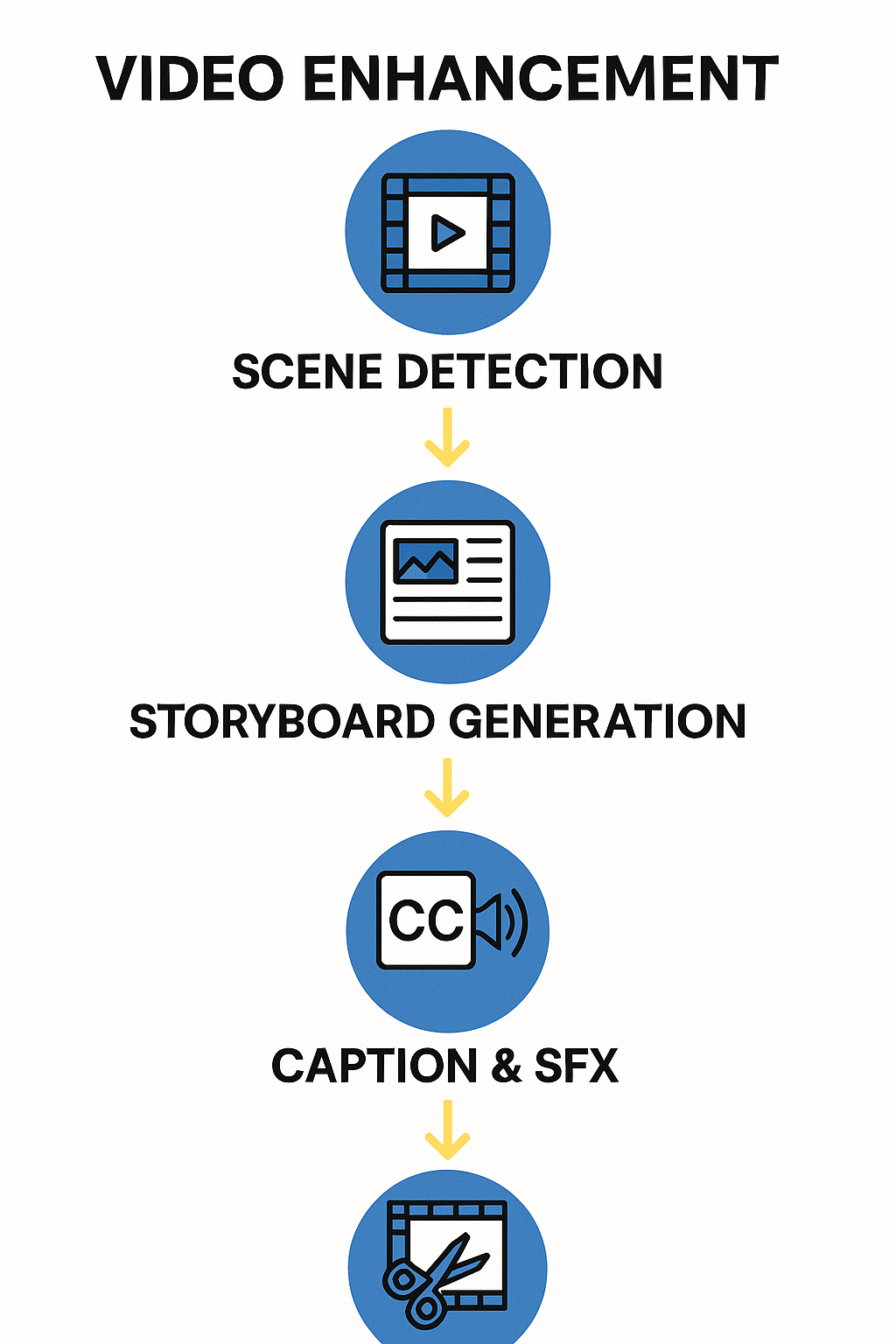

生产级视频转录管道通过多个复杂的处理阶段将原始视频内容转化为结构化、时间同步的文本。完整的工作流程:视频 → 音频提取 → 分段 → ASR(自动语音识别) → 对齐 → 说话者区分 → 后处理。

每个阶段解决特定的技术挑战:音频提取隔离语音轨道,分段将长音频分解为可管理的块,ASR 将语音转换为文本,对齐提供单词级时间戳,区分识别谁在何时说话,后处理清理和格式化最终输出。

像 Curify 的管道这样的现代系统在挑战条件下也能实现 95% 以上的准确率,通过结合 Conv-TasNet 进行音频分离、WhisperX 进行语音识别和先进的聚类算法进行说话者识别。这个技术深入探讨探索了每个组件及其集成策略。

为什么技术架构对转录很重要

准确性与速度的权衡:更大的模型提供更好的准确性,但会增加处理时间和计算成本。生产系统必须根据用例要求平衡这些因素。

可扩展性挑战:实时转录需要流处理和低延迟推理,而批处理可以优化吞吐量和成本效率。

多语言复杂性:代码切换(在句子中混合语言)和跨语言内容需要能够跨语言边界保持上下文的专用模型。

生产可靠性:企业系统需要故障转移机制、质量监控和自动错误恢复,以处理现实内容中不可避免出现的边缘情况。

核心管道组件

音频预处理和分段

管道以使用 Conv-TasNet 进行源分离和音频分段的复杂音频预处理开始。此阶段通过时域音频分离将人声与背景音乐、环境噪声和其他音频源隔离。

技术实现:

# 使用 Conv-TasNet 进行音频分离

import torch

import torchaudio

from conv_tasnet import ConvTasNet

# 初始化源分离模型

separator = ConvTasNet(

n_bases=512, # 基函数数量

kernel_size=16, # 卷积核大小

stride=8, # 时间卷积的步幅

n_layers=8, # 卷积层数

n_src=2 # 要分离的源数量

)

# 以 16kHz 处理音频波形

audio_tensor, sample_rate = torchaudio.load('input_video.wav')

if sample_rate != 16000:

resampler = torchaudio.transforms.Resample(sample_rate, 16000)

audio_tensor = resampler(audio_tensor)

# 分离源

with torch.no_grad():

separated_sources = separator(audio_tensor)

speech_source = separated_sources[0] # 提取主要语音

Conv-TasNet 架构使用卷积编码-解码结构和时间卷积网络直接从原始波形中分离音频源,避免了与基于声谱图的方法相关的信息损失。

使用 WhisperX 的 ASR(语音转文本)

清晰的语音输入 WhisperX,这是 OpenAI 的 Whisper 模型的增强版本,优化了转录的准确性和速度。该系统通过说话者区分处理多个说话者、方言和口音——自动按说话者身份分段音频。

技术实现:

# 使用 WhisperX 进行高级语音识别

import whisperx

import torch

from whisperx.utils import get_writer

# 加载 WhisperX 模型进行转录

model = whisperx.load_model("large-v3", device="cuda")

# 执行转录,带有单词级时间戳和说话者区分

result = model.transcribe(

speech_source,

batch_size=32, # 为了效率以批处理方式处理

language="auto", # 自动检测语言

task="transcribe",

word_timestamps=True, # 启用单词级时间

print_progress=True

)

# 使用强制对齐对齐 Whisper 输出

model_a, metadata = whisperx.load_align_model(

language_code=result["language"],

device="cuda"

)

result = whisperx.align(

result["segments"],

model_a,

metadata,

speech_source,

device="cuda"

)

# 分配说话者标签

diarize_model = whisperx.DiarizationPipeline(

use_auth_token=False,

device="cuda"

)

diarize_segments = diarize_model(speech_source)

result = whisperx.assign_word_speakers(diarize_segments, result)

WhisperX 通过优化推理、改进说话者区分和增强单词级时间准确性,改进了基础 Whisper 模型。强制对齐步骤确保音频与转录之间的精确同步。

强制对齐和单词级时间戳

强制对齐提供精确的单词级时间戳,这对于高质量字幕、视频同步和下游语言处理至关重要。在此阶段,专用声学模型将音频信号与 ASR 系统的初始转录进行对齐,精度远高于原始 ASR 输出。系统不仅知道每个句子或段落的开始和结束时间,还估计每个单词的确切开始和结束时间,有时甚至达到音素级别。此对齐过程通常使用概率序列模型,例如隐马尔可夫模型或神经声学编码器,计算给定声学证据和转录的每个单词的最可能时间。结果是一个丰富的结构,每个单词都带有开始时间、结束时间和置信度分数,段落则附加详细的时间元数据。这些精确的时间戳使得逐帧字幕渲染成为可能,允许编辑者直接跳转到视频时间线中的特定发言部分,并为后续任务(如机器翻译、配音、唇语同步分析或跨大型媒体库的基于内容的搜索)创建可靠的时间基础。

说话者区分实现

说话者区分负责回答“谁在何时说话”的问题,将原始转录转化为结构化的、关注说话者的对话。系统首先将音频分成可能包含单一主导说话者的同质段落,然后将每个段落转换为称为说话者嵌入的紧凑数值表示,捕捉音色、音调模式和说话风格等特征。利用这些嵌入,聚类算法将听起来相似的段落分组为一致的说话者身份,而无需事先了解有多少说话者或他们是谁。先进的区分管道可以自适应估计说话者数量,细化说话者重叠的边界,并平滑标签,以便在长录音中为同一个人分配相同的说话者 ID。最终的区分转录将每个段落,通常每个单词,与稳定的说话者标签关联,使得应用程序如会议记录、每位说话者的摘要、呼叫中心分析、个性化内容推荐和更清晰的字幕成为可能,这些字幕指示每个时刻哪个角色或参与者在发言。

后处理和质量保证

后处理和质量保证阶段将原始模型输出转化为适合最终用户和下游系统的精致、生产就绪的转录。后处理通常从规范化步骤开始,例如修复大小写、扩展或标准化数字、处理缩略词和恢复标点,使文本读起来像自然散文,而不是一系列平坦的标记。然后将时间戳格式化为标准化的字幕时间码,并根据长度、持续时间和语言边界将转录分段为可读的字幕单元或段落。质量保证在这个清理后的转录上增加了一层验证:它将单词级置信度分数聚合为段落级指标,检测异常低置信度段落、突发时间间隔或可疑重复,并将其标记为人工审核或自动重新处理。额外的检查可以强制执行风格指南,在适当时删除不流畅或填充词,并确保说话者标签在整个文件中保持一致。通过这些后处理和质量保证步骤,最终输出不仅反映所说的内容,还符合专业转录、本地化和可访问性工作流所需的准确性、可读性和格式标准。

技术挑战与解决方案

重叠语音:多个说话者同时说话会造成 ASR 挑战。解决方案包括音频源分离、多说话者模型和复杂的区分算法。

多语言切换:语言之间的代码切换需要能够同时处理多种语言的模型。先进的系统使用语言识别和专用的多语言模型。

嘈杂环境:背景音乐、环境噪声和差的音频质量降低转录准确性。音频预处理和源分离技术可以缓解这些问题。

延迟与准确性:实时应用需要低延迟,但可能牺牲准确性。生产系统必须根据用例平衡这些竞争要求。

生产系统设计

批处理与流处理:批处理优化成本和吞吐量,而流处理则为实时应用提供实时转录。

GPU 推理优化:模型量化、批处理和张量并行化降低计算成本,同时保持准确性。

管道编排:消息队列(如 Azure Service Bus)在处理阶段之间进行协调,实现可扩展的、容错的工作流。

成本优化策略:动态批处理、临时实例和模型压缩降低基础设施成本,同时保持服务水平协议。

技术架构比较

| 组件 | 基本 ASR | WhisperX | 企业管道 |

|---|---|---|---|

| 音频处理 | 单通道 | 基本过滤 | Conv-TasNet 分离 |

| 语音识别 | HMM/GMM | Transformer | WhisperX + 微调 |

| 说话者区分 | 无 | 基本聚类 | 高级聚类 + 语音分析 |

| 强制对齐 | 无 | 基本对齐 | 单词级精确对齐 |

| 质量保证 | 手动 | 置信度评分 | 自动 + 人工审核 |

| 可扩展性 | 有限 | 中等 | 企业级 |

| 准确性 | 70-85% | 90-95% | 95-98% |

技术权衡:

- 延迟与准确性:更大的模型提供更好的准确性,但会增加处理时间

- 计算成本:GPU 加速对生产规模处理至关重要

- 模型大小:量化减少内存使用,但可能影响边缘案例的准确性

- 语言支持:多语言模型需要更多的存储和计算资源

Curify 的生产转录架构

Curify 的转录系统代表了一种生产级实现,采用最先进的音频处理技术,旨在实现规模、准确性和可靠性。我们的架构将多个专用神经网络结合成一个统一的管道,以最小的人为干预处理视频内容。

核心技术组件:

音频处理堆栈:利用 Conv-TasNet 进行源分离和 WhisperX 进行转录,Curify 即使在嘈杂环境中也能实现 95% 以上的准确性。该系统以 16kHz 分辨率处理音频,应用实时噪声减少和说话者区分以隔离个别声音。

质量保证管道:自动置信度评分识别潜在的转录错误以供人工审核。该系统使用在特定领域术语上训练的语言模型来提高技术内容的准确性,并具备行业特定词汇的微调能力。

基础设施:部署在 GPU 集群上,支持 100 多个并发转录作业。该系统在大约 2 分钟内处理 1 小时的视频,具体取决于内容复杂性和音频质量。

管道编排:Azure Service Bus 队列在处理阶段之间进行协调,实现容错工作流,能够自动处理故障和重试。该系统支持批处理以降低成本效率,并支持实时应用的流处理。

🎯 准备好为您的组织实施先进的转录管道了吗? 探索 Curify 的技术转录解决方案

视频转录技术的未来

视频转录技术已经从基本的语音识别系统演变为复杂的多阶段管道,结合了神经网络、音频处理和优化技术的进步。像 Curify 的管道这样的现代系统展示了如何将 Conv-TasNet 用于音频分离、WhisperX 用于转录以及先进的质量保证集成到生产级工作流中。

对于技术团队和开发人员来说,关键的收获是视频转录不再是一个研究问题,而是一个解决的工程挑战。剩下的机会在于优化、边缘案例和集成,而不是根本技术限制。随着这些系统通过更好的模型架构和更大的训练数据集不断改进,我们正接近一个未来,在这个未来中,完美的转录可以在任何内容类型上大规模提供。

这里描述的技术架构代表了 2026 年的最新技术,但该领域仍在快速发展。实时转录、零样本说话者识别和自动内容摘要已经成为新兴能力,将进一步改变我们处理和分析视频内容的方式。

相关文章

video-translation-dubbing

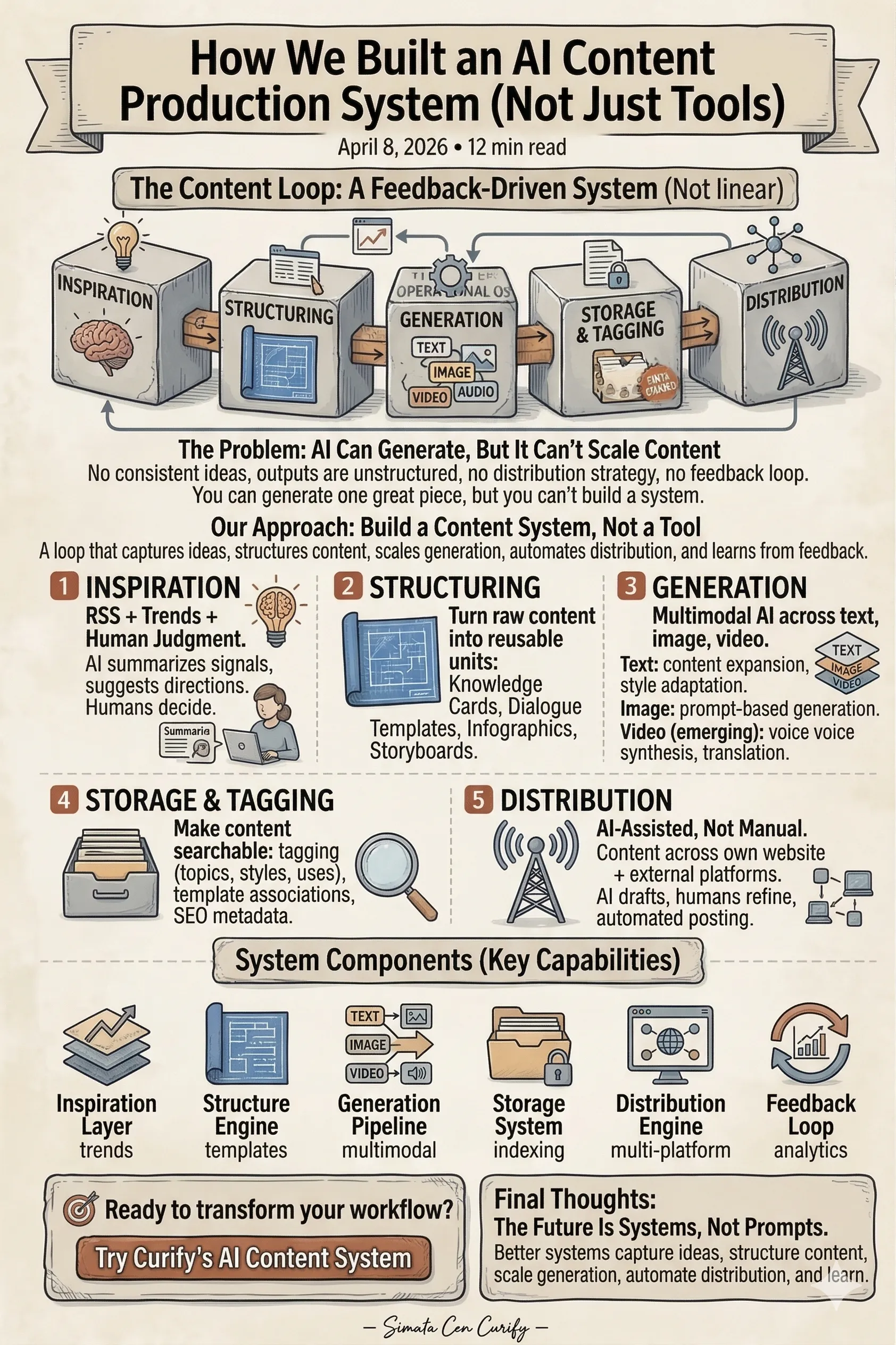

How We Built an AI Content Production System (Not Just Tools)

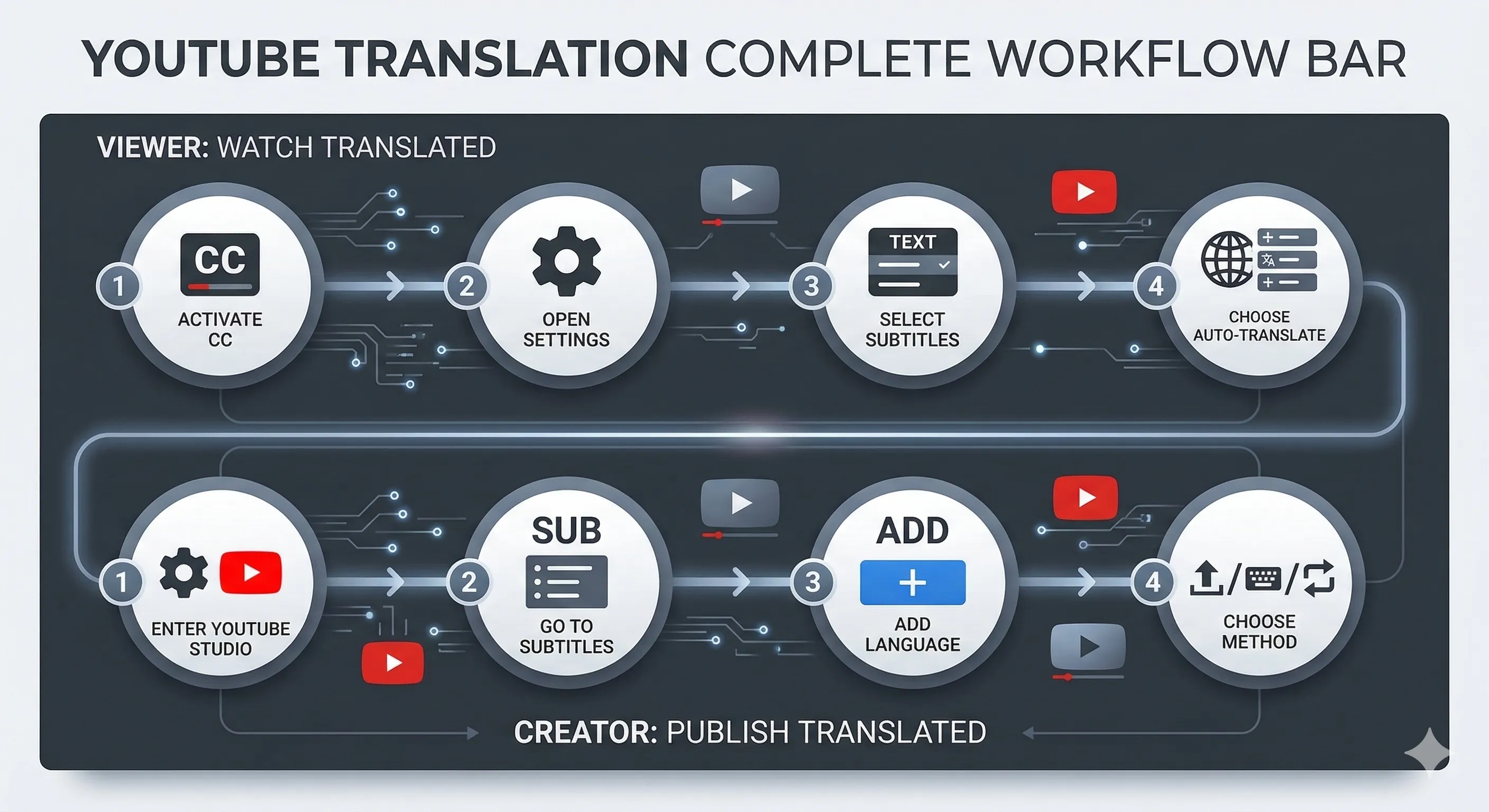

Inside Curify's Video Translation Pipeline: A Technical Deep-Dive