Derinlemesine: Transkripsiyon Teknik Genel Bakışı

Çoğu transkripsiyon aracı konuşmadan metne kadar durur. Bu derinlemesine inceleme, Curify'nin tam transkripsiyon sürecini yürütür: sesin arka plandaki müzikten nasıl ayrıldığı, WhisperX'in temizlenmiş parça üzerinde nasıl çalıştığı, konuşmacı diarizasyonunun örtüşen sesleri nasıl ayırdığı ve zorunlu hizalamanın kelime düzeyinde zaman damgalarını transkripte nasıl geri koyduğu, böylece çıktı aşağı akıştaki altyazı, dublaj ve çeviri araçlarını [/tools/video-transcript-generator](/tools/video-transcript-generator) yönlendirebilir. Eğer transkripsiyonu daha büyük bir sürece entegre etmek istiyorsanız, sadece bir SRT indirmek yerine, çoğu blog yazısının atladığı katman budur.

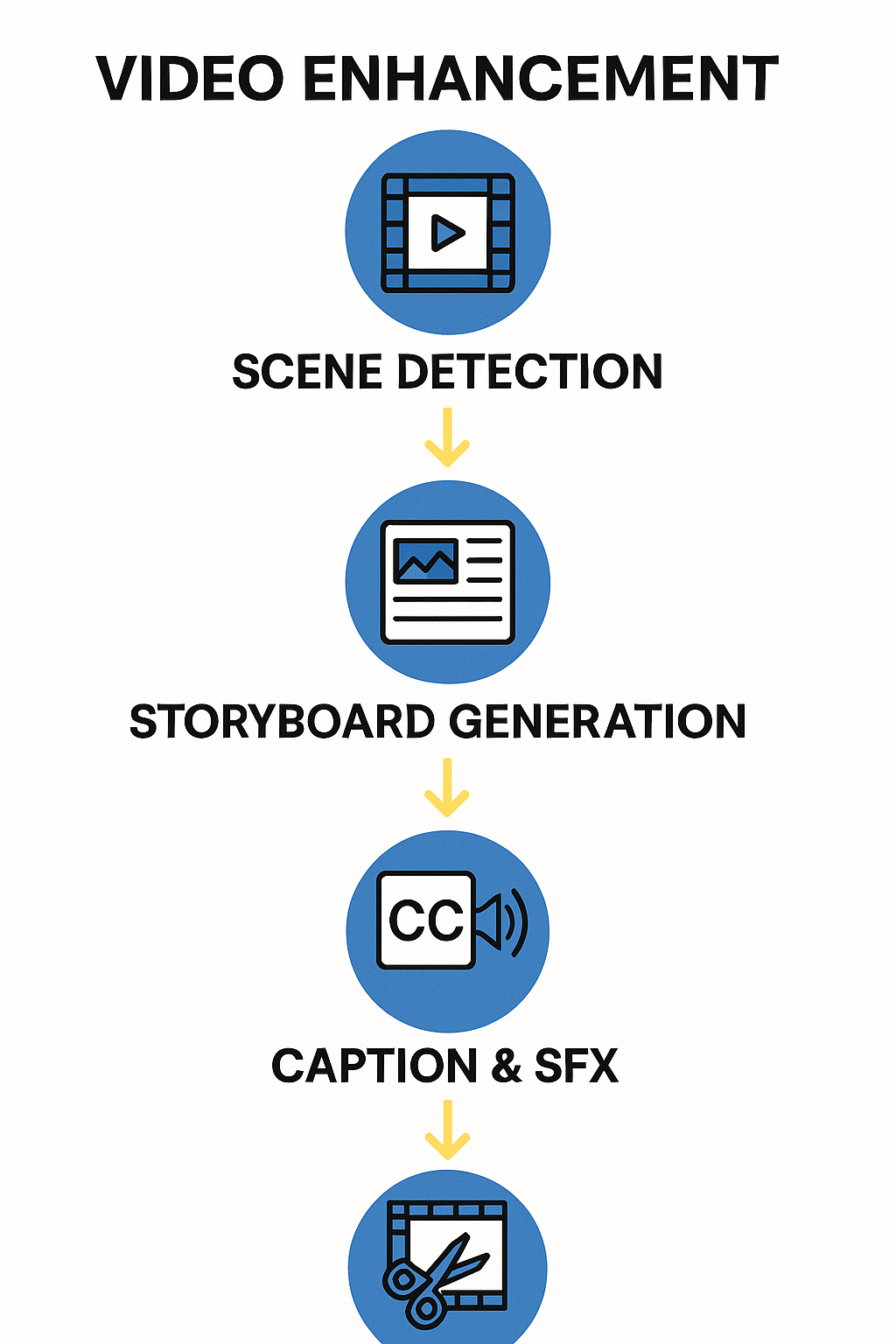

Uçtan Uca Video Transkripsiyon Boru Hattı

Üretim düzeyinde bir video transkripsiyon boru hattı, ham video içeriğini yapılandırılmış, zaman senkronize metne dönüştürmek için birden fazla sofistike işleme aşamasından geçer. Tam iş akışı: Video → Ses çıkarımı → Segmentasyon → ASR (Otomatik Konuşma Tanıma) → Hizalama → Konuşmacı Ayrıştırma → Son işlem.

Her aşama, belirli teknik zorlukları ele alır: ses çıkarımı, konuşma parçasını izole eder, segmentasyon, uzun sesleri yönetilebilir parçalara böler, ASR konuşmayı metne dönüştürür, hizalama kelime düzeyinde zaman damgaları sağlar, ayrıştırma, kimin ne zaman konuştuğunu tanımlar ve son işlem, nihai çıktıyı temizler ve biçimlendirir.

Modern sistemler, Curify'nin boru hattı gibi, zorlu koşullarda bile %95'ten fazla doğruluk elde etmek için ses ayrıştırma için Conv-TasNet, konuşma tanıma için WhisperX ve konuşmacı tanımlama için gelişmiş kümeleme algoritmalarını birleştirir. Bu teknik derin dalış, her bileşeni ve entegrasyon stratejilerini keşfeder.

Neden Teknik Mimari Transkripsiyon İçin Önemlidir

Doğruluk ve Hız Dengesi: Daha büyük modeller daha iyi doğruluk sağlar ancak işleme süresini ve hesaplama maliyetlerini artırır. Üretim sistemleri, kullanım durumu gereksinimlerine göre bu faktörleri dengelemelidir.

Ölçeklenebilirlik Zorlukları: Gerçek zamanlı transkripsiyon, akış işleme ve düşük gecikmeli çıkarım gerektirirken, toplu işleme, verimlilik ve maliyet etkinliği için optimize edilebilir.

Çok Dilli Karmaşıklık: Diller arasında karışık konuşma ve diller arası içerik, dil sınırları boyunca bağlamı koruyabilen özel modellere ihtiyaç duyar.

Üretim Güvenilirliği: Kurumsal sistemlerin, gerçek dünya içeriği ile kaçınılmaz olarak ortaya çıkan kenar durumlarını ele almak için yedekleme mekanizmaları, kalite izleme ve otomatik hata kurtarma gereklidir.

Temel Boru Hattı Bileşenleri

Ses Ön İşleme ve Segmentasyon

Boru hattı, kaynak ayrıştırma ve ses segmentasyonu için Conv-TasNet kullanarak sofistike ses ön işleme ile başlar. Bu aşama, insan konuşmasını arka plan müziğinden, çevresel gürültüden ve diğer ses kaynaklarından ayırır.

Teknik Uygulama:

# Ses ayrıştırma Conv-TasNet kullanarak

import torch

import torchaudio

from conv_tasnet import ConvTasNet

# Kaynak ayrıştırma modelini başlat

separator = ConvTasNet(

n_bases=512, # Temel fonksiyon sayısı

kernel_size=16, # Konvolüsyon çekirdek boyutu

stride=8, # Zamansal konvolüsyonlar için adım

n_layers=8, # Konvolüsyon katmanları sayısı

n_src=2 # Ayrıştırılacak kaynak sayısı

)

# 16kHz'de ses dalgasını işleyin

audio_tensor, sample_rate = torchaudio.load('input_video.wav')

if sample_rate != 16000:

resampler = torchaudio.transforms.Resample(sample_rate, 16000)

audio_tensor = resampler(audio_tensor)

# Kaynakları ayırın

with torch.no_grad():

separated_sources = separator(audio_tensor)

speech_source = separated_sources[0] # Ana konuşmayı çıkar

Conv-TasNet mimarisi, ses kaynaklarını doğrudan ham dalga formlarından ayırmak için zamansal konvolüsyonel ağlarla konvolüsyonel kodlama-çözme yapıları kullanır ve spektrum tabanlı yaklaşımlarla ilişkili bilgi kaybını önler.

ASR (Konuşmadan Metne) WhisperX ile

Temiz konuşma, transkripsiyon doğruluğu ve hızı için optimize edilmiş OpenAI'nin Whisper modelinin geliştirilmiş bir versiyonu olan WhisperX'e beslenir. Sistem, konuşmacı ayrıştırması aracılığıyla birden fazla konuşmacıyı, lehçeyi ve aksanı yönetir - sesi konuşmacı kimliğine göre otomatik olarak segmentlere ayırır.

Teknik Uygulama:

# Gelişmiş konuşma tanıma WhisperX kullanarak

import whisperx

import torch

from whisperx.utils import get_writer

# Transkripsiyon için WhisperX modelini yükleyin

model = whisperx.load_model("large-v3", device="cuda")

# Kelime düzeyinde zaman damgaları ve konuşmacı ayrıştırması ile transkripsiyon yapın

result = model.transcribe(

speech_source,

batch_size=32, # Verimlilik için partiler halinde işleyin

language="auto", # Dili otomatik olarak algıla

task="transcribe",

word_timestamps=True, # Kelime düzeyinde zamanlamayı etkinleştir

print_progress=True

)

# Zorunlu hizalama kullanarak whisper çıktısını hizalayın

model_a, metadata = whisperx.load_align_model(

language_code=result["language"],

device="cuda"

)

result = whisperx.align(

result["segments"],

model_a,

metadata,

speech_source,

device="cuda"

)

# Konuşmacı etiketlerini atayın

diarize_model = whisperx.DiarizationPipeline(

use_auth_token=False,

device="cuda"

)

diarize_segments = diarize_model(speech_source)

result = whisperx.assign_word_speakers(diarize_segments, result)

WhisperX, optimize edilmiş çıkarım, daha iyi konuşmacı ayrıştırması ve geliştirilmiş kelime düzeyinde zamanlama doğruluğu ile temel Whisper modelinin üzerine inşa edilmiştir. Zorunlu hizalama aşaması, ses ve transkript arasındaki hassas senkronizasyonu sağlar.

Zorunlu Hizalama ve Kelime Düzeyinde Zaman Damgaları

Zorunlu hizalama, yüksek kaliteli altyazılar, video senkronizasyonu ve sonraki dil işleme için gerekli olan hassas kelime düzeyinde zaman damgaları sağlar. Bu aşamada, özel bir akustik model, ses sinyalini ve ASR sisteminden gelen bir başlangıç transkriptini alır ve bunları ham ASR çıktısından çok daha ince bir ayrıntı düzeyinde hizalar. Her cümlenin veya bölümün ne zaman başladığını ve bittiğini bilmek yerine, sistem, her kelimenin tam başlangıç ve bitiş zamanını tahmin eder, bazen hatta fonem düzeyinde. Bu hizalama süreci genellikle, akustik kanıt ve transkript göz önüne alındığında her kelimenin en olası zamanlamasını hesaplamak için olasılıksal dizilim modelleri, gizli Markov modelleri veya sinir akustik kodlayıcıları gibi yöntemler kullanır. Sonuç, her kelimenin başlangıç zamanı, bitiş zamanı ve güven puanları ile etiketlendiği zengin bir yapı ve bölümlerin ayrıntılı zamanlama meta verileri ile zenginleştirildiği bir yapı sunar. Bu hassas zaman damgaları, çerçeve doğruluğuna sahip altyazı oluşturmayı, editörlerin bir video zaman çizelgesinde belirli konuşma bölümlerine doğrudan atlamasını sağlar ve daha sonra makine çevirisi, dublaj, dudak senkronizasyonu analizi veya büyük medya kütüphanelerinde içerik tabanlı arama gibi görevler için güvenilir bir zamansal omurga oluşturur.

Konuşmacı Ayrıştırma Uygulaması

Konuşmacı ayrıştırma, bir ses veya video dosyasında "kim ne zaman konuştu" sorusunu yanıtlamaktan sorumludur ve ham bir transkripti yapılandırılmış, konuşmacı farkındalığına sahip bir konuşmaya dönüştürür. Sistem, sesi, muhtemelen tek bir baskın konuşmacıyı içeren homojen segmentlere ayırır ve ardından her segmenti, timbre, tonlama kalıpları ve konuşma tarzı gibi özellikleri yakalayan bir konuşmacı gömme biçiminde kompakt bir sayısal temsile dönüştürür. Bu gömme kullanılarak, kümeleme algoritmaları, önceden kaç konuşmacının bulunduğunu veya kim olduklarını bilmeden benzer sesleri gruplar. Gelişmiş ayrıştırma boru hatları, konuşmacı sayısını uyumlu bir şekilde tahmin edebilir, konuşmacıların örtüştüğü yerlerde sınırları iyileştirebilir ve uzun kayıtlar boyunca aynı konuşmacı kimliğinin atanmasını sağlamak için etiketleri düzleştirebilir. Sonuçta elde edilen ayrıştırılmış transkript, her segmenti ve genellikle her kelimeyi, sabit bir konuşmacı etiketi ile ilişkilendirir ve toplantı tutanakları, konuşmacı bazında özetler, çağrı merkezi analitiği, kişiselleştirilmiş içerik önerileri ve her an hangi karakterin veya katılımcının konuştuğunu gösteren daha net altyazılar gibi uygulamalara olanak tanır.

Son İşleme ve Kalite Güvencesi

Son işleme ve kalite güvencesi aşaması, ham model çıktısını son kullanıcılar ve sonraki sistemler için uygun, cilalı bir transkripte dönüştürür. Son işleme genellikle, metnin düz bir token dizisi yerine doğal bir anlatım gibi okunmasını sağlamak için büyük harf düzeltmeleri, sayıların genişletilmesi veya standartlaştırılması, kısaltmaların işlenmesi ve noktalamanın geri yüklenmesi gibi normalleştirme adımlarıyla başlar. Zaman damgaları, standart altyazı zaman kodlarına biçimlendirilir ve transkript, uzunluk, süre ve dilsel sınırlar dikkate alınarak okunabilir altyazı birimlerine veya paragraflara bölünür. Kalite güvencesi, bu temizlenmiş transkriptin üzerine bir doğrulama katmanı ekler: kelime düzeyindeki güven puanlarını segment düzeyindeki metriklere toplar, alışılmadık derecede düşük güven düzeyine sahip bölümleri, ani zaman boşluklarını veya şüpheli tekrarları tespit eder ve bunları insan incelemesi veya otomatik yeniden işleme için işaretler. Ek kontrol mekanizmaları, stil kılavuzlarını zorlayabilir, uygun olduğunda belirsizlikleri veya dolgu kelimelerini kaldırabilir ve konuşmacı etiketlerinin dosya boyunca tutarlı kalmasını sağlayabilir. Birlikte, bu son işleme ve QA adımları, nihai çıktının yalnızca söylenenleri yansıtmasını değil, aynı zamanda profesyonel transkripsiyon, yerelleştirme ve erişilebilirlik iş akışları için gereken doğruluk, okunabilirlik ve biçimlendirme standartlarını da karşılamasını sağlar.

Teknik Zorluklar ve Çözümler

Örtüşen Konuşma: Birden fazla konuşmacının aynı anda konuşması ASR zorlukları yaratır. Çözümler arasında ses kaynağı ayrıştırması, çoklu konuşmacı modelleri ve sofistike ayrıştırma algoritmaları bulunur.

Çok Dilli Geçiş: Diller arasında kod geçişi, birden fazla dili aynı anda yönetebilen modellere ihtiyaç duyar. Gelişmiş sistemler, dil tanımlama ve özel çok dilli modeller kullanır.

Gürültülü Ortamlar: Arka plan müziği, çevresel gürültü ve kötü ses kalitesi, transkripsiyon doğruluğunu azaltır. Ses ön işleme ve kaynak ayrıştırma teknikleri bu sorunları hafifletir.

Gecikme ve Doğruluk: Gerçek zamanlı uygulamalar düşük gecikme gerektirir ancak doğruluktan ödün verebilir. Üretim sistemleri, bu karşıt gereksinimleri kullanım durumuna göre dengelemelidir.

Üretim Sistemi Tasarımı

Toplu ve Akış İşleme: Toplu işleme maliyet ve verimlilik için optimize edilirken, akış işleme canlı uygulamalar için gerçek zamanlı transkripsiyonu sağlar.

GPU Çıkarım Optimizasyonu: Model nicemesi, toplu işleme ve tensör paralelleştirmesi, doğruluğu korurken hesaplama maliyetlerini azaltır.

Boru Hattı Orkestrasyonu: Mesaj kuyrukları (Azure Service Bus gibi), işleme aşamaları arasında koordinasyon sağlar ve ölçeklenebilir, hata toleranslı iş akışlarını mümkün kılar.

Maliyet Optimizasyon Stratejileri: Dinamik toplama, spot örnekler ve model sıkıştırması, hizmet düzeyi anlaşmalarını korurken altyapı maliyetlerini azaltır.

Teknik Mimari Karşılaştırması

| Bileşen | Temel ASR | WhisperX | Kurumsal Boru Hattı |

|---|---|---|---|

| Ses İşleme | Tek kanal | Temel filtreleme | Conv-TasNet ayrıştırması |

| Konuşma Tanıma | HMM/GMM | Dönüştürücü | WhisperX + ince ayar |

| Konuşmacı Ayrıştırma | Yok | Temel kümeleme | Gelişmiş kümeleme + ses profilleme |

| Zorunlu Hizalama | Yok | Temel hizalama | Kelime düzeyinde hassas hizalama |

| Kalite Güvencesi | Manuel | Güven puanlama | Otomatik + insan incelemesi |

| Ölçeklenebilirlik | Sınırlı | Orta | Kurumsal ölçek |

| Doğruluk | %70-85 | %90-95 | %95-98 |

Teknik Ticaret:

- Gecikme ve Doğruluk: Daha büyük modeller daha iyi doğruluk sağlar ancak işleme süresini artırır

- Hesaplama Maliyeti: GPU hızlandırması, üretim ölçeğinde işleme için esastır

- Model Boyutu: Nicemesi, bellek kullanımını azaltır ancak kenar durumlarındaki doğruluğu etkileyebilir

- Dil Desteği: Çok dilli modeller daha fazla depolama ve hesaplama kaynakları gerektirir

Curify'nin Üretim Transkripsiyon Mimarisi

Curify'nin transkripsiyon sistemi, ölçek, doğruluk ve güvenilirlik için tasarlanmış en son ses işleme teknolojilerinin üretim düzeyinde bir uygulamasını temsil eder. Mimarimiz, video içeriğini uçtan uca en az insan müdahalesi ile işleyen birleştirilmiş bir boru hattı oluşturmak için birden fazla özel sinir ağı kombinasyonu içerir.

Temel Teknik Bileşenler:

Ses İşleme Yığını: Kaynak ayrıştırma için Conv-TasNet ve transkripsiyon için WhisperX kullanarak, Curify, gürültülü ortamlarda bile %95'ten fazla doğruluk elde eder. Sistem, sesleri 16kHz çözünürlükte işler, bireysel sesleri izole etmek için gerçek zamanlı gürültü azaltma ve konuşmacı ayrıştırması uygular.

Kalite Güvencesi Boru Hattı: Otomatik güven puanlama, insan incelemesi için potansiyel transkripsiyon hatalarını tanımlar. Sistem, teknik içerik için doğruluğu artırmak amacıyla alan spesifik terminoloji üzerinde eğitilmiş dil modelleri kullanır ve endüstri spesifik kelime dağarcığı için ince ayar yeteneklerine sahiptir.

Altyapı: 100'den fazla eşzamanlı transkripsiyon işini işlemek için dağıtılmış işlemle GPU kümeleri üzerinde dağıtılmıştır. Sistem, içerik karmaşıklığı ve ses kalitesine bağlı olarak 1 saatlik videoyu yaklaşık 2 dakikada işler.

Boru Hattı Orkestrasyonu: Azure Service Bus kuyrukları, işleme aşamaları arasında koordinasyon sağlar ve otomatik olarak hataları ve yeniden denemeleri ele alabilen hata toleranslı iş akışlarını mümkün kılar. Sistem, maliyet etkinliği için toplu işleme ve gerçek zamanlı uygulamalar için akış işleme destekler.

🎯 Kuruluşunuz için gelişmiş transkripsiyon boru hatları uygulamaya hazır mısınız? Curify'nin Teknik Transkripsiyon Çözümlerini Keşfedin

Video Transkripsiyon Teknolojisinin Geleceği

Video transkripsiyon teknolojisi, temel konuşma tanıma sistemlerinden, sinir ağları, ses işleme ve optimizasyon tekniklerindeki ilerlemeleri birleştiren karmaşık çok aşamalı boru hatlarına evrildi. Curify'nin boru hattı gibi modern sistemler, ses ayrımı için Conv-TasNet, transkripsiyon için WhisperX ve gelişmiş kalite güvencesinin üretim kalitesindeki iş akışlarına nasıl entegre edilebileceğini göstermektedir.

Teknik ekipler ve geliştiriciler için önemli olan, video transkripsiyonunun artık bir araştırma sorunu değil, çözülmüş bir mühendislik zorluğu olduğudur. Kalan fırsatlar, temel teknoloji sınırlamaları yerine optimizasyon, kenar durumları ve entegrasyonda yatmaktadır. Bu sistemler, daha iyi model mimarileri ve daha büyük eğitim veri setleri aracılığıyla geliştikçe, her içerik türü için ölçeklenebilir mükemmel transkripsiyonun mümkün olduğu bir geleceğe yaklaşıyoruz.

Burada tanımlanan teknik mimari, 2026'daki mevcut en iyi durumu temsil etmektedir, ancak alan hızla evrilmeye devam etmektedir. Gerçek zamanlı transkripsiyon, sıfırdan konuşmacı tanımlama ve otomatik içerik özetleme, video içerik işleme ve analizine yaklaşımımızı daha da dönüştürecek olan yeni yeteneklerdir.

İlgili Makaleler

video-translation-dubbing

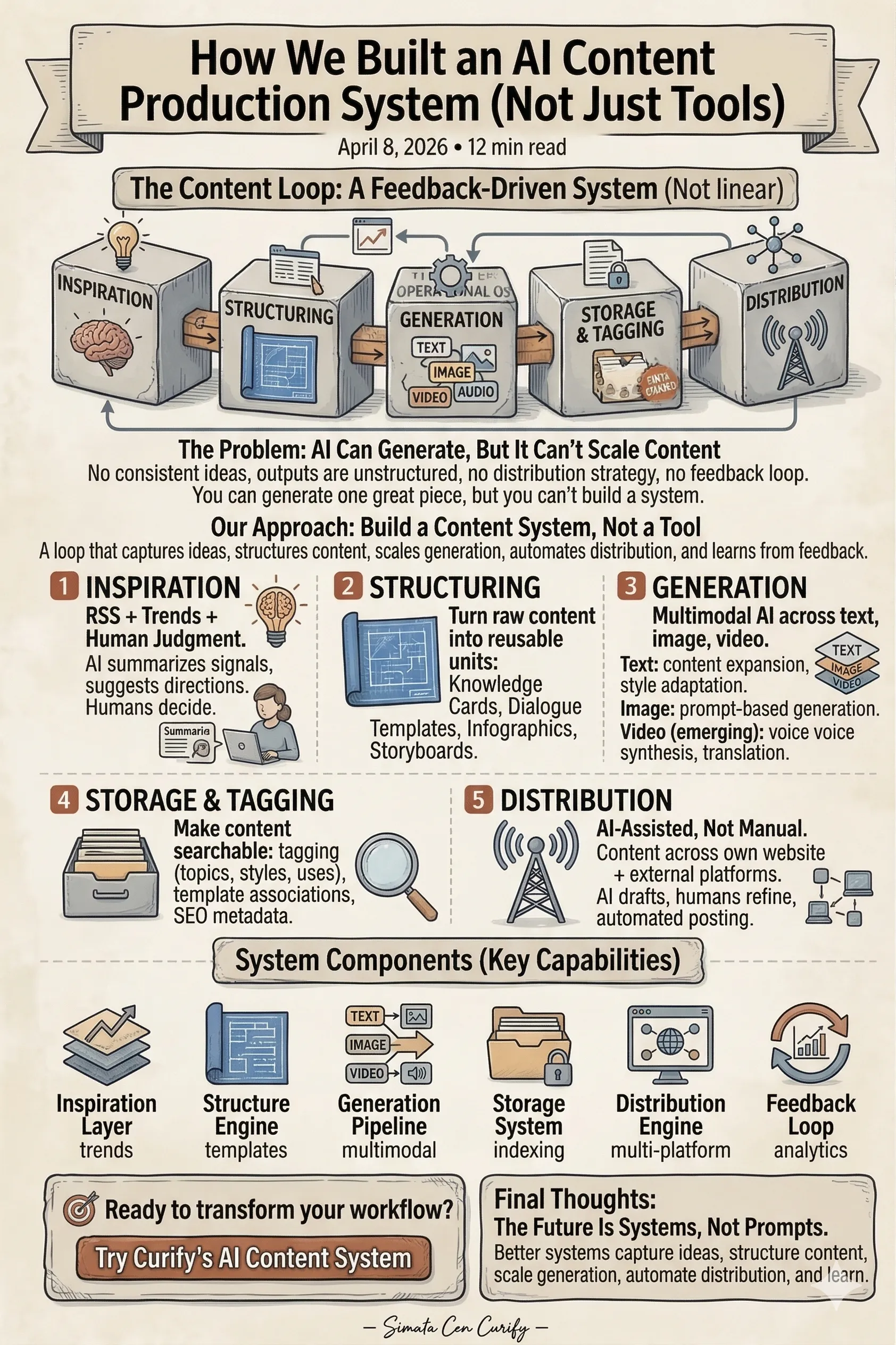

How We Built an AI Content Production System (Not Just Tools)

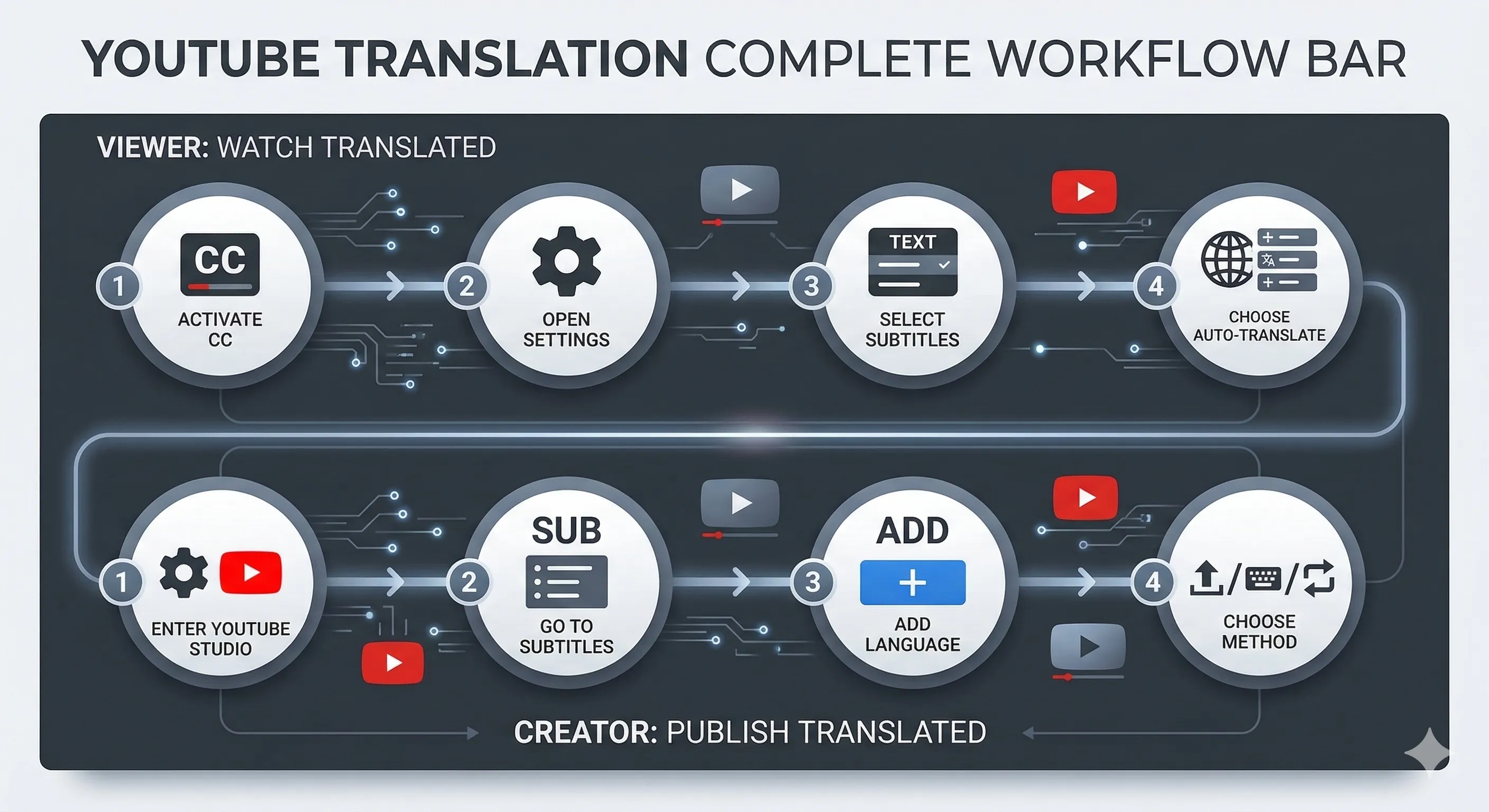

Inside Curify's Video Translation Pipeline: A Technical Deep-Dive